DeepSeek publie des modèles unifiés de compréhension multimodale et de génération : de JanusFlow à Janus-Pro

JanusFlow Lecture rapide

DeepSeek L'équipe a publié un autre nouveau modèle en lançant Janus-Pro, un cadre multimodal innovant aux premières heures du 28, qui est un modèle unifié capable de traiter simultanément les tâches de compréhension et de génération multimodales. Construit sur DeepSeek-LLM-1.5b-base/DeepSeek-LLM-7b-base, le modèle prend en charge l'entrée d'images 384 x 384 et utilise un tokeniser spécifique pour la génération d'images. La caractéristique la plus importante est la division de l'encodage visuel en canaux distincts, tout en conservant un seul canal d'encodage. transformateur pour le traitement.

Cette conception innovante résout non seulement le problème des rôles conflictuels des modèles traditionnels dans les codeurs visuels, mais rend également l'ensemble du système plus flexible. En pratique, Janus-Pro surpasse les modèles unifiés précédents et rivalise même avec les modèles basés sur des tâches spécifiques pour certaines tâches. Il a battu DALL-E 3 et Stable Diffusion d'OpenAI dans les tests GenEval et DPG-Bench.

La série de modèles Janus, qui a débuté avec le JanusFlowL'objectif est de construire uneUn cadre unifié pour la compréhension et la génération multimodalesL'idée principale est de combiner un modèle de langage autorégressif (LLM) avec un modèle de génération de flux rectifié. L'idée de base est de combiner un modèle de langage autorégressif (LLM) avec un modèle de génération de flux rectifié, afin d'obtenir une compréhension visuelle supérieure et des capacités de génération d'images de haute qualité au sein d'un modèle unique.Janus-Pro En tant que version avancée de Janus, les performances du modèle Janus ont encore été améliorées grâce à des optimisations complètes de la stratégie d'apprentissage, de la taille des données et des dimensions du modèle, et des progrès significatifs ont été réalisés dans plusieurs tests de référence. Dans cet article, nous examinons systématiquement l'évolution du modèle Janus, de JanusFlow à Janus-Pro, en nous concentrant sur ses fonctionnalités, les caractéristiques de ses paramètres et ses principales améliorations.

1) JanusFlow : la pierre angulaire de l'architecture unifiée

adresse papier: : https://arxiv.org/pdf/2411.07975

JanusFlow L'innovation principale est sonArchitecture unifiée minimalisteElle intègre intelligemment le modèle de génération de flux modifié dans le cadre du LLM autorégressif sans nécessiter de modifications complexes de la structure du LLM. Les caractéristiques principales de cette architecture sont les suivantes

- Correction de la génération d'images en continu : JanusFlow utilise un modèle de flux modifié pour la génération d'images, en partant d'un bruit gaussien, en prédisant de manière itérative les vecteurs de vitesse pour mettre à jour la représentation de l'espace latent de l'image, et en générant finalement des images de haute qualité par le biais d'un décodeur. Cette approche évite les limites des méthodes traditionnelles où le LLM agit uniquement comme un générateur conditionnel et manque de capacité de génération directe.

- Encodeur visuel découplé : Afin d'optimiser les performances du modèle unifié, JanusFlow utilise la fonctionEncodeur découplédes codeurs visuels distincts sont utilisés pour gérer la tâche de compréhension et la tâche de génération, respectivement :

- Comprendre les codeurs (fenc) : pré-entraîné SigLIP-Large-Patch/16 qui est chargé d'extraire les caractéristiques sémantiques des images afin d'améliorer la compréhension multimodale.

- Générer un codeur (genc) et un décodeur (gdec) : Entraînement à la griffe ConvNeXt module dédié aux tâches de génération d'images afin d'optimiser la qualité de la génération.

- Mécanismes d'alignement des représentations : Au cours du processus de formation à l'unification, JanusFlow introduit les éléments suivantsl'alignement des caractèresqui aligne les représentations intermédiaires des modules de génération et de compréhension, améliorant ainsi la cohérence sémantique et la consistance du processus de génération.

- Une stratégie de formation en trois phases : JanusFlow a conçu un programme de formation en trois étapes :

- Étape 1 : Initialisation aléatoire Adaptation des composants - La couche linéaire, le codeur et le décodeur du générateur sont entraînés à travailler avec les codeurs LLM et SigLIP pré-entraînés en tant que phase d'initialisation pour l'entraînement ultérieur.

- Étape 2 : Harmonisation de la préformation - Entraîner l'ensemble du modèle, à l'exception de l'encodeur visuel, en fusionnant la compréhension multimodale, la génération d'images et les données en texte brut afin d'établir initialement les capacités d'unification du modèle.

- Étape 3 : Suivi de la mise au point - Les données de réglage fin des commandes sont utilisées pour entraîner davantage le modèle afin d'améliorer la réponse aux commandes de l'utilisateur et de dégeler les paramètres de l'encodeur SigLIP à ce stade.

Caractéristiques des paramètres :

- Foundation LLM : Architecture LLM légère avec 1,3 milliard de paramètres.

- Encodeur visuel : SigLIP-Large-Patch/16 (compréhension), ConvNeXt (génération d'encodeurs et de décodeurs).

- Résolution de l'image : 384 × 384 pixels.

Performance : JanusFlow atteint des performances significatives à la fois sur la génération de texte à partir d'images et sur les tâches de compréhension multimodale, surpassant de nombreux modèles spécialisés et prouvant l'efficacité de son architecture unifiée.

2. Janus-Pro : une mise à jour complète des données, des modèles et des stratégies

adresse papier: : https://github.com/deepseek-ai/Janus/blob/main/janus_pro_tech_report.pdf

Janus-Pro En tant que version améliorée de Janus, JanusFlow a été mis à niveau dans trois domaines principaux :

- Des stratégies de formation optimisées : Janus-Pro affine la stratégie de formation en trois étapes de JanusFlow, dans le but d'améliorer l'efficacité de la formation et les goulets d'étranglement en matière de performance :

- Étape 1 : Entraînement à l'ensemble de données ImageNet étendu - L'augmentation du nombre d'étapes de formation sur l'ensemble de données ImageNet permet au modèle d'apprendre plus complètement les dépendances entre les pixels, améliorant ainsi les capacités sous-jacentes de la génération d'images.

- Étape 2 : Se concentrer sur la formation aux données texte-image - Lors de la phase 2 de l'apprentissage, les données ImageNet sont supprimées et l'ensemble de données texte-image normal est utilisé directement, ce qui permet au modèle d'apprendre plus efficacement à générer des images de haute qualité sur la base de descriptions textuelles denses.

- Étape 3 : Mise à l'échelle des données - Dans la phase d'ajustement supervisé, les rapports entre les données de compréhension multimodale, les données textuelles et les données texte-image ont été ajustés (de 7:3:10 à 5:1:4) afin d'améliorer encore les performances de compréhension multimodale tout en garantissant la capacité de génération visuelle.

- Données de formation étendues : Janus-Pro augmente considérablement la taille et la diversité des données d'apprentissage afin d'améliorer la capacité de généralisation et la qualité de génération du modèle :

- Compréhension multimodale des données : Lors de la phase 2 de pré-entraînement, environ 90 millions de nouveaux échantillons ont été ajoutés, couvrant un plus large éventail de données de sous-titrage d'images (par exemple, YFCC) ainsi que des données de compréhension de tableaux, de graphiques et de documents (par exemple, Docmatix). D'autres échantillons sont introduits lors de la phase 3 de mise au point. Recherche en profondeur-VL2 ainsi que la compréhension MEME, les données de dialogue chinoises, etc., ce qui améliore considérablement la capacité de dialogue et la capacité multitâche du modèle.

- Données générées visuellement : Afin d'améliorer la qualité esthétique et la stabilité des images générées, Janus-Pro introduit environ 72 millions de données esthétiques synthétiques de haute qualité et ajuste le ratio données réelles/données synthétiques à 1:1. Les expériences montrent que l'ajout de données synthétiques accélère la convergence du modèle et améliore de manière significative la qualité esthétique et la stabilité des images générées.

- Taille étendue du modèle : Janus-Pro conserve non seulement le modèle paramétrique 1,5B de JanusFlow, mais l'élargit également pour inclure les éléments suivants 7B Paramètreset fournit Série Janus-Pro dans les modèles 1.5B et 7B.Les résultats expérimentaux montrent que le LLM à grande échelle peut améliorer de manière significative la performance du modèle et accélérer la vitesse de convergence. Les résultats expérimentaux montrent que les LLM à grande échelle peuvent améliorer de manière significative la performance du modèle et accélérer la vitesse de convergence, validant ainsi l'évolutivité de l'architecture du modèle Janus.

Caractéristiques des paramètres :

- Dimensions du modèle : Disponible dans les modèles 1.5B et 7B.

- Architecture : Suit l'architecture du codeur visuel découplé de JanusFlow.

- Données de formation : Données d'entraînement considérablement élargies et optimisées pour la compréhension multimodale et la génération visuelle.

- Résolution de l'image : La résolution de l'image utilisée dans les expériences est restée de 384 × 384 pixels.

Performance : Janus-Pro a démontré l'efficacité des mises à jour des données, des modèles et des stratégies en réalisant des gains de performance significatifs dans tous les benchmarks, en particulier dans le benchmark de compréhension multimodale MMBench et les benchmarks de génération de texte à partir d'images GenEval et DPG-Bench, qui ont tous deux surpassé JanusFlow et d'autres modèles unifiés et spécialisés avancés.

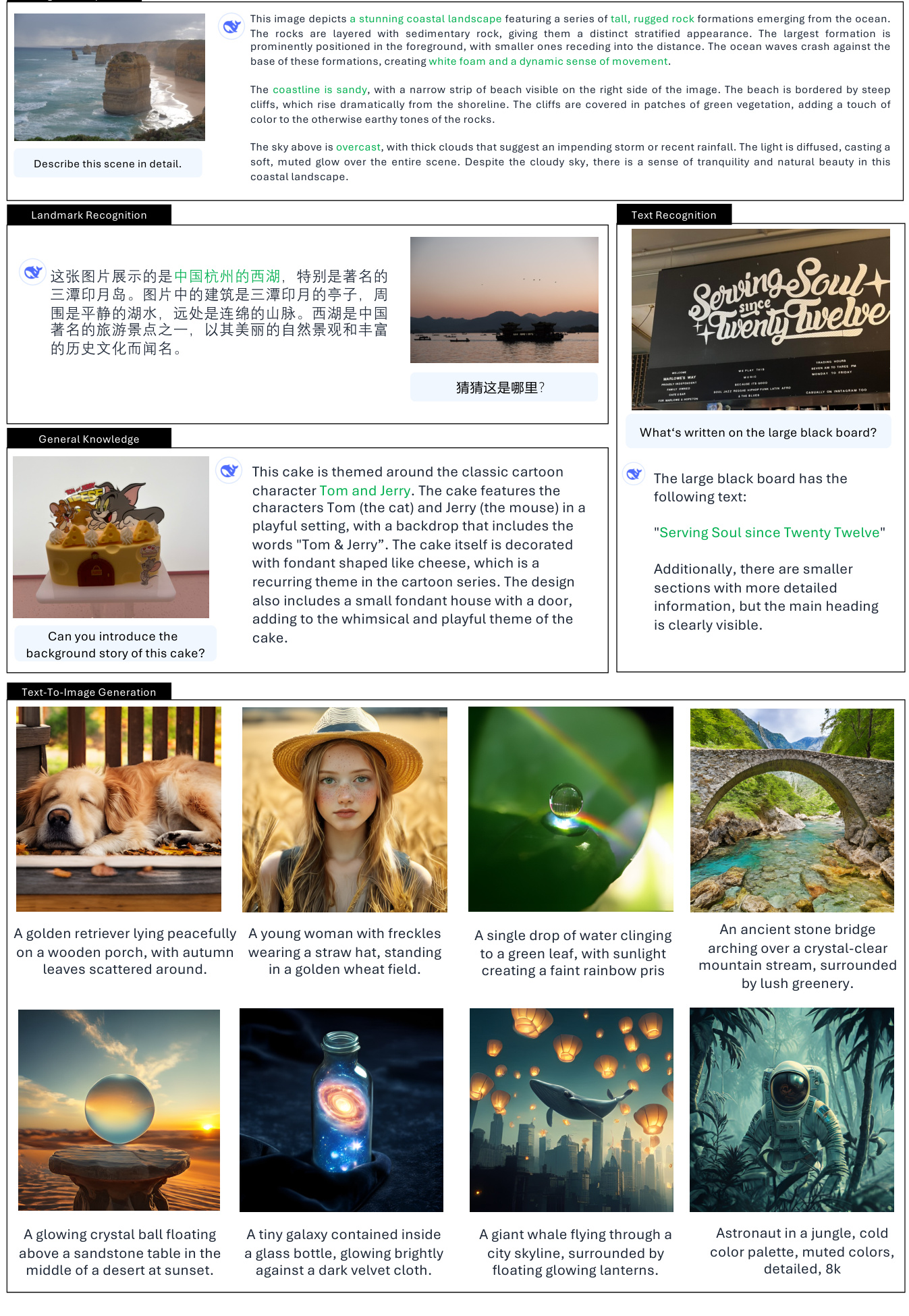

3.Janus : scénarios d'utilisation réelle

Fonctions de compréhension visuelle :

- Description de l'image / sous-titrage.

- Description détaillée de la scène : permet de générer des descriptions textuelles détaillées basées sur le contenu de l'image, y compris les éléments de la scène, les objets, l'atmosphère environnementale, etc. (Exemple : description des trois piscines du lac de l'Ouest, du paysage de bord de mer, etc.)

- Description graphique : être capable de comprendre et de décrire des informations sur des graphiques et des tableaux, tels que la représentation des données et l'analyse des tendances des diagrammes à barres. (Exemple : Interpréter le diagramme à barres "Fruits préférés des enfants")

- Reconnaissance/classification d'objets.

- Identifier les types d'objets dans une image : être capable d'identifier et d'énumérer les catégories d'objets qui apparaissent dans une image. (Exemple : identifier le type de fruit dans une image)

- Comptage d'objets.

- Compter avec précision le nombre d'objets dans une image : capacité à compter avec précision le nombre d'objets spécifiques dans une image (exemple : compter le nombre de pingouins dans l'image). (Exemple : compter le nombre de pingouins dans l'image)

- Reconnaissance d'un événement marquant.

- Identifier des points de repère célèbres sur des images : être capable d'identifier des points de repère ou des lieux qui apparaissent sur une image. (Exemple : identifier les trois bassins du lac de l'Ouest)

- Reconnaissance de texte/OCR.

- Reconnaître le contenu textuel d'une image : être capable de reconnaître un texte apparaissant dans une image et d'en extraire l'information textuelle. (Exemple : identifier "Serving Soul since Twenty Twelve" sur un tableau noir)

- Réponse visuelle aux questions.

- Répondre à des questions en fonction du contenu de l'image : être capable de comprendre le contenu d'une image et de donner une réponse raisonnable en fonction de la question de l'utilisateur. (Exemple : demander "Quel fruit se trouve sur l'image ?" en réponse à une image).

- Raisonnement visuel/Intégration des connaissances.

- Comprendre les significations et les associations derrière les images : être capable de raisonner visuellement à un niveau plus profond et de contextualiser les connaissances. (Exemples : expliquer l'humour de l'image du chien de la Joconde, comprendre le contexte du dessin animé du gâteau).

- Génération de code (Python pour le traçage).

- Générer du code en fonction des commandes de l'utilisateur : comprendre les besoins de l'utilisateur en matière de graphiques et générer du code Python en conséquence. (Exemple : générer du code Python pour dessiner un diagramme à barres)

Fonction de génération de texte à partir d'une image :

- Génération d'images guidée par le texte.

- Générer des images à partir de descriptions textuelles : permet de générer des images sémantiquement liées à des textes saisis par l'utilisateur.

- Génération d'images créatives : capacité à comprendre des textes abstraits et imaginatifs pour générer des images créatives et artistiques. (Exemples : baleine volante, corgi de la nébuleuse cosmique, etc.)

- Génération d'images stylisées : génère des images avec un style artistique spécifique basé sur la description du style dans les invites de texte. (Exemples : église de style Renaissance, village de montagne de style peinture à l'encre chinoise, etc.)

- Génération de texte simple sur des images : possibilité de générer des images avec des éléments de texte simples. (Exemple : écrire "Hello" sur un tableau noir)

Exemples de scénarios d'application pratique :

- Assistant intelligent : il s'agit d'un assistant intelligent multimodal qui comprend les images téléchargées par l'utilisateur et effectue des questions-réponses, des descriptions, des analyses, etc.

- Création de contenu : aider les créateurs de contenu à générer rapidement des images de haute qualité, telles que des graphiques pour les médias sociaux, des illustrations d'articles, etc.

- Applications éducatives : utilisées pour enseigner la reconnaissance d'images, l'interprétation de diagrammes, etc. afin d'aider les étudiants à comprendre les informations visuelles.

- Recherche d'informations : fournit des résultats de recherche plus riches grâce à la recherche d'images combinée à des capacités de compréhension et de génération de texte.

- Création artistique : en tant qu'outil de création, il aide les artistes à créer des images et à explorer de nouvelles formes d'expression visuelle.

Caractéristiques et limites des paramètres à connaître :

- Limites de la résolution des images : la formation et les tests des modèles actuels sont principalement basés sur des images d'une résolution de 384x384, ce qui peut présenter des limites pour les scénarios nécessitant une résolution plus élevée.

- Finesse des détails : bien que l'image soit sémantiquement riche, la finesse des détails peut encore être améliorée en raison de la perte de résolution et de reconstruction du tokenizer de la vision ; par exemple, les zones de visage de petite taille peuvent ne pas être suffisamment fines.

4. résumé et perspectives

La famille de modèles Janus, de JanusFlow à Janus-Pro, démontre le potentiel de percées continues dans le domaine de la compréhension et de la génération multimodales unifiées.JanusFlow a jeté les bases d'une architecture unifiée, tandis que Janus-Pro a réalisé un bond en avant en termes de performances grâce à l'optimisation de la stratégie de formation, à l'augmentation de l'échelle des données et à l'amélioration de la taille des modèles.Le succès de Janus-Pro Le succès de Janus-Pro valideLes extensions de modèles et de données sont essentielles pour améliorer les performances des modèles unifiés.L'évolution de la famille de modèles Janus ne fait pas seulement progresser les modèles multimodaux, mais pose également des bases solides pour la construction de systèmes d'intelligence artificielle plus polyvalents et plus intelligents.

Article complet "Janus-Pro : Une compréhension multimodale unifiée et un modèle génératif, rendu possible par des extensions de données et de modèles

auteurXiaokang Chen, Zhiyu Wu, Xingchao Liu, Zizheng Pan, Wen Liu, Zhenda Xie, Xingkai Yu, Chong Ruan

page du projet: https://github.com/deepseek-ai/Janus

résumés

Dans ce travail, nous présentons Janus-Pro, une version améliorée du modèle Janus précédent. Plus précisément, Janus-Pro intègre (1) une stratégie d'entraînement optimisée, (2) des données d'entraînement étendues et (3) une mise à l'échelle pour des modèles de plus grande taille. Grâce à ces améliorations, Janus-Pro fait des progrès significatifs dans la compréhension multimodale et les capacités de suivi des commandes pour les images générées par le texte, tout en améliorant la stabilité des images générées par le texte. Nous espérons que ce travail stimulera l'exploration dans ce domaine. Le code et le modèle sont accessibles au public.

1. introduction

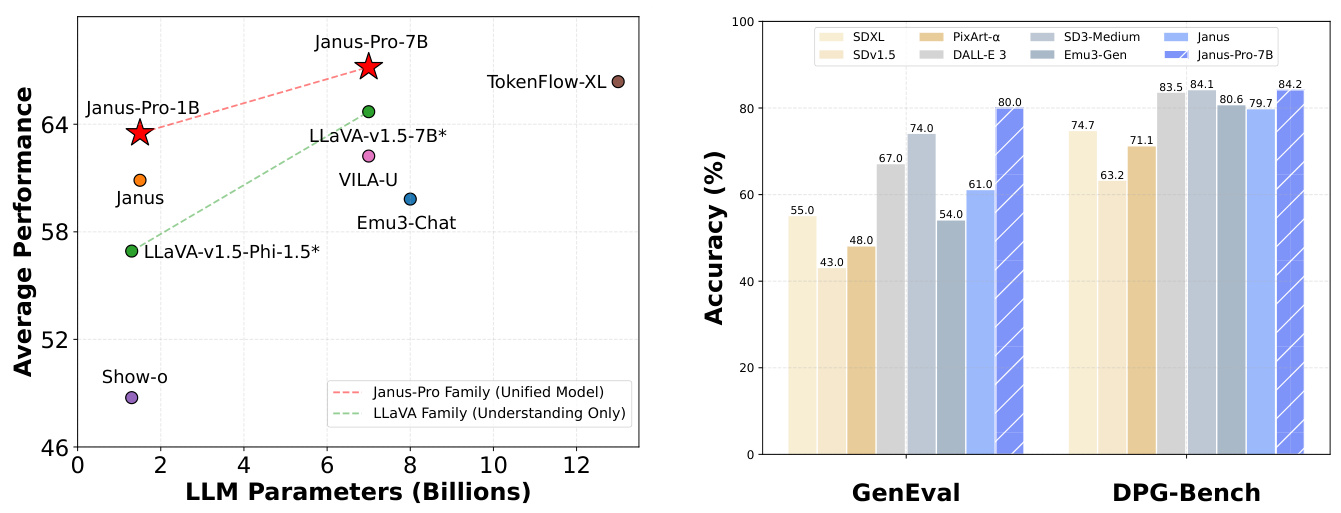

(a) Performance moyenne de quatre repères de compréhension multimodale. (b) Performance de l'enseignement "texte-générer-image" après le repère.

Figure 1 | Résultats de la compréhension multimodale et de la génération visuelle pour Janus-Pro. Pour la compréhension multimodale, nous avons calculé la moyenne de la précision de POPE, MME-Perception, GQA et MMMU. Le score de MME-Perception a été divisé par 20 pour obtenir une échelle de [0, 100]. Pour la génération visuelle, nous avons évalué les performances des tests de suivi de commande GenEval et DPG-Bench. Dans l'ensemble, Janus-Pro surpasse les modèles multimodaux unifiés de l'état de l'art ainsi que certains modèles spécifiques à une tâche. Les meilleurs résultats ont été obtenus pour la visualisation à l'écran.

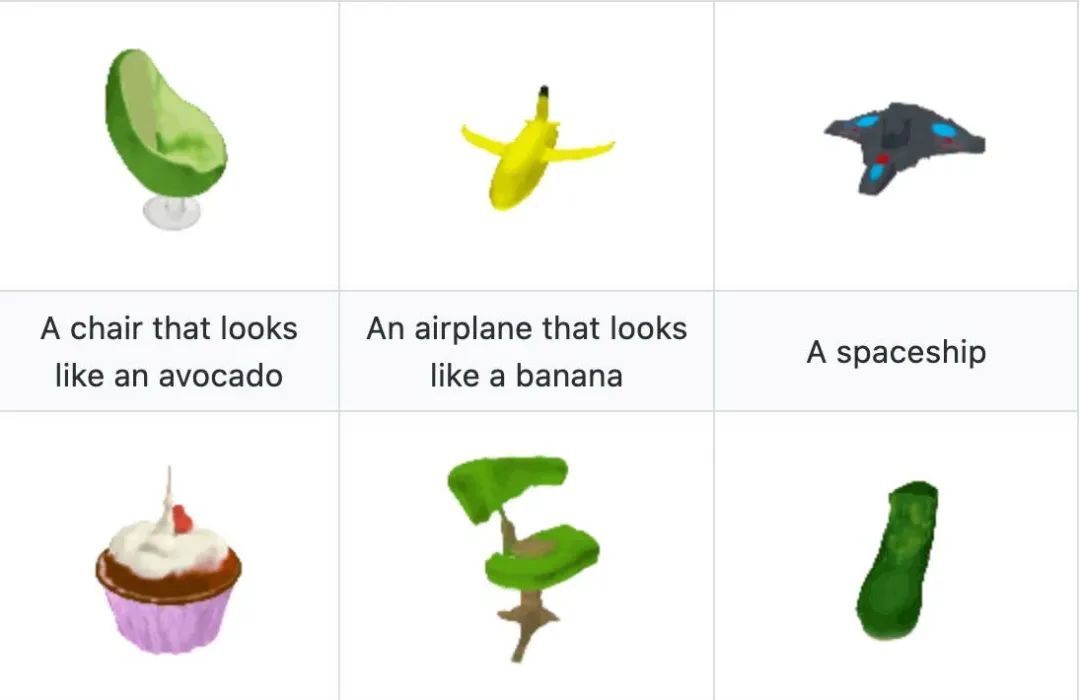

1. une simple photo d'une mandarine orange 2. un tableau noir propre avec une surface verte et le mot "Hello" écrit avec précision et clarté à la craie blanche 3. un gros plan d'un tournesol symbolisant la prospérité, avec des tiges et des feuilles vertes, des pétales en pleine floraison, et une abeille posée dessus, ses ailes scintillant à la lumière du soleil.

Figure 2 | Comparaison des images générées par Janus-Pro et son prédécesseur, Janus. Janus-Pro fournit un résultat plus cohérent pour les messages courts, avec une meilleure qualité visuelle, des détails plus riches et la possibilité de générer un texte simple. La résolution de l'image est de 384x384 et il est préférable de la visualiser sur un écran.

Des progrès significatifs ont été réalisés récemment dans l'unification de la compréhension multimodale et des modèles génératifs [30, 40, 45, 46, 48, 50, 54, 55]. Il a été démontré que ces approches améliorent l'adhésion aux instructions dans les tâches de génération visuelle tout en réduisant la redondance des modèles. La plupart de ces approches utilisent le même codeur visuel pour traiter les entrées des tâches de compréhension et de génération multimodales. Cela se traduit généralement par des performances médiocres en compréhension multimodale en raison des différentes représentations requises pour les deux tâches. Pour résoudre ce problème, Janus [46] a proposé un codage visuel découplé, qui atténue le conflit entre les tâches de compréhension et de génération multimodales et permet d'obtenir d'excellentes performances dans les deux tâches.

En tant que modèle pionnier, Janus a été validé à l'échelle des paramètres 1B. Cependant, en raison des limites des données d'entraînement et de la capacité relativement faible du modèle, il présente plusieurs inconvénients, tels que des performances médiocres dans la génération d'images de repères courts et une qualité incohérente des images générées par le texte. Dans cet article, nous présentons Janus-Pro, une version améliorée de Janus qui porte sur trois aspects : la stratégie d'apprentissage, les données et la taille du modèle. La famille Janus-Pro comprend deux tailles de modèle : 1B et 7B, ce qui démontre l'évolutivité de la méthode de codage-décodage visuel.

Nous avons évalué Janus-Pro sur plusieurs benchmarks, et les résultats montrent une compréhension multimodale supérieure et une performance significativement améliorée pour l'adhésion à l'instruction d'image générée par le texte. Plus précisément, Janus-Pro-7B obtient un score de 79,2 sur le benchmark de compréhension multimodale MMBench [29], surpassant les modèles multimodaux unifiés précédents tels que Janus [46] (69,4), TokenFlow [34] (68,9), et MetaMorph [42] (75,2). De plus, Janus-Pro-7B obtient un score de 0,80 dans la directive texte-génération d'images suivant le leaderboard GenEval [14], surpassant Janus [46] (0,61), DALL-E 3 (0,67), et Stable Diffusion 3 Medium [11] (0,74).

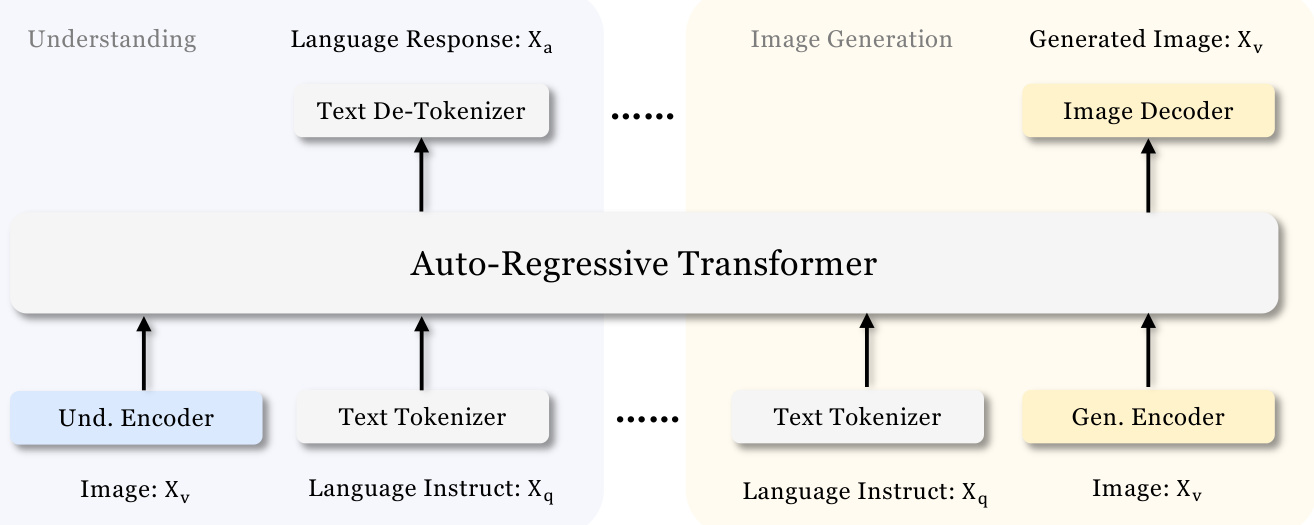

Figure 3 | Architecture de Janus-Pro. Nous découplons le codage visuel pour la compréhension multimodale et la génération visuelle. "Und. Encoder" et "Gen. Encoder" sont des abréviations pour "Understanding Encoder" et "Generation Encoder" respectivement. "Und. Encoder" et "Gen. Encoder" sont des abréviations de "Understanding Encoder" et "Generation Encoder" respectivement. Meilleur affichage sur écran.

2. la méthodologie

2.1.

L'architecture de Janus-Pro est présentée à la figure 3 et est identique à celle de Janus [46]. Le principe de base de l'architecture globale est de découpler le codage visuel pour la compréhension et la génération multimodales. Nous appliquons des méthodes de codage indépendantes pour convertir les entrées brutes en caractéristiques, qui sont ensuite traitées par un transformateur autorégressif unifié. Pour la compréhension multimodale, nous utilisons le codeur SigLIP [53] pour extraire des caractéristiques sémantiques à haute dimension des images. Ces caractéristiques sont étendues d'un maillage 2-D à une séquence 1-D, et ces caractéristiques d'image sont mappées à l'espace d'entrée du LLM à l'aide d'un adaptateur de compréhension. Pour la tâche de génération visuelle, nous utilisons le tagger VQ de [38] pour convertir les images en ID discrets. Après avoir aplati les séquences d'ID en 1-D, nous utilisons un adaptateur génératif pour mapper les codebook embeddings correspondant à chaque ID dans l'espace d'entrée du LLM. Nous concaténons ensuite ces séquences de caractéristiques pour former une séquence de caractéristiques multimodales, qui est ensuite introduite dans le LLM pour traitement. En plus de l'en-tête de prédiction intégré dans le LLM, nous utilisons un en-tête de prédiction initialisé de manière aléatoire pour la prédiction d'image dans les tâches de génération visuelle. L'ensemble du modèle suit un cadre autorégressif.

2.2 Des stratégies de formation optimisées

La version précédente de Janus utilisait un processus de formation en trois étapes. La première étape se concentre sur l'entraînement des adaptateurs et des têtes d'image. La deuxième phase concerne le pré-entraînement uniforme, où tous les composants, à l'exception du codeur de compréhension et du codeur de génération, mettent à jour leurs paramètres. La troisième phase est celle du réglage fin supervisé, qui s'appuie sur la deuxième phase en déverrouillant davantage les paramètres du codeur de compréhension au cours du processus de formation. Cette stratégie de formation pose quelques problèmes. Dans la deuxième phase, Janus divise l'apprentissage de la capacité de conversion texte-image en deux parties, à l'instar de PixArt [4]. La première partie a été entraînée à l'aide des données ImageNet [9], en utilisant les noms des catégories d'images comme repères pour les images générées par le texte, dans le but de modéliser les dépendances entre les pixels. La seconde partie a été entraînée à l'aide de données d'images générées par du texte simple. Dans la mise en œuvre, 66,67% des étapes d'apprentissage des images générées par le texte dans la deuxième phase ont été allouées à la première partie. Cependant, d'autres expériences ont montré que cette stratégie n'était pas optimale et qu'elle entraînait d'importantes inefficacités en termes de calcul.

Deux modifications ont été apportées pour résoudre ce problème.

- Formation plus longue dans la première phaseNous avons ajouté une première étape de formation qui permet une formation complète sur l'ensemble de données ImageNet. Nos résultats montrent que même avec des paramètres LLM fixes, le modèle peut modéliser efficacement les dépendances des pixels et générer des images sensées basées sur les noms de catégories.

- Formation ciblée de la phase IIDans la seconde phase, nous avons abandonné les données ImageNet et utilisé directement des données d'images générées par du texte simple pour entraîner le modèle à générer des images sur la base de descriptions denses. Cette nouvelle approche permet à la deuxième phase d'utiliser plus efficacement les données d'images générées par le texte, améliorant ainsi l'efficacité de la formation et les performances globales.

Nous avons également ajusté les ratios de données des différents types d'ensembles de données au cours de la troisième étape du processus d'ajustement supervisé, en modifiant le ratio des données multimodales, des données textuelles et des données d'images générées par le texte de 7:3:10 à 5:1:4. En diminuant légèrement le ratio des données d'images générées par le texte, nous avons observé que cet ajustement nous permettait d'améliorer la performance de la compréhension multimodale tout en conservant de fortes capacités de génération visuelle.

2.3 Extensions de données

Nous élargissons les données d'entraînement utilisées par Janus pour la compréhension multimodale et la génération de vision.

- compréhension multimodalePour les données de pré-entraînement de la deuxième étape, nous nous référons à DeepSeekVL2 [49] et ajoutons environ 90 millions d'échantillons. Ces données comprennent des ensembles de données de sous-titrage d'images (par exemple, YFCC [31]), ainsi que des données pour la compréhension de tableaux, de graphiques et de documents (par exemple, Docmatix [20]). Pour la troisième étape d'affinage supervisé des données, nous avons également ajouté des ensembles de données supplémentaires provenant de DeepSeek-VL2, tels que la compréhension MEME, les données de dialogue chinois et les ensembles de données conçus pour améliorer l'expérience du dialogue. Ces ajouts étendent considérablement les capacités du modèle, enrichissant sa capacité à traiter une variété de tâches tout en améliorant l'expérience globale du dialogue.

- production visuelleJanus-Pro : Nous avons observé que les données réelles utilisées dans la version précédente de Janus manquaient de qualité et contenaient un bruit important, ce qui se traduisait généralement par des images instables générées par le texte et donc par des résultats esthétiquement médiocres. Dans Janus-Pro, nous avons inclus environ 72 millions d'échantillons de données esthétiques synthétiques pour porter le rapport entre les données réelles et synthétiques à 1:1 dans la phase unifiée de pré-entraînement. Les expériences ont montré que lors de l'entraînement sur des données synthétiques, le modèle converge plus rapidement et produit non seulement des images générées par le texte plus stables, mais aussi une qualité esthétique nettement supérieure.

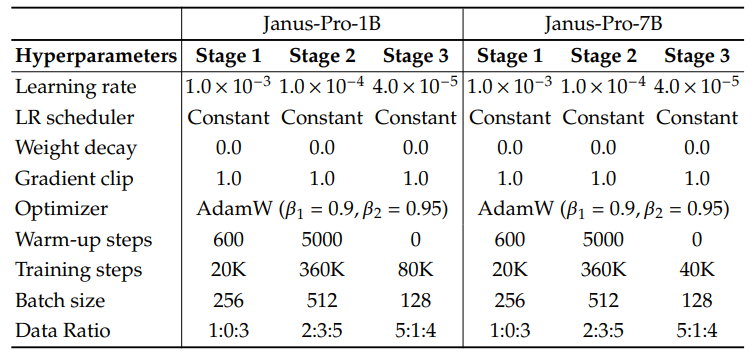

2.4 Extensions du modèle

Une version précédente de Janus a vérifié l'efficacité de l'utilisation du LLM 1.5B pour le découplage du codage visuel. Dans Janus-Pro, nous avons étendu le modèle à 7B, et les hyperparamètres des LLM 1.5B et 7B sont détaillés dans le tableau 1. Nous avons observé une augmentation significative de la vitesse de convergence de la compréhension multimodale et de la perte de génération visuelle lors de l'utilisation de LLMs plus grands comparés à des modèles plus petits. Cette constatation valide la robustesse de l'extensibilité de cette approche.

Tableau 1 Configuration de l'architecture de Janus-Pro. Nous listons les hyperparamètres de l'architecture.

| Janus-Pro-1B | Janus-Pro-7B | |

| Taille du vocabulaire | 100K | 100K |

| Taille de l'image | 2048 | 4096 |

| fenêtre contextuelle | 4096 | 4096 |

| capacité d'attention | 16 | 32 |

| étage | 24 | 30 |

Tableau 2 Hyperparamètres détaillés pour la formation Janus-Pro. Le ratio de données fait référence au ratio entre les données de compréhension multimodales, les données textuelles et les données générées visuellement.

3. expériences

3.1 Détails de la mise en œuvre

Dans nos expériences, nous utilisons DeepSeek-LLM (1.5B et 7B) [3] comme modèle de langage de base avec une longueur de séquence maximale supportée de 4096. Pour le codeur visuel utilisé dans la tâche de compréhension, nous avons choisi SigLIP-Large-Patch16-384 [53]. L'encodeur de génération a un livre de codes de taille 16 384 et sous-échantillonne l'image 16 fois. L'adaptateur de compréhension et l'adaptateur de génération sont des MLP à deux couches. Les hyperparamètres détaillés pour chaque étape sont fournis dans le tableau 2. Toutes les images ont été redimensionnées à 384x384 pixels. Pour les données de compréhension multimodale, nous redimensionnons le côté long de l'image à 384 et remplissons le côté court avec la couleur d'arrière-plan (RVB : 127, 127, 127) pour atteindre 384. Pour les données de génération visuelle, le côté court est redimensionné à 384 et le côté long est recadré à 384. nous utilisons le regroupement de séquences pendant le processus d'apprentissage pour améliorer l'efficacité de l'apprentissage. Nous mélangeons tous les types de données selon des ratios spécifiés en une seule étape de formation. Notre Janus est entraîné et évalué à l'aide de HAI-LLM [15], un cadre d'entraînement distribué léger et efficace construit sur PyTorch. L'ensemble du processus d'apprentissage a pris environ 7/14 jours sur un cluster de 16/32 nœuds équipé de 8 GPU Nvidia A100 (40GB) pour 1,5B/7B modèles.

3.2 Évaluation des paramètres

Compréhension multimodale : Pour évaluer la compréhension multimodale, nous avons évalué notre modèle sur des bancs d'essai visuels-verbaux basés sur des images largement reconnus, notamment GQA [17], POPE [23], MME [12], SEED [21], MMB [29], MM-Vet [51] et MMMU [52].

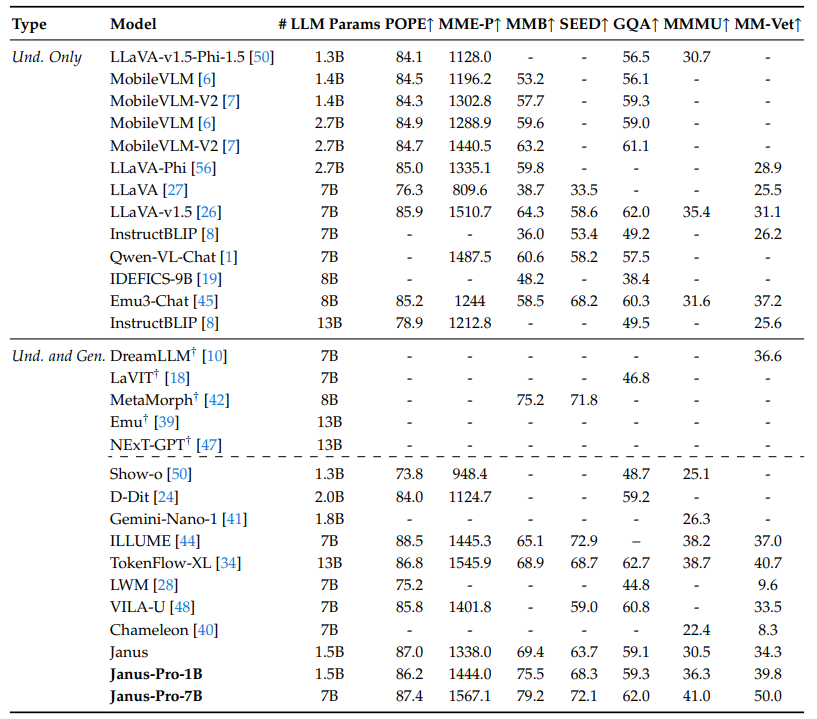

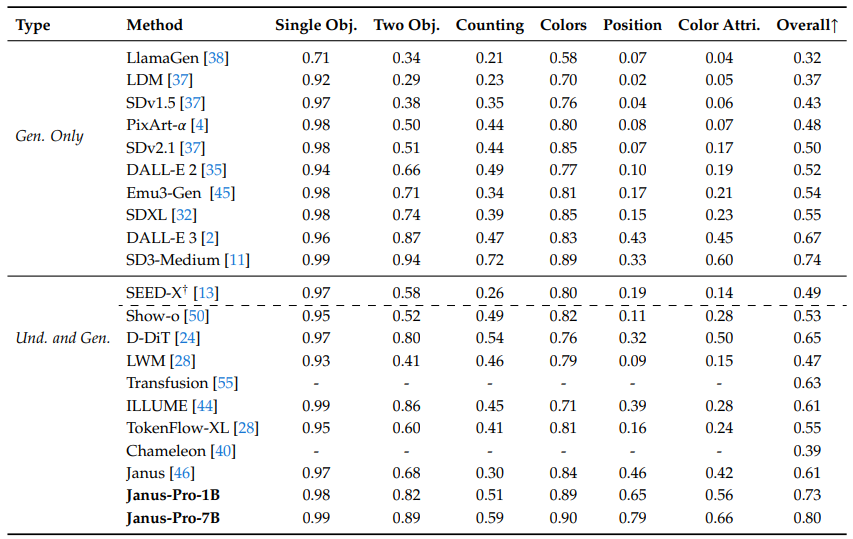

Tableau 3 Comparaison avec les techniques de pointe dans l'évaluation comparative de la compréhension multimodale. Les termes "Und." et "Gen." désignent respectivement la "compréhension" et la "génération". Les modèles qui utilisent des modèles de diffusion pré-entraînés externes sont marqués par †.

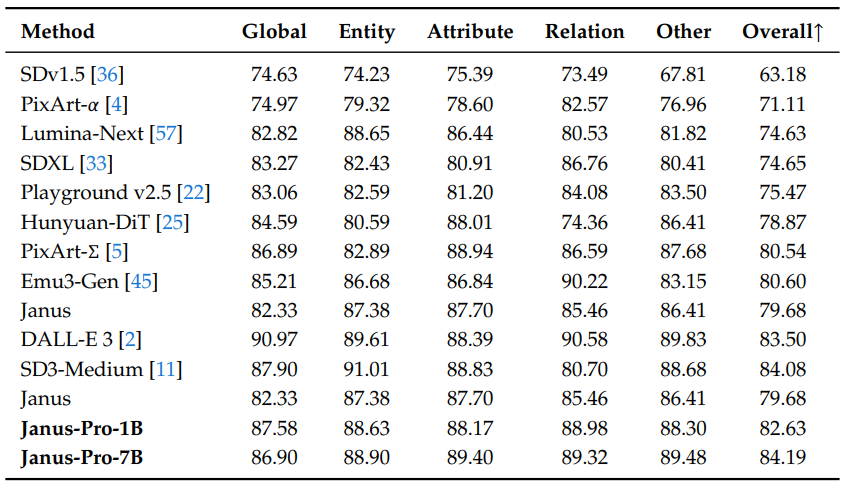

Génération visuelle : Pour évaluer les capacités de génération visuelle, nous avons utilisé GenEval [14] et DPG-Bench [16].GenEval est un benchmark difficile de génération d'images vers du texte conçu pour refléter l'ensemble des capacités génératives d'un modèle de génération visuelle grâce à une analyse détaillée de ses capacités combinatoires au niveau de l'instance.DPG-Bench (Dense Prompted Graph Benchmark) est un ensemble de données complet contenant 1065 indices longs et denses dans un ensemble de données complet conçu pour évaluer les capacités complexes d'alignement sémantique des modèles texte-image. 1065 indices longs et denses dans un ensemble de données complet conçu pour évaluer les capacités d'alignement sémantique complexe des modèles texte-image.

3.3 Comparaison avec l'état de l'art

Performance de la compréhension multimodale : Nous comparons l'approche proposée avec l'état de l'art des modèles unifiés et des modèles de compréhension seule dans le tableau 3. Ceci peut être attribué au découplage de la compréhension multimodale et du codage visuel généré, qui atténue le conflit entre ces deux tâches. Janus-Pro reste très compétitif par rapport à des modèles beaucoup plus grands. Par exemple, Janus-Pro-7B surpasse TokenFlow-XL (13B) dans tous les benchmarks à l'exception de GQA.

Tableau 4 Évaluation de la génération de texte à partir d'images dans le cadre du test GenEval. Les mentions "Und." et "Gen." indiquent respectivement "Comprendre" et "Générer". Les modèles qui utilisent des modèles de diffusion externes pré-entraînés sont marqués par †.

Tableau 5 performance sur DPG-Bench. À l'exception de Janus et Janus-Pro, toutes les méthodes figurant dans ce tableau sont spécifiques au modèle utilisé pour générer la tâche.

Performance de la génération visuelle : Nous présentons les performances de la génération visuelle sur GenEval et DPG-Bench. Comme le montre le tableau 4, notre Janus-Pro-7B obtient une précision globale de 80% sur GenEval, ce qui surpasse toutes les autres méthodes unifiées ou supportant uniquement la génération, par exemple Transfusion [55] (63%), SD3-Medium (74%), et DALL-E 3 (67%). Cela montre que notre méthode a une meilleure capacité à suivre les instructions. Comme le montre le tableau 5, Janus-Pro obtient un score de 84,19 sur le DPG-Bench, surpassant toutes les autres méthodes. Cela montre que Janus-Pro est capable de suivre des instructions denses pour la génération de texte à partir d'images.

3.4 Résultats qualitatifs

Nous montrons les résultats de la compréhension multimodale dans la Fig. 4. Janus-Pro montre une compréhension impressionnante lorsqu'il traite des entrées provenant de différents contextes, démontrant ainsi sa puissance. Les images générées par Janus-Pro-7B sont très réalistes et contiennent beaucoup de détails, même si la résolution n'est que de $384\times384$. Pour les scénarios imaginatifs et créatifs, Janus-Pro-7B saisit avec précision les informations sémantiques contenues dans les invites et génère des images sensées et cohérentes.

Figure 4 | Résultats qualitatifs des capacités de compréhension multimodale et de génération visuelle. Le modèle est Janus-Pro-7B, et l'image générée visuellement a une résolution de $384\times384$. Il est préférable de la visualiser sur un écran.

4) Conclusion

Dans cet article, des améliorations sont apportées à Janus en termes de stratégie d'apprentissage, de données et de taille du modèle. Ces améliorations se traduisent par des progrès significatifs en matière de compréhension multimodale et de suivi des commandes d'images de génération de texte. Cependant, Janus-Pro présente encore certaines limites. Pour la compréhension multimodale, la résolution d'entrée est limitée à $384\times384$, ce qui affecte ses performances dans les tâches à grain fin telles que l'OCR. Pour les images générées par le texte, la faible résolution associée à la perte de reconstruction introduite par le marqueur visuel donne des images riches sur le plan sémantique, mais qui manquent encore de détails. Par exemple, les petites régions du visage qui occupent un espace limité dans l'image peuvent sembler ne pas avoir assez de détails. L'augmentation de la résolution de l'image peut atténuer ces problèmes.

bibliographie

[1] J. Bai, S. Bai, S. Yang, S. Wang, S. Tan, P. Wang, J. Lin, C. Zhou et J. Zhou. qwen-vl : a cutting-edge large-scale visual language model with versatility. arXiv preprint arXiv:2308.12966, 2023.[2] J. Betker, G. Goh, L. Jing, T. Brooks, J. Wang, L. Li, L. Ouyang, J. Zhuang, J. Lee, Y. Guo, et al. Improving image generation through better captioning (Amélioration de la génération d'images grâce à un meilleur sous-titrage). Computer Science. https://cdn.openai.com/papers/dall-e-3.pdf, 2(3):8, 2023.

[3] X. Bi, D. Chen, G. Chen, S. Chen, D. Dai, C. Deng, H. Ding, K. Dong, Q. Du, Z. Fu, et al. DeepSeek LLM : Extending open source language models using long-termism. arXiv preprint arXiv:2401.02954, 2024.

[4] J. Chen, J. Yu, C. Ge, L. Yao, E. Xie, Y. Wu, Z. Wang, J. Kwok, P. Luo, H. Lu, et al. PixArtℎ : fast training diffusion transformer for photo-realistic text generation image synthesis. arXiv preprint arXiv:2310.00426, 2023.

[5] J. Chen, C. Ge, E. Xie, Y. Wu, L. Yao, X. Ren, Z. Wang, P. Luo, H. Lu, et Z. Li. PixArt-Sigma : weak-to-strong diffusion transformer training for 4K text generation image generation. arXiv preprint arXiv:2403.04692, 2024.

[6] X. Chu, L. Qiao, X. Lin, S. Xu, Y. Yang, Y. Hu, F. Wei, X. Zhang, B. Zhang, X. Wei, et al. Mobilevlm : a fast, reproducible and powerful visual language assistant for mobile devices. arXiv preprint arXiv:2312.16886, 2023.

[7] X. Chu, L. Qiao, X. Zhang, S. Xu, F. Wei, Y. Yang, X. Sun, Y. Hu, X. Lin, B. Zhang, et al. Mobilevlm v2 : A faster and more powerful basis for visual language modelling. arXiv preprint arXiv:2402.03766, 2024.

[8] W. Dai, J. Li, D. Li, A. M. H. Tiong, J. Zhao, W. Wang, B. Li, P. Fung et S. Hoi. Instructblip : towards a generalised visual language model with command fine-tuning, 2023.

[9] J. Deng, W. Dong, R. Socher, L.-J. Li, K. Li et L. Fei-Fei. Imagenet : a large-scale hierarchical image database. In Proceedings of the 2009 IEEE Conference on Computer Vision and Pattern Recognition, pages 248-255, Institute of Electrical and Electronics Engineers, 2009.

[10] R. Dong, C. Han, Y. Peng, Z. Qi, Z. Ge, J. Yang, L. Zhao, J. Sun, H. Zhou, H. Wei, et al. Dreamllm : multimodal collaborative understanding and creation. arXiv preprint arXiv:2309.11499, 2023.

[11] P. Esser, S. Kulal, A. Blattmann, R. Entezari, J. Mller, H. Saini, Y. Levi, D. Lorenz, A. Sauer, F. Boesel, D. Podell, T. Dockhorn, Z. English, K. Lacey, Goodwin, Y. Marek et R. Rombach. A. Goodwin, Y. Marek, and R. Rombach. scaling-corrected stream transformer for high-resolution image synthesis, 2024. URL https://arxiv.org/abs/2403.03206.

[12] C. Fu, P. Chen, Y. Shen, Y. Qin, M. Zhang, X. Lin, J. Yang, X. Zheng, K. Li, X. Sun, et al. MME : a comprehensive evaluation benchmark for multimodal large language models. arXiv preprint arXiv:2306.13394, 2023.

[13] Y. Ge, S. Zhao, J. Zhu, Y. Ge, K. Yi, L. Song, C. Li, X. Ding et Y. Shan. SEED-X : a multimodal model with unified multi-granularity understanding and generation. arXiv preprint arXiv:2404.14396, 2024.

[14] D. Ghosh, H. Hajishirzi et L. Schmidt, GenEval : an object-oriented framework for evaluating text-generated image alignment (GenEval : un cadre orienté objet pour évaluer l'alignement d'images générées par le texte). Advances in Neural Information Processing Systems, 36, 2024.

[15] High-flyer, HAI-LLM : An Efficient and Lightweight Large Model Training Tool, 2023, URL https://www.high-flyer.cn/en/blog/hai-llm.

[16] X. Hu, R. Wang, Y. Fang, B. Fu, P. Cheng et G. Yu. ELLA : Equipping diffusion models for enhanced semantic alignment. arXiv preprint arXiv:2403.05135, 2024.

[17] D. A. Hudson et C. D. Manning. gqa : a new dataset for real-world visual reasoning and combinatorial quizzing. Dans les actes de la conférence IEEE/CVF sur la vision informatique et la reconnaissance des formes, pages 6700-6709, 2019.

[18] Y. Jin, K. Xu, L. Chen, C. Liao, J. Tan, B. Chen, C. Lei, A. Liu, C. Song, X. Lei, et al. Dynamic discrete visual tokenisation for visual pre-training in unified language. arXiv preprint arXiv:2309.04669, 2023.

[19] H. Laurenon, D. van Strien, S. Bekman, L. Tronchon, L. Saulnier, T. Wang, S. Karamcheti, A. Singh, G. Pistilli, Y. Jernite, et al. Introducing IDEFICS : an open model for reproducing state-of-the-art visual language models, 2023. URL https://huggingface.co/blog/id efics.

[20] H. Laurenon, A. Marafioti, V. Sanh et L. Tronchon, Building and better understanding visual language models : insights and future directions, 2024.

[21] B. Li, R. Wang, G. Wang, Y. Ge, et Y. Shan. SEED-Bench : benchmarking multimodal LLMs using generative understanding. arXiv preprint arXiv:2307.16125, 2023.

[22] D. Li, A. Kamko, E. Akhgari, A. Sabet, L. Xu et S. Doshi. Terrain de jeux v2.5 : Three-point insights for enhancing the aesthetic quality of text-generated image generation. arXiv preprint arXiv:2402.17245, 2024.

[23] Y. Li, Y. Du, K. Zhou, J. Wang, W. X. Zhao et J.-R. Wen. Evaluating object illusions in large-scale visual language models. arXiv preprint arXiv:2305.10355, 2023.

[24] Z. Li, H. Li, Y. Shi, A. B. Farimani, Y. Kluger, L. Yang et P. Wang. double diffusion for unified image generation and understanding. arXiv preprint arXiv:2501.00289, 2024.

[25] Z. Li, J. Zhang, Q. Lin, J. Xiong, Y. Long, X. Deng, Y. Zhang, X. Liu, M. Huang, Z. Xiao, et al. Hunyuan-DiT : a powerful multi-resolution diffusion transformer with fine Chinese understanding. arXiv preprint arXiv:2405.08748, 2024.

[26] H. Liu, C. Li, Y. Li et Y. J. Lee. Improved fine-tuning baselines for visual commands. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pages 26296-26306, 2024.

[27] H. Liu, C. Li, Q. Wu et Y. J. Lee. visual command fine-tuning. Advances in Neural Information Processing Systems, 36, 2024.

[28] H. Liu, W. Yan, M. Zaharia et P. Abbeel. world model on million-length videos and languages using ring attention. arXiv preprint arXiv:2402.08268, 2024.

[29] Y. Liu, H. Duan, Y. Zhang, B. Li, S. Zhang, W. Zhao, Y. Yuan, J. Wang, C. He, Z. Liu, et al. MMBench : is your multimodal model an all-rounder ? arXiv preprint arXiv:2307.06281, 2023.

[30] Y. Ma, X. Liu, X. Chen, W. Liu, C. Wu, Z. Wu, Z. Pan, Z. Xie, H. Zhang, X. yu, L. Zhao, Y. Wang, J. Liu, and C. Ruan. Janusflow : reconciling autoregressive and corrective flows for unified multimodal understanding and generation, 2024.

[31] mehdidc. yfcc-huggingface. https://huggingface.co/datasets/mehdidc/yfcc15 m, 2024.

[32] D. Podell, Z. English, K. Lacey, A. Blattmann, T. Dockhorn, J. Mller, J. Penna, et R. Rombach. sdxl : improving potential diffusion models for high-resolution image synthesis. arXiv preprint arXiv:2307.01952,. 2023.

[33] D. Podell, Z. English, K. Lacey, A. Blattmann, T. Dockhorn, J. Mller, J. Penna et R. Rombach. sdxl : improving potential diffusion models for high resolution image synthesis. 2024.

[34] L. Qu, H. Zhang, Y. Liu, X. Wang, Y. Jiang, Y. Gao, H. Ye, D. K. Du, Z. Yuan et X. Wu. Tokenflow : a unified image tagger for multimodal understanding and generation. arXiv preprint arXiv:2412.03069, 2024.

[35] A. Ramesh, P. Dhariwal, A. Nichol, C. Chu et M. Chen. hierarchical text-conditional image generation using CLIP latent values. arXiv preprint arXiv:2204.06125, 1(2):3, 2022.

[36] R. Rombach, A. Blattmann, D. Lorenz, P. Esser et B. Ommer. High-resolution image synthesis using a latent diffusion model. 2022.

[37] R. Rombach, A. Blattmann, D. Lorenz, P. Esser et B. Ommer. High-resolution image synthesis using latent diffusion models. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pages 10684-10695, 2022.

[38] P. Sun, Y. Jiang, S. Chen, S. Zhang, B. Peng, P. Luo et Z. Yuan. Autoregressive models beat diffusion : the LLama for scalable image generation. arXiv preprint arXiv:2406.06525, 2024.

[39] Q. Sun, Q. Yu, Y. Cui, F. Zhang, X. Zhang, Y. Wang, H. Gao, J. Liu, T. Huang et X. Wang. multimodal generative pretraining. arXiv preprint arXiv:2307.05222, 2023.

[40] C. Team. Chameleon : A basic model for early fusion of mixed modes. arXiv preprint arXiv:2405.09818, 2024.

[41] G. Team, R. Anil, S. Borgeaud, Y. Wu, J.-B. Alayrac, J. Yu, R. Soricut, J. Schalkwyk, A. M. Dai, A. Hauth, et al. Gémeaux: a family of capable multimodal models. arXiv preprint arXiv:2312.11805, 2023.

[42] S. Tong, D. Fan, J. Zhu, Y. Xiong, X. Chen, K. Sinha, M. Rabbat, Y. LeCun, S. Xie, et Z. Liu. Metamorph : multimodal understanding and generation through instruction fine-tuning. arXiv preprint arXiv:2412.14164,. 2024.

[43] Vivym. Voyage à mi-parcours Prompt dataset. https://huggingface.co/datasets/vivym/midjourney-prompts, 2023. Date de la visite : [insérer la date de la visite, par exemple 2023-10-15].

[44] C. Wang, G. Lu, J. Yang, R. Huang, J. Han, L. Hou, W. Zhang et H. Xu. Illume : illuminating your LLMs to see, draw, and self-enhance. arXiv preprint arXiv:2412.06673, 2024.

[45] X. Wang, X. Zhang, Z. Luo, Q. Sun, Y. Cui, J. Wang, F. Zhang, Y. Wang, Z. Li, Q. Yu, et al. Emu3 : the next tag prediction is all you need. arXiv preprint arXiv:2409.18869, 2024.

[46] C. Wu, X. Chen, Z. Wu, Y. Ma, X. Liu, Z. Pan, W. Liu, Z. Xie, X. Yu, C. Ruan, et al. Janus : decoupling visual coding for unified multimodal understanding and generation. arXiv preprint arXiv:2410.13848, 2024.

[47] S. Wu, H. Fei, L. Qu, W. Ji, et T.-S. Chua. next-gpt : any-to-any multimodal LLM. arXiv preprint arXiv:2309.05519, 2023.

[48] Y. Wu, Z. Zhang, J. Chen, H. Tang, D. Li, Y. Fang, L. Zhu, E. Xie, H. Yin, L. Yi, et al. VILA-U : a foundational model for integrating visual understanding and generation. arXiv preprint arXiv:2409.04429, 2024.

[49] Z. Wu, X. Chen, Z. Pan, X. Liu, W. Liu, D. Dai, H. Gao, Y. Ma, C. Wu, B. Wang, et al. DeepSeek-VL2 : hybrid expert visual language model for advanced multimodal understanding. arXiv preprint arXiv:2412.10302, 2024.

[50] J. Xie, W. Mao, Z. Bai, D. J. Zhang, W. Wang, K. Q. Lin, Y. Gu, Z. Chen, Z. Yang, et M. Z. Shou. show-o : a single converter for unified multimodal understanding and generation. arXiv preprint arXiv:2408.12528,. 2024.

[51] W. Yu, Z. Yang, L. Li, J. Wang, K. Lin, Z. Liu, X. Wang et L. Wang. MM-Vet : assessing the integrative power of large multimodal models. arXiv preprint arXiv:2308.02490, 2023.

[52] X. Yue, Y. Ni, K. Zhang, T. Zheng, R. Liu, G. Zhang, S. Stevens, D. Jiang, W. Ren, Y. Sun, et al. MMMU : A large-scale multidisciplinary multimodal understanding and inference benchmark for expert AGI. in Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pages 9556-9567, 2024.

[X. Zhai, B. Mustafa, A. Kolesnikov et L. Beyer. sigmoid loss for language image pretraining. In Proceedings of the IEEE/CVF International Conference on Computer Vision, pages 11975-11986, 2023.

[54] C. Zhao, Y. Song, W. Wang, H. Feng, E. Ding, Y. Sun, X. Xiao et J. Wang. Monoformer : a single converter for diffusion and autoregression. arXiv preprint arXiv:2409.16280, 2024.

[55] C. Zhou, L. Yu, A. Babu, K. Tirumala, M. Yasunaga, L. Shamis, J. Kahn, X. Ma, L. Zettlemoyer, et O. Levy. Transfusion : predicting the next labelled and diffused image using a multimodal model. arXiv Preprint. arXiv:2408.11039, 2024.

[56] Y. Zhu, M. Zhu, N. Liu, Z. Ou, X. Mou et J. Tang. lLAVA-Phi : Efficient multimodal assistant with small language models. arXiv preprint arXiv:2401.02330, 2024.[57] L. Zhuo, R. Du, H. Xiao, Y. Li, D. Liu, R. Huang, W. Liu, L. Zhao, F.-Y. Wang, Z. Ma, et al. Lumina-Next : making Lumina-T2X more powerful and faster with Next-DiT. arXiv preprint arXiv:2406.18583, 2024.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...