Les capacités de DeepSeek-R1 en détail, avec un rapport d'évaluation chinois

lecture rapide

Expérience :DeepSeek Site officiel : chat.deepseek.com Chattez avec DeepSeek-R1 et activez le bouton "Pensée profonde". Visiter le site API compatible avec le format OpenAI .

Le bien-être :Déploiement en ligne du modèle open-source DeepSeek-R1 avec une puissance GPU gratuite ,Remise de 100$ crédits DeepSeek-R1,Top 5 des plateformes d'inférence IA qui utilisent gratuitement une version complète de DeepSeek-R1

Récidive :Les tentatives récentes de reproduction Il y a pas mal de projets pour DeepSeek-R1, alors gardez un oeil sur les articles suivants :TinyZero : une réplique à faible coût de l'effet épiphanique de DeepSeeK-R1 Zero ,Open R1 : Un visage étreint reproduit le processus de formation de DeepSeek-R1 ,Reproduction de DeepSeek-R1 : 8 000 exemples mathématiques aident les petits modèles à réaliser des percées en matière d'inférence grâce à l'apprentissage par renforcement Et ce n'est pas tout :R1 Overthinker : Forcer les modèles R1 de DeepSeek à réfléchir plus longtemps .

Résumé :Longueur du contexte : 128K, $2.19/par million de jetons de sortie (Poundland dans le monde des grands modèles), performances comparables à celles d'OpenAI-o1, tous les modèles open source librement distillés et utilisés commercialement, fonctionnalité frontale imaginative pour l'écriture...

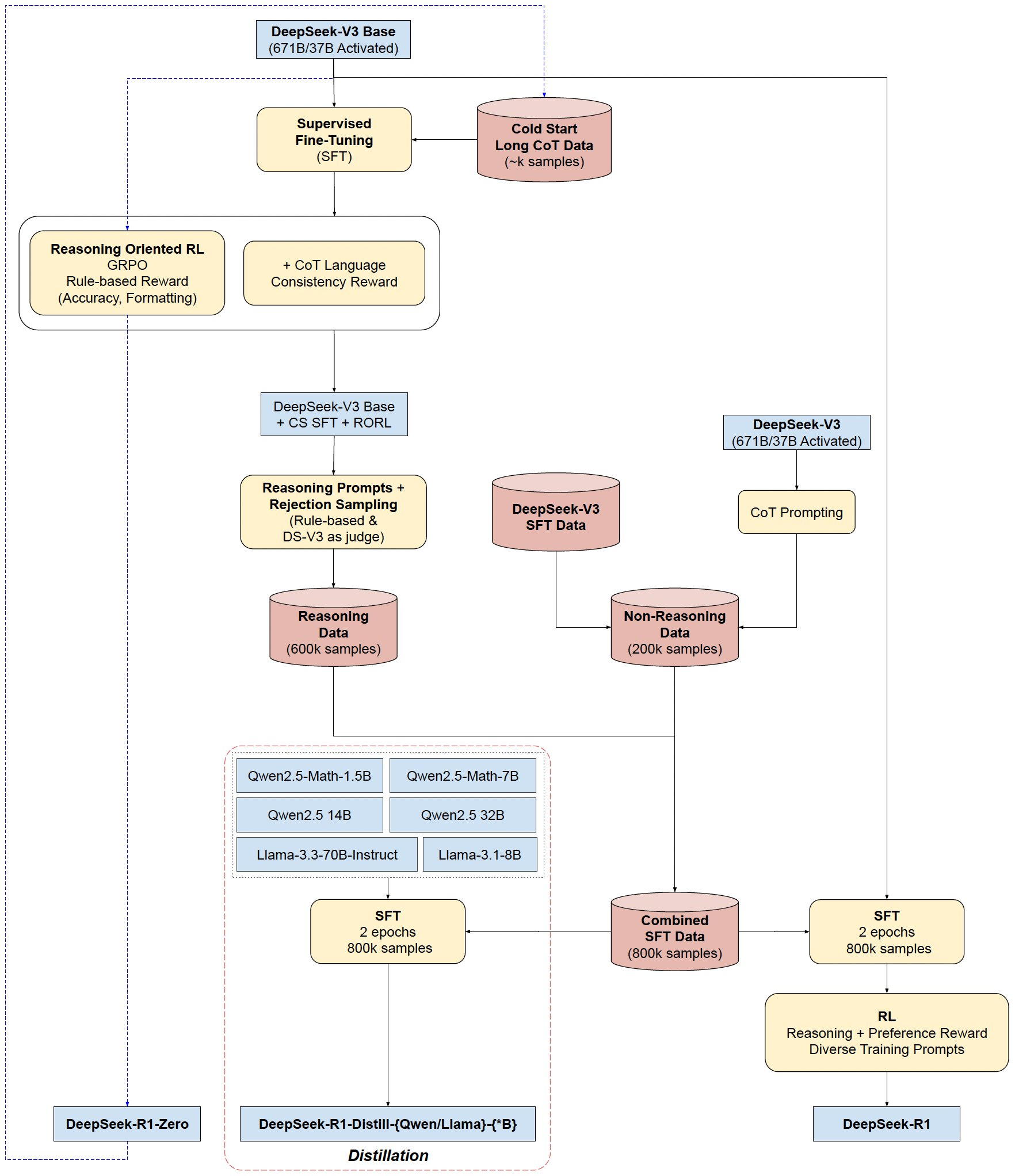

Modèle de base : DeepSeek-R1-Zero et DeepSeek-R1 sont tous deux formés sur la base de DeepSeek-V3-Base, et DeepSeek-R1 est enrichi d'une petite quantité de données CoT longues, ce qui rend le résultat plus structuré et plus parcimonieux.

Modèles de distillation (amélioration globale des capacités des miniatures open source existantes) : Distiller DeepSeek-R1 en plusieurs modèles plus petits qui sont ( Ollama (disponible en téléchargement)

Qwen2.5-Math-1.5B, Qwen2.5-Math-7B, Qwen2.5-14B, Qwen2.5-32B, Llama-3.1-8B, Llama-3.3-70B-Instruire

Flux de formation de DeepSeek-R1(-Zero)

- Démarrage à froid : mise au point sur l'exemple du CoT

- Apprentissage par renforcement du raisonnement : ajout de récompenses pour la cohérence linguistique

- Génération de données : créées 80 10 000 échantillons d'entraînement

- Apprentissage par renforcement ultime : compétences équilibrées (à la fois raisonnées et génériques) grâce à un retour d'information mixte.

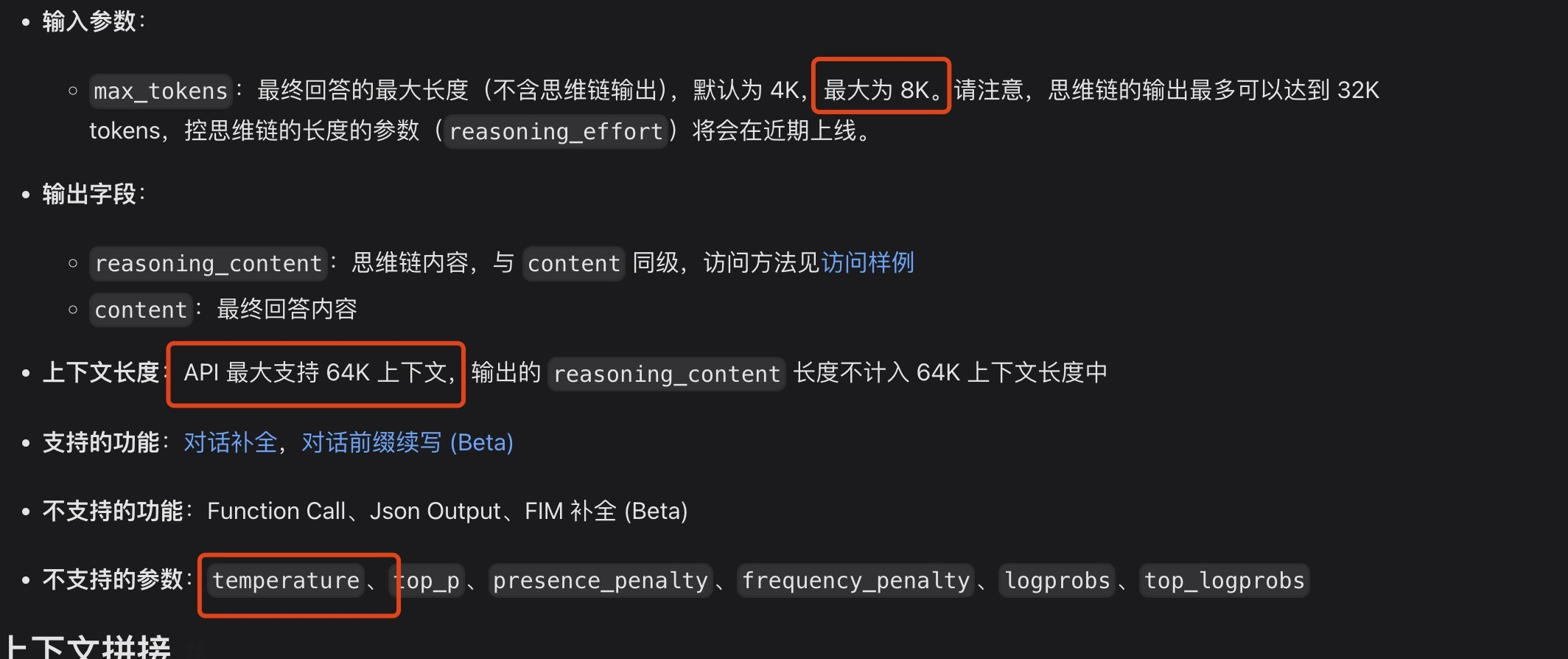

problème, la longueur du contexte de l'API peut s'avérer insuffisante dans la programmation.

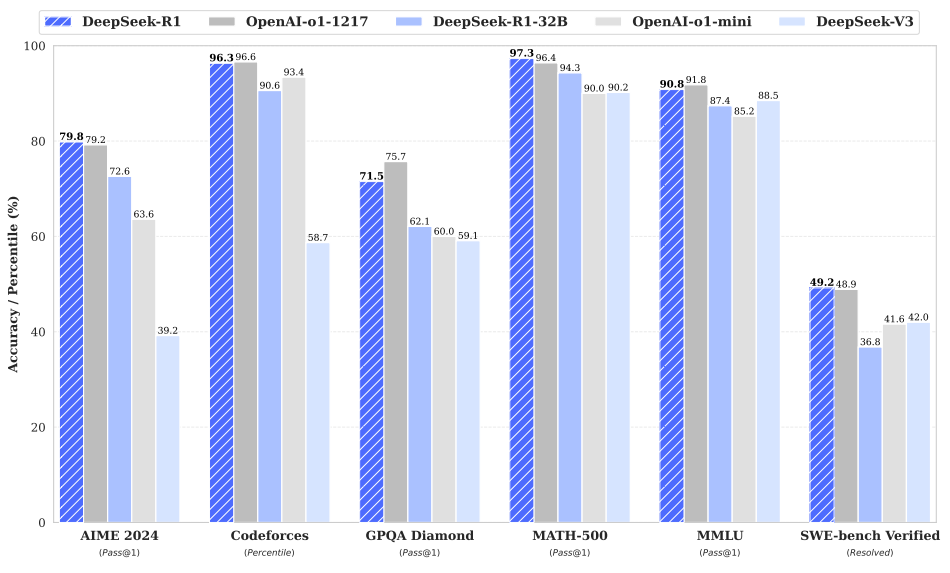

Évaluation de référence

Solides compétences en matière de raisonnement :

Il obtient de bons résultats dans les problèmes mathématiques, avec des performances comparables à celles de l'OpenAI-01-1217. A obtenu un score étonnamment élevé (97,3%) au test de référence MATH-500.

Excellentes performances dans les tâches d'algorithme de codage telles que Codeforces et LiveCodeBench.

Démontrer de fortes capacités dans les tâches nécessitant un raisonnement complexe, telles que FRAMES.

De solides capacités d'utilisation générale :

Excellentes performances dans les tests de référence basés sur la connaissance tels que MMLU, MMLU-Pro et GPQA Diamond.

Il a également excellé dans la rédaction, la réponse à des questions ouvertes sur le terrain et une variété d'autres tâches.

D'excellents taux de victoire en matière de contrôle de la longueur sur des benchmarks tels que AlpacaEval 2.0 et ArenaHard, démontrant qu'il gère intelligemment les requêtes non orientées vers l'examen.

Capacité à produire des résumés concis et à éviter les biais de longueur.

Bonne lisibilité :Avec des données de départ à froid et une conception spécifique dans le processus de formation, les résultats de DeepSeek-R1 sont plus faciles à lire, en utilisant le format et la structure appropriés.

Le multilinguisme :Bien qu'il soit actuellement optimisé principalement pour le chinois et l'anglais, il montre une certaine capacité à traiter des requêtes dans plusieurs langues.

Capacité à suivre des instructions :Il a obtenu de bons résultats au test de référence IF-Eval, démontrant ainsi sa capacité à comprendre et à suivre des instructions.

Capacité d'auto-évolution :Grâce à l'apprentissage par renforcement, les modèles peuvent apprendre de manière autonome et améliorer leurs capacités de raisonnement, et sont capables de traiter des problèmes complexes en augmentant leur temps de réflexion.

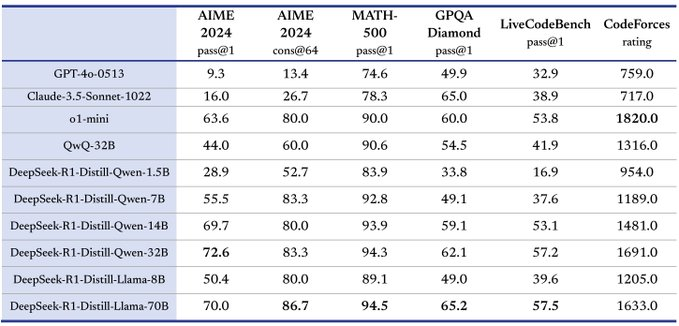

Excellent potentiel de distillation :DeepSeek-R1 peut être utilisé comme modèle professeur pour distiller la puissance d'inférence dans des modèles plus petits, et les modèles distillés ont d'excellentes performances, par exemple DeepSeek-R1-Distill-Qwen-32B, qui surpasse de manière significative les autres modèles sur plusieurs points de référence.

À propos des capacités de programmation locale

Si vous pensez que la version 3 est suffisante pour la programmation, quel est le modèle de distillation alternatif pour les ordinateurs de bureau ? Quel modèle de distillation est comparable à DeepSeek V3 ? Selon le score LiveCodeBench, DeepSeek V3 obtient un score de 42,2 et le modèle de distillation Qwen 14B un score de 53,1. Les performances sont comparables et la taille de la classe est relativement réduite, ce qui permet d'utiliser le modèle 14B sur le poste de travail.

DeepSeek-R1 : Motiver le raisonnement LLM par l'apprentissage par renforcement.

Posté par DeepSeek-AI

Original : https://github.com/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf

résumés

Nous présentons nos modèles d'inférence de première génération, DeepSeek-R1-Zero et DeepSeek-R1. DeepSeek-R1-Zero, un modèle entraîné par apprentissage par renforcement (RL) à grande échelle sans étape initiale de réglage fin supervisé (SFT), fait preuve d'une inférence supérieure. Avec l'apprentissage par renforcement, DeepSeek-R1-Zero émerge naturellement avec de nombreux comportements d'inférence puissants et intéressants. Cependant, il rencontre également des difficultés telles qu'une mauvaise lisibilité et un mélange de langues. Pour résoudre ces problèmes et améliorer les performances d'inférence, nous présentons DeepSeek-R1, qui combine l'entraînement en plusieurs étapes et les données de démarrage à froid avant le RL. DeepSeek-R1 atteint des performances comparables à celles de l'OpenAI-01-1217 pour les tâches d'inférence. Pour soutenir la communauté des chercheurs, nous ouvrons DeepSeek-R1-Zero, DeepSeek-R1 et six modèles denses (1,5B, 7B, 8B, 14B, 32B, 70B) basés sur les raffinements de Qwen et de Llama.

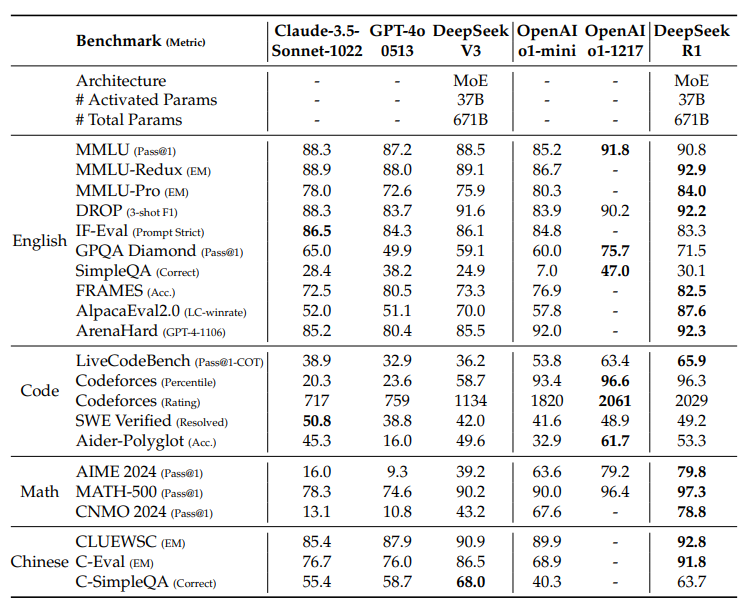

Fig. 1 | Performances de référence de DeepSeek-R1.

répertoire (sur le disque dur de l'ordinateur)

1 Introduction

1.1 Contributions

1.2 Résumé des résultats de l'évaluation

2 Méthodologie

2.1 Vue d'ensemble

2.2 DeepSeek-R1-Zero : Apprentissage par renforcement basé sur des modèles fondamentaux

2.2.1 Algorithme d'apprentissage amélioré

2.2.2 Modélisation des incitations

2.2.3 Modèles de formation

2.2.4 Performance de DeepSeek-R1-Zero, processus d'auto-évolution et moments d'épiphanie

2.3 DeepSeek-R1 : Apprentissage par renforcement avec un démarrage à froid

2.3.1 Démarrage à froid

2.3.2 Apprentissage par renforcement orienté vers le raisonnement

2.3.3 Rejet de l'échantillonnage et supervision de la mise au point

2.3.4 Apprentissage par renforcement pour tous les scénarios

2.4 Distillation : augmenter la puissance de raisonnement des petits modèles

3 expériences

3.1 Évaluation de DeepSeek-R1

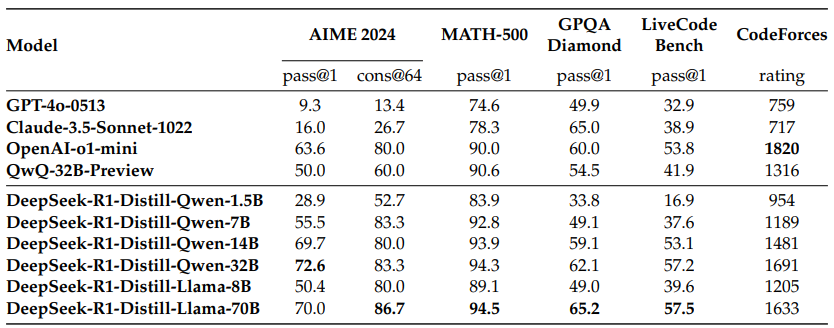

3.2 Évaluation de la modélisation de la distillation

4 Discussion

4.1 Distillation et apprentissage intensif

4.2 Tentatives infructueuses

5 Conclusions, limites et travaux futurs

1. introduction

Ces dernières années, les modèles de langage à grande échelle (LLM) ont fait l'objet d'itérations et de développements rapides (Anthropic, 2024 ; Google, 2024 ; OpenAI, 2024a), comblant progressivement le fossé menant à l'intelligence générale artificielle (AGI).

Récemment, le post-entraînement est devenu une partie importante du processus de formation complet. Il a été démontré qu'elle améliore la précision des tâches de raisonnement, s'aligne sur les valeurs sociétales et s'adapte aux préférences de l'utilisateur, tout en nécessitant relativement peu de ressources informatiques par rapport à la préformation. En termes de puissance de raisonnement, la famille de modèles o1 d'OpenAI (OpenAI, 2024b) introduit pour la première fois une mise à l'échelle lors du raisonnement en augmentant la longueur du processus de raisonnement par chaîne de pensée. Cette approche a conduit à des avancées significatives dans une variété de tâches de raisonnement, telles que le raisonnement mathématique, le codage et le raisonnement scientifique. Cependant, le défi d'une mise à l'échelle efficace du temps de test reste une question ouverte pour la communauté des chercheurs. Certains travaux antérieurs ont exploré diverses approches, notamment les modèles de récompense basés sur les processus (Lightman et al., 2023 ; Uesato et al., 2022 ; Wang et al., 2023), l'apprentissage par renforcement (Kumar et al., 2024) et les algorithmes de recherche tels que la recherche arborescente de Monte-Carlo et la recherche par paquets (Feng et al., 2024 ; Trinh et al., 2024). 2024 ; Trinh et al.) Cependant, aucune de ces méthodes n'a été en mesure d'atteindre des performances d'inférence généralisée comparables à la famille de modèles o1 d'OpenAI.

Dans cet article, nous faisons le premier pas vers l'amélioration des capacités de raisonnement des modèles de langage en utilisant l'apprentissage par renforcement (RL). Notre objectif est d'explorer le potentiel de l'apprentissage par renforcement pour développer des capacités de raisonnement sans aucune donnée supervisée, en se concentrant sur l'auto-évolution à travers un processus d'apprentissage par renforcement pur. Plus précisément, nous utilisons DeepSeek-V3-Base comme modèle de base et GRPO (Shao et al., 2024) comme cadre d'apprentissage par renforcement pour améliorer les performances du modèle en matière de raisonnement. Au cours du processus de formation, DeepSeek-R1-Zero émerge naturellement avec de nombreux comportements d'inférence puissants et intéressants. Après des milliers d'étapes RL, DeepSeek-R1-Zero montre d'excellentes performances sur les benchmarks d'inférence. Par exemple, AIME 2024的pass@1得分从15.6%提高到71.0% et par vote majoritaire, le score est encore amélioré à 86.7%, atteignant le niveau de performance de OpenAI-01-0912.

Cependant, DeepSeek-R1-Zero se heurte à des difficultés telles que la faible lisibilité et le mélange des langues. Pour résoudre ces problèmes et améliorer les performances d'inférence, nous présentons DeepSeek-R1, qui combine une petite quantité de données de départ à froid avec un processus de formation en plusieurs étapes. Plus précisément, nous commençons par collecter des milliers de données de démarrage à froid pour affiner le modèle DeepSeek-V3-Base. Ensuite, nous effectuons un apprentissage par inférence similaire à DeepSeek-R1-Zero. Lorsque le processus d'apprentissage par inférence approche de la convergence, nous créons de nouvelles données SFT en rejetant l'échantillonnage des points de contrôle de l'apprentissage par inférence, nous les combinons avec les données supervisées de DeepSeek-V3 dans les domaines de l'écriture, des questions factuelles et de la conscience de soi, puis nous entraînons à nouveau le modèle DeepSeek-V3-Base. V3-Base. Après un réglage fin avec les nouvelles données, ce point de contrôle subit un processus RL supplémentaire, qui prend en compte les indices de tous les scénarios. Après ces étapes, nous obtenons un point de contrôle appelé DeepSeek-R1, dont les performances sont comparables à celles de l'OpenAI-01-1217.

Nous avons également exploré la distillation de DeepSeek-R1 vers des modèles denses plus petits. En utilisant Qwen 2.5-32B (Qwen, 2024b) comme modèle de base, la distillation directement à partir de DeepSeek-R1 est plus performante que l'application de RL par-dessus, ce qui suggère que les modèles d'inférence trouvés dans le modèle de base plus large sont essentiels pour améliorer l'inférence. La famille de modèles Qwen et Llama (Dubey et al., 2024) est en libre accès pour la distillation. Notamment, notre modèle distillé 14B surpasse substantiellement l'état de l'art open-source QwQ-32B-Preview (Qwen, 2024a), et les modèles distillés 32B et 70B établissent un nouveau record pour les benchmarks de raisonnement dans les modèles denses.

1.1 Contributions

Post-entraînement : apprentissage par renforcement à grande échelle basé sur des modèles de base

- Nous appliquons l'apprentissage par renforcement (RL) directement au modèle sous-jacent sans avoir recours à un réglage fin supervisé (SFT) en tant qu'étape préliminaire. Cette approche permet au modèle d'explorer des chaînes de pensée (CoT) pour résoudre des problèmes complexes, ce qui a conduit au développement de DeepSeek-R1-Zero. DeepSeek-R1-Zero démontre la capacité d'auto-valider, de réfléchir et de développer des CoT, ce qui constitue une étape importante pour la communauté des chercheurs. Il s'agit notamment de la première étude publique à valider le fait que la capacité de raisonnement du LLM peut être motivée par le RL pur sans qu'il soit nécessaire de recourir au SFT.

- Nous décrivons le processus utilisé pour développer DeepSeek-R1. Ce processus se compose de deux phases RL visant à découvrir des modèles de raisonnement améliorés et à les aligner sur les préférences humaines, et de deux phases SFT qui servent de germes pour les capacités de raisonnement et autres du modèle. Nous pensons que ce processus profitera à l'industrie en créant de meilleurs modèles.

Distillation : les petits modèles peuvent être puissants

- Nous démontrons que les schémas d'inférence des grands modèles peuvent être distillés dans des modèles plus petits pour une meilleure performance par rapport aux schémas d'inférence découverts via RL sur les petits modèles. Le logiciel libre DeepSeek-R1 et son API permettront à la communauté des chercheurs de distiller de meilleurs petits modèles à l'avenir.

- En utilisant les données d'inférence générées par DeepSeek-R1, nous avons affiné plusieurs modèles denses largement utilisés dans la communauté des chercheurs. Les résultats de l'évaluation montrent que les petits modèles denses distillés sont performants dans les benchmarks.DeepSeek-R1-Distill-Qwen-7B atteint un score de 55,51 TP3T sur AIME 2024, surpassant QwQ-32B-Preview.En outre, DeepSeek-R1-Distill-Qwen-32B a obtenu 72,61 TP3T sur AIME 2024, 94,3% sur MATH-500 et 57,2% sur LiveCodeBench. Ces résultats sont nettement meilleurs que les modèles open-source précédents et comparables à o1-mini. Nous avons ouvert à la communauté les points de contrôle des distillations 1,5B, 7B, 8B, 14B, 32B et 70B basés sur les séries Qwen2.5 et Llama3.

1.2 Résumé des résultats de l'évaluation

- Tâches d'inférence :(1) DeepSeek-R1 a obtenu un score pass@1 de 79.81 TP3T sur AIME 2024, légèrement supérieur à OpenAI-o1-1217. Sur MATH-500, il a obtenu un score impressionnant de 97.31 TP3T, ce qui est comparable à la performance d'OpenAI-o1-1217 et significativement meilleur que les autres modèles. modèles. (2) Pour les tâches liées au codage, DeepSeek-R1 a démontré son niveau d'expertise dans la compétition de codage en obtenant une note Elo de 2 029 sur Codeforces, surpassant le participant humain de 96,31 TP3T dans cette compétition. Pour les tâches liées à l'ingénierie, DeepSeek-R1 a obtenu des résultats légèrement supérieurs à ceux de DeepSeek-V3, qui aide les développeurs à travailler dans le monde réel.

- **** connaissances : sur des benchmarks tels que MMLU, MMLU-Pro, et GPQA Diamond, DeepSeek-R1 obtient des résultats exceptionnels, surpassant de manière significative DeepSeek-V3, avec un score de 90,8% sur MMLU, 84,0% sur MMLU-Pro, et GPQA Diamond avec un score de 71,5%. Bien que ses performances soient légèrement inférieures à celles d'OpenAI-01-1217 sur ces points de référence, DeepSeek-R1 surpasse les autres modèles à code source fermé, ce qui démontre son avantage concurrentiel dans les tâches éducatives. Sur le benchmark factuel SimpleQA, DeepSeek-R1 surpasse DeepSeek-V3, démontrant ainsi sa capacité à traiter des requêtes basées sur des faits. Une tendance similaire est observée dans OpenAI-o1 au-delà de 4o pour ce benchmark.

- Autres : DeepSeek-R1 a également obtenu de bons résultats dans une variété de tâches, y compris la rédaction créative, la réponse à des questions générales, l'édition, le résumé, etc. Il a obtenu un taux de réussite de 87,61 TP3T sur AlpacaEval 2.0 et de 92,31 TP3T sur ArenaHard, démontrant ainsi sa forte capacité à traiter intelligemment des requêtes qui ne sont pas orientées vers l'examen. En outre, DeepSeek-R1 est performant dans les tâches qui nécessitent une compréhension du contexte long, surpassant de manière significative DeepSeek-V3 dans le test de référence du contexte long.

2. la méthodologie

2.1 Vue d'ensemble

Les travaux antérieurs se sont fortement appuyés sur de grandes quantités de données supervisées pour améliorer les performances des modèles. Dans cette étude, nous démontrons que l'inférence peut être améliorée de manière significative par l'apprentissage par renforcement (RL) à grande échelle, même sans utiliser le réglage fin supervisé (SFT) comme départ à froid. En outre, les performances peuvent être encore améliorées en incluant une petite quantité de données de départ à froid. Dans les sections suivantes, nous présentons (1) DeepSeek-R1-Zero, qui applique l'apprentissage par renforcement directement au modèle de base sans aucune donnée SFT, (2) DeepSeek-R1, qui applique l'apprentissage par renforcement à partir de points de contrôle affinés avec des milliers d'exemples de longue chaîne de pensées (CoT) et (3) la distillation des capacités d'inférence de DeepSeek-R1 dans de petits modèles denses. petits modèles denses.

2.2 DeepSeek-R1-Zero : Apprentissage par renforcement basé sur des modèles fondamentaux

L'apprentissage par renforcement a montré une efficacité significative dans les tâches d'inférence, comme l'ont démontré nos travaux antérieurs (Shao et al., 2024 ; Wang et al., 2023). Cependant, ces tâches s'appuient fortement sur des données supervisées, dont la collecte prend du temps. Dans cette section, nous explorons le potentiel du LLM pour développer des capacités de raisonnement sans aucune donnée supervisée, en nous concentrant sur l'auto-évolution à travers un processus d'apprentissage par renforcement pur. Nous commençons par un bref aperçu de notre algorithme d'apprentissage par renforcement et présentons ensuite quelques résultats passionnants qui, nous l'espérons, fourniront des informations précieuses à la communauté.

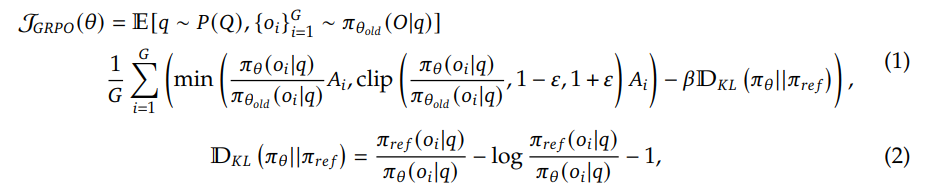

Optimisation de la stratégie relative du groupe Pour économiser le coût d'apprentissage de la RL, nous utilisons l'optimisation de la stratégie relative du groupe (GRPO) (Shao et al., 2024), qui abandonne le modèle critique, qui est généralement de la même taille que le modèle stratégique, et estime plutôt la ligne de base à partir des scores de groupe. Plus précisément, pour chaque problème q, GRPO échantillonne un ensemble de sorties {o1, o2,..., oG} de l'ancienne stratégie πθold et optimise ensuite le modèle de stratégie πθ en maximisant l'objectif suivant :

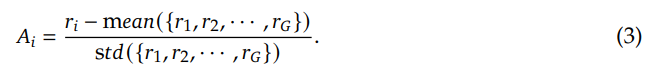

où ɛ et β sont des hyperparamètres et Ai est la dominance, en utilisant les récompenses correspondant aux sorties de chaque groupe {r1,r2, . . . rG} pour le calcul :

La récompense est la source du signal de formation, qui détermine la direction d'optimisation de RL. Pour former DeepSeek-R1-Zero, nous utilisons un système de récompense basé sur des règles qui consiste en deux types principaux de récompenses :

- Récompenses de précision : les modèles de récompense de précision évaluent si une réponse est correcte. Par exemple, pour les problèmes de mathématiques dont les résultats sont déterministes, le modèle doit fournir la réponse finale dans un format spécifique (par exemple, dans une boîte) afin que la vérification de l'exactitude basée sur des règles puisse être effectuée de manière fiable. De même, pour les problèmes LeetCode, le compilateur peut être utilisé pour générer un retour d'information basé sur des cas de test prédéfinis.

- Récompense du format : en plus du modèle de récompense de la précision, nous avons utilisé un modèle de récompense du format qui oblige le modèle à placer le processus de réflexion entre les étiquettes '' et ''.

Nous n'avons pas utilisé de modèles de récompense neuronaux de résultat ou de processus dans le développement de DeepSeek-R1-Zero parce que nous avons constaté que les modèles de récompense neuronaux peuvent souffrir du piratage de la récompense pendant l'apprentissage par renforcement à grande échelle et que le recyclage du modèle de récompense nécessite des ressources de formation supplémentaires, ce qui peut compliquer le processus de formation global.

Pour entraîner DeepSeek-R1-Zero, nous avons d'abord conçu un modèle simple qui demande au modèle de base de suivre les instructions que nous avons spécifiées. Comme le montre le tableau 1, ce modèle exige que DeepSeek-R1-Zero génère d'abord le processus de raisonnement, puis la réponse finale. Nous avons intentionnellement limité les contraintes à ce format structurel afin d'éviter tout biais spécifique au contenu, tel que l'application d'un raisonnement réfléchi ou la promotion de stratégies de résolution de problèmes spécifiques, afin de garantir que nous puissions observer avec précision la progression naturelle du modèle à travers le processus d'apprentissage par renforcement (RL).

用户与助手之间的对话。用户提出一个问题,助手解决该问题。

助手首先在脑海中思考推理过程,然后为用户提供答案。

推理过程和答案分别用 <think> </think> 和 <answer> </answer> 标签括起来,即:

<think> 此处为推理过程 </think>

<answer> 此处为答案 </answer>。

用户:提示。助手:

Tableau 1 : Modèles pour DeepSeek-R1-Zero. Pendant l'entraînement, lesattirer l'attention sur qqch.sera remplacé par un problème de raisonnement spécifique.

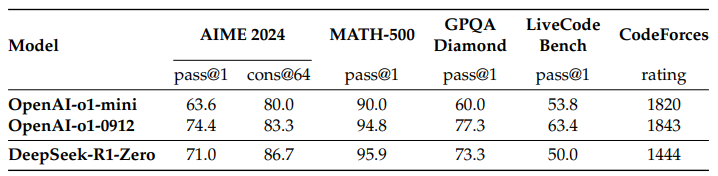

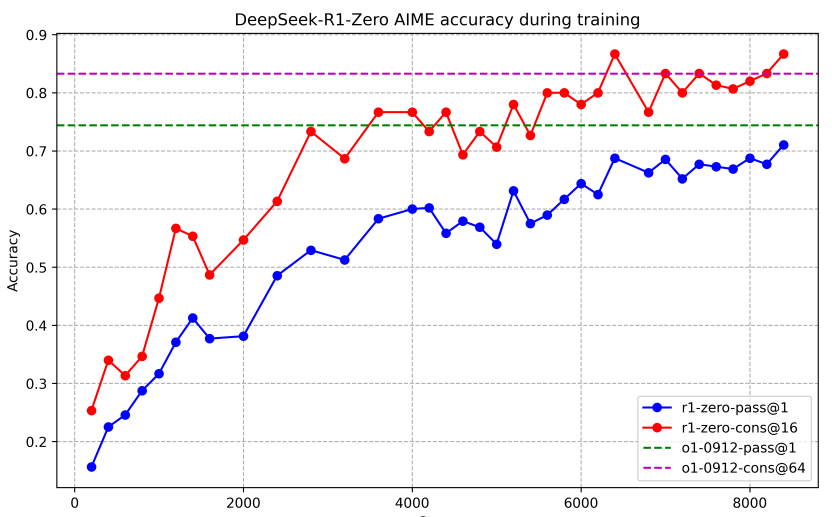

Performance de DeepSeek-R1-Zero La figure 2 illustre la trajectoire de performance de DeepSeek-R1-Zero sur le benchmark AIME 2024 tout au long de la formation à l'apprentissage par renforcement (RL). Comme on peut le voir, les performances de DeepSeek-R1-Zero s'améliorent de manière régulière et cohérente au fur et à mesure de la formation à l'apprentissage par renforcement. Notamment, le score moyen de pass@1 d'AIME 2024 montre une croissance significative, passant d'un score initial de 15,61 TP3T à un score impressionnant de 71,01 TP3T, atteignant un niveau de performance comparable à celui d'OpenAI-01-0912. Cette amélioration significative souligne l'efficacité de notre algorithme RL dans l'optimisation des performances du modèle.

Le tableau 2 présente une analyse comparative de DeepSeek-R1-Zero et du modèle o1-0912 d'OpenAI sur divers critères de référence liés à l'inférence. Les résultats montrent que RL fait

Tableau 2 - Comparaison des modèles DeepSeek-R1-Zero et OpenAI o1 sur des benchmarks liés à l'inférence.

Fig. 2 | Précision AIME de DeepSeek-R1-Zero pendant l'entraînement. Pour chaque problème, nous avons échantillonné 16 réponses et calculé la précision moyenne globale afin de garantir une évaluation stable.

DeepSeek-R1-Zero réalise une inférence puissante sans aucun réglage fin supervisé des données. Il s'agit d'un résultat remarquable, car il met en évidence la capacité du modèle à apprendre et à se généraliser efficacement par le seul biais du RL. En outre, les performances de DeepSeek-R1-Zero peuvent être encore améliorées en appliquant le vote majoritaire. Par exemple, en utilisant le vote majoritaire dans les benchmarks AIME, les performances de DeepSeek-R1-Zero passent de 71,01 TP3T à 86,71 TP3T, dépassant ainsi les performances d'OpenAI-01-0912.Le fait que DeepSeek-R1-Zero atteigne des performances aussi compétitives avec et sans vote majoritaire Le fait que DeepSeek-R1-Zero atteigne des performances aussi compétitives avec et sans vote majoritaire met en évidence ses fortes capacités sous-jacentes et son potentiel de développement dans les tâches de raisonnement.

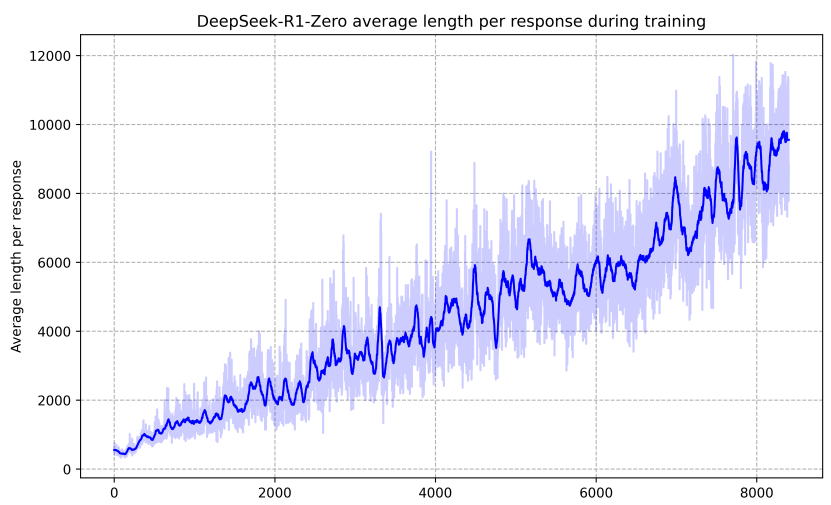

Le processus d'auto-évolution de DeepSeek-R1-Zero Le processus d'auto-évolution de DeepSeek-R1-Zero est une démonstration fascinante de la manière dont le RL peut conduire les modèles à améliorer leur raisonnement de manière autonome. En lançant le RL directement à partir du modèle de base, nous pouvons suivre de près les progrès du modèle sans être soumis à une phase de mise au point supervisée. Cette approche permet de voir clairement comment le modèle évolue dans le temps, notamment en termes de capacité à traiter des tâches de raisonnement complexes.

Comme le montre la figure 3, le temps de réflexion de DeepSeek-R1-Zero s'améliore continuellement tout au long du processus de formation. Cette amélioration n'est pas le résultat d'un réglage externe, mais plutôt d'un développement intrinsèque du modèle. DeepSeek-R1-Zero acquiert naturellement la capacité de résoudre des tâches de raisonnement de plus en plus complexes en utilisant un calcul de temps de test étendu. Ce calcul va de la génération de centaines à des milliers de jetons d'inférence, permettant ainsi au modèle d'explorer et d'affiner ses processus de pensée de manière plus approfondie.

L'un des aspects les plus frappants de cette auto-évolution est l'émergence de comportements complexes au fur et à mesure que les calculs augmentent au cours des essais. La réflexion - c'est-à-dire le fait que le modèle revoit et réévalue ses étapes précédentes - ainsi que l'exploration d'autres approches de résolution de problèmes émergent spontanément. Ces comportements ne sont pas explicitement programmés, mais résultent de l'interaction du modèle avec l'environnement d'apprentissage par renforcement. Ce développement spontané améliore considérablement les capacités de raisonnement de DeepSeek-R1-Zero, ce qui lui permet de s'attaquer à des tâches plus difficiles avec plus d'efficacité et de précision.

Fig. 3 | Longueur de réponse moyenne de DeepSeek-R1-Zero sur l'ensemble d'entraînement du processus RL.DeepSeek-R1-Zero apprend naturellement à résoudre les tâches d'inférence en prenant plus de temps de réflexion.

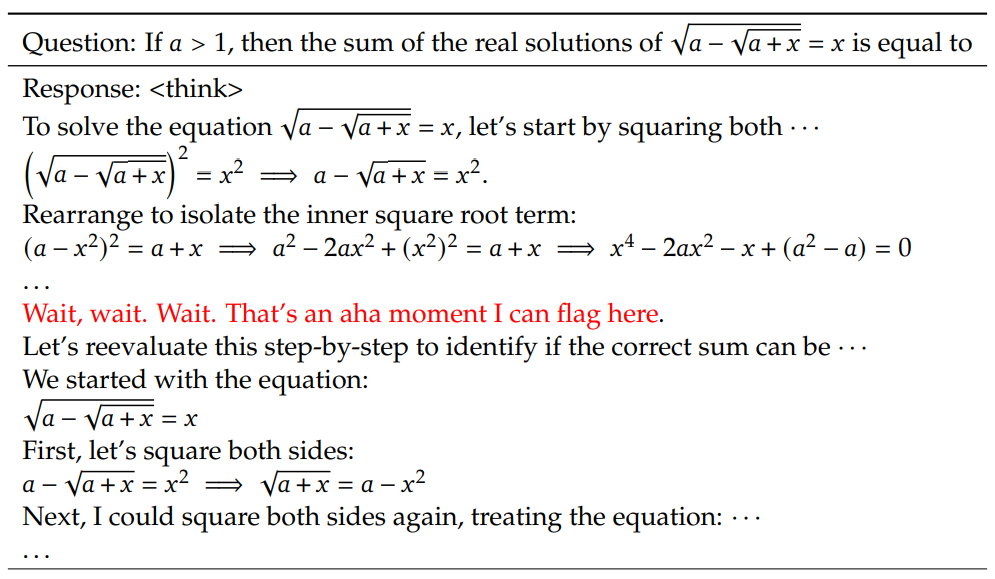

Moments d'épiphanie dans DeepSeek-R1-Zero Un phénomène particulièrement intéressant observé pendant l'entraînement de DeepSeek-R1-Zero est l'apparition de "moments d'épiphanie". Comme le montre le tableau 3, ce moment survient dans la version intermédiaire du modèle. À ce stade, DeepSeek-R1-Zero apprend à consacrer plus de temps de réflexion au problème en réévaluant son approche initiale. Ce comportement témoigne non seulement des capacités d'inférence croissantes du modèle, mais constitue également un exemple fascinant de la manière dont l'apprentissage par renforcement peut conduire à des résultats inattendus et complexes.

Tableau 3 - Un "moment d'épiphanie" intéressant dans la version intermédiaire de DeepSeek-R1-Zero. Le modèle apprend à repenser en utilisant un ton anthropomorphique. Il s'agit également de notre propre moment d'épiphanie, qui nous a permis de constater la puissance et la beauté de l'apprentissage par renforcement.

Ce moment a été une "révélation" non seulement pour le modèle, mais aussi pour les chercheurs qui ont observé son comportement. Il souligne la puissance et la beauté de l'apprentissage par renforcement : au lieu d'enseigner explicitement à un modèle comment résoudre un problème, il suffit de lui fournir les bonnes incitations pour qu'il développe de manière autonome des stratégies avancées de résolution de problèmes. Ce "moment d'épiphanie" est un rappel puissant du potentiel de l'apprentissage par renforcement pour débloquer de nouveaux niveaux d'intelligence dans les systèmes d'IA, ouvrant la voie à des modèles plus autonomes et plus adaptatifs à l'avenir.

Inconvénients de DeepSeek-R1-Zero Bien que DeepSeek-R1-Zero présente de fortes capacités de raisonnement et développe de manière autonome des comportements de raisonnement inattendus et puissants, il est également confronté à certains problèmes. Par exemple, DeepSeek-R1-Zero souffre d'une mauvaise lisibilité et d'un mélange de langues. Pour rendre le processus de raisonnement plus lisible et le partager avec la communauté ouverte, nous avons exploré DeepSeek-R1, une approche qui utilise RL avec des données de démarrage à froid adaptées aux humains.

2.3 DeepSeek-R1 : Apprentissage par renforcement avec un démarrage à froid

Inspirés par les résultats prometteurs de DeepSeek-R1-Zero, deux questions naturelles se posent : 1) La performance de l'inférence peut-elle être encore améliorée ou la convergence accélérée en incorporant une petite quantité de données de haute qualité comme départ à froid ? et 2) Comment pouvons-nous former un modèle convivial qui non seulement produit des chaînes de pensée (CoT) claires et cohérentes, mais qui démontre également de fortes capacités de généralisation ? Pour répondre à ces questions, nous avons conçu un processus de formation pour DeepSeek-R1. Ce processus se compose de quatre phases, décrites ci-dessous.

Contrairement à DeepSeek-R1-Zero, afin d'éviter une phase de démarrage à froid précoce et instable lorsque la formation RL commence à partir du modèle de base, pour DeepSeek-R1 nous avons construit et collecté une petite quantité de données CoT longues pour affiner le modèle en tant que participant RL initial. Pour collecter ces données, nous avons exploré plusieurs approches : l'utilisation d'invites à quelques échantillons avec de longues CoT comme exemples, l'invitation directe du modèle à générer des réponses détaillées avec réflexion et validation, la collecte des résultats de DeepSeek-R1-Zero dans un format lisible, et le post-traitement des résultats par des annotateurs humains.

Dans ce travail, nous avons collecté des milliers de données de démarrage à froid pour affiner DeepSeek-V3-Base en tant que point de départ pour RL. Les avantages des données de démarrage à froid par rapport à DeepSeek-R1-Zero sont les suivants :

- Lisibilité : l'une des principales limites de DeepSeek-R1-Zero est que son contenu n'est souvent pas lisible. Les réponses peuvent être rédigées dans plusieurs langues ou ne pas comporter le formatage utilisé pour mettre en évidence les réponses de l'utilisateur. Lors de la création des données de démarrage à froid pour DeepSeek-R1, nous avons conçu un schéma lisible qui inclut un résumé à la fin de chaque réponse et filtre les réponses qui ne sont pas facilement lisibles. Ici, nous définissons le format de sortie comme suit : | special_token | | special_token |

, où le processus de raisonnement est le CoT de la requête et le résumé est utilisé pour résumer les résultats du raisonnement. - Potentiel : En utilisant un humain avant de créer un modèle pour les données de démarrage à froid, nous observons de meilleures performances par rapport à DeepSeek-R1-Zero. Nous soutenons que la formation itérative est une meilleure façon de raisonner sur les modèles.

Après avoir affiné DeepSeek-V3-Base sur des données de démarrage à froid, nous avons appliqué le même processus de formation par apprentissage par renforcement à grande échelle que celui utilisé dans DeepSeek-R1-Zero. L'objectif de cette phase était d'améliorer les capacités d'inférence du modèle, en particulier dans les tâches qui nécessitent une inférence, telles que le codage, le raisonnement mathématique, scientifique et logique impliquant des questions explicites. Au cours du processus de formation, nous avons observé que le CoT présentait souvent un mélange de langues, en particulier lorsque les indices RL impliquent plusieurs langues. Pour atténuer le problème du mélange des langues, nous avons introduit une récompense pour la cohérence linguistique pendant l'apprentissage de la NR, calculée comme la proportion de mots dans la langue cible dans le CdT. Bien que les expériences d'ablation montrent que cet alignement entraîne une légère dégradation des performances du modèle, cette récompense est conforme aux préférences humaines, ce qui la rend plus lisible. Enfin, nous combinons les récompenses de la précision et de la cohérence linguistique dans la tâche de raisonnement en les additionnant directement pour former la récompense finale. Nous appliquons ensuite l'apprentissage par renforcement (RL) au modèle affiné jusqu'à ce qu'il atteigne la convergence dans la tâche d'inférence.

Lorsque le RL orienté vers l'inférence converge, nous utilisons les points de contrôle générés pour collecter des données SFT (réglage fin supervisé) pour les cycles suivants. Contrairement aux données initiales de démarrage à froid, qui se concentrent principalement sur le raisonnement, cette phase incorpore des données provenant d'autres domaines afin d'améliorer les capacités du modèle en matière d'écriture, de jeu de rôle et d'autres tâches à usage général. Plus précisément, nous avons généré des données et affiné le modèle comme décrit ci-dessous.

Données d'inférence Nous avons créé des indices d'inférence et généré des trajectoires d'inférence en effectuant un échantillonnage de rejet à partir des points de contrôle entraînés par la logique logique logique (RL) décrits ci-dessus. Dans la phase précédente, nous n'avons inclus que des données qui pouvaient être évaluées à l'aide de récompenses basées sur des règles. Cependant, dans cette phase, nous étendons l'ensemble de données en combinant plus de données, dont certaines utilisent des modèles de récompense génératifs, en introduisant des étiquettes réelles et des prédictions de modèle dans DeepSeek-V3 pour jugement. En outre, étant donné que les résultats du modèle sont parfois confus et difficiles à lire, nous avons filtré les chaînes de pensée contenant un langage mixte, de longs paragraphes et des morceaux de code. Pour chaque indice, nous avons échantillonné plusieurs réponses et n'avons conservé que la réponse correcte. Au total, nous avons recueilli environ 600 000 échantillons d'entraînement liés au raisonnement.

Données non raisonnées Pour les données non raisonnées, telles que l'écriture, les questions factuelles, la connaissance de soi et la traduction, nous utilisons le processus DeepSeek-V3 et réutilisons des parties de l'ensemble de données SFT de DeepSeek-V3. Pour certaines tâches autres que le raisonnement, nous demandons à DeepSeek-V3 de générer des chaînes de pensée potentielles en l'invitant à répondre à une question avant de le faire. Enfin, nous collectons un total d'environ 200 000 échantillons d'entraînement qui ne sont pas liés à l'inférence.

Nous avons affiné DeepSeek-V3-Base pendant deux périodes en utilisant l'ensemble de données susmentionné d'environ 800 000 échantillons.

Pour aligner davantage le modèle sur les préférences humaines, nous avons mis en œuvre une deuxième phase d'apprentissage par renforcement visant à accroître l'utilité et l'innocuité du modèle tout en améliorant continuellement son inférence. Plus précisément, nous entraînons le modèle à l'aide d'une combinaison de signaux de récompense et de diverses distributions d'indices. Pour les données d'inférence, nous nous en tenons à l'approche décrite dans DeepSeek-R1-Zero, qui utilise des récompenses basées sur des règles pour guider le processus d'apprentissage dans les domaines du raisonnement mathématique, du codage et du raisonnement logique. Pour les données générales, nous nous appuyons sur des modèles de récompense pour saisir les préférences humaines dans des scénarios complexes et détaillés. Nous nous appuyons sur le processus DeepSeek-V3 et utilisons des paires de préférences et des distributions d'indices d'entraînement similaires. Pour être utiles, nous nous concentrons exclusivement sur le résumé final, en veillant à ce que l'évaluation mette l'accent sur l'utilité et la pertinence de la réponse pour l'utilisateur, tout en minimisant l'interférence avec le processus de raisonnement sous-jacent. Pour garantir l'innocuité, nous évaluons l'ensemble de la réponse du modèle, y compris le processus de raisonnement et le résumé, afin d'identifier et d'atténuer les risques potentiels, les biais ou le contenu nuisible qui ont pu survenir au cours du processus de génération. En fin de compte, l'intégration des signaux de récompense et des différentes distributions de données nous permet de former un modèle qui excelle dans le raisonnement et donne la priorité à l'utilité et à l'innocuité.

2.4 Distillation : augmenter la puissance de raisonnement des petits modèles

Afin de rendre plus efficaces les petits modèles dotés de capacités d'inférence comme DeepSeek-R1, nous avons directement affiné des modèles open-source tels que Qwen (Qwen, 2024b) et Llama (AI@Meta, 2024) en utilisant les 800 000 échantillons collationnés par DeepSeek-R1 (comme détaillé dans le §2.3.3). Nos résultats suggèrent que cette simple méthode de distillation peut améliorer de manière significative l'inférence de petits modèles. Les modèles de base que nous utilisons ici sont Qwen2.5-Math-1.5B, Qwen2.5-Math-7B, Qwen2.5-14B, Qwen2.5-32B, Llama-3.1-8B, et Llama-3.3-70B-Instruct. nous avons choisi Llama-3.3 en raison de son pouvoir de raisonnement légèrement supérieur à celui de Llama-3.1.

Pour le modèle de distillation, nous n'appliquons que SFT et n'incluons pas l'étape RL, bien que la fusion de RL puisse améliorer de manière significative les performances du modèle. Notre objectif principal est de démontrer l'efficacité de la technique de distillation, en laissant l'exploration de l'étape RL à la communauté de recherche élargie.

3. expériences

l'étalonnage des performances Nous avons publié les résultats dans MMLU (Hendrycks et al., 2020), MMLU-Redux (Gema et al., 2024), MMLU-Pro (Wang et al., 2024), C-Eval (Huang et al., 2023), et CMMLU (Li et al., 2023), IFEval (Zhou et al., 2023), FRAMES (Krishna et al., 2024), GPQA Diamond (OpenAI Diamond) (Rein et al., 2023), et IFEval (Zhou et al., 2023), FRAMES (Krishna et al., 2024), GPQA Diamond (OpenAI Diamond) (Rein et al., 2023), SimpleQA (OpenAI, 2024). IFEval (Zhou et al., 2023), FRAMES (Krishna et al., 2024), GPQA Diamond (Rein et al., 2023), SimpleQA (OpenAI, 2024c), C-SimpleQA (He et al., 2024), SWE- Bench Verified (OpenAI, 2024d), Aider¹ , LiveCodeBench (Jain et al., 2024) (2024-08 - 2025-01), Codeforces², Chinese National High School Mathematics Olympiad (CNHSMOA) School Mathematics Olympiad (CNMO 2024)³, et American Invitational Mathematics Examination 2024 (AIME 2024) (MAA, 2024). En plus des tests de référence standard, nous utilisons LLM comme jury pour évaluer la performance de nos modèles sur des tâches génératives ouvertes. Plus précisément, nous suivons les configurations originales d'AlpacaEval 2.0 (Dubois et al., 2024) et d'Arena-Hard (Li et al., 2024), qui utilisent GPT-4-Turbo-1106 comme jury pour les comparaisons par paires. Ici, nous ne fournissons que les résumés finaux pour l'évaluation afin d'éviter tout biais de longueur. Pour les modèles de distillation, nous présentons des résultats représentatifs sur AIME 2024, MATH-500, GPQA Diamond, Codeforces et LiveCodeBench.

Conseils d'évaluation Suivant la configuration de DeepSeek-V3, les benchmarks standards tels que MMLU, DROP, GPQA Diamond, et SimpleQA sont évalués en utilisant les invites du cadre simple-evals. Pour MMLU-Redux, nous utilisons le format d'invite Zero-Eval (Lin, 2024) dans le cadre de l'échantillon zéro. Pour MMLU-Pro, C-Eval et CLUE-WSC, étant donné que les invites originales étaient sous-échantillonnées, nous avons légèrement modifié les invites pour les adapter au cadre de l'échantillon zéro. L'utilisation de CoT dans quelques échantillons peut nuire aux performances de DeepSeek-R1. Les autres ensembles de données suivent le protocole d'évaluation original avec les conseils par défaut fournis par leurs créateurs. Pour l'évaluation comparative du code et des mathématiques, l'ensemble de données HumanEval-Mul couvre huit langages de programmation majeurs (Python, Java, C++, C#, JavaScript, TypeScript, PHP et Bash). Les performances du modèle sur LiveCodeBench sont évaluées à l'aide du format CoT, avec des données collectées entre août 2024 et janvier 2025. L'ensemble de données Codeforces a été évalué à l'aide de questions provenant de 10 concours Div.2 ainsi que de cas de test produits par des experts, puis les notes et les pourcentages attendus des concurrents ont été calculés. Les résultats de la validation SWE-Bench ont été obtenus par le biais d'un cadre sans agent (Xia et al., 2024). Les repères liés à AIDER ont été mesurés en utilisant le format " diff ", et la sortie de DeepSeek-R1 a été plafonnée à 32 768 tokens par repère.

ligne de base (dans les levés géodésiques) Nous avons effectué des évaluations complètes par rapport à plusieurs bases puissantes, notamment DeepSeek-V3, Claude-Sonnet-3.5-1022, GPT-40-0513, OpenAI-01-mini et OpenAI-01-1217. En raison des difficultés d'accès à l'API OpenAI-01-1217 en Chine continentale, nous présentons ses performances sur la base des rapports officiels. nous présentons ses performances sur la base des rapports officiels. Pour le modèle de distillation, nous avons également comparé le modèle open source QwQ-32B-Preview (Qwen, 2024a).

Générer des paramètres Pour tous nos modèles, la longueur maximale de la génération est fixée à 32 768 jetons. Pour les repères qui nécessitent un échantillonnage, nous utilisons une température de 0,6, une valeur top-p de 0,95 et générons 64 réponses pour chaque requête afin d'estimer pass@1.

3.1 Évaluation de DeepSeek-R1

Pour les benchmarks de connaissances orientés vers l'éducation tels que MMLU, MMLU-Pro et GPQA Diamond, DeepSeek-R1 démontre une performance supérieure à DeepSeek-V3. Cette amélioration est principalement attribuée à une plus grande précision dans les problèmes liés aux STEM, où des gains significatifs sont réalisés grâce à l'apprentissage par renforcement (RL) à grande échelle. En outre, DeepSeek-R1 obtient de bons résultats avec FRAMES, une longue tâche d'assurance qualité dépendant du contexte, ce qui démontre ses fortes capacités d'analyse de documents. Cela met en évidence le potentiel des modèles d'inférence dans les tâches de recherche et d'analyse de données pilotées par l'IA. Sur le benchmark factuel SimpleQA, DeepSeek-R1 surpasse DeepSeek-V3, démontrant sa capacité à traiter des requêtes basées sur des faits. Une tendance similaire a été observée lorsque OpenAI-01 a surpassé GPT-40 dans ce benchmark. Cependant, DeepSeek-R1 n'est pas aussi performant que DeepSeek-V3 sur le benchmark chinois SimpleQA, principalement en raison de sa tendance à refuser de répondre à certaines requêtes après un RL sécurisé. En l'absence d'un RL sécurisé, DeepSeek-R1 peut atteindre une précision supérieure à 70%.

Tableau 4 - Comparaison entre DeepSeek-R1 et d'autres modèles représentatifs.

DeepSeek-R1 a également obtenu des résultats impressionnants à l'IF-Eval, un test de référence conçu pour évaluer la capacité d'un modèle à suivre des instructions de format. Ces améliorations peuvent être liées aux données relatives au respect des instructions incluses dans les étapes finales du réglage fin supervisé (SFT) et de la formation RL. En outre, des performances supérieures ont été observées sur AlpacaEval2.0 et ArenaHard, démontrant que DeepSeek-R1 a un avantage dans les tâches d'écriture et de réponse à des questions dans un domaine ouvert. Ses performances nettement supérieures à celles de DeepSeek-V3 mettent en évidence les avantages de la généralisation du RL à grande échelle, qui améliore non seulement l'inférence mais aussi les performances dans de multiples domaines. En outre, DeepSeek-R1 génère des résumés concis, et la moyenne sur ArenaHard jeton de 689 caractères et une moyenne de 2 218 caractères sur AlpacaEval 2.0. Cela indique que DeepSeek-R1 évite d'introduire un biais de longueur lors de l'évaluation basée sur le GPT, ce qui renforce encore sa robustesse dans de multiples tâches.

Pour les tâches mathématiques, les performances de DeepSeek-R1 sont comparables à celles d'OpenAI-01-1217 et dépassent largement celles des autres modèles. Une tendance similaire est observée dans les tâches d'algorithme de codage telles que LiveCodeBench et Codeforces, où les modèles centrés sur l'inférence dominent ces benchmarks. Pour les tâches de codage orientées ingénierie, OpenAI-01-1217 surpasse DeepSeek-R1 sur Aider, mais atteint des performances comparables sur SWE Verified. Nous pensons que les performances de DeepSeek-R1 pour les tâches d'ingénierie seront améliorées dans la prochaine version, car la quantité de données d'entraînement RL pertinentes est encore très limitée à ce stade.

3.2 Évaluation de la modélisation de la distillation

Tableau 5 - Comparaison du modèle de distillation DeepSeek-R1 avec d'autres modèles comparables sur le test de référence de la corrélation d'inférence.

Comme le montre le tableau 5, le simple fait de distiller les résultats de DeepSeek-R1 permet à DeepSeek-R1-7B (c'est-à-dire DeepSeek-R1-Distill-Qwen-7B, ci-après dénommé par ce nom) de surpasser les modèles de non-inférence tels que GPT-40-0513 à tous les égards. DeepSeek-R1-14B surpasse QwQ-32B-Preview dans toutes les mesures d'évaluation, tandis que DeepSeek-R1-32B et DeepSeek-R1-70B surpassent de manière significative o1-mini dans la plupart des repères. Ces résultats démontrent le fort potentiel de la distillation. En outre, nous constatons que l'application de RL à ces modèles de distillation permet d'obtenir des gains supplémentaires significatifs. Nous pensons que cela vaut la peine d'être exploré plus avant, et c'est pourquoi nous ne présentons ici que les résultats pour le modèle de distillation SFT simple.

4. discussion

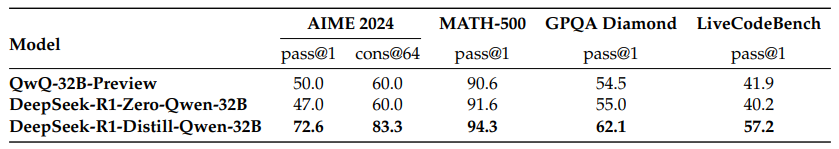

4.1 Distillation et apprentissage intensif

Tableau 6 - Comparaison entre le modèle de distillation et le modèle RL sur le benchmark de corrélation d'inférence.

Dans la section 3.2, nous pouvons voir qu'en distillant DeepSeek-R1, les petits modèles peuvent obtenir des résultats impressionnants. Cependant, une question demeure : peut-on entraîner des modèles avec le RL à grande échelle discuté dans cet article (sans distillation) pour obtenir des performances comparables ?

Pour répondre à cette question, nous avons effectué un entraînement RL à grande échelle de Qwen-32B-Base en utilisant des mathématiques, du code et des données STEM pour plus de 10 000 étapes, ce qui a donné DeepSeek-R1-Zero-Qwen-32B. Les résultats expérimentaux (présentés dans la figure 6) montrent que le modèle de base de 32B, après un entraînement RL à grande échelle, atteint des performances comparables à celles du modèle de base de Qwen-32B, et ce à un niveau comparable. QwQ-32B-Preview à un niveau comparable. Cependant, DeepSeek-R1-Distill-Qwen-32B, qui est distillé à partir de DeepSeek-R1, surpasse de manière significative DeepSeek-R1-Zero-Qwen-32B dans tous les benchmarks. Nous pouvons donc tirer deux conclusions : premièrement, la distillation du modèle le plus puissant dans un modèle plus petit produit d'excellents résultats, alors que les modèles plus petits qui s'appuient sur un entraînement RL à grande échelle sont plus efficaces. tandis que les modèles plus petits qui reposent sur les RL à grande échelle mentionnés dans cet article nécessitent une puissance de calcul énorme et peuvent même ne pas atteindre les performances de la distillation. Deuxièmement, si la stratégie de distillation est à la fois rentable et efficace, des modèles sous-jacents plus puissants et un apprentissage par renforcement à plus grande échelle peuvent encore être nécessaires pour dépasser les limites de l'intelligence.

4.2 Tentatives infructueuses

Au cours des premières phases de développement de DeepSeek-R1, nous avons également rencontré des échecs et des revers. Nous partageons nos échecs ici pour donner un aperçu, mais cela ne signifie pas que ces méthodes sont incapables de développer des modèles d'inférence efficaces.

Modélisation de la récompense des processus (PRM) La PRM est un moyen judicieux de guider les modèles afin qu'ils adoptent de meilleures méthodes pour résoudre les tâches de raisonnement (Lightman et al., 2023 ; Uesato et al., 2022 ; Wang et al., 2023). Dans la pratique, cependant, trois limitations principales de la MPR peuvent entraver son succès final. Premièrement, il est difficile de définir explicitement des étapes fines dans un raisonnement général. Deuxièmement, il est difficile de déterminer si l'étape intermédiaire actuelle est correcte. L'annotation automatique à l'aide de modèles peut ne pas produire de résultats satisfaisants, tandis que l'annotation manuelle n'est pas propice à la mise à l'échelle. Troisièmement, une fois que la MPR basée sur un modèle est introduite, elle conduit inévitablement à un piratage de la récompense (Gao et al., 2022), et le recyclage du modèle de récompense nécessite des ressources de formation supplémentaires, ce qui peut compliquer le processus de formation dans son ensemble. En résumé, bien que la MPR démontre une bonne capacité à réorganiser les réponses top-N générées par le modèle ou à aider à la recherche guidée (Snell et al., 2024), ses avantages sont limités par rapport à la surcharge de calcul supplémentaire introduite lors de l'apprentissage par renforcement à grande échelle dans nos expériences.

Monte Carlo Tree Search (MCTS) Inspirés par AlphaGo (Silver et al., 2017b) et AlphaZero (Silver et al., 2017a), nous avons exploré l'utilisation de Monte Carlo Tree Search (MCTS) pour améliorer l'évolutivité du calcul au moment du test. Cette approche consiste à décomposer la réponse en parties plus petites pour permettre au modèle d'explorer systématiquement l'espace des solutions. Pour ce faire, nous invitons le modèle à générer plusieurs étiquettes qui correspondent à des étapes d'inférence spécifiques nécessaires à la recherche. Pour la formation, nous utilisons d'abord les indices collectés pour trouver des réponses par le biais d'un MCTS guidé par un modèle de valeur pré-entraîné. Ensuite, nous utilisons les paires question-réponse générées pour entraîner le modèle d'acteur et le modèle de valeur, améliorant ainsi le processus de manière itérative.

Toutefois, cette approche se heurte à plusieurs difficultés lorsqu'il s'agit d'étendre la formation. Tout d'abord, contrairement aux échecs où l'espace de recherche est relativement bien défini, la génération de jetons présente un espace de recherche exponentiellement plus grand. Pour résoudre ce problème, nous avons fixé une limite maximale d'expansion pour chaque nœud, mais le modèle risque alors de tomber dans un optimum local. Deuxièmement, le modèle de valeur affecte directement la qualité de la génération car il guide chaque étape du processus de recherche. L'apprentissage d'un modèle de valeur à grain fin est intrinsèquement difficile, ce qui complique l'amélioration itérative du modèle. Alors que le succès d'AlphaGo repose sur l'apprentissage de modèles de valeur pour améliorer progressivement ses performances, le principe est difficile à reproduire dans notre contexte en raison de la complexité de la génération de marqueurs.

En conclusion, si les SCTM peuvent améliorer les performances lors de l'inférence lorsqu'ils sont associés à des modèles de valeur pré-entraînés, l'amélioration itérative des performances des modèles lors de la recherche autonome reste un défi difficile à relever.

5. conclusions, limites et travaux futurs

DeepSeek-R1-Zero représente une approche RL pure qui ne s'appuie pas sur des données de démarrage à froid et obtient d'excellentes performances dans une variété de tâches. DeepSeek-R1 est encore plus puissant dans la mesure où il utilise des données de démarrage à froid et un réglage RL itératif. En fin de compte, DeepSeek-R1 atteint des performances comparables à celles d'OpenAI-01-1217 dans une variété de tâches.

Nous avons exploré plus avant la distillation du pouvoir de raisonnement dans de petits modèles denses. Nous avons utilisé DeepSeek-R1 comme modèle professeur pour générer 800 000 données et avons affiné plusieurs petits modèles denses. Les résultats sont prometteurs : le modèle DeepSeek-R1-Distill-Qwen-1.5B surpasse le GPT-40 et Claude-3.5-Sonnet dans le test d'évaluation des performances en mathématiques, avec un score AIME de 28,91 TP3T et un score MATH de 83,91 TP3T. Les autres modèles denses obtiennent également des résultats impressionnants, nettement meilleurs que les autres modèles de réglage fin des instructions basés sur les mêmes points de contrôle sous-jacents.

À l'avenir, nous prévoyons d'étudier DeepSeek-R1 dans les domaines suivants :

- Capacités génériques : actuellement, DeepSeek-R1 est moins performant que DeepSeek-V3 dans des tâches telles que les appels de fonction, les dialogues à plusieurs tours, les jeux de rôle complexes et les sorties json.

- Mélange de langues : DeepSeek-R1 est actuellement optimisé pour le chinois et l'anglais, ce qui peut entraîner des problèmes de mélange de langues lors du traitement de requêtes dans d'autres langues. Par exemple, DeepSeek-R1 peut raisonner et répondre en anglais même si la requête est formulée dans une langue autre que l'anglais ou le chinois. Nous avons l'intention de remédier à cette limitation dans une prochaine mise à jour.

- Ingénierie des indices : lors de l'évaluation de DeepSeek-R1, nous avons constaté qu'il était sensible aux indices. Les indices avec moins d'échantillons dégradent systématiquement ses performances. Par conséquent, nous recommandons aux utilisateurs de décrire le problème directement et de spécifier le format de sortie en utilisant le paramètre d'échantillonnage zéro pour obtenir les meilleurs résultats.

- Tâches de génie logiciel : Le RL à grande échelle n'a pas été largement appliqué aux tâches de génie logiciel en raison du long temps d'évaluation, qui affecte l'efficacité du processus RL. En conséquence, DeepSeek-R1 n'a pas encore montré une énorme amélioration de la performance sur les repères de génie logiciel par rapport à DeepSeek-V3. Les prochaines versions s'attaqueront à ce problème en mettant en œuvre l'échantillonnage par rejet sur les données d'ingénierie logicielle ou en fusionnant les évaluations asynchrones dans le processus RL afin d'améliorer l'efficacité.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...