La popularité de Cursor explose, mais Cursor n'est pas la solution pour la programmation domestique de l'IA

En 2021, Microsoft a lancé GitHub Copilot, qui est devenu l'outil d'IA le plus recherché dans le monde de la programmation.

GitHub Copilot peut générer automatiquement des fonctions de code complètes sur la base des informations contextuelles fournies par l'utilisateur, telles que les noms de fonctions, les commentaires, les extraits de code, etc.

Ce qui le rend si étonnant, c'est l'accès sous-jacent au modèle Codex de l'OpenAI, qui a une taille de paramètre de 12 milliards et qui est une première version de GPT-3, optimisée spécifiquement pour les tâches de codage. C'est la première fois qu'un modèle à grands paramètres basé sur l'architecture Transformer a réellement "émergé" dans le domaine du code.

GitHub Copilot a suscité une passion pour la programmation de l'IA chez les développeurs du monde entier, et quatre étudiants du MIT se sont réunis avec le rêve de changer le développement de logiciels pour créer une entreprise appelée Anysphere en 2022.

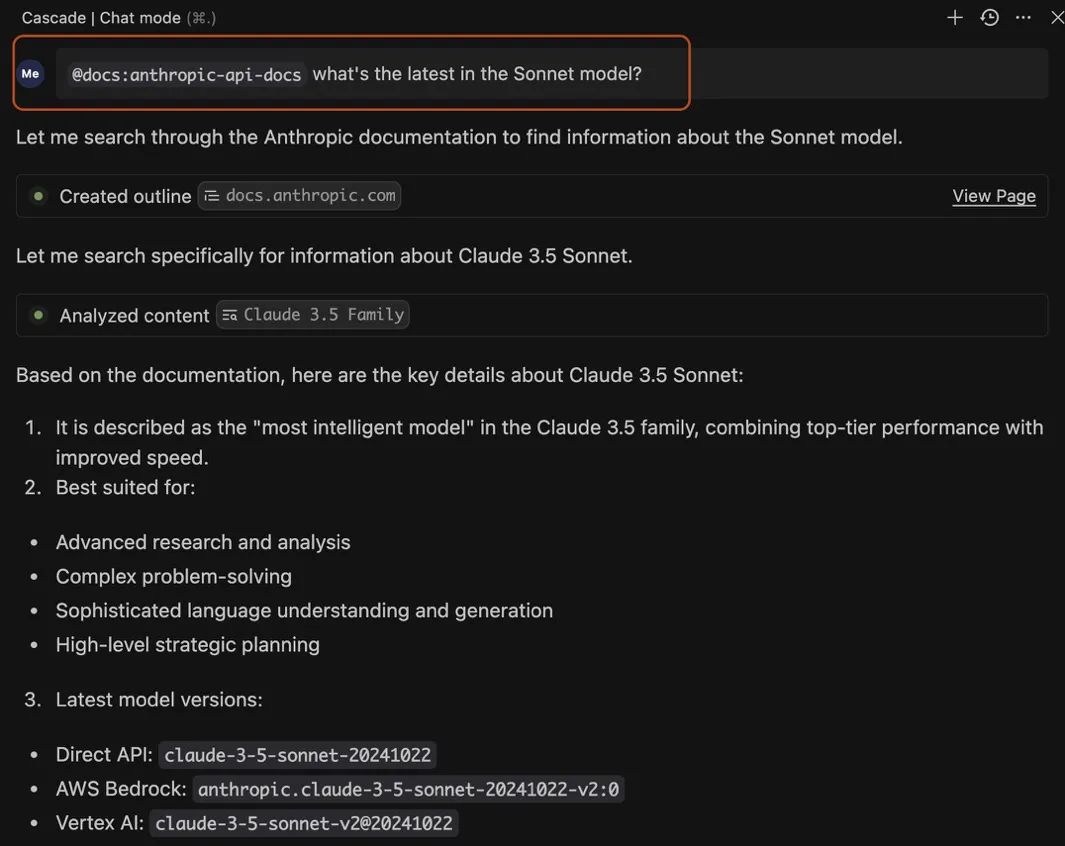

Le cofondateur d'Anysphere, Michael Truell, a clairement indiqué que si Visual Studio Code de Microsoft domine le marché des IDE, Anysphere considère qu'il est possible d'offrir un produit différent. Anysphere a saisi l'occasion d'offrir un produit différent.

Michael Truell (à droite)

Microsoft n'aurait peut-être pas imaginé qu'en moins de trois ans, cette équipe peu connue lancerait une lourde "bombe" dans l'industrie, déclenchant une nouvelle vague de fièvre de programmation de l'IA dans le monde, et que l'entreprise ferait également un bond pour devenir une licorne avec une évaluation de 2,5 milliards de dollars en quatre mois.

1) Qu'est-ce qui fait le succès de Cursor ?

En août 2024, Andrej Karpathy, ancien directeur de l'IA chez Tesla, a envoyé plusieurs tweets sur X faisant l'éloge d'un éditeur de code appelé Cursor, affirmant qu'il avait écrasé GitHub Copilot.

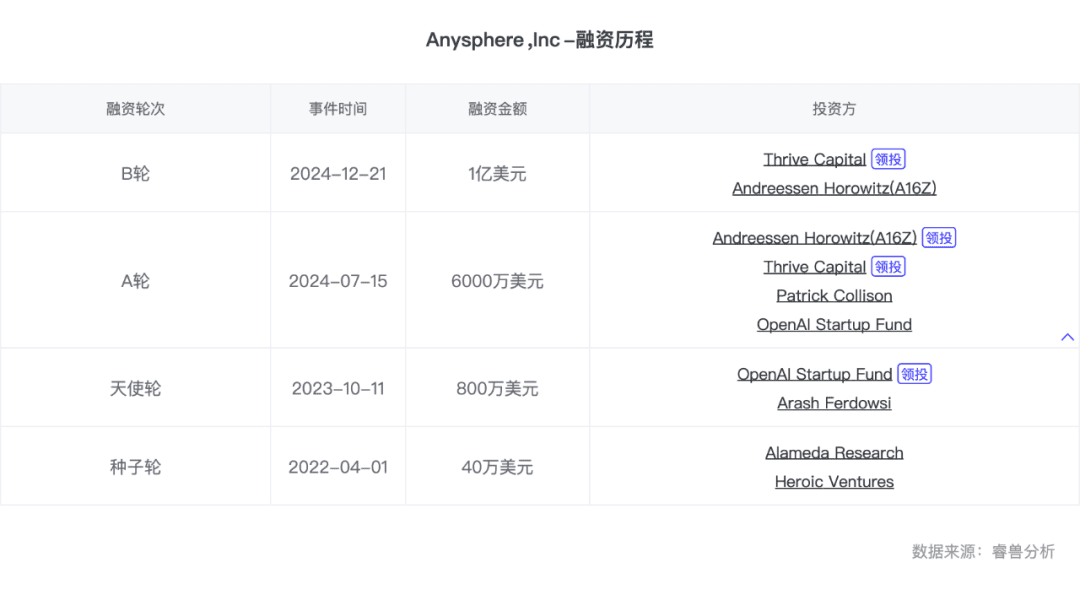

Le même mois, Anysphere, la société à l'origine de Cursor, a clôturé un tour de table de série A de 60 millions de dollars, pour une valorisation de 400 millions de dollars.

Les fonctionnalités étonnantes de Cursor comprennent l'édition multiligne, la complétion contextuelle entre fichiers, la remise en question, la prédiction de l'action suivante, et bien plus encore. Les développeurs peuvent simplement continuer à appuyer sur la touche Tab pour automatiser les modifications de code dans l'ensemble du fichier, et les résultats de Cursor sont plus précis et plus rapides, avec peu ou pas de latence perçue.

Quiconque connaît un tant soit peu la programmation sait à quel point cela est profond.

L'achèvement et la prédiction entre plusieurs fichiers est une exigence très subtile que les développeurs eux-mêmes peuvent avoir du mal à exprimer avec précision, mais qui est très "cool" lorsqu'on l'utilise réellement.

Tom Yedwab, un développeur avec des dizaines d'années d'expérience, a également écrit pour partager que la fonction de complétion des onglets est celle qui correspond le mieux à ses habitudes de codage quotidiennes et qui lui fait gagner le plus de temps. "C'est comme si l'outil lisait dans mon esprit et prédisait ce que je vais faire ensuite, ce qui me permet de me concentrer moins sur les détails du code et plus sur la construction de l'architecture globale". écrit Tom Yedwab.

La clé du succès de Cursor ne réside pas tant dans les obstacles techniques élevés que dans le fait qu'ils ont été les premiers à identifier un nouveau besoin subtil et qu'ils ont osé parier sur une voie qui n'avait jamais été empruntée auparavant.

Cursor est un parasite de VS Code, Visual Studio Code, un éditeur de code multiplateforme gratuit et open-source développé par Microsoft avec quelques fonctionnalités de base de complétion de code.

Auparavant, les développeurs créaient toutes sortes de plug-ins pour étendre les limites fonctionnelles de VS Code, mais le mécanisme de plug-in de VS Code lui-même présente de nombreuses limites. Par exemple, lorsqu'il s'agit de grands projets, certains plug-ins peuvent ralentir l'indexation et l'analyse du code ; pour certains plug-ins complexes, le processus de configuration est plus lourd, obligeant les utilisateurs à modifier manuellement le fichier de configuration, ce qui augmente invariablement le seuil d'utilisation.

Par conséquent, afin d'éliminer ces limitations, l'équipe de Cursor a adopté une approche très audacieuse, elle n'a pas suivi la manière traditionnelle de faire des plug-ins sur VS Code, mais a "magiquement changé" le code de VS Code, compatible avec un certain nombre de modèles d'IA dans le fond, et grâce à beaucoup d'optimisation d'ingénierie, améliorer l'expérience de l'utilisateur de l'ensemble de l'IDE.

Au début du développement de Cursor, de nombreux praticiens, y compris lui-même, ne sont pas optimistes quant à la difficulté de cette voie, qui fait l'objet d'un énorme "non-consensus". L'architecture interne de VS Code est complexe, impliquant l'édition de code, l'analyse syntaxique, l'indexation de code, le système de plug-in et d'autres modules, et il peut y avoir des différences entre les différentes versions de VS Code, le processus "magique" devant tenir compte de la compatibilité. La compatibilité doit être prise en compte dans le processus de "modification magique". En outre, lorsque plusieurs modèles d'IA sont intégrés dans VS Code, il est nécessaire de résoudre les problèmes d'interaction entre le modèle et l'éditeur, par exemple : comment transmettre efficacement le contexte du code au modèle ? Comment traiter les résultats du modèle et les appliquer au code ? Et comment minimiser la latence dans la génération du code ?

La résolution d'une série de problèmes implique un système lourd d'optimisation de l'ingénierie. Au cours de la seule année 2023, Cursor a fait l'objet de trois mises à jour majeures et de près de 40 itérations de fonctionnalités.C'est une grande épreuve de patience pour toute l'équipe de R&D et les investisseurs qui soutiennent l'entreprise.

En fin de compte, la Silicon Valley a une fois de plus prouvé au monde sa capacité à produire des innovations perturbatrices. Le succès de Cursor est un modèle entrepreneurial très classique de la Silicon Valley : un groupe de geeks technologiques paranoïaques, avec une grande vision, soutenu par le système de capital-risque mature de la Silicon Valley pour percer dans le no man's land, avec en toile de fond d'innombrables défis pour être le premier à manger du crabe, et finalement compter sur le produit pour faire un coup d'éclat.

"C'est ce qu'il y a de fascinant dans l'esprit d'entreprise : un projet aussi simple à mettre en œuvre et qu'ils ont mené à bien.

Récemment, Anysphere a annoncé la clôture d'un cycle de financement de série B de 100 millions de dollars et a été évaluée à 2,6 milliards de dollars. Sacra estime le chiffre d'affaires annuel récurrent de Cursor à 65 millions de dollars en novembre 2024, soit une augmentation de 64 001 TP3T d'une année sur l'autre. Et depuis sa création en 2022, Anysphere ne compte que 12 personnes.

2. le copilote est clair, l'agent est confus

Cursor n'est pas le premier produit à sortir de l'anneau du circuit de programmation de l'IA.

En mars 2024, le "premier programmeur d'IA au monde", présenté comme le Devin est sorti de nulle part et a déclenché pour la première fois la passion de l'industrie pour la programmation de l'IA.

Devin est un agent autonome doté de compétences complètes lui permettant d'apprendre par lui-même, de créer et de déployer des applications de bout en bout, de corriger les bogues et même d'entraîner et d'affiner ses propres modèles d'IA. L'entreprise qui l'a conçu, Cognition AI, est également une "équipe de rêve" de l'IA.

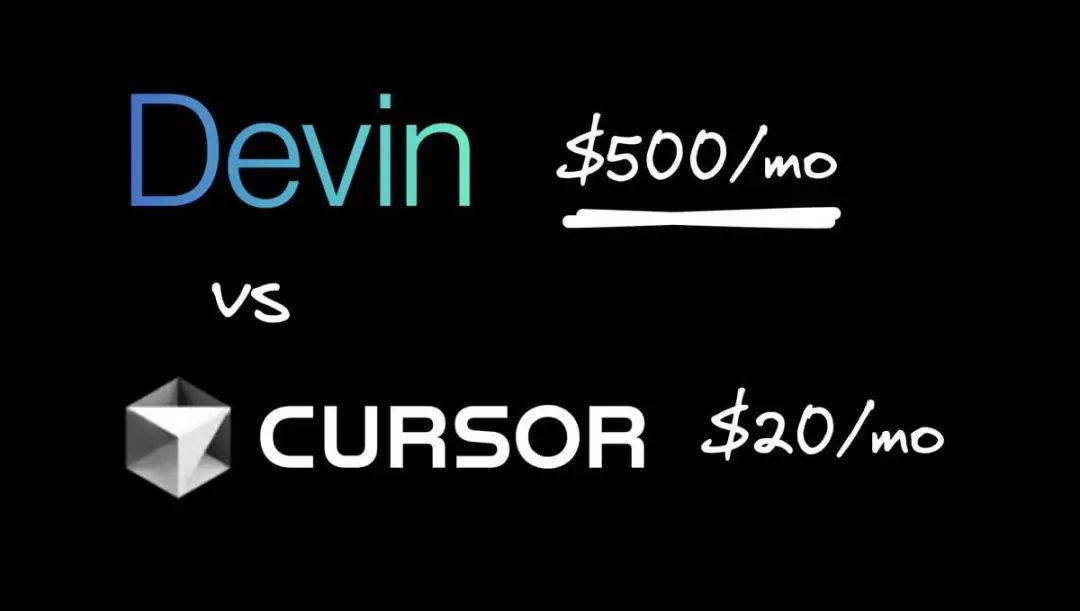

Cependant, Devin a d'abord été publié en tant que démo et les développeurs n'ont pas pu mettre la main dessus. Ce n'est que le 11 décembre 2024 que Devin a été mis en service, moyennant un abonnement mensuel de 500 dollars. En comparaison, l'abonnement mensuel de 20 dollars de Cursor semble même plus abordable.

Contrairement au favori universel de Cursor, les avis des développeurs sur Devin sont controversés. Certains pensent que Devin est excellent dans la gestion de la migration du code et la génération de PR (Pull Requests, demandes de modification du code soumises par les développeurs au cours de la collaboration pour révision et fusion par d'autres membres de l'équipe), ce qui peut réduire de manière significative le travail répétitif des développeurs ; cependant, certains utilisateurs soulignent que Devin nécessite encore beaucoup d'interventions manuelles lorsqu'il s'agit de traiter des logiques d'entreprise complexes. Toutefois, certains utilisateurs soulignent que Devin nécessite encore beaucoup d'interventions manuelles lorsqu'il s'agit de traiter une logique métier complexe, en particulier lorsque le projet n'est pas suffisamment documenté ou que la qualité du code est médiocre.

La raison fondamentale de la différence de "popularité" entre Cursor et Devin est la différence de taux d'échec et de coût de l'échec pour les développeurs qui utilisent le produit.

À l'heure actuelle, le taux d'échec du scénario Copilote est relativement faible et la précision de la mesure HumanEval correspondante converge vers 100%, tandis que la précision de la mesure SWE correspondante pour le scénario Agent est actuellement inférieure à 60%.

En outre, les résultats du travail de l'IA doivent être acceptés et confirmés par l'homme, et la méthode d'interaction des produits de type Copilote détermine que le coût pour le développeur de visualiser les résultats générés par l'IA est très faible, et que le coût pour l'utilisateur de les modifier ou de ne pas les adopter en cas d'échec est également très faible. En revanche, pour les produits de type agent, le coût de confirmation pour l'utilisateur est nettement plus élevé que pour le copilote, et le coût de modification après un échec est également plus élevé.

Les deux orientations de Cursor et Devin reflètent aussi largement l'état actuel des formes de produits Copilot et Agent dans les scénarios génériques.

Cursor est l'abréviation de Copilot et exige que l'IA et les humains travaillent en synchronisation, les humains dirigeant et l'IA assistant.

Pour l'instant, c'est Copilot qui gère réellement le CMR.Copilot peut être parasité par des IDE tels que VS Code, sous la forme de plug-ins, aidant les développeurs humains à réaliser toutes sortes d'actions de codage, et après l'émergence de GitHub Copilot, les utilisateurs se sont progressivement habitués à la forme de collaboration dans Copilot, et l'émergence de GPT-3.5, Copilot de la démo est devenu un véritable produit utilisable.

Cependant, j'ai écrit sur les "préoccupations cachées" des produits Copilot. "Le véritable fossé est VS Code, qui est passé d'un simple éditeur à une plateforme. La raison pour laquelle les utilisateurs peuvent facilement migrer de GitHub Copilot à Cursor est qu'ils sont tous deux parasités par VS Code, et que les habitudes, l'expérience et les fonctionnalités/plugins de l'utilisateur sont tous exactement les mêmes. C'est ce que les grands modèles obtiennent et qui fait déjà partie du modèle".

Devin est un représentant de la forme Agent, qui exige que l'IA travaille de manière asynchrone avec les humains, et que l'IA ait plus d'initiative pour prendre certaines décisions et les exécuter de manière autonome.

L'agent est une opportunité pour les entrepreneurs. Mais il n'est pas convaincu par la vision globale de l'agent que défend Devin, le"Tout faire, c'est ne rien faire, et la valeur des applications d'agents dans des domaines de niche est beaucoup plus élevée.

Cependant, comme le concept d'agent est encore très jeune et que tout le monde l'explore, l'environnement parasitaire de l'agent et les limites de ses capacités ne sont pas encore clairs, et il y a des gens qui entrent dans le domaine dans les directions de la génération de code, de l'achèvement du code, de la génération de tests unitaires et de la détection des défauts.

Gru a choisi de commencer par les tests unitaires. Avant de lancer officiellement le produit, Gru a également connu une période d'essais et d'erreurs en interne, la génération automatique de documents, la correction de bogues, les tests E2E et d'autres directions ont été essayés, mais limités par les capacités du modèle, l'itération et la maintenance du logiciel et d'autres points douloureux ne peuvent pas être avancés.

Finalement, Gru a découvert que les tests unitaires étaient un besoin courant, mais non négligeable. De nombreux développeurs n'aiment pas écrire des tests unitaires parce qu'ils sont ennuyeux. En outre, pour les projets moins exigeants, les tests unitaires ne sont pas une condition nécessaire à l'ingénierie logicielle. Cependant, Gru pense que du point de vue des capacités techniques, l'atterrissage d'un produit d'IA doit résoudre le problème de la cohérence entre le contexte commercial et le contexte technique, les tests unitaires étant les moins dépendants des deux contextes, mais aussi les plus pertinents pour les capacités du modèle actuel du lien.

Cependant.Que le copilote ou l'agent soit un moyen plutôt qu'une fin, ils ne sont pas "l'un ou l'autre", mais coexistent et résolvent des problèmes différents.

Pour de nombreux développeurs individuels et certaines petites et moyennes entreprises, des produits génériques tels que Cursor ou certains modèles open-source peuvent suffire à répondre à la plupart des besoins ; cependant, pour de nombreuses grandes entreprises et des scénarios commerciaux complexes dans différents domaines, il est difficile de répondre aux besoins simplement par une forme de "copilote" ou d'"agent" de produits génériques, ce qui exige des fournisseurs de technologie qu'ils disposent de capacités de services spécifiques plus solides. Toutefois, pour de nombreuses grandes entreprises et des scénarios commerciaux complexes dans différents domaines, il est difficile de satisfaire la demande au moyen d'un produit générique sous la forme d'un "copilote" ou d'un "agent", ce qui exige des fournisseurs de technologie qu'ils disposent de capacités de service plus solides dans le domaine en question.

C'est dans ce dernier domaine que les entreprises nationales de programmation de l'IA ont des opportunités à saisir.

3. les opportunités domestiques se situent dans les secteurs verticaux

En 2024, la programmation de l'IA est sans aucun doute l'une des orientations les plus chaudes de la Silicon Valley, avec des licornes telles que Cursor, Poolside, Cognition, Magic, Codeium, Replit et d'autres déjà en activité.

En revanche, les fabricants nationaux d'Internet et les grands fabricants de modèles ont essentiellement lancé leurs propres "modèles de code", mais il y a très peu de start-ups bien développées. Selon Silicon Star People, l'année dernière, Qiji Chuangtan a investi dans six start-ups dans le domaine de la programmation de l'IA, et depuis lors, presque toutes ont été éliminées, tandis que l'année dernière, plus de 10 équipes basées sur le code qui avaient brièvement fait surface, la plupart d'entre elles se sont déjà retirées du domaine cette année.

Après l'émergence de ChatGPT, Clearstream Capital a examiné des dizaines de projets dans le domaine de la programmation de l'IA, mais le seul à avoir finalement franchi le pas est Silicon Heart Technology ("aiXcoder" en abrégé).

En ce qui concerne les projets nationaux de programmation de l'IA, nombreux sont ceux qui estiment que le produit est rendu plus "superficiel". "Certains développeurs de la communauté se plaignent que de nombreux produits génèrent désormais du code pendant quelques minutes, mais qu'ils doivent passer une demi-journée ou plus à le déboguer".

Sous l'apparence "superficielle" du produit se cache une différence environnementale qui s'est développée au fil des ans sur les marchés 2B des États-Unis et de la Chine.. L'analyse des raisons est la suivante : aux États-Unis, le groupe des jeunes programmeurs est énorme et le coût de la main-d'œuvre est plus élevé ; l'introduction de produits d'IA peut aider les entreprises à réduire considérablement leurs coûts ; le marché SaaS des États-Unis a été géré par le modèle PLG, la volonté de l'entreprise de payer pour des produits à usage général est plus forte ; et la voie de sortie du marché 2B étranger est claire, la volonté des investisseurs d'investir est forte, et la logique du premier niveau du marché pour reprendre l'entreprise est également très claire, les investisseurs providentiels sont très nombreux et très actifs. Les startups peuvent presque toujours obtenir un premier tour de table pour valider leurs idées.

En septembre 2024, Gru a lancé Gru.ai et s'est classé premier dans l'évaluation vérifiée swe-bench publiée par OpenAI avec un score élevé de 45,2%. Il était clair que le fait d'avoir un produit rendait l'entreprise plus acceptable dans la Silicon Valley.

Et pour le marché national du côté B, le problème classique persiste. "Il est plus difficile de faire du B to B en Chine, la chaîne de vente est plus longue et, en fin de compte, ceux qui peuvent payer la facture sont encore principalement les grandes entreprises, mais parfois les grandes entreprises ne sont pas celles qui achèteront si votre produit est bon. "De nombreuses entreprises ont un grand nombre d'exigences de conformité en matière de sécurité interne, par exemple, en raison de préoccupations concernant le risque de fuite d'informations, ne peuvent pas utiliser le nuage pour appeler le produit, la nécessité d'outils de code déployés localement."

Par conséquent, les entreprises nationales de programmation de l'IA doivent mettre les deux pieds dans le plat pour résoudre des problèmes spécifiques dans divers secteurs.

"Le modèle devrait prendre en compte la continuité des activités dans le processus d'atterrissage réel, le modèle de code national à partir des résultats de l'évaluation des performances est amélioré, mais dans des scénarios d'application spécifiques, il est nécessaire d'analyser des scénarios spécifiques." Précédemment, après avoir communiqué avec une entreprise de fabrication industrielle, il a été constaté que le langage utilisé dans certains systèmes logiciels dans des scénarios industriels n'est pas le langage commun python ou C++, mais certains outils de codage spécifiques à l'industrie, ce qui oblige les fournisseurs de technologie à procéder à des ajustements ciblés de leurs produits.

Il ne s'agit pas d'une demande propre aux scénarios industriels ; chaque industrie a ses propres caractéristiques et chaque entreprise a une logique commerciale et un système d'ingénierie spécifiques, ce qui exige des entreprises de programmation de l'IA qu'elles aient des capacités de service plus fortes et spécifiques à leur domaine.

Après avoir étudié des dizaines d'entreprises, il a été constaté que "pour tous les types de besoins en matière de développement de logiciels, les fonctions de programmation de l'IA comprennent au moins une série de tâches telles que la recherche, la détection et la réparation des défauts, et les tests, en plus de la génération de code" ;Outre la fonctionnalité, il est également nécessaire de réfléchir à la manière d'intégrer ces capacités à la logique commerciale du client, afin que le modèle ait une connaissance plus approfondie du domaine, ce qui est en fait une exigence élevée".

Par conséquent, Clearstream Capital est plus favorable à l'idée d'un couplage profond des modèles et des produits avec les connaissances privées internes, les données et les cadres de développement de logiciels au sein de l'organisation, et a investi dans aiXcoder en septembre 2023.

"Dans ce besoin avéré, aiXcoder est l'équipe la plus compatible sur le plan technique et commercial. En même temps, un certain nombre de membres clés de l'équipe commerciale de l'entreprise ont plus de dix ans d'expérience dans la vente aux clients Big B nationaux et internationaux, et ont une connaissance approfondie des clients et du marché. Ils ont proposé une solution d'atterrissage par "domainisation" au deuxième trimestre 2023, c'est-à-dire la stratégie selon laquelle la programmation de l'IA devrait être profondément associée aux connaissances privées internes, aux données et aux cadres de développement de logiciels au sein de l'entreprise, ce qui a également été reconnu par un grand nombre de grandes entreprises clientes en termes de résultats d'atterrissage réels du projet."

Incubé à l'Institut de génie logiciel de l'Université de Pékin, aiXcoder est la première équipe au monde à appliquer la technologie de l'apprentissage profond à la génération et à la compréhension du code, ainsi que la première équipe à appliquer l'apprentissage profond aux produits de programmation. L'équipe a publié plus de 100 articles dans des revues et conférences internationales de premier plan, dont beaucoup sont les premiers articles et les plus cités dans le domaine de l'ingénierie logicielle intelligente.

Le partenaire commercial et président d'aiXcoder a déclaré que, face aux scénarios de déploiement privé B-end, parce que le grand modèle général n'a pas appris les données du domaine privé, le modèle n'intègre pas en profondeur les exigences commerciales internes de l'entreprise, les spécifications de l'industrie, le cadre de développement logiciel et l'environnement opérationnel, et n'incorpore pas les connaissances de base du domaine de l'entreprise telles que l'analyse des exigences et les documents de conception dans la formation au modèle, ce qui entraîne un manque de pertinence ou de fiabilité du code généré ou complété au niveau de la logique d'entreprise. niveau de la logique d'entreprise manque de pertinence et de fiabilité.

Il en résulte que la précision et la facilité d'utilisation des grands modèles dans les applications d'entreprise sont inférieures aux attentes. "De nombreux grands modèles fonctionnent admirablement dans des scénarios génériques ou des ensembles d'évaluation courants, avec une précision allant jusqu'à 301 TP3T, mais lorsqu'ils sont déployés en interne dans l'entreprise, la précision chute généralement à moins de 101 TP3T.Les moyens conventionnels de mise au point sont également difficiles à mettre en œuvre pour atteindre les résultats souhaités par l'entreprise.Par conséquent, l'apprentissage et la maîtrise de la connaissance du domaine sont la clé d'une mise en œuvre réussie des systèmes de programmation de l'IA dans l'entreprise. Par conséquent, l'apprentissage et la maîtrise des connaissances du "domaine" sont la clé d'une mise en œuvre réussie des systèmes de programmation de l'IA dans les entreprises. C'est en résolvant les problèmes spécifiques à un domaine pour les entreprises clientes que nous nous différencions.

Pour résoudre les problèmes susmentionnés, aiXcoder propose une formation incrémentale ciblée basée sur une variété de données internes fournies par l'entreprise - y compris le code, les documents commerciaux, les documents d'exigences, les documents de conception, les documents de test, ainsi que la terminologie commerciale de l'industrie et les spécifications de processus, les normes et spécifications techniques de l'industrie, les piles technologiques de l'entreprise et les cadres de programmation, ainsi que d'autres connaissances du domaine. . En plus de la formation au modèle, il est également combiné à des outils de développement de logiciels multi-agents, RAG, et à un "système d'invite technique" qui s'adapte au cadre de développement de logiciels de l'entreprise, de manière à améliorer la qualité de la génération de code et la capacité de l'ensemble du processus de recherche et de développement.

Sous forme de livraison.Les solutions basées sur les domaines ne sont pas les mêmes que les projets traditionnels hautement personnalisés.aiXcoder extraira les capacités et les outils ayant une valeur commune des besoins individuels des clients et formera des produits et des processus standardisés à fournir aux clients ; en même temps, aiXcoder maintient une communication très fréquente avec les clients par le biais de réunions régulières, non seulement en aidant les clients à résoudre des problèmes cycliques, mais aussi en continuant à itérer les produits sur la base des besoins communs et réels des clients.

4) L'industrie de l'IA a trop souvent crié au loup.

Du point de vue des résultats, qu'il s'agisse d'un petit B ou d'un grand B, d'un "modèle de formation" ou d'un "modèle sans formation", d'un copilote ou d'un agent, il n'y a peut-être pas de réponse optimale, tout doit être basé sur les besoins réels des clients, ainsi que sur ceux de l'équipe entrepreneuriale. Il se peut qu'il n'y ait pas de réponse optimale.

Quelle que soit la voie qu'elles empruntent, les entreprises de programmation de l'IA ont un objectif simple et direct : améliorer l'efficacité du développement de logiciels. Cependant, le marché actuel n'en est qu'à ses débuts, et les entreprises de programmation de l'IA ont un objectif simple et direct : améliorer l'efficacité du développement de logiciels.Canaliser correctement la demande des clients est un problème pour tout nouvel entrant sur le marché..

La plus grande difficulté actuelle est de faire en sorte que les clients reconnaissent la valeur des agents segmentés."Même dans la Silicon Valley, la première réaction de nombreux clients potentiels lorsqu'ils entendent parler d'un nouveau produit d'IA est l'interrogation, et non l'excitation.. Pour l'instant, Gru consacre beaucoup d'énergie à aller à la rencontre des clients et à développer le bouche-à-oreille auprès des utilisateurs initiaux, ce qui constituera la base d'une commercialisation à grande échelle par la suite.

Sur le marché intérieur, la demande de systèmes de programmation d'IA doit également clarifier les limites de ses propres besoins et de ses capacités de modélisation. "Actuellement, les systèmes de programmation de l'IA basés sur les grands modèles ont un avenir prometteur en ce qui concerne l'amélioration de la productivité des logiciels. "Pour vraiment tirer parti de la valeur de cette technologie dans un environnement d'entreprise, il est nécessaire de combiner en profondeur le grand modèle de code avec la connaissance du domaine propre à l'entreprise, et de l'itérer et de le valider en permanence dans des scénarios commerciaux spécifiques."

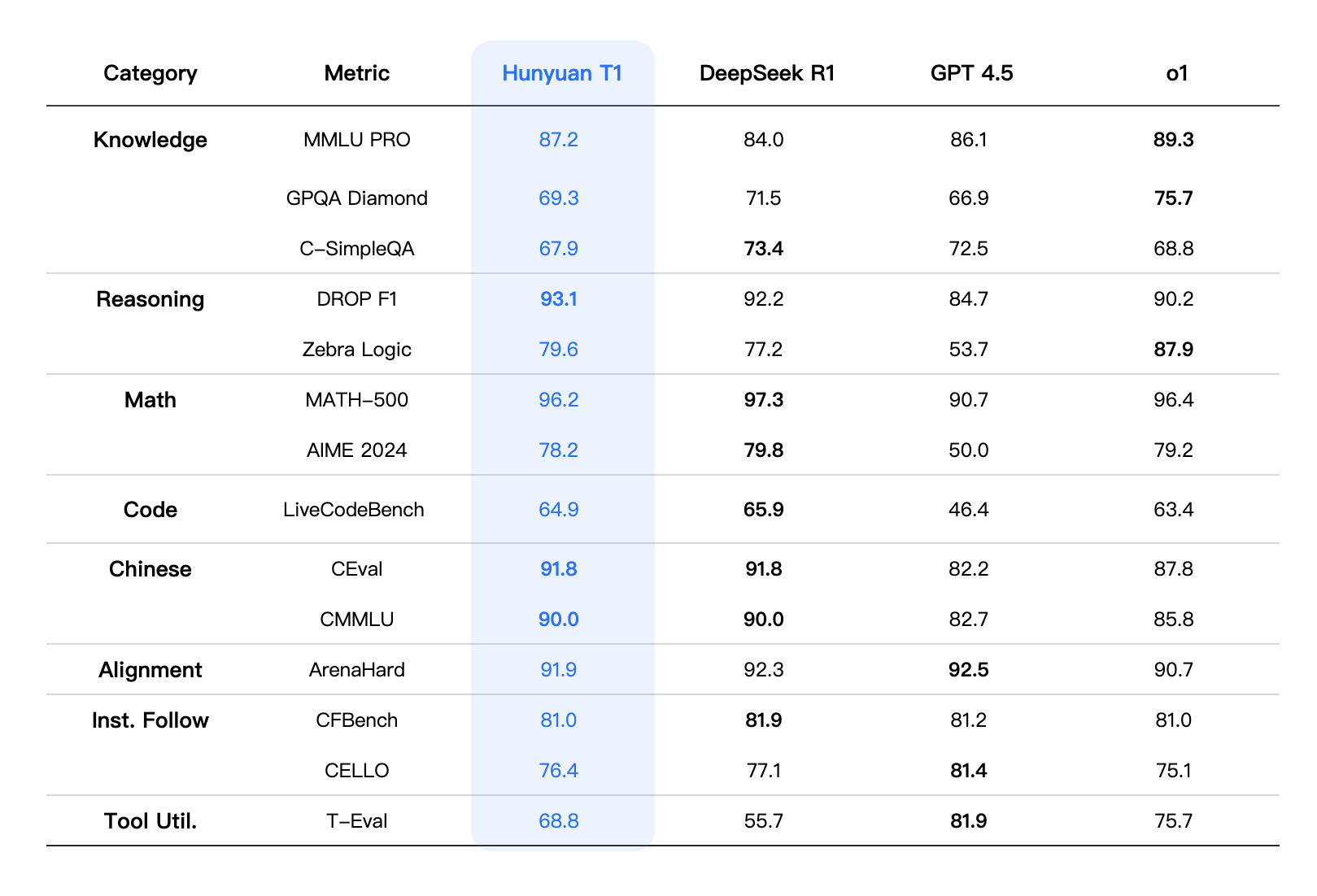

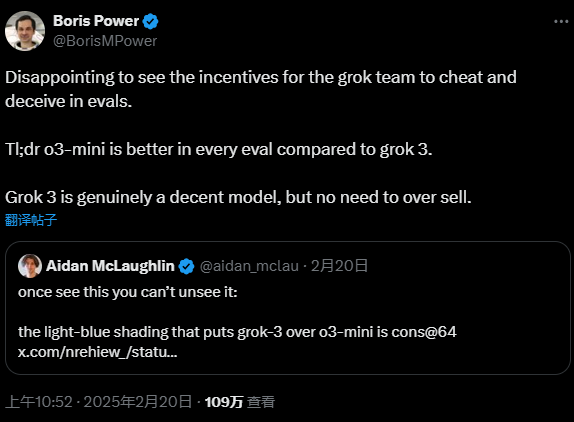

En effet.Les grands modèles ont évolué au point que le sentiment du marché est largement revenu à la rationalité, mais le bruit est toujours là.L'année 2024, par exemple, est une année au cours de laquelle les grands modèles d'informations sur les offres sont monnaie courante, mais certaines données peuvent être "trompeuses". Par exemple, en 2024, les grands modèles d'informations sur les appels d'offres sont monnaie courante, mais certaines données sont susceptibles d'être "trompeuses".

"La division écologique du travail est plus claire dans les pays étrangers, mais de nombreux projets de TO B en Chine finissent par faire l'objet d'un appel d'offres, et de nombreuses entreprises s'arrachent les cheveux pour participer à l'appel d'offres." Toutefois, dans le domaine de la programmation de l'IA, à en juger par les informations relatives aux appels d'offres publics, même quelques grands fabricants n'ont pas obtenu beaucoup de commandes.

La raison en est queUn appel d'offres réussi n'équivaut pas à un modèle ou à un produit réussi sur le terrain..

D'une part, dans de nombreux cas, les acheteurs responsables de l'approvisionnement et de l'utilisation réelle du produit ne sont pas les mêmes, ce qui peut conduire à des décisions d'approvisionnement et à des besoins commerciaux réels des deux couches de la peau. D'autre part, ces débarquements s'appuient souvent sur des produits standardisés plus un réglage fin, et non sur les scénarios commerciaux de l'entreprise et la logique interne pour une formation et une adaptation approfondies au domaine, ce qui peut conduire les programmeurs dans l'utilisation du processus à constater que les résultats ne sont pas satisfaisants.

Un initié de l'industrie a révélé que la plupart des commandes sur le marché actuel des appels d'offres qui comprennent du matériel se chiffrent en millions, tandis que les commandes de logiciels purs, tels que le développement de logiciels intelligents, les assistants de code et d'autres projets, se situent pour la plupart dans une fourchette de 300 000 ou plus. De nombreuses entreprises constatent qu'elles ne peuvent pas résoudre le problème après l'achat et qu'elles ne peuvent que retourner sur le marché pour trouver un fabricant plus approprié, ce qui entraîne un gaspillage de ressources.

Toutefois, un certain consensus se dégage de cette déconstruction.De plus en plus d'entreprises se rendent compte que la tendance est de "découpler" les capacités des produits et des modèles.

Au cours du premier semestre 2024, lorsque les capacités des modèles se renforceront, les modèles convergeront en termes de programmation, et le produit ne devra plus être adapté aux capacités des modèles mais devra êtreRendre le produit "agnostique".. "À partir du premier semestre 2024, nous ne ferons plus d'optimisations spécifiques pour les différents modèles, mais nous améliorerons les capacités de notre architecture de produits, et n'importe quel modèle sur le marché pourra être branché tant qu'il passera nos tests de référence."

"Les entreprises clientes devraient accorder toute leur attention à la continuité de leurs activités et ne devraient pas être liées à un seul fournisseur de grands modèles. Actuellement, il est difficile de répondre véritablement aux besoins des entreprises en matière de grands modèles en achetant uniquement des produits standardisés. Les entreprises doivent parvenir à un découplage architectural en termes de grands modèles, de niveau de données, de domainisation et d'ingénierie, et choisir de manière flexible les modèles et les fournisseurs de services qui répondent le mieux à leurs besoins. Plus important encore, il est nécessaire de résoudre efficacement le problème réel de la domainisation du développement logiciel au sein de l'entreprise pour aider les entreprises à réduire leurs coûts et à gagner en efficacité."

Du point de vue d'un tiers de l'industrie, à l'avenir, l'accès au modèle n'est qu'une partie de l'atterrissage de l'industrie. "Il reste encore 100 km entre le modèle et l'application. Si les fournisseurs de technologie standardisent les capacités des 95-99 premiers kilomètres dans l'infrastructure, les 1-5 km restants peuvent être réalisés par l'application elle-même.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...