CosyVoice : projet open source de clonage de voix en 3 secondes lancé par Ali, avec prise en charge des étiquettes contrôlées par les émotions

Introduction générale

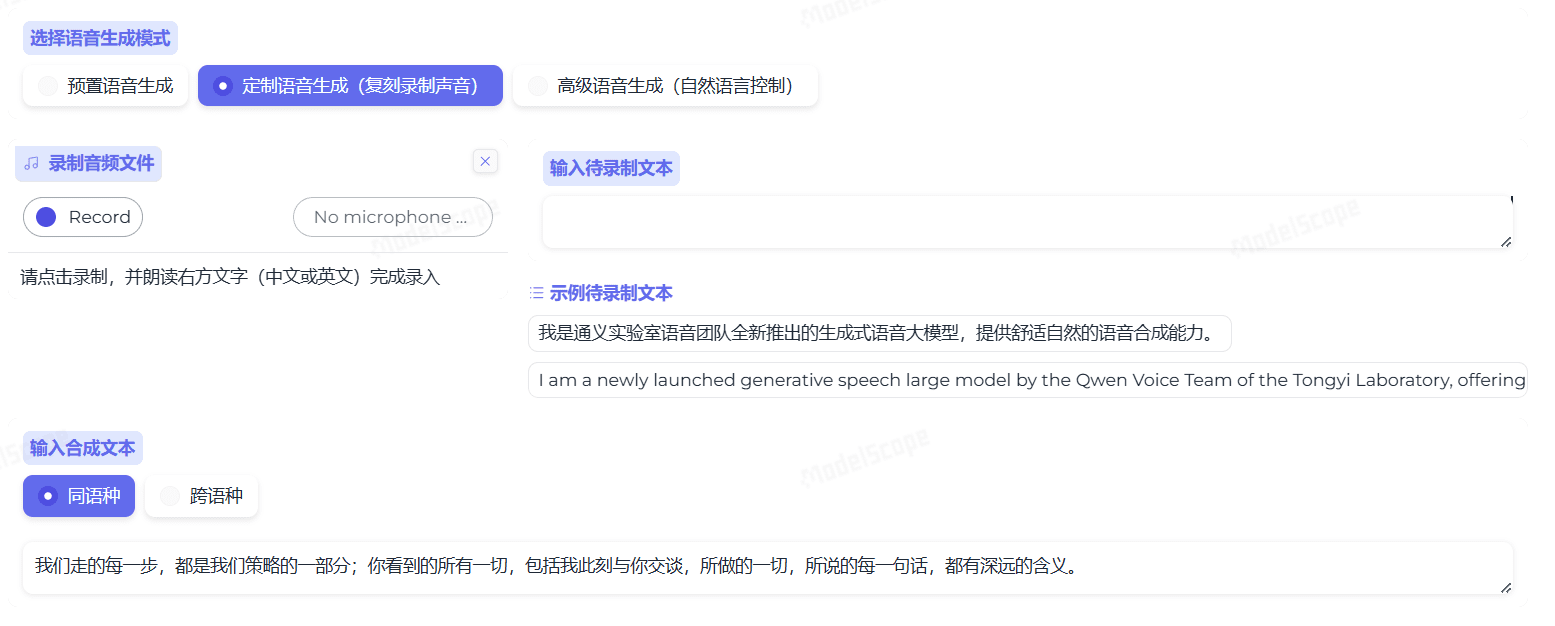

CosyVoice est un modèle de génération de parole multilingue à grande échelle qui offre des capacités complètes, de l'inférence au déploiement en passant par l'entraînement. Développé par l'équipe FunAudioLLM, il vise à réaliser une synthèse vocale de haute qualité grâce à des transformateurs autorégressifs avancés et des modèles de diffusion basés sur l'EDO. CosyVoice prend non seulement en charge la génération vocale multilingue, mais réalise également le contrôle des émotions et la synthèse du cantonais à un niveau comparable à celui de la prononciation humaine.

Expérience en ligne gratuite (synthèse vocale) : https://modelscope.cn/studios/iic/CosyVoice-300M

Expérience en ligne gratuite (synthèse vocale) : https://www.modelscope.cn/studios/iic/SenseVoice

Liste des fonctions

- Génération vocale multilingue : prend en charge la synthèse vocale dans plusieurs langues.

- Clonage de la parole : capacité à cloner les caractéristiques de la parole d'un locuteur spécifique.

- Synthèse vocale : convertir le contenu textuel en une parole naturelle et fluide.

- Contrôle des émotions : expression ajustable des émotions lors de la synthèse vocale.

- Synthèse en cantonais : permet de générer des discours en cantonais.

- Sortie audio de haute qualité : synthèse d'un son de haute fidélité via le vocodeur HiFTNet.

Utiliser l'aide

Processus d'installation

Récemment, Ali Tongyi Labs a mis en libre accès le modèle vocal CosyVoice, qui prend en charge la génération de la parole naturelle, le contrôle des langues, du timbre et des émotions, et qui excelle dans la génération de la parole en plusieurs langues, la génération de la parole sans échantillon, la synthèse sonore multilingue et les capacités d'exécution des commandes.

CosyVoice utilise un total de plus de 150 000 heures de formation de données pour prendre en charge la synthèse de cinq langues, le chinois, l'anglais, le japonais, le cantonais et le coréen, et l'effet de synthèse est nettement meilleur que les modèles de synthèse vocale traditionnels.

CosyVoice prend en charge le clonage de tonalités en une seule fois : seules 3 à 10 secondes d'audio brut sont nécessaires pour générer des tonalités analogiques, y compris des détails tels que le rythme et l'émotion. Il donne également de bons résultats dans la synthèse vocale inter-langues.

La version officielle ne prenant pas en charge les plateformes Windows et Mac pour le moment, nous avons cette fois déployé CosyVoice localement sur ces deux plateformes respectivement.

Plate-forme Windows

Il faut d'abord passer à la plate-forme Windows et cloner le projet :

git clone https://github.com/v3ucn/CosyVoice_For_Windows

Accès aux projets.

cd CosyVoice_For_Windows

Générer des modules intégrés :

git submodule update --init --recursive

Installez ensuite les dépendances :

conda create -n cosyvoice python=3.11

conda activate cosyvoice

pip install -r requirements.txt -i https://mirrors.aliyun.com/pypi/simple/ --trusted-host=mirrors.aliyun.com

La version officielle recommandée de Python est la 3.8. La 3.11 fonctionne réellement, et en théorie, la 3.11 est plus performante.

Téléchargez ensuite la version Windows de l'installateur deepspeed pour l'installer :

https://github.com/S95Sedan/Deepspeed-Windows/releases/tag/v14.0%2Bpy311

Enfin, installez la version gpu de la torche : le fichier

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

Ici, la version de cuda est sélectionnée comme 12, ou vous pouvez installer 11.

Le modèle a ensuite été téléchargé :

# git模型下载,请确保已安装git lfs

mkdir -p pretrained_models

git clone https://www.modelscope.cn/iic/CosyVoice-300M.git pretrained_models/CosyVoice-300M

git clone https://www.modelscope.cn/iic/CosyVoice-300M-SFT.git pretrained_models/CosyVoice-300M-SFT

git clone https://www.modelscope.cn/iic/CosyVoice-300M-Instruct.git pretrained_models/CosyVoice-300M-Instruct

git clone https://www.modelscope.cn/speech_tts/speech_kantts_ttsfrd.git pretrained_models/speech_kantts_ttsfrd

Il est très rapide car il utilise l'entrepôt de Magic Hitch en Chine.

Enfin, ajoutez les variables d'environnement :

set PYTHONPATH=third_party/AcademiCodec;third_party/Matcha-TTS

Utilisation de base :

from cosyvoice.cli.cosyvoice import CosyVoice

from cosyvoice.utils.file_utils import load_wav

import torchaudio

cosyvoice = CosyVoice('speech_tts/CosyVoice-300M-SFT')

# sft usage

print(cosyvoice.list_avaliable_spks())

output = cosyvoice.inference_sft('你好,我是通义生成式语音大模型,请问有什么可以帮您的吗?', '中文女')

torchaudio.save('sft.wav', output['tts_speech'], 22050)

cosyvoice = CosyVoice('speech_tts/CosyVoice-300M')

# zero_shot usage

prompt_speech_16k = load_wav('zero_shot_prompt.wav', 16000)

output = cosyvoice.inference_zero_shot('收到好友从远方寄来的生日礼物,那份意外的惊喜与深深的祝福让我心中充满了甜蜜的快乐,笑容如花儿般绽放。', '希望你以后能够做的比我还好呦。', prompt_speech_16k)

torchaudio.save('zero_shot.wav', output['tts_speech'], 22050)

# cross_lingual usage

prompt_speech_16k = load_wav('cross_lingual_prompt.wav', 16000)

output = cosyvoice.inference_cross_lingual('<|en|>And then later on, fully acquiring that company. So keeping management in line, interest in line with the asset that\'s coming into the family is a reason why sometimes we don\'t buy the whole thing.', prompt_speech_16k)

torchaudio.save('cross_lingual.wav', output['tts_speech'], 22050)

cosyvoice = CosyVoice('speech_tts/CosyVoice-300M-Instruct')

# instruct usage

output = cosyvoice.inference_instruct('在面对挑战时,他展现了非凡的<strong>勇气</strong>与<strong>智慧</strong>。', '中文男', 'Theo \'Crimson\', is a fiery, passionate rebel leader. Fights with fervor for justice, but struggles with impulsiveness.')

torchaudio.save('instruct.wav', output['tts_speech'], 22050)

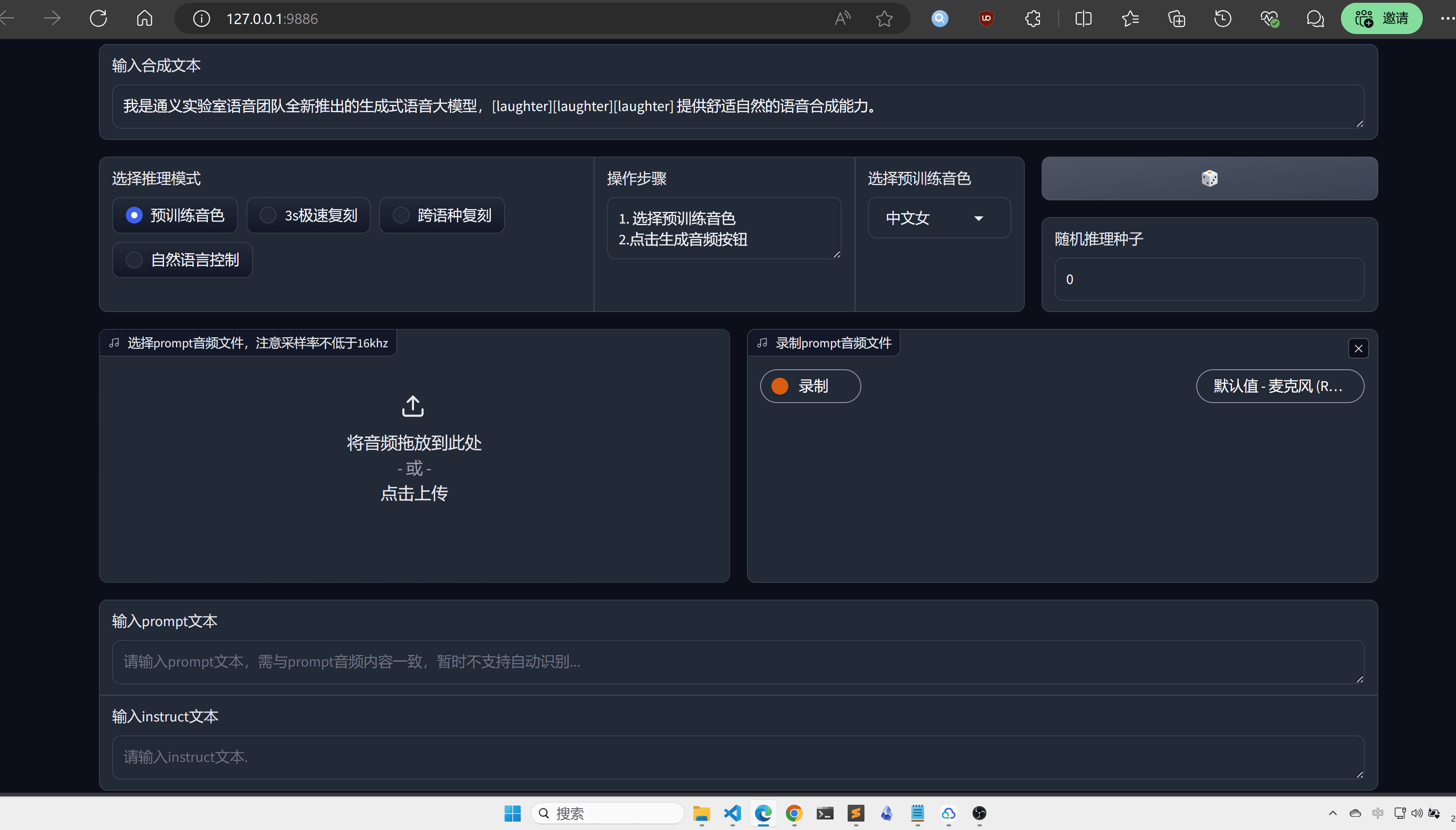

Webui est recommandé ici pour plus d'intuition et de commodité :

python3 webui.py --port 9886 --model_dir ./pretrained_models/CosyVoice-300M

Visitez le site http://localhost:9886

Notez que la version officielle de torch utilise sox pour le backend, ici il est remplacé par soundfile :

torchaudio.set_audio_backend('soundfile')

Il se peut qu'il y ait des bogues, alors restez à l'écoute des mises à jour officielles du projet à l'avenir.

Plate-forme MacOS

Pour la plateforme MacOs, il est préférable de cloner le projet en premier lieu :

git clone https://github.com/v3ucn/CosyVoice_for_MacOs.git

Installer la dépendance :

cd CosyVoice_for_MacOs

conda create -n cosyvoice python=3.8

conda activate cosyvoice

pip install -r requirements.txt -i https://mirrors.aliyun.com/pypi/simple/ --trusted-host=mirrors.aliyun.com

Ensuite, vous devez installer sox via Homebrew :

brew install sox

C'est donc configuré, mais n'oubliez pas d'ajouter des variables d'environnement :

export PYTHONPATH=third_party/AcademiCodec:third_party/Matcha-TTS

L'utilisation reste la même que pour la version Windows.

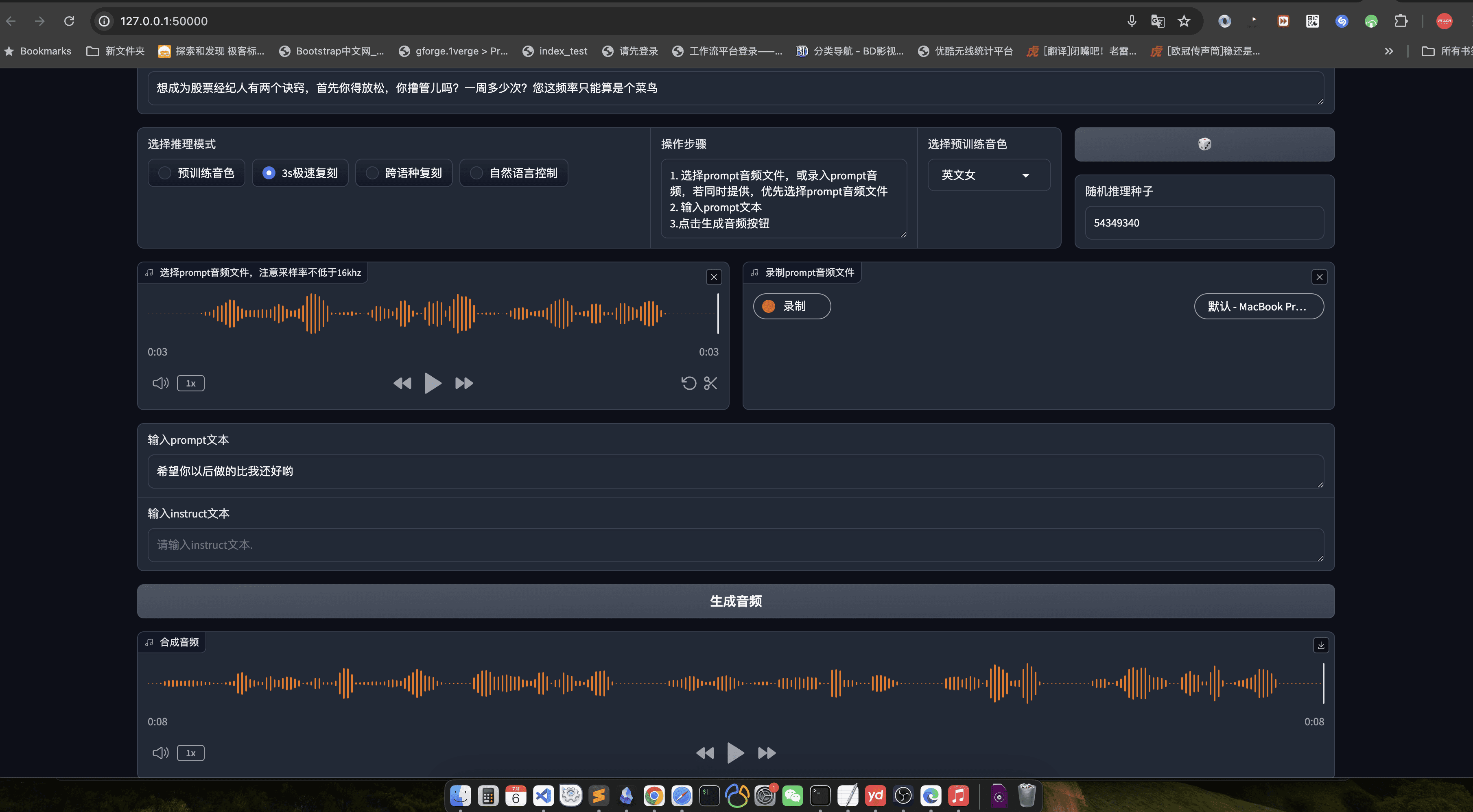

L'utilisation de l'interface web est toujours recommandée ici : l'interface

python3 webui.py --port 50000 --model_dir speech_tts/CosyVoice-300M

Visitez le site http://localhost:50000

remarques finales

En toute justice, CosyVoice mérite d'être une grande usine, la qualité du modèle n'est pas à dire, représentant le plus haut niveau de l'IA domestique, le nom de Tongyi Labs n'est pas faux, bien sûr, si vous pouvez également open source le code après l'ingénierie, ce serait mieux, je pense qu'après l'optimisation de la libtorch, ce modèle sera l'open source du TTS n'est pas un bon choix.

Processus d'utilisation

- génération de discours: :

- Préparez le fichier texte d'entrée (par exemple, input.txt) avec une phrase par ligne.

- Exécutez la commande suivante pour la génération de la parole :

python generate.py --input input.txt --output output/ - Les fichiers vocaux générés seront enregistrés dans le fichier

output/Catalogue.

- clonage de la parole: :

- Préparez un fichier d'échantillon de parole (par exemple, sample.wav) du locuteur cible.

- Exécutez la commande suivante pour le clonage vocal :

python clone.py --sample sample.wav --text input.txt --output output/ - Les fichiers vocaux clonés sont enregistrés dans le répertoire

output/Catalogue.

- le contrôle des émotions: :

- Les émotions peuvent être ajustées à l'aide de paramètres de ligne de commande lors de la génération du discours :

python generate.py --input input.txt --output output/ --emotion happy - Les émotions de soutien comprennent : la joie, la tristesse, la colère, la neutralité.

- Les émotions peuvent être ajustées à l'aide de paramètres de ligne de commande lors de la génération du discours :

- Synthèse en cantonais: :

- Préparez un fichier texte en cantonais (par exemple, cantonese_input.txt).

- Exécutez la commande suivante pour la génération de la parole en cantonais :

python generate.py --input cantonese_input.txt --output output/ --language cantonese - Les fichiers vocaux cantonais générés seront enregistrés dans le fichier

output/Catalogue.

Procédure d'utilisation détaillée

- Préparation du texte: :

- Assurez-vous que le fichier texte d'entrée est formaté correctement, une phrase par ligne.

- Le texte doit être aussi concis et clair que possible, en évitant les phrases complexes.

- Préparation de l'échantillon vocal: :

- Les échantillons de parole doivent être clairs, prononcés par une seule personne, avec le moins de bruit de fond possible.

- Il est recommandé que la durée de l'échantillon soit inférieure à 1 minute pour garantir un clonage optimal.

- paramétrage: :

- Ajustez les paramètres du discours généré, tels que l'émotion, la langue, etc.

- La personnalisation peut être réalisée en modifiant les fichiers de configuration ou les paramètres de la ligne de commande.

- Validation des résultats: :

- Les fichiers vocaux générés peuvent être écoutés à l'aide d'un lecteur audio.

- Si les résultats ne sont pas satisfaisants, le texte d'entrée ou les échantillons de parole peuvent être ajustés et régénérés.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...