AssemblyAI : Plate-forme d'analyse de haute précision de la parole au texte et de l'intelligence audio

Introduction générale

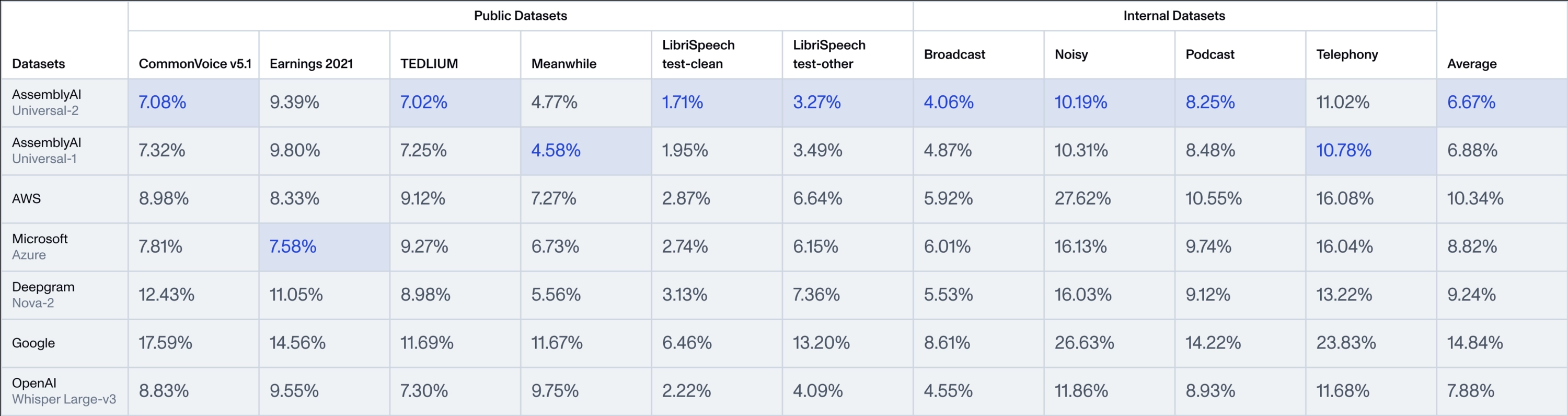

AssemblyAI est une plateforme axée sur la technologie de l'IA vocale, qui fournit aux développeurs et aux entreprises des outils efficaces d'analyse audio et de conversion de la parole au texte. Le point fort est la série de modèles Universal, en particulier le nouveau modèle Universal-2, qui est le modèle de synthèse vocale le plus avancé d'AssemblyAI à ce jour. Universal-2 s'appuie sur les fondations d'Universal-1, avec plus de 12,5 millions d'heures de données d'entraînement audio multilingues, et est capable de capturer avec précision la complexité des conversations réelles et de fournir des données audio de haute précision. Universal-2 s'appuie sur Universal-1, avec plus de 12,5 millions d'heures de données d'entraînement audio multilingues, pour saisir avec précision la complexité des dialogues réels et fournir des données audio d'une grande précision. Par rapport à Universal-1, Universal-2 améliore de 241 TP3T la reconnaissance des noms propres (par exemple, noms, marques), de 211 TP3T le contenu numérique-alphabétique mixte (par exemple, numéros de téléphone, boîtes aux lettres), et de 151 TP3T le formatage du texte (par exemple, ponctuation, majuscules), réduisant ainsi de manière significative la précision du "dernier kilomètre" du modèle traditionnel. "AssemblyAI met ces technologies de pointe à la disposition des utilisateurs du monde entier grâce à des API faciles à utiliser, et a été utilisé par Spotify, Fireflies et d'autres entreprises pour créer des produits vocaux intelligents couvrant des domaines tels que l'enregistrement de réunions et l'analyse de contenu.

Liste des fonctions

- de la parole au texteLe logiciel de conversion : convertit des fichiers audio ou des flux audio en direct en texte de haute précision, en prenant en charge plusieurs langues et plusieurs formats audio.

- Détection de l'orateurLes résultats de l'étude sont les suivants : identification automatique des différents locuteurs dans l'audio pour les scénarios de dialogue multi-personnes.

- Analyse des sentimentsLes services d'aide à la décision : Analyser les tendances émotionnelles dans le discours, telles que positives, négatives ou neutres, afin d'améliorer l'expérience de l'utilisateur.

- transcription en temps réelLa fonction de conversion de la parole en texte en temps réel à faible latence est adaptée aux agents vocaux ou au sous-titrage en direct.

- Modélisation de l'intelligence audioLe système d'information sur le contenu : Il comprend des fonctions avancées telles que l'examen du contenu, la détection des sujets, la recherche par mot-clé, etc.

- Cadre LeMURTraitement de textes transcrits à l'aide d'un modèle de langage à grande échelle, avec prise en charge de la génération de résumés, de questions-réponses, etc.

- Génération de sous-titresLa fonction d'exportation de fichiers de sous-titres au format SRT ou VTT facilite la création de contenu vidéo.

- Confidentialité des IPILes informations sensibles contenues dans les fichiers audio, telles que les noms ou les numéros de téléphone, sont automatiquement identifiées et bloquées.

Utiliser l'aide

AssemblyAI est un service API basé sur le cloud qui ne nécessite aucune installation locale pour utiliser ses puissantes fonctionnalités. Voici un guide détaillé pour vous aider à démarrer et à approfondir ses capacités.

Enregistrement et obtention de clés API

- Visiter le site officiel: Ouvrez votre navigateur et tapez

https://www.assemblyai.com/Accédez à la page d'accueil. - S'inscrire à un compteCliquez sur "S'inscrire" dans le coin supérieur droit et entrez votre adresse électronique et votre mot de passe pour terminer la procédure d'inscription. Après l'inscription, vous serez automatiquement connecté au tableau de bord.

- Obtenir la cléPour copier la clé, cliquez sur "Copier" dans la zone "Clé API" du tableau de bord. Il s'agit du seul justificatif d'identité permettant d'appeler l'API et il convient de le conserver précieusement.

- Essai gratuitCrédit gratuit pour les nouveaux utilisateurs, pas besoin de lier les méthodes de paiement immédiatement.

Fonction principale Fonctionnement

Le cœur d'AssemblyAI est son intégration API, et ce qui suit est un exemple d'utilisation de la famille de modèles Universal en Python. Vous pouvez également utiliser d'autres langages (par exemple Java, Node.js) en vous référant à la documentation sur le site web.

Synthèse vocale (Universal-2)

- préliminaireLa liste des fichiers audio peut être consultée à l'adresse suivante : Assurez-vous qu'il existe un fichier audio (par ex.

sample.mp3) ou un lien URL. - Installation du SDK: S'exécute dans le terminal :

pip install assemblyai

- exemple de code: :

import assemblyai as aai

aai.settings.api_key = "你的API密钥" # 替换为你的密钥

transcriber = aai.Transcriber()

transcript = transcriber.transcribe("sample.mp3")

print(transcript.text) # 输出文本,如“今天天气很好。”

- Universel-2 Points fortsLe modèle Universal-2 est utilisé par défaut. Il reconnaît les noms propres (par exemple "Zhang Wei") et les nombres formatés (par exemple "6 mars 2025") avec plus de précision que le modèle Universal-1, souvent en l'espace de quelques secondes. Le temps de traitement n'est généralement que de quelques secondes.

transcription en temps réel

- Scénarios applicablesLes services d'information et de communication de la Commission européenne sont les suivants : diffusion en direct, téléconférences et autres besoins en temps réel.

- exemple de code: :

from assemblyai import RealtimeTranscriber import asyncio async def on_data(data): print(data.text) # 实时输出文本 transcriber = RealtimeTranscriber( api_key="你的API密钥", sample_rate=16000, on_data=on_data ) async def start(): await transcriber.connect() await transcriber.stream() # 开始接收音频流 asyncio.run(start()) - flux de travailLa faible latence de l'Universal-2 garantit des résultats rapides et précis.

Détection de l'orateur

- Méthode d'habilitation: :

config = aai.TranscriptionConfig(speaker_labels=True) transcript = transcriber.transcribe("sample.mp3", config=config) for utterance in transcript.utterances: print(f"说话人 {utterance.speaker}: {utterance.text}") - Exemples de résultats: :

说话人 A: 你好,今天会议几点? 说话人 B: 下午两点。 - attirer l'attention sur qqch.L'Universal-2 est plus cohérent dans les conversations entre plusieurs personnes et réduit les confusions.

Analyse des sentiments

- Méthode d'habilitation: :

config = aai.TranscriptionConfig(sentiment_analysis=True) transcript = transcriber.transcribe("sample.mp3", config=config) for result in transcript.sentiment_analysis: print(f"文本: {result.text}, 情感: {result.sentiment}") - Exemples de résultats: :

文本: 我很喜欢这个产品, 情感: POSITIVE 文本: 服务有点慢, 情感: NEGATIVE

Génération de sous-titres

- code de fonctionnement: :

transcript = transcriber.transcribe("sample.mp3") with open("captions.srt", "w") as f: f.write(transcript.export_subtitles_srt()) - en fin de compte: Générer

.srtqui peut être directement importé dans un logiciel de montage vidéo.

Caractéristiques : LeMUR Framework

- Introduction à la fonctionLeMUR traite les résultats de la transcription en conjonction avec un grand modèle linguistique, par exemple pour générer des résumés.

- procédure: :

- Obtenir un identifiant de transcription :

transcript = transcriber.transcribe("sample.mp3") transcript_id = transcript.id - Générer un résumé :

from assemblyai import Lemur lemur = Lemur(api_key="你的API密钥") summary = lemur.summarize(transcript_id) print(summary.response) - Exemple de résultat : "L'avancement du projet a été discuté lors de la réunion et il est prévu qu'il soit achevé la semaine prochaine."

- Obtenir un identifiant de transcription :

mise en garde

- Formats pris en chargeCompatible avec 33 formats audio/vidéo tels que MP3, WAV, etc.

- Paramètres linguistiquesLes langues : plus de 99 langues sont prises en charge et sont accessibles par l'intermédiaire de

language_code="zh"Précisez le chinois. - facturationLes prix sont calculés sur la base de l'heure d'écoute, voir le site web officiel pour les prix.

En suivant ces étapes, vous pourrez tirer pleinement parti des puissantes fonctions de l'Universal-2 pour créer des applications vocales efficaces.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...