X-Dyna: Vídeo de generación de poses para hacer bailar las fotos de Missy

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 54.2K 00

Introducción general

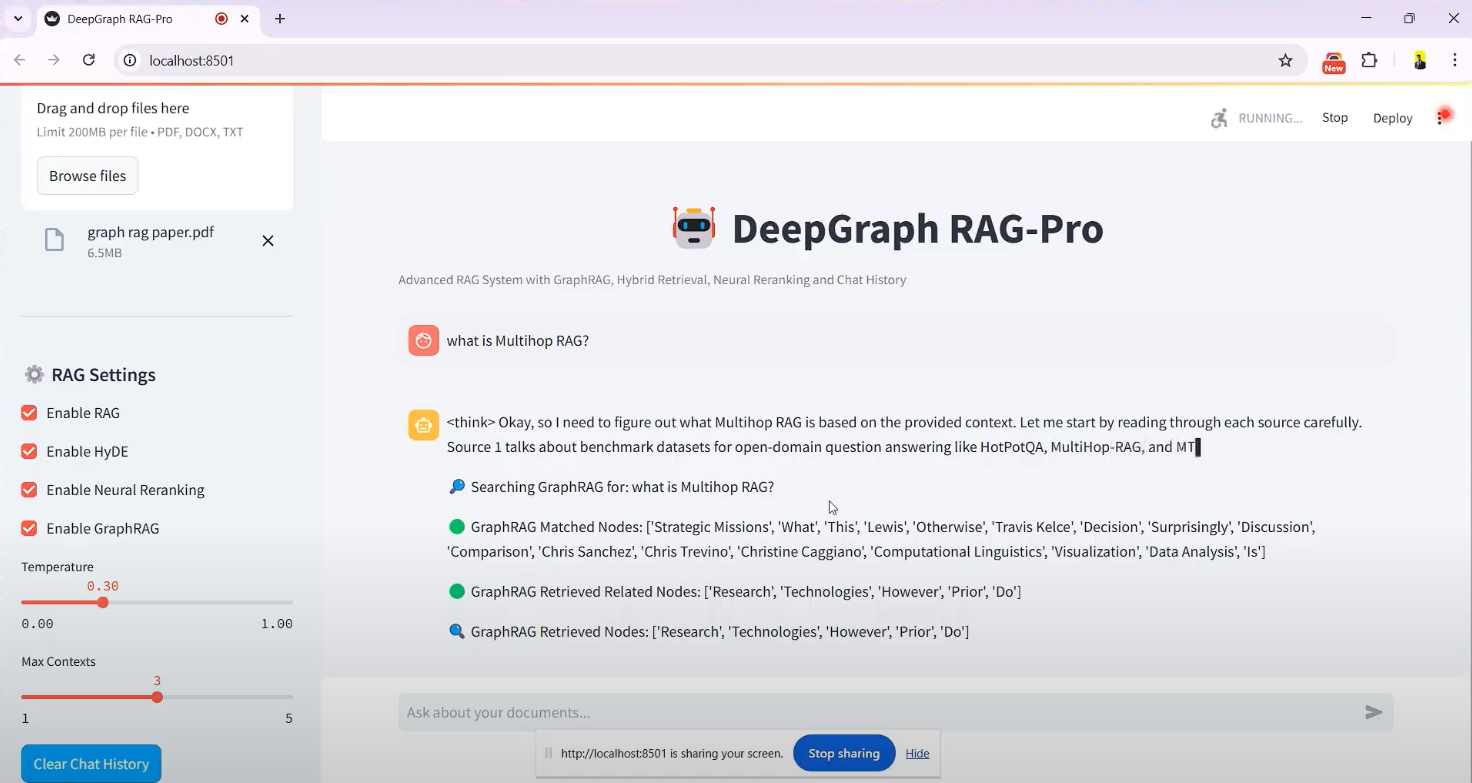

X-Dyna es un proyecto de código abierto desarrollado por ByteDance para generar animaciones dinámicas de retratos mediante técnicas de difusión de muestra cero. El proyecto utiliza expresiones faciales y movimientos corporales en el vídeo de conducción para animar imágenes de retratos individuales, generando animaciones realistas y conscientes del contexto. x-Dyna mejora la viveza y el detalle de las animaciones de vídeo de retratos introduciendo un módulo adaptador dinámico que integra a la perfección el contexto de apariencia de la imagen de referencia en la atención espacial de la red troncal de difusión.

Recomendación relacionada:StableAnimator: genera animaciones de vídeo de alta calidad que mantienen los rasgos del personaje. yDisPose: generación de vídeos con control preciso de la postura humana, creación de bailarinas yVídeo MOFA: la tecnología de adaptación del campo de movimiento convierte imágenes fijas en vídeo

Lista de funciones

- Generación de animaciones dinámicas de retratos: Genere animaciones dinámicas realistas de retratos utilizando expresiones faciales y movimientos corporales en el vídeo de accionamiento.

- Técnica de difusión de muestra cero: genera animaciones de alta calidad sin datos de preentrenamiento.

- Módulo adaptador dinámico: integración del contexto de la imagen de referencia para mejorar el detalle y la viveza de las animaciones.

- Transferencia de la expresión facial: captura la expresión facial mediante el módulo de control local para una transferencia precisa de la expresión.

- Códigos de evaluación: Proporcionan una variedad de métricas de evaluación (por ejemplo, DTFVD, Face-Cos, Face-Det, FID, etc.) para evaluar la calidad de la animación.

- Código y modelos de código abierto: se proporcionan el código de inferencia completo y los modelos preentrenados para facilitar su uso y el desarrollo secundario.

Utilizar la ayuda

Proceso de instalación

- Almacén de proyectos de clonación:

git clone https://github.com/bytedance/X-Dyna.git

cd X-Dyna

- Instale la dependencia:

pip install -r requirements.txt

- Instale el entorno PyTorch 2.0:

bash env_torch2_install.sh

Utilización

- Prepare la imagen de entrada y el vídeo de accionamiento:

- Imagen de entrada: Una sola imagen de retrato.

- Drive Video: un vídeo que contiene las expresiones faciales y los movimientos corporales del objetivo.

- Ejecuta el código de inferencia para generar la animación:

python inference_xdyna.py --input_image path_to_image --driving_video path_to_video

- Evalúe la calidad de la animación generada:

- La calidad de las animaciones generadas se evaluó utilizando el código de evaluación y el conjunto de datos proporcionados.

python evaluate.py --generated_video path_to_generated_video --metrics DTFVD,Face-Cos,Face-Det,FID

Flujo detallado de funcionamiento de las funciones

- Generación dinámica de animaciones de retratos::

- Seleccione una imagen de retrato estática como entrada.

- Seleccione un vídeo de accionamiento que contenga los movimientos y expresiones del objetivo.

- Ejecutar código de inferencia para generar animación dinámica de retrato.

- transferencia de la expresión facial::

- Capture expresiones faciales en vídeos de conducción mediante el módulo de control local.

- Transfiera la expresión capturada a la imagen de entrada para una animación precisa de la expresión.

- Módulo adaptador dinámico::

- El módulo adaptador dinámico integra perfectamente el contexto de apariencia de la imagen de referencia en la atención espacial de la red troncal de difusión.

- De este modo, la animación generada conserva más detalle y viveza.

- Código de evaluación::

- Se proporciona una variedad de métricas de evaluación (por ejemplo, DTFVD, Face-Cos, Face-Det, FID, etc.) para evaluar la calidad de las animaciones generadas.

- Los usuarios pueden evaluar completamente las animaciones generadas basándose en estas métricas.

- Código fuente abierto y modelización::

- El proyecto proporciona un código de inferencia completo y modelos preentrenados, que los usuarios pueden utilizar fácilmente para desarrollos secundarios y aplicaciones personalizadas.

Preguntas más frecuentes.

- La animación no es fluida: Intenta aumentar

num_mixo ajustesddim_steps. - desajuste en la expresión facial: Asegúrese de que la elección de

best_framecorresponde al fotograma del vídeo de accionamiento cuya expresión es más similar a la de la imagen de origen.

Uso avanzado.

- optimizar el rendimientoEl modelo LCM LoRA permite mejorar la velocidad de generación reduciendo el número de pasos de inferencia.

- Modelos personalizadosSi tiene necesidades específicas, puede modificar o ampliar el modelo siguiendo las instrucciones del LÉAME.

Siguiendo estos pasos, los usuarios pueden empezar fácilmente a utilizar X-Dyna para generar animaciones dinámicas de retratos de alta calidad y evaluar y optimizar completamente las animaciones generadas.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...