Implantación privada sin GPU locales DeepSeek-R1 32B

Tutoriales prácticos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 61.4K 00

con respecto a DeepSeek-R1 Para el uso diario de oficina, directamente en el sitio web oficial es la mejor opción, si usted tiene otras preocupaciones o necesidades especiales ... Debe ser utilizado en el Implantación local de DeepSeek-R1 (con el instalador de un solo clic)Los tutoriales sobre el blanco son perfectos para ti.

Si usted tiene un ordenador mal configurado, pero todavía quiere desplegar utilizando DeepSeek-R1 privado ... A continuación, considere el uso de GPUs libres, enseñó a todos hace siglos Implantación en línea del modelo de código abierto DeepSeek-R1 con potencia de GPU gratuitaSin embargo, hay un inconveniente fatal, es decir, la GPU libre sólo puede instalar 14B, la instalación de 32B será muy tarjeta, pero después de las pruebas sólo instalar DeepSeek-R1 32B o más calidad de salida para satisfacer las necesidades del trabajo diario.

Así que... Lo que vamos a hacer es instalar GPUs libres en el funcionamiento eficiente Versión cuantitativa de DeepSeek-R1 32B. ¡Ya viene!

En la GPU libre se puede hacer en la salida de 2 a 6 palabras por segundo (de acuerdo a la complejidad de la velocidad de salida del problema fluctúa), la desventaja de este método es que usted necesita para encender el servicio de vez en cuando.

equipo unsloth versión cuantificada DeepSeek-R1

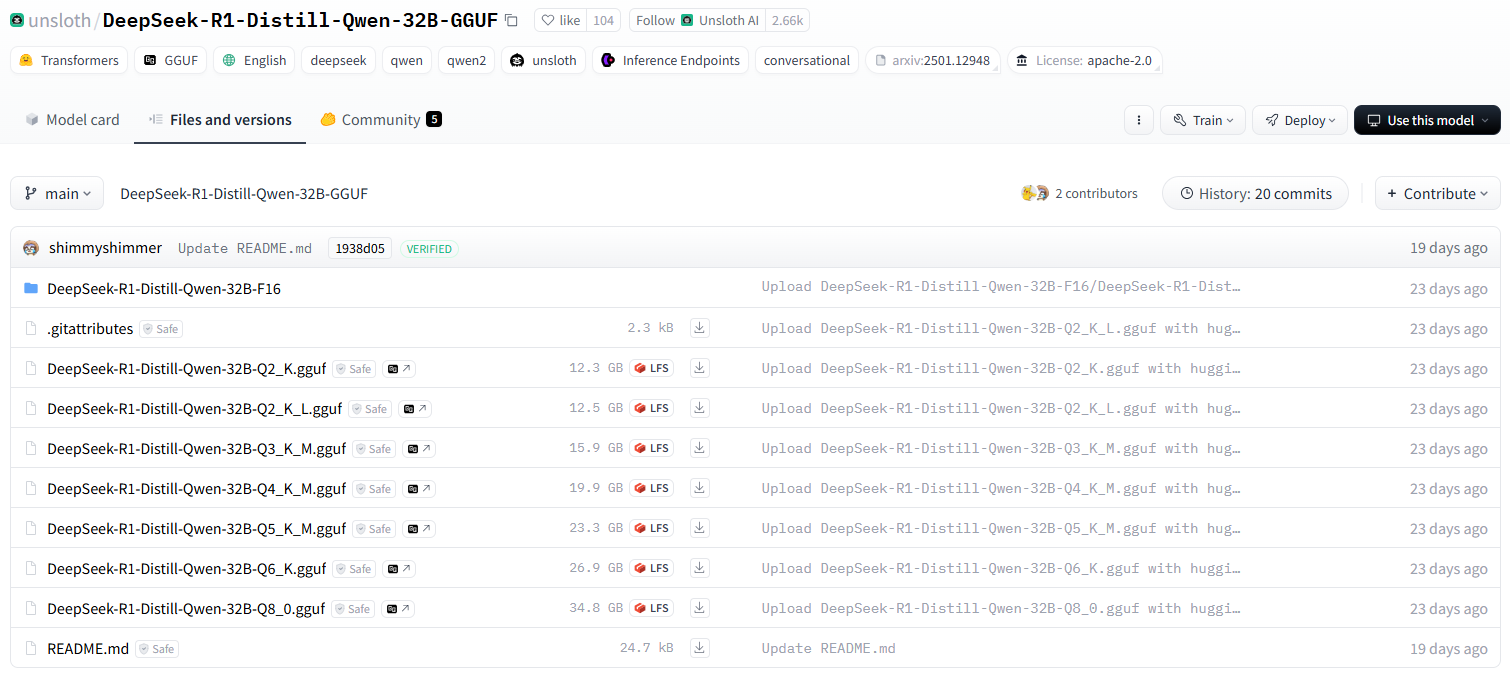

antipático La versión suministrada de Qwen-32B-Q4_K_M está comprimida hasta 20 GB, lo que ya es capaz de funcionar en una tarjeta única de consumo..

Breve resumen de los requisitos de rendimiento informático de la versión cuantificada

DeepSeek-R1-Distill-Qwen-32B-GGUFDescripción de las distintas versiones cuantitativas del modelo

El sufijo de cada archivo (por ejemplo, Q2_K_L, Q4_K_M, etc.) representa una cuantificación diferente. He aquí sus principales diferencias:

q2_k_l, q3_k_m, q4_k_m, q5_k_m, q6_k, q8_0

Q2yQ3yQ4yQ5yQ6yQ8denota el número de bits que hay que calcular (p. ej.Q4(indica un cálculo de 4 bits).Kademás deMPodría tratarse de una estrategia cuantitativa o un nivel de precisión diferentes.Q8_0Cuantificación típica de 8 bits, cercana a la precisión FP16, con las mayores exigencias computacionales pero mejor calidad de inferencia.

DeepSeek-R1-Distill-Qwen-32B-F16

F16indiquecoma flotante de 16 bits (FP16)es el modelo no calculado, que tiene la mayor precisión pero utiliza más memoria de vídeo.

Más información sobre el concepto de cuantificación aquí:Qué es la cuantificación de modelos: explicación de los tipos de datos FP32, FP16, INT8, INT4

¿Cómo elijo la versión adecuada?

- Dispositivos con poca memoria de vídeo (por ejemplo, GPU de consumo) →SeleccionarCuantificación Q4, Q5Por ejemplo

Q4_K_Mtal vezQ5_K_MEl equilibrio entre rendimiento y precisión. - Dispositivos de memoria extremadamente baja (por ejemplo, funcionamiento de la CPU) →SeleccionarCuantificación Q2 o Q3Por ejemplo

Q2_K_Ltal vezQ3_K_Mreduciendo la huella de memoria. - Servidores GPU de alto rendimiento→SeleccionarCuantificación Q6 o Q8Por ejemplo

Q6_Ktal vezQ8_0, obteniendo una mejor calidad de razonamiento. - más eficaz→Seleccionar

F16pero requiere una cantidad significativa de almacenamiento importante (unos 60 GB o más).

GPU gratuita Versión de instalación recomendada

Q2_K_L

Inicio de la instalación de DeepSeek-R1 32B

De cómo conseguir una GPU gratis hasta que se instale Ollama Proceso de hojear o leer:Implantación en línea del modelo de código abierto DeepSeek-R1 con potencia de GPU gratuitaya que la única diferencia con el tutorial anterior es un ligero cambio en el comando de instalación.

Vaya directamente al proceso de cómo instalar una versión específica de quantised en Ollama. Afortunadamente, Ollama ha simplificado al extremo todo el proceso de instalación, que sólo requiere aprender un comando de instalación.

1. Instalar el modelo de versionado cuantitativo huggingface formato base de comandos

Recuerde el siguiente formato de comando de instalación

ollama run hf.co/{username}:{reponame}

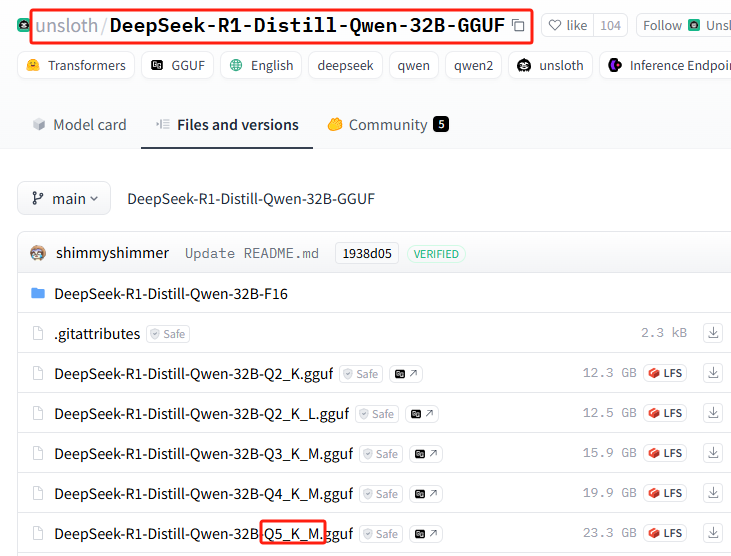

2. Selección de la versión cuantitativa

Lista de todas las versiones cuantificadas: https://huggingface.co/unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF/tree/main

Esta instalación utiliza: Q5_K_M (sólo para fines de demostración, elUna vez más, instale la versión gratuita recomendada por la GPU.(Q5 requiere 23 G de espacio en el disco duro para su instalación)

3. Orden de instalación de empalmes

{username}=unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF

{reponame}=Q5_K_M

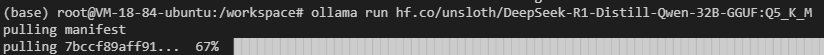

Empálmalo para obtener el comando de instalación completo:ollama run hf.co/unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF:Q5_K_M

4. Realice la instalación en Ollama

Ejecute el comando de instalación

Puede que experimentes fallos en la red (buena suerte con eso), repite el comando de instalación unas cuantas veces más...

¿Sigue sin funcionar? Ejecute el siguiente comando para intentarlo (cambie a la dirección espejo nacional):ollama run https://hf-mirror.com/unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF:Q5_K_M

¿Por qué no utiliza simplemente la dirección de la réplica para descargar, en lugar de utilizar primero la dirección oficial y luego la réplica?

La instalación integrada es más rápida.

Por supuesto, puede que no necesite esta versión cuantificada, aquí tiene una versión popular sin censura más reciente: ollama run huihui_ai/deepseek-r1-abliterated:14b

5. Hacer que Ollama sea accesible a los marginados

Confirme el puerto Ollama introduciendo el comando en el terminal

ollama serve

11414 o 6399

Instalación de ngrok

curl -sSL https://ngrok-agent.s3.amazonaws.com/ngrok.asc \ | tee /etc/apt/trusted.gpg.d/ngrok.asc >/dev/null \ && echo "deb https://ngrok-agent.s3.amazonaws.com buster main" \ | tee /etc/apt/sources.list.d/ngrok.list \ && apt update \ && apt install ngrok

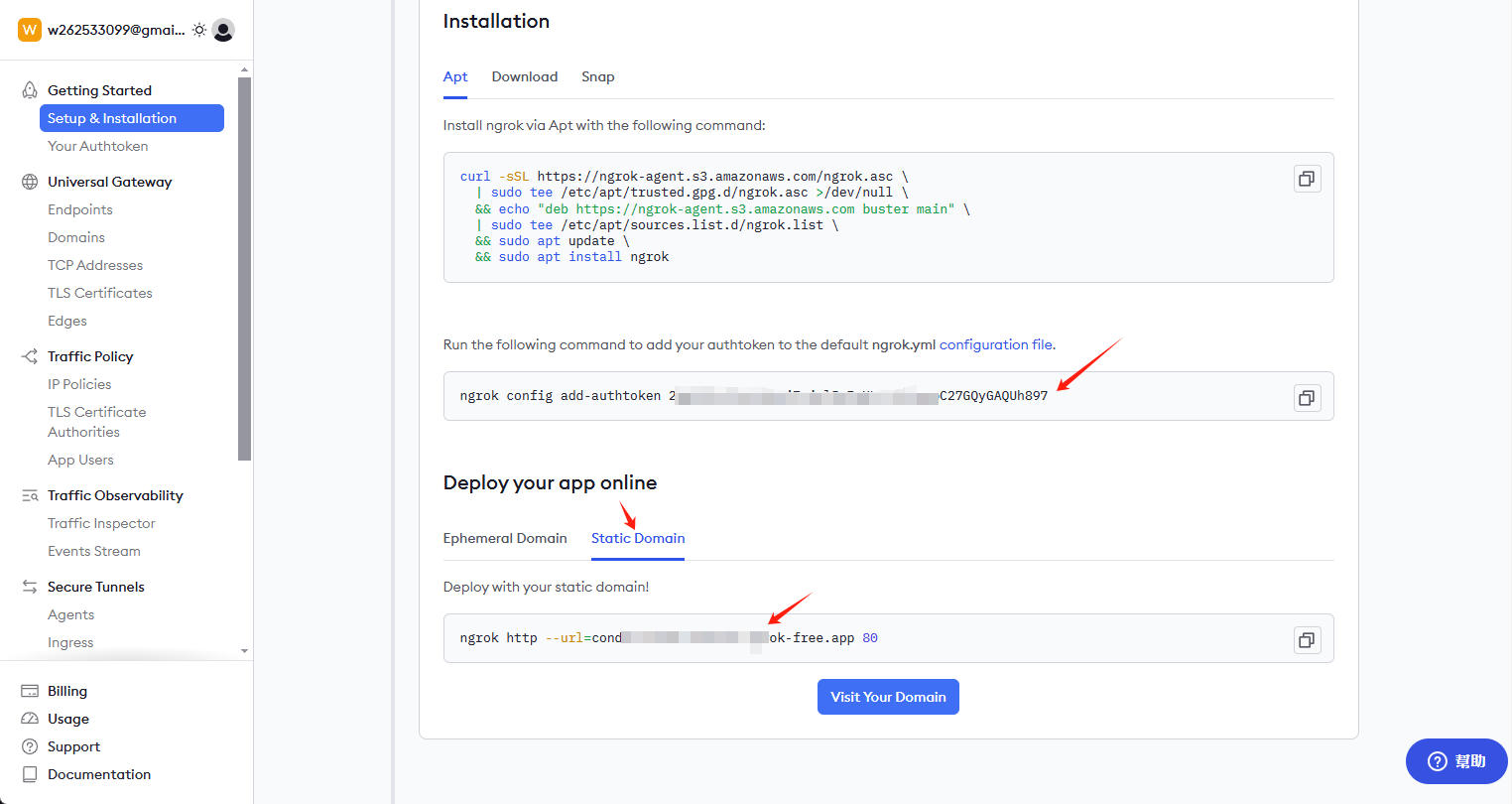

Obtener clave y enlace permanente

Visite ngrok.com para registrarse y vaya a la página de inicio para obtener la clave y el enlace permanente.

Instale la clave y habilite la dirección de acceso externa

Introduzca el siguiente comando en el cliente:

ngrok config add-authtoken 这里是你自己的密钥

Continuar para introducir los siguientes comandos para abrir el acceso externo: 6399 este puerto puede ser diferente de todo el mundo, comprobar y modificar su propia

ngrok http --url=condor-known-ferret.ngrok-free.app 6399

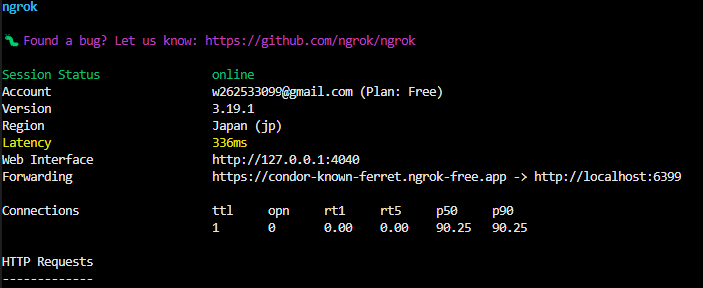

Tras el éxito verá en el terminal

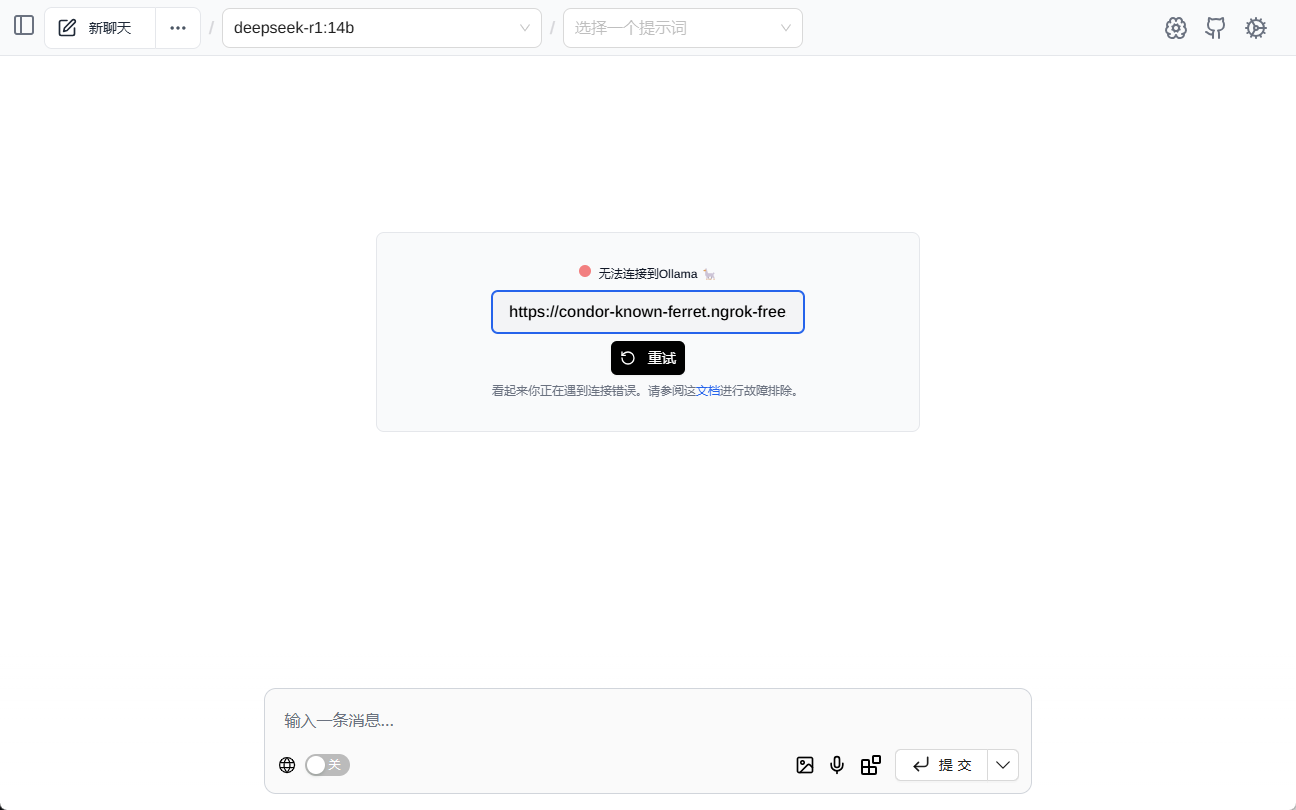

https://condor-known-ferret.ngrok-free.app es la dirección de acceso para la interfaz del modelo, ábrala y podrá ver el siguiente contenido

utilizar

¿Obtenido de https://condor-known-ferret.ngrok-free.app如何使用?

La forma más sencilla de hacerlo es instalar Ayuda de página Utilizada conjuntamente, la herramienta es un complemento del navegador que se instala solo.

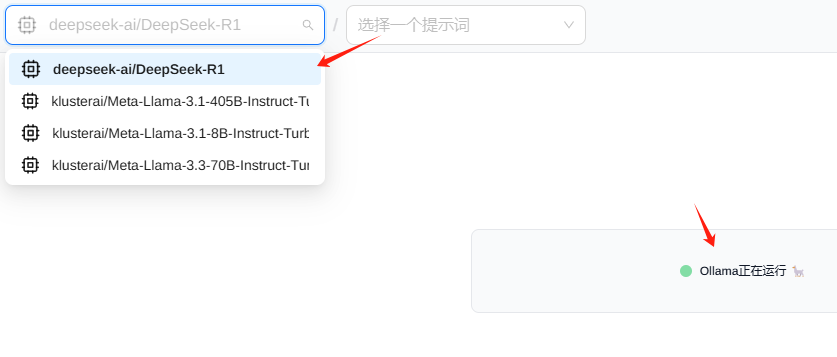

configure

espectáculo (una entrada) Ayuda de página A continuación, verá la siguiente interfaz, introduzca la dirección de la interfaz

Normalmente verá que el modelo se carga automáticamente

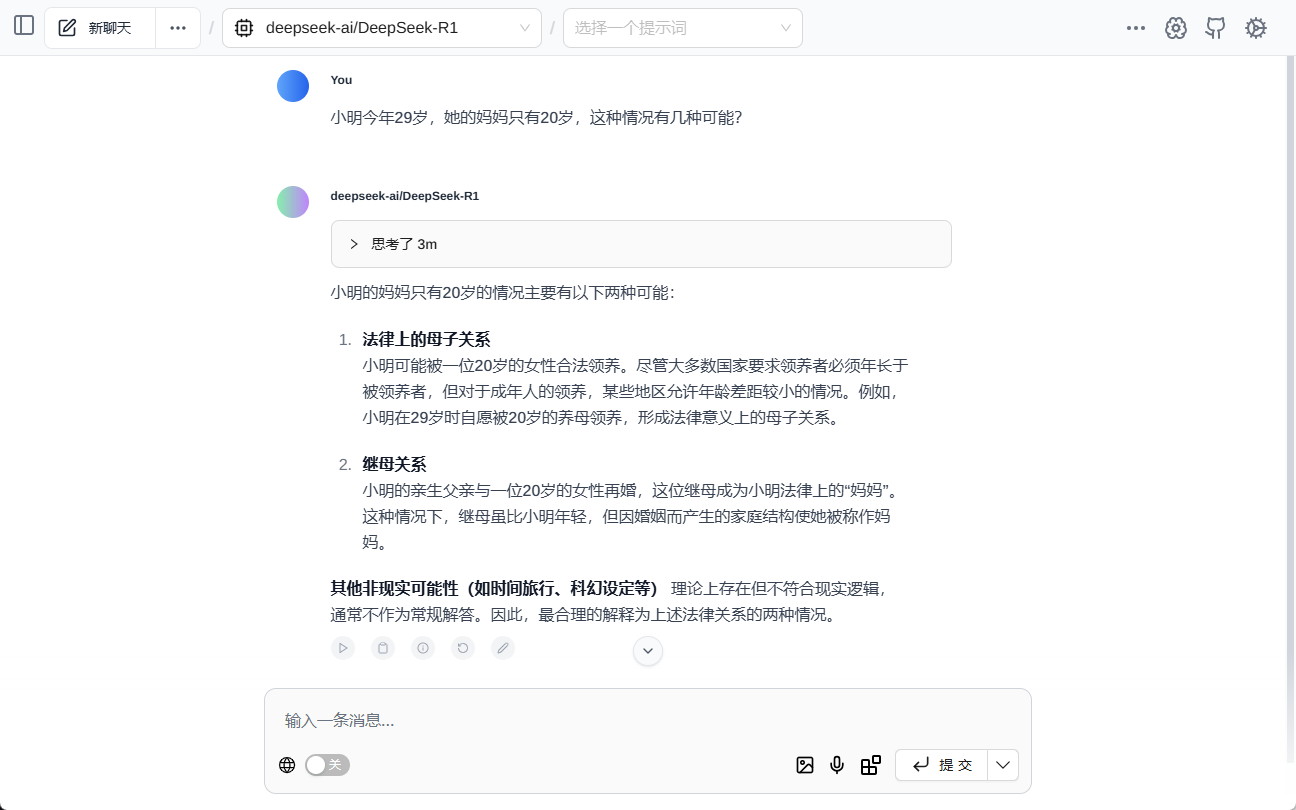

prueba (maquinaria, etc.)

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...