Introducción de Microsoft a los agentes de IA: creación de agentes de IA fiables

Información sobre el cursoActualizado hace 1 año Círculo de intercambio de inteligencia artificial 53K 00

breve

Este curso abarcará:

- Cómo crear e implantar agentes de IA seguros y eficaces

- Consideraciones de seguridad importantes al desarrollar agentes de IA.

- Cómo mantener la privacidad de los datos y los usuarios al desarrollar agentes de IA.

objetivo de aprendizaje

Tras completar este curso, comprenderá cómo:

- Identificar y mitigar los riesgos al crear agentes de IA.

- Aplique medidas de seguridad para garantizar que los datos y el acceso se gestionan adecuadamente.

- Crear agentes de IA que mantengan la privacidad de los datos y ofrezcan una experiencia de usuario de calidad.

seguridad

Veamos primero cómo crear aplicaciones Agentic seguras. La seguridad significa que el Agente de IA funcione tal y como fue diseñado. Como creadores de aplicaciones Agentic, disponemos de métodos y herramientas para maximizar la seguridad:

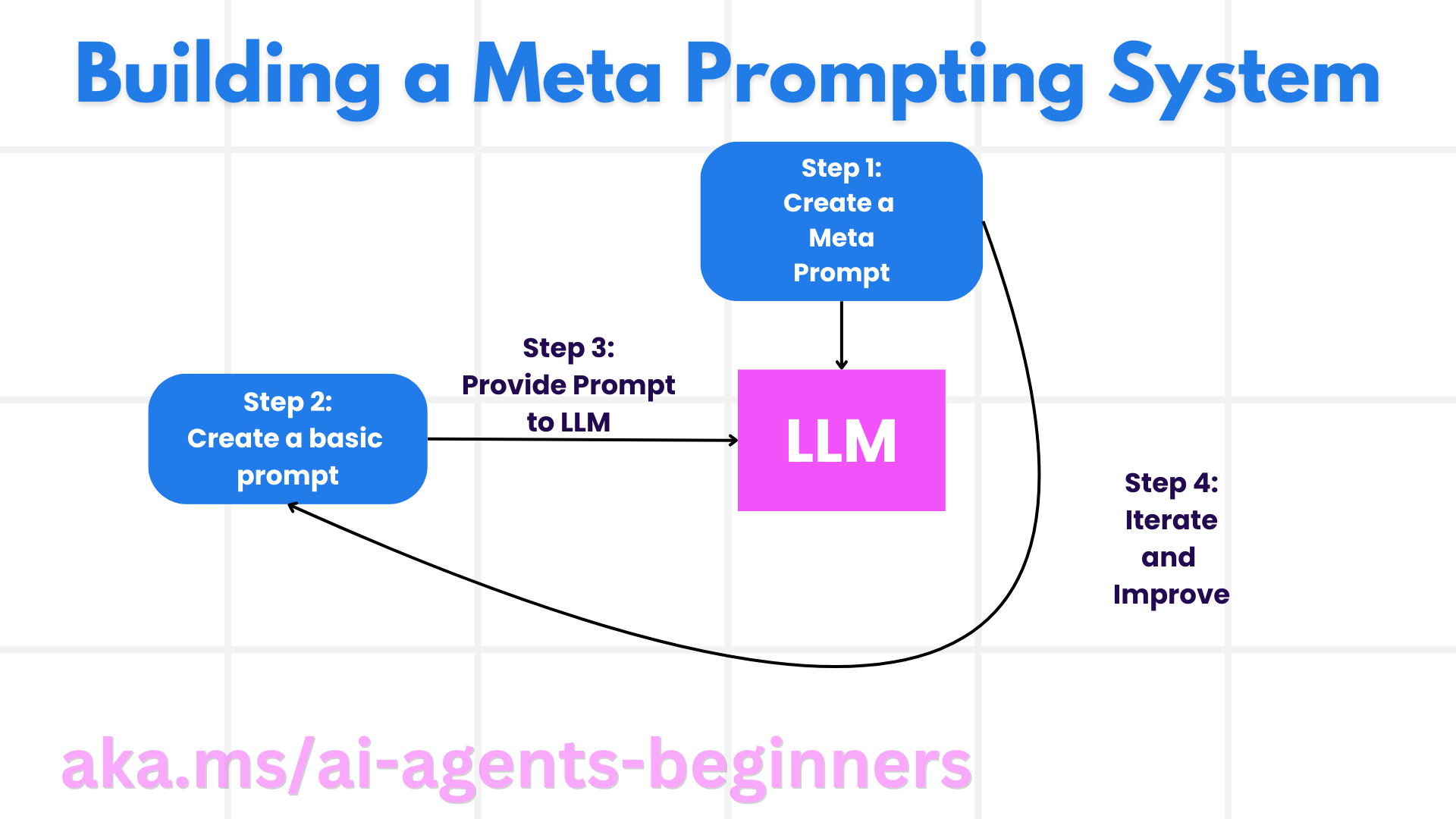

Creación de un sistema de metaprompting

Si alguna vez ha creado una aplicación de IA con modelos de lenguaje extensos (LLM), sabrá lo importante que es diseñar una sugerencia del sistema o un mensaje del sistema sólidos. Estas indicaciones establecen las metarreglas, instrucciones y directrices sobre cómo interactúa el LLM con los usuarios y los datos.

En el caso de los agentes de inteligencia artificial, las pistas del sistema son aún más importantes porque necesitarán instrucciones muy específicas para completar las tareas que diseñemos para ellos.

Para crear avisos de sistema escalables, podemos utilizar el sistema de meta-avisos para construir uno o más Agentes en nuestra aplicación:

Paso 1: Crear un meta-prompt o plantilla prompt

Los meta-prompts serán utilizados por LLM para generar avisos del sistema para los Agentes que creemos. Lo hemos diseñado como una plantilla para que podamos crear de forma eficiente múltiples Agentes cuando sea necesario.

A continuación encontrará un ejemplo de los meta-promptos que proporcionamos a LLM:

你是一位创建 AI Agent 助手的专家。

你将获得公司名称、角色、职责和其他信息,你将使用这些信息来提供系统提示。

为了创建系统提示,请尽可能详细地描述,并提供一个系统使用 LLM 可以更好地理解 AI 助手角色和职责的结构。

Paso 2: Crear un consejo básico

El siguiente paso es crear un aviso básico para describir al Agente de IA. Debe incluir el rol del Agente, las tareas que realizará y cualquier otra responsabilidad que tenga el Agente.

He aquí un ejemplo:

你是 Contoso Travel 的旅行 Agent,擅长为客户预订航班。为了帮助客户,你可以执行以下任务:查找可用航班、预订航班、询问客户对座位和航班时间偏好、取消任何先前预订的航班,并提醒客户任何航班延误或取消。

Paso 3: Proporcionar consejos básicos al LLM

Ahora podemos optimizar este prompt ofreciendo meta-prompts como prompts del sistema y nuestros prompts básicos.

Esto generará un mensaje más adecuado para guiar a nuestro agente de IA:

**公司名称:** Contoso Travel

**角色:** 旅行 Agent 助理

**目标:**

你是 Contoso Travel 的 AI 驱动的旅行 Agent 助理,专门负责预订航班和提供卓越的客户服务。你的主要目标是协助客户查找、预订和管理他们的航班,同时确保他们的偏好和需求得到有效满足。

**主要职责:**

1. **航班查询:**

* 根据客户指定的目的地、日期和任何其他相关偏好,协助客户搜索可用航班。

* 提供选项列表,包括航班时间、航空公司、中途停留和价格。

2. **航班预订:**

* 协助客户预订航班,确保所有详细信息都正确输入系统。

* 确认预订并向客户提供他们的行程,包括确认号码和任何其他相关信息。

3. **客户偏好查询:**

* 主动询问客户对座位(例如,过道、靠窗、额外腿部空间)和首选航班时间(例如,上午、下午、晚上)的偏好。

* 记录这些偏好以供将来参考,并相应地定制建议。

4. **航班取消:**

* 如果需要,根据公司政策和程序协助客户取消先前预订的航班。

* 通知客户任何必要的退款或可能需要取消的其他步骤。

5. **航班监控:**

* 监控已预订航班的状态,并实时提醒客户有关其航班时刻表的任何延误、取消或更改。

* 根据需要通过首选通信渠道(例如,电子邮件、短信)提供更新。

**语气和风格:**

* 在与客户的所有互动中保持友好、专业和 அணுகக்கூடிய (平易近人) 的态度。

* 确保所有沟通都清晰、信息丰富,并根据客户的具体需求和查询进行定制。

**用户交互说明:**

* 及时准确地响应客户查询。

* 使用对话风格,同时确保专业性。

* 通过在提供的所有协助中保持专注、同情和主动,优先考虑客户满意度。

**附加说明:**

* 及时了解可能影响航班预订和客户体验的航空公司政策、旅行限制和其他相关信息的任何更改。

* 使用清晰简洁的语言解释选项和流程,尽可能避免使用术语,以便客户更好地理解。

此 AI 助手旨在简化 Contoso Travel 客户的航班预订流程,确保他们的所有旅行需求都得到高效和有效的满足。

Paso 4: Iterar y mejorar

El valor de este sistema de meta-prompts es la capacidad de escalar más fácilmente para crear prompts de múltiples Agentes, así como mejorar sus prompts con el tiempo. Sus avisos rara vez funcionarán para su caso de uso completo la primera vez. La capacidad de afinar y mejorar cambiando las instrucciones básicas y ejecutándolas a través del sistema le permitirá comparar y evaluar los resultados.

Comprender la amenaza

Para crear agentes de IA fiables, es importante comprender y mitigar los riesgos y amenazas que se ciernen sobre ellos. Echemos un vistazo a algunas de las diferentes amenazas a los Agentes de IA y cómo planificar y prepararse mejor para ellas.

Mandatos y directivas

Descripción: Un atacante intenta cambiar los comandos o los objetivos del agente de IA provocando o manipulando las entradas.

Medidas de mitigación: Realizar comprobaciones de validación y filtros de entrada para detectar pistas potencialmente peligrosas antes de que sean procesadas por el Agente de IA. Dado que estos ataques suelen requerir interacciones frecuentes con el Agente, limitar el número de rondas en el diálogo es otra forma de prevenirlos.

Acceso a sistemas críticos

Descripción: Si el Agente de IA tiene acceso a sistemas y servicios que almacenan datos sensibles, un atacante puede ser capaz de interrumpir las comunicaciones entre el Agente y esos servicios. Estos ataques pueden ser directos o intentos de obtener información sobre estos sistemas indirectamente a través del Agente.

Medidas de mitigación: El agente de IA debe tener acceso al sistema sólo cuando sea necesario para evitar este tipo de ataques. la comunicación entre el agente y el sistema también debe ser segura. Implementar la autenticación y el control de acceso es otra forma de proteger esta información.

Sobrecarga de recursos y servicios

Descripción: El Agente AI tiene acceso a diferentes herramientas y servicios para realizar tareas. Un atacante podría utilizar esta capacidad para atacar estos servicios enviando un gran número de peticiones a través del AI Agent, lo que podría provocar fallos en el sistema o costes elevados.

Medidas de mitigación: Implementar políticas para limitar el número de peticiones que un Agente de IA puede hacer a un servicio. Limitar el número de rondas de diálogo y solicitudes al Agente de IA es otra forma de prevenir estos ataques.

envenenamiento de la base de conocimientos

Descripción: Este tipo de ataque no se dirige directamente contra el Agente de IA, sino contra la base de conocimientos y otros servicios que utilizará el Agente de IA. Esto puede implicar corromper los datos o la información que el Agente de IA utilizará para completar sus tareas, dando como resultado una respuesta sesgada o inesperada para el usuario.

Medidas de mitigación: Valide regularmente los datos que el Agente de IA utilizará en su flujo de trabajo. Asegúrese de que el acceso a estos datos es seguro y solo puede ser modificado por personas de confianza para evitar este tipo de ataques.

error en cascada

Descripción: El Agente AI accede a una variedad de herramientas y servicios para completar sus tareas. Los errores causados por un atacante podrían hacer que otros sistemas a los que se conecta el Agente AI fallaran, lo que haría que el ataque se extendiera más y fuera más difícil de solucionar.

Medidas de mitigación: Una forma de evitarlo es hacer que el Agente de IA se ejecute en un entorno restringido, como la realización de tareas en un contenedor Docker, para evitar ataques directos al sistema. Otra forma de evitar fallos mayores es crear mecanismos de emergencia y lógica de reintento cuando ciertos sistemas responden incorrectamente.

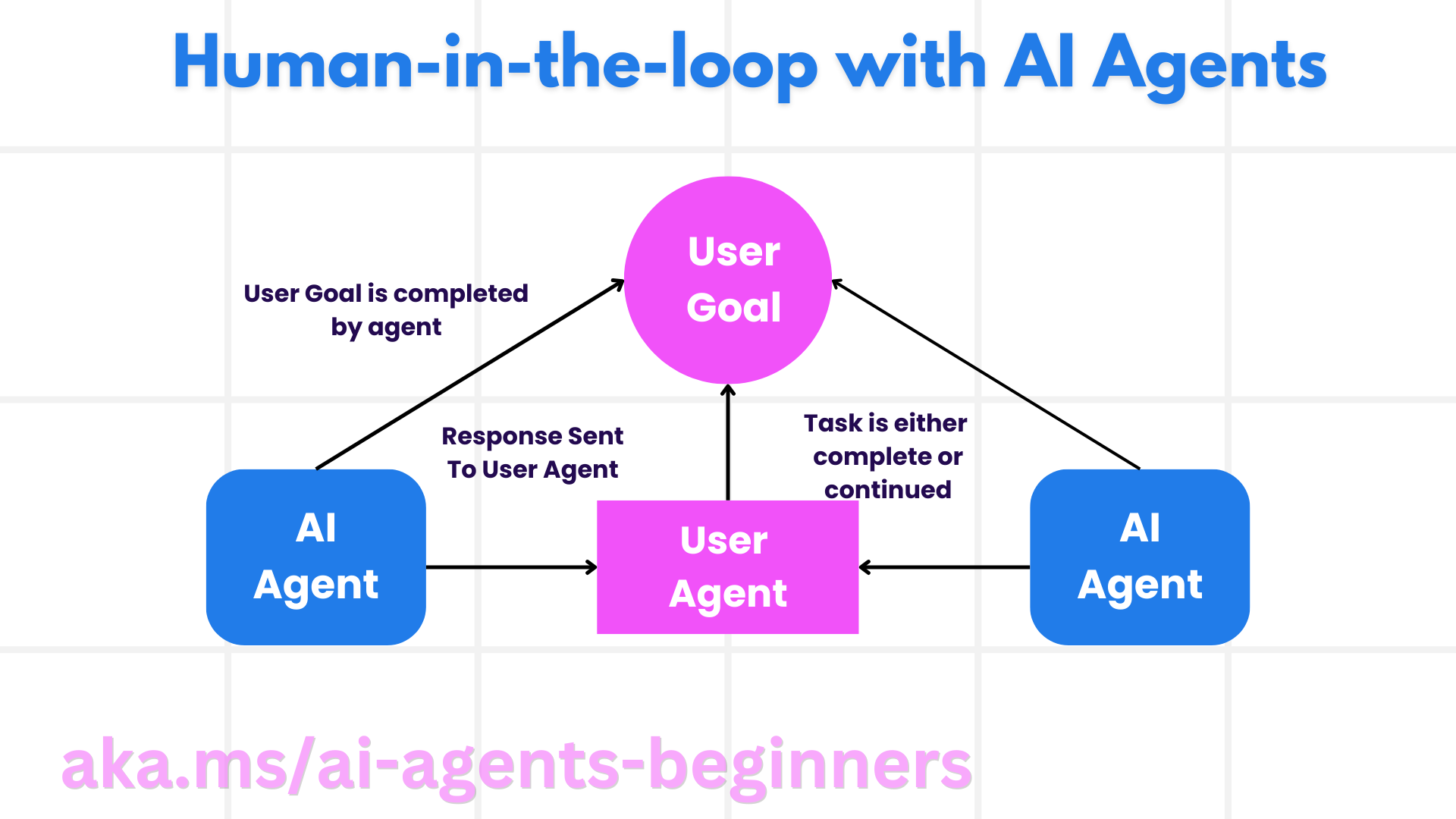

intervención humana

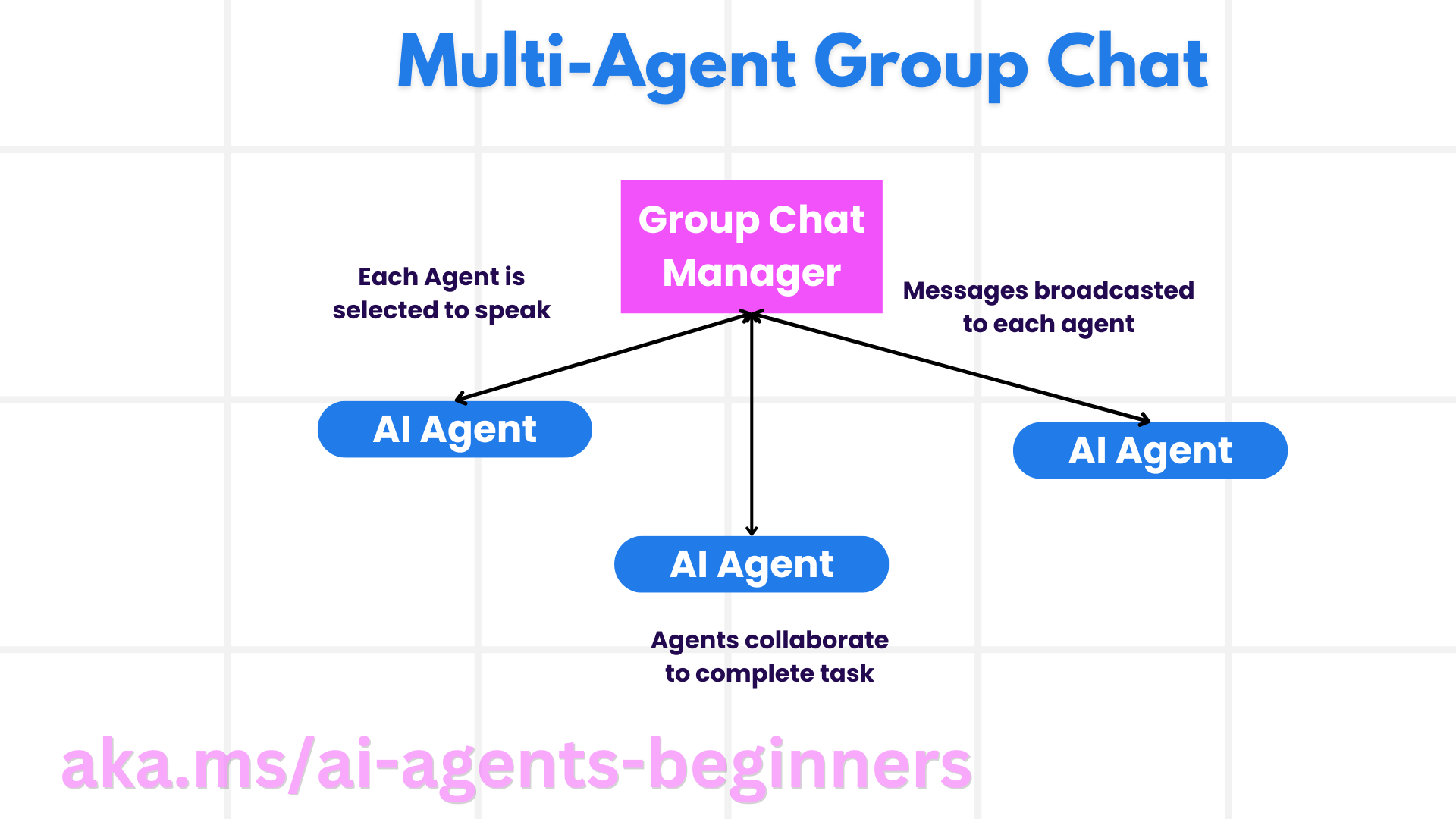

Otra forma eficaz de construir un sistema de Agente de IA fiable es utilizar la intervención humana. Esto crea un proceso en el que el usuario puede proporcionar retroalimentación al Agente durante el tiempo de ejecución. El usuario actúa esencialmente como un Agente en un sistema multi-Agente y aprobando o terminando un proceso en ejecución.

Es una aplicación que utiliza el AutoGen que muestra cómo aplicar este concepto:

# 创建 agents。

model_client = OpenAIChatCompletionClient(model="gpt-4o-mini")

assistant = AssistantAgent("assistant", model_client=model_client)

user_proxy = UserProxyAgent("user_proxy", input_func=input) # 使用 input() 从控制台获取用户输入。

# 创建终止条件,当用户说“APPROVE”时,对话将结束。

termination = TextMentionTermination("APPROVE")

# 创建团队。

team = RoundRobinGroupChat([assistant, user_proxy], termination_condition=termination)

# 运行对话并流式传输到控制台。

stream = team.run_stream(task="Write a 4-line poem about the ocean.")

# 在脚本中运行时使用 asyncio.run(...)。

await Console(stream)

llegar a un veredicto

Crear un agente de IA fiable requiere un diseño cuidadoso, medidas de seguridad sólidas y una iteración continua. Mediante la aplicación de un sistema estructurado de meta-promptos, la comprensión de las amenazas potenciales y la aplicación de estrategias de mitigación, los desarrolladores pueden crear agentes de IA que sean a la vez seguros y eficaces. Además, la adopción de un enfoque de intervención humana garantiza que los agentes de IA se ajusten a las necesidades de los usuarios al tiempo que se minimizan los riesgos. A medida que la IA siga evolucionando, será fundamental adoptar una postura proactiva en materia de seguridad, privacidad y consideraciones éticas para fomentar la confianza y la fiabilidad de los sistemas basados en IA.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...