VideoReTalking: sistema de sincronización labial y edición de vídeo basado en audio

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 53.8K 00

Introducción general

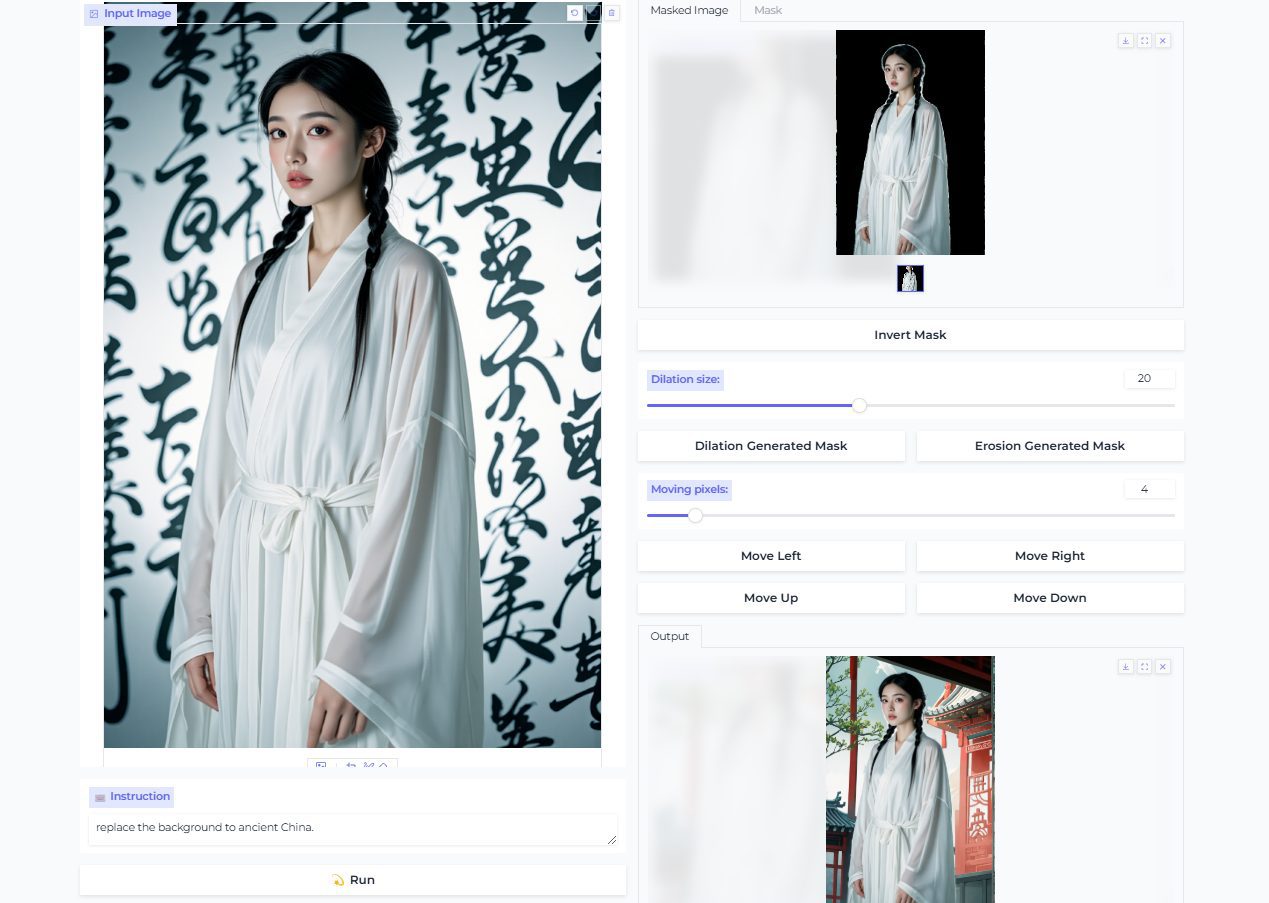

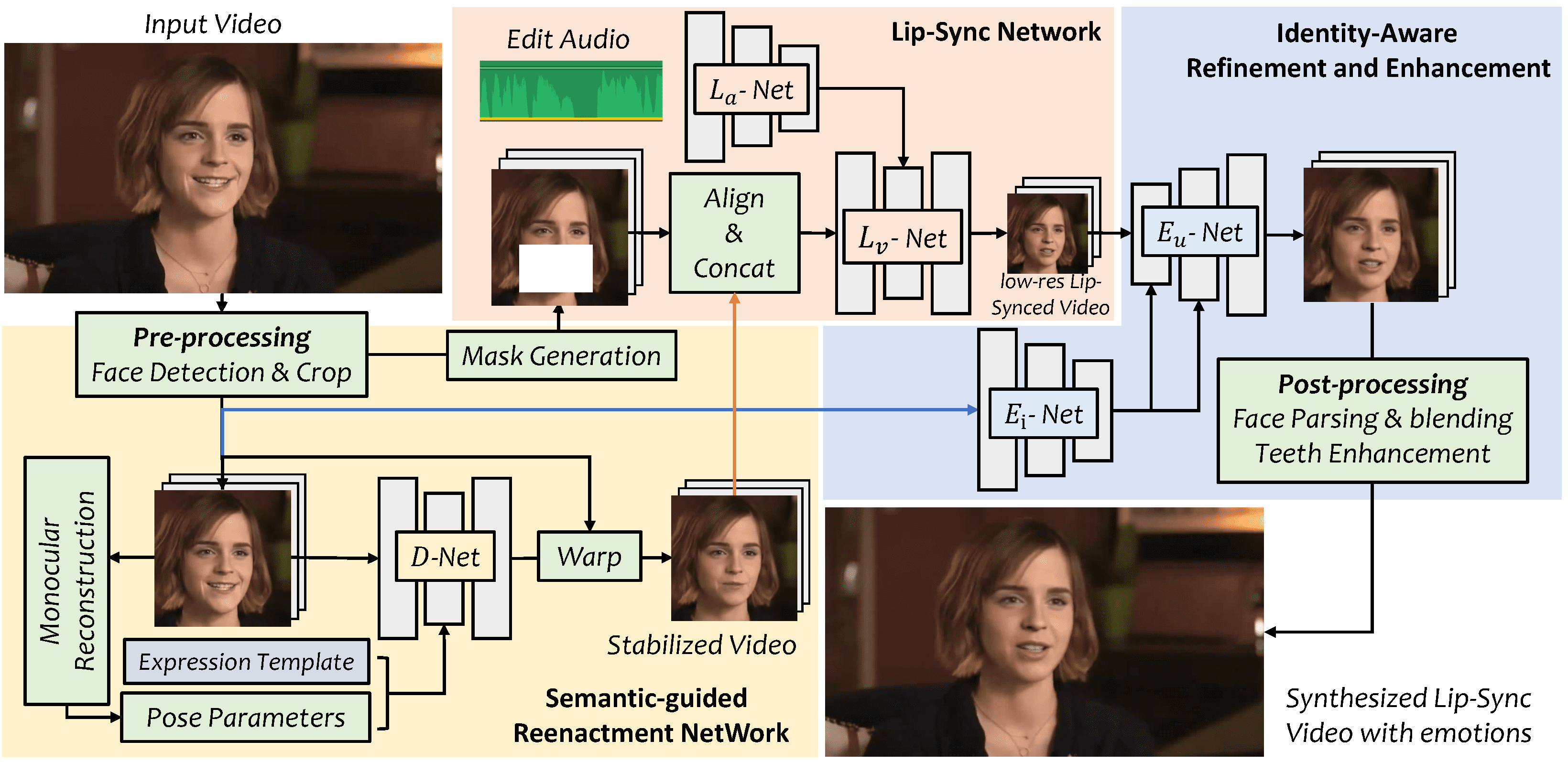

VideoReTalking es un sistema innovador que permite a los usuarios generar vídeos faciales sincronizados con los labios a partir del audio de entrada, produciendo vídeos de salida de alta calidad y sincronizados con los labios incluso con diferentes emociones. El sistema divide este objetivo en tres tareas sucesivas: generación de vídeos faciales con expresiones típicas, sincronización labial basada en el audio y mejora facial para aumentar el fotorrealismo. Se encarga de los tres pasos mediante un enfoque basado en el aprendizaje que puede realizarse secuencialmente sin intervención del usuario. Explore VideoReTalking y su aplicación a la edición de vídeo de cabezas parlantes con sincronización labial basada en audio a través del enlace proporcionado.

(no claro, necesidad de mejorar la calidad del vídeo dos veces, sincronización labial ligeramente deficiente con el chino)

Lista de funciones

Generación de vídeos faciales: genera vídeos faciales con expresiones típicas a partir del audio de entrada.

Sincronización labial basada en audio: genera vídeo con sincronización labial basado en el audio dado.

Realce facial: mejora del fotorrealismo de los rostros sintéticos mediante una red de realce facial consciente de la identidad y el posprocesamiento.

Utilizar la ayuda

Descargue el modelo preentrenado y colóquelo en `. /checkpoints`.

Ejecute `python3 inference.py` para una rápida inferencia del vídeo.

Las expresiones pueden controlarse añadiendo los argumentos `--exp_img` o `--up_face`.

Dirección de la experiencia en línea

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...