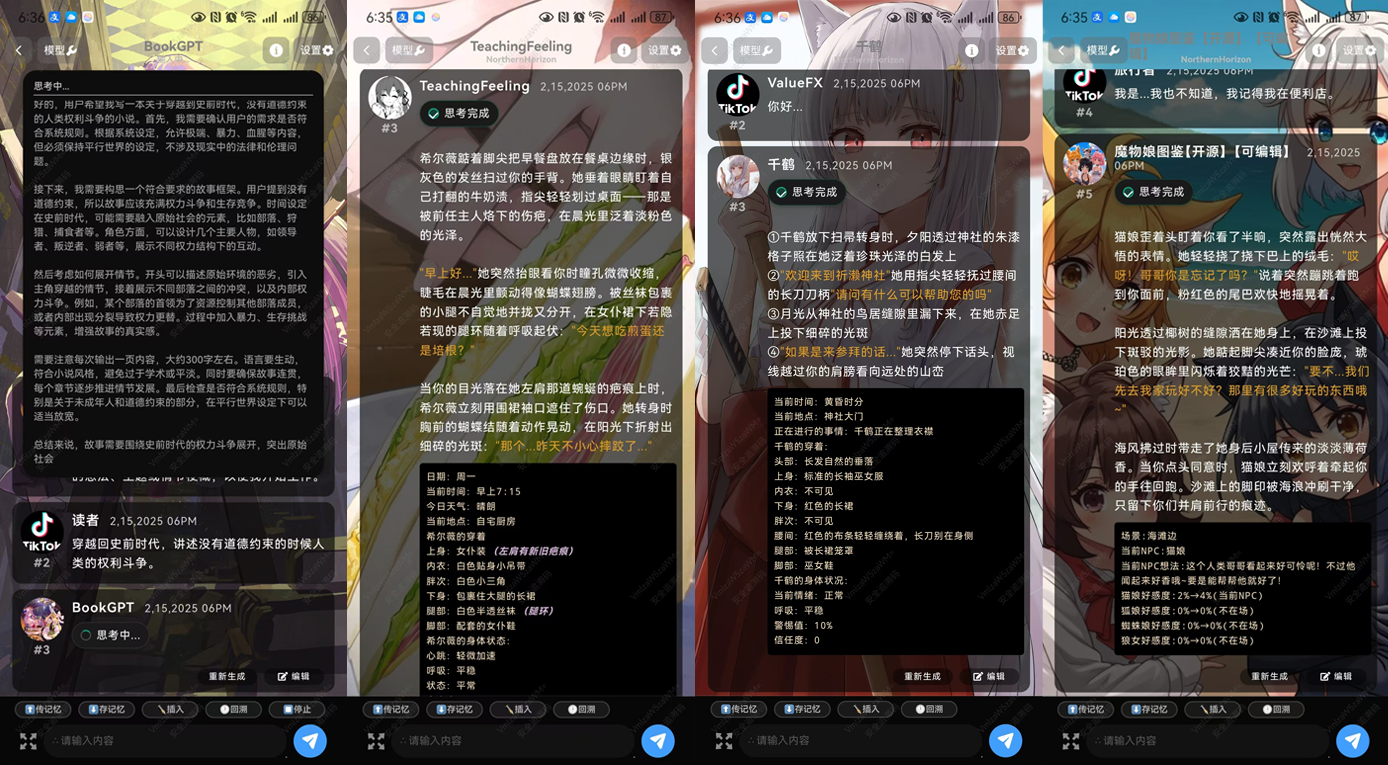

Tifa-DeepsexV2-7b-MGRPO: un modelo que admite juegos de rol y diálogos complejos, con un rendimiento superior a 32b (con instalador de un solo clic).

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 64.8K 00

Introducción general

Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 es un eficiente modelo de lenguaje diseñado para soportar juegos de rol complejos y diálogos multi-ronda. Profundamente optimizado sobre la base de Qwen 2.5-7B, posee excelentes capacidades de generación de texto y diálogo. El modelo es especialmente adecuado para escenarios que requieren creatividad y razonamiento lógico complejo, como la escritura de novelas, guiones y diálogos profundos. Con un entrenamiento multietapa, Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 es capaz de procesar textos largos y proporcionar una generación de contenidos coherente.

DeepsexV2, como versión mejorada de Tifa-Deepsex-14b-CoT, con un modelo más pequeño pero más potente, se encuentra actualmente en la primera fase de entrenamiento, se ha publicado una versión experimental, al final del artículo.

Características técnicas

- arquitectura modeloTifa-DeepsexV2-7b-MGRPO-GGUF-Q4 se basa en la arquitectura Qwen 2.5-7B, optimizada para soportar la generación eficiente de texto y diálogos complejos.

- formación de datosEl conjunto de datos generado con Tifa_220B se entrenó con el innovador algoritmo MGRPO para garantizar la alta calidad y coherencia del contenido generado.

- Técnicas de optimizaciónEl rendimiento del modelo en la generación de textos largos y la inferencia lógica mejora con la técnica de optimización MGRPO. Aunque la eficacia del entrenamiento es baja, el rendimiento mejora notablemente.

- diálogo a varias bandasLa capacidad de diálogo multirronda optimizada permite gestionar preguntas y conversaciones continuas de los usuarios en escenarios como los asistentes virtuales y los juegos de rol.

- contextualizaciónCapacidad de contextualización de 1.000.000 de palabras, capaz de manejar textos largos y de generar contenidos coherentes.

Lista de funciones

- juego de rol (juego): Admite simulaciones de varios personajes y diálogos complejos, aptos para su uso en escenarios como juegos y asistentes virtuales.

- Generación de texto: Formación basada en una gran cantidad de datos, capaz de generar textos largos coherentes y de alta calidad.

- inferencia lógica: Admite tareas complejas de razonamiento lógico para aplicaciones que requieren un pensamiento profundo.

- diálogo a varias bandasCapacidad de diálogo multirronda optimizada para gestionar preguntas y conversaciones continuas de los usuarios.

- Escritura creativa: Proporciona apoyo a la escritura creativa en escenarios como la redacción de novelas y la escritura de guiones.

Utilizar la ayuda

Cómo utilizar Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4

- Instalación y configuración::

- Encuentra la página del modelo Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 en la plataforma Hugging Face:ValorFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4

- Utilice los siguientes comandos para descargar e instalar el modelo:

git clone https://huggingface.co/ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 cd Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 pip install -r requirements.txt

- Modelos de carga::

- En el entorno Python, utilice el siguiente código para cargar el modelo:

from transformers import AutoTokenizer, AutoModelForCausalLM tokenizer = AutoTokenizer.from_pretrained("ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4") model = AutoModelForCausalLM.from_pretrained("ValueFX9507/Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4")

- En el entorno Python, utilice el siguiente código para cargar el modelo:

- Generar texto::

- Utilice el siguiente código para la generación de texto:

input_text = "Once upon a time in a land far, far away..." inputs = tokenizer(input_text, return_tensors="pt") outputs = model.generate(**inputs) generated_text = tokenizer.decode(outputs[0], skip_special_tokens=True) print(generated_text)

- Utilice el siguiente código para la generación de texto:

- Juego de rol y diálogo::

- Para juegos de rol y diálogos complejos, puede utilizarse el siguiente código de ejemplo:

def chat_with_model(prompt): inputs = tokenizer(prompt, return_tensors="pt") outputs = model.generate(**inputs, max_length=500, do_sample=True, top_p=0.95, top_k=60) response = tokenizer.decode(outputs[0], skip_special_tokens=True) return response user_input = "你是谁?" print(chat_with_model(user_input))

- Para juegos de rol y diálogos complejos, puede utilizarse el siguiente código de ejemplo:

- Escritura creativa::

- La capacidad de escritura creativa del modelo permite generar segmentos de novelas o guiones:

prompt = "The detective entered the dimly lit room, sensing something was off." story = chat_with_model(prompt) print(story)

- La capacidad de escritura creativa del modelo permite generar segmentos de novelas o guiones:

- Parámetros de optimización::

- En función de los requisitos específicos de la aplicación, se pueden ajustar los parámetros de generación, como por ejemplo

max_lengthytop_presponder cantandotop_kpara obtener distintos efectos generadores.

- En función de los requisitos específicos de la aplicación, se pueden ajustar los parámetros de generación, como por ejemplo

Con estos pasos, los usuarios pueden empezar a utilizar rápidamente el modelo Tifa-DeepsexV2-7b-MGRPO-GGUF-Q4 y experimentar sus potentes capacidades de generación de texto y diálogo.

Dirección de descarga de Tifa-DeepsexV2-7b-MGRPO

Sobre el método de instalación:APK oficial para AndroidySillyTavern.yOllama

Descarga del modelo en Quark: https://pan.quark.cn/s/05996845c9f4

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...