Step1X-Edit: una herramienta de código abierto para editar imágenes con instrucciones de lenguaje natural

Últimos recursos sobre IAActualizado hace 11 meses Círculo de intercambio de inteligencia artificial 75.1K 00

Introducción general

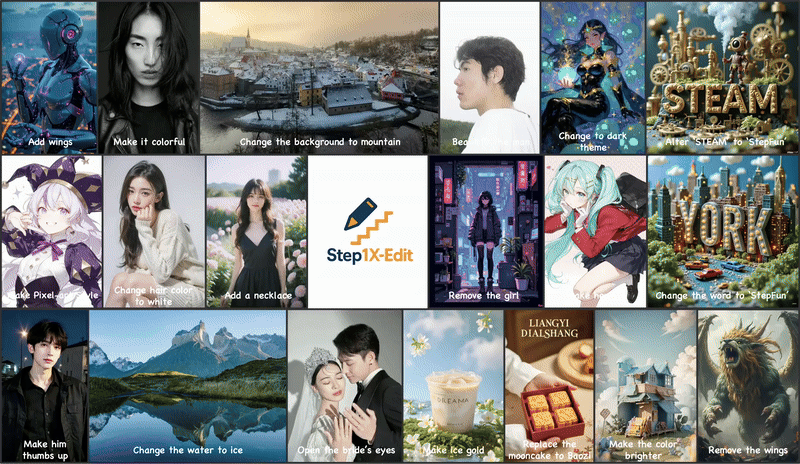

Step1X-Edit es un marco de edición de imágenes de código abierto, desarrollado por el equipo Stepfun AI y alojado en GitHub, que combina un modelo multimodal de gran lenguaje (Qwen-VL) y un transformador de difusión (DiT) para permitir a los usuarios editar una imagen con sencillos comandos de lenguaje natural, como cambiar el fondo, eliminar un objeto o cambiar de estilo. Lanzado el 25 de abril de 2025, el rendimiento del proyecto se acerca al de modelos de código cerrado como GPT-4o y Géminis 2 Flash. step1X-Edit proporciona pesos de modelo, código de inferencia y evaluación comparativa GEdit-Bench para soportar una amplia gama de escenarios de edición. la licencia Apache 2.0 permite el uso libre y el desarrollo comercial, atrayendo a desarrolladores, diseñadores e investigadores. El apoyo de la comunidad es activo y ha lanzado ComfyUI Plug-ins y versiones cuantificadas FP8 para optimizar los requisitos de hardware.

Actualmente disponible en Paso AI Experiencia gratuita. Sin embargo, los resultados reales de edición de imágenes son ligeramente diferentes de GPT-4o y Gemini 2 Flash.

Lista de funciones

- Admite comandos de lenguaje natural para editar imágenes, como "Cambiar el fondo a la playa" o "Quitar gente de la foto".

- Análisis sintáctico de comandos de imagen y texto mediante un gran modelo de lenguaje multimodal (Qwen-VL) para generar ediciones precisas.

- Genera imágenes de alta calidad basadas en el transformador de difusión (DiT) que mantiene los detalles de la imagen original.

- Proporciona la evaluación comparativa GEdit-Bench para evaluar el rendimiento de edición bajo comandos de usuario reales.

- Admite modelos cuantitativos FP8, reduce los requisitos de hardware y se adapta a GPU de baja memoria.

- La integración con el complemento ComfyUI simplifica el flujo de trabajo y mejora la experiencia del usuario.

- Existe una demostración en línea que permite a los usuarios experimentar las funciones de edición sin necesidad de instalación.

- Código de inferencia y pesos del modelo de código abierto para apoyar el desarrollo secundario y la investigación.

Utilizar la ayuda

Proceso de instalación

Para utilizar Step1X-Edit, es necesario instalar el entorno y descargar los pesos del modelo. A continuación se detallan los pasos, adecuados para sistemas Linux (se recomienda Ubuntu 20.04 o superior):

- Preparar el entorno

Asegúrese de que Python 3.10 o superior está instalado en su sistema, así como el kit de herramientas CUDA (se recomienda 12.1). Se recomienda una GPU (80 GB de RAM es lo mejor, como la NVIDIA H800), pero las versiones cuantificadas de FP8 admiten menos RAM (16 GB o 24 GB).conda create -n step1x python=3.10 conda activate step1x

- almacén de clones

Descargue el código del proyecto Step1X-Edit de GitHub:git clone https://github.com/stepfun-ai/Step1X-Edit.git cd Step1X-Edit - Instalación de dependencias

Instale PyTorch (se recomienda 2.3.1 o 2.5.1) y las bibliotecas relacionadas:pip install torch==2.3.1 torchvision --index-url https://download.pytorch.org/whl/cu121 pip install -r requirements.txtInstale Flash Attention (opcional, para acelerar el razonamiento):

pip install flash-attn --no-build-isolationSi tiene problemas con la instalación de Flash Attention, puede consultar el script oficial para generar un archivo wheel precompilado adecuado para su sistema:

python scripts/find_flash_attn_wheel.py - Descargar modelos de pesos

Descargue los pesos del modelo y el Autocoder Variable (VAE) de Hugging Face o ModelScope:- Paso1X-Editar modelo:

step1x-edit-i1258.safetensors(aproximadamente 24,9 GB) - VAE:

vae.safetensors(aproximadamente 335 MB) - Modelo Qwen-VL:

Qwen/Qwen2.5-VL-7B-Instruct

Descargas automatizadas mediante scripts de Python:

from huggingface_hub import snapshot_download import os target_dir = "models/step1x" os.makedirs(target_dir, exist_ok=True) # 下载 Step1X-Edit 模型 snapshot_download(repo_id="stepfun-ai/Step1X-Edit", local_dir=target_dir, allow_patterns=["step1x-edit-i1258.safetensors"]) # 下载 VAE snapshot_download(repo_id="stepfun-ai/Step1X-Edit", local_dir=target_dir, allow_patterns=["vae.safetensors"]) # 下载 Qwen-VL qwen_dir = os.path.join(target_dir, "Qwen2.5-VL-7B-Instruct") snapshot_download(repo_id="Qwen/Qwen2.5-VL-7B-Instruct", local_dir=qwen_dir) - Paso1X-Editar modelo:

- razonamiento en funcionamiento

Edite una imagen utilizando el script de razonamiento proporcionado. Por ejemplo, edita una imagen y cambia el fondo:python scripts/run_inference.py --image_path assets/demo.png --prompt "将背景改为夜空" --output_path output.pngDescripción de los parámetros:

--image_pathIntroduzca la ruta de la imagen.--promptComandos de edición (por ejemplo, "cambiar el cielo a puesta de sol").--output_pathRuta de la imagen de salida.--size_levelResolución (por defecto 512x512, 1024x1024 requiere más memoria).--seedSemillas aleatorias para controlar la coherencia de la generación.

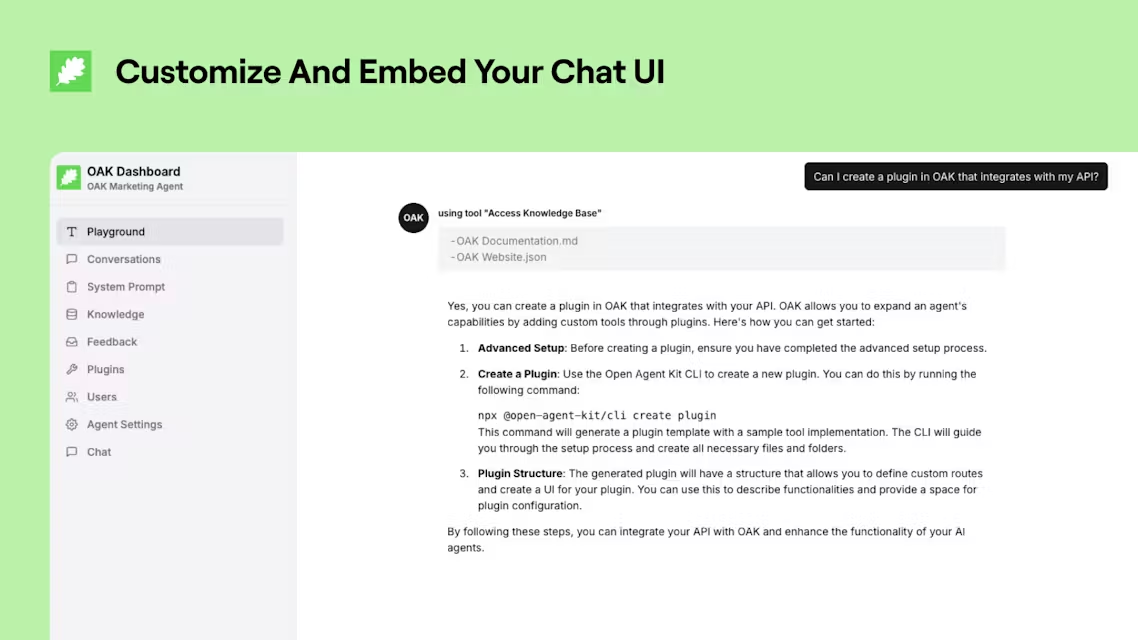

Uso del plug-in ComfyUI

Step1X-Edit ofrece un plug-in ComfyUI para los usuarios que deseen integrarlo en los flujos de trabajo.

- Clona el repositorio de plugins de ComfyUI:

cd path/to/ComfyUI/custom_nodes git clone https://github.com/quank123wip/ComfyUI-Step1X-Edit.git - Coloque los pesos del modelo en el

ComfyUI/models/Step1x-EditCatálogo:step1x-edit-i1258.safetensorsvae.safetensors- Carpeta de modelos Qwen-VL:

Qwen2.5-VL-7B-Instruct

- Inicia ComfyUI y carga el nodo Step1X-Edit.

- En la interfaz ComfyUI, sube una imagen, introduce un comando de edición (por ejemplo, "Añadir alas") y ejecuta el flujo de trabajo para generar el resultado.

Funciones principales

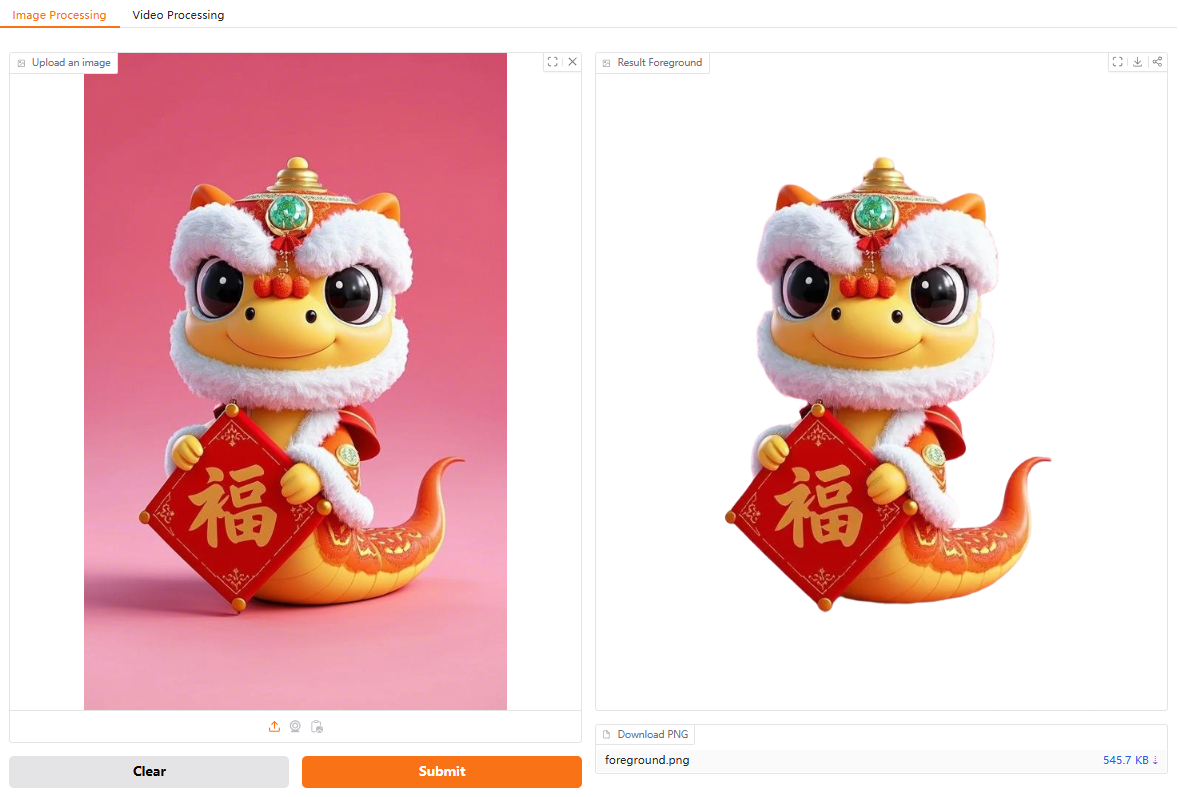

- editor de lenguaje natural

El usuario carga una imagen e introduce un comando de texto. Por ejemplo, para cambiar el fondo de una foto a una vista de montaña, introduce "cambiar fondo a vista de montaña". El modelo analiza la orden a través de Qwen-VL, extrae la semántica y genera una nueva imagen junto con DiT. Se recomienda que los comandos sean claros y específicos, por ejemplo, "Cambiar cielo a cielo azul estrellado" es más eficaz que "Embellecer cielo". - Supresión o adición de objetos

Comandos como "Quitar una persona de una foto" o "Añadir un árbol". El modelo conserva el resto de la imagen y edita con precisión la zona especificada. En escenas complejas, múltiples ajustes de los comandos pueden optimizar los resultados. - cambio de estilo

Se admite la edición estilizada, por ejemplo, "convertir imagen a estilo pixel art" o "cambiar a estilo Miyazaki". El modelo se difumina para producir una imagen estilizada. - Demostración en línea

Visita el espacio Hugging Face (https://huggingface.co/spaces/stepfun-ai/Step1X-Edit), sube una imagen, introduce las instrucciones y experimenta directamente. Cada generación está limitada por el tiempo de GPU y los usuarios gratuitos tienen dos intentos.

advertencia

- requisitos de hardwareLa versión cuantificada FP8 puede reducirse a 16 GB de memoria para GPU como la 3090 Ti.

- Optimización de comandosLa edición compleja requiere instrucciones detalladas, como "cambiar el fondo por montañas nevadas, mantener los personajes en primer plano sin cambios".

- Apoyo comunitarioEl repositorio de GitHub cuenta con una comunidad activa, así que echa un vistazo a Temas o Debates si tienes problemas.

escenario de aplicación

- creación de contenidos

Los diseñadores utilizan Step1X-Edit para cambiar rápidamente los fondos o ajustar los estilos de los materiales publicitarios. Por ejemplo, cambie el fondo de una foto de producto a un tema navideño para mejorar el atractivo visual. - Edición fotográfica personal

Los usuarios normales pueden embellecer sus fotos, por ejemplo eliminando el desorden del fondo o cambiando una foto diurna por una nocturna, mediante demostraciones en línea que son fáciles de usar y no requieren conocimientos profesionales. - Optimización de productos de comercio electrónico

Las plataformas de comercio electrónico utilizan Step1X-Edit para generar imágenes de exposición de productos en distintos escenarios, como colocar la ropa sobre un fondo de playa o ciudad para ahorrar costes de rodaje. - investigación académica

Los investigadores utilizan el conjunto de datos GEdit-Bench y las ponderaciones de los modelos para desarrollar nuevos algoritmos de edición de imágenes o comparar el rendimiento de los modelos.

CONTROL DE CALIDAD

- ¿Qué resoluciones admite Step1X-Edit?

Admite resoluciones de 512x512 y 1024x1024. 512x512 es más rápido y requiere menos memoria; 1024x1024 es más detallado y requiere más memoria. - ¿Cómo puedo optimizar mis resultados de edición?

Utilice instrucciones específicas y evite las descripciones vagas. Probar varias veces con una redacción diferente puede mejorar los resultados. Por ejemplo, "cambia el cielo por una puesta de sol roja" es más claro que "cambia el cielo". - ¿Admite comandos en chino?

Sí, el modelo admite comandos en chino con resultados comparables a los del inglés. Se recomienda describir los requisitos en un lenguaje conciso. - FP8 ¿Cuál es la diferencia entre las versiones cuantificadas?

La versión FP8 requiere menos memoria (16 GB para funcionar), pero puede sacrificar ligeramente los detalles. Ideal para usuarios con recursos de hardware limitados. - ¿Necesita estar conectado en red para funcionar?

No se requiere conexión a Internet para ejecutarlo localmente. Las demostraciones en línea requieren acceso al espacio Hugging Face.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...