StableAnimator: genera animaciones de vídeo de alta calidad que mantienen los rasgos del personaje.

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 54.1K 00

Introducción general

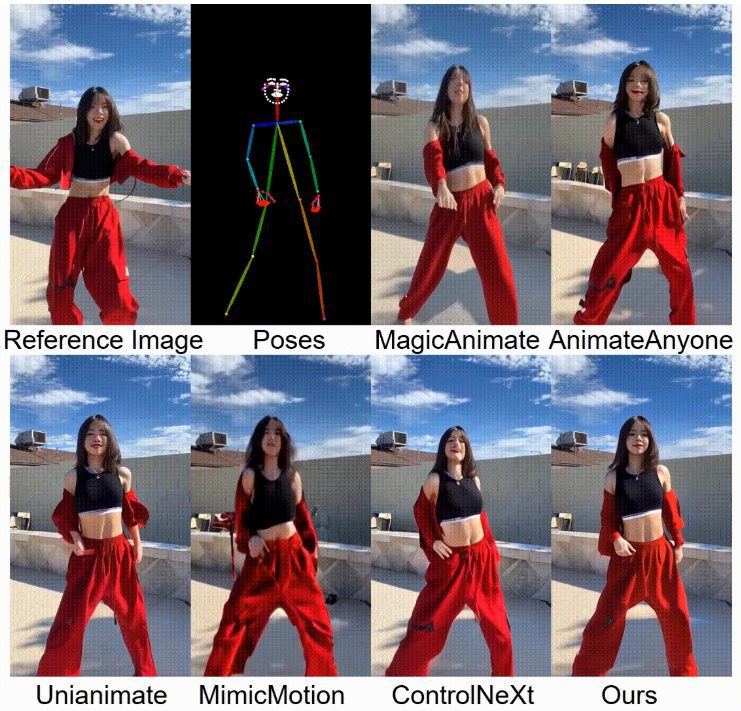

StableAnimator es un innovador marco de difusión de vídeo de extremo a extremo que preserva la identidad y es capaz de sintetizar vídeo de alta calidad a partir de una imagen de referencia y una serie de poses sin ningún postprocesamiento. Desarrollado en colaboración con investigadores de la Universidad de Fudan, Microsoft Research Asia, Huya Inc y la Universidad Carnegie Mellon, StableAnimator garantiza la coherencia de la identidad del vídeo. identidad en vídeo. El marco obtiene buenos resultados en múltiples pruebas comparativas y genera animaciones de retratos de alta fidelidad que preservan la identidad.

Lista de funciones

- Conservación de la identidad Generación de vídeosGeneración de vídeos de alta calidad basados en imágenes de referencia y secuencias de poses para garantizar la coherencia de la identidad.

- Sin tratamiento posterior: El vídeo resultante no requiere postprocesamiento con ninguna herramienta de intercambio de caras ni modelos de restauración facial.

- Codificador facial global sensible al contenidoOptimización adicional de la incrustación facial mediante la interacción con la incrustación de imágenes.

- Adaptador de identidad consciente de la distribución: Evita las interferencias de la capa temporal manteniendo la coherencia de la identidad.

- Optimización Hamilton-Jacobi-Bellman: La calidad facial se mejora aún más resolviendo la ecuación HJB durante el proceso de razonamiento.

Utilizar la ayuda

Proceso de instalación

- almacén de clonesClone el repositorio de StableAnimator ejecutando el siguiente comando en un terminal:

git clone https://github.com/Francis-Rings/StableAnimator.git

- Instalación de dependenciasVaya al directorio del repositorio e instale las dependencias necesarias:

cd StableAnimator

pip install -r requirements.txt

- Ejecutar la aplicación: Utilice el siguiente comando para iniciar la aplicación:

python app.py

Proceso de utilización

- Preparación de imágenes de referencia y secuencias de posesAsegúrate de tener una imagen de referencia y una serie de imágenes de pose que se utilizarán para generar la animación.

- Ejecución de scripts de inferencia: Utilice el siguiente comando para ejecutar el script de inferencia para generar la animación de vídeo:

python inference_basic.py --reference_image path_to_reference_image --pose_sequence path_to_pose_sequence

- Ver resultados generadosEl vídeo generado se guardará en el directorio de salida especificado y podrás ver el resultado con cualquier reproductor de vídeo.

Funcionamiento detallado

- Conservación de la identidad Generación de vídeosStableAnimator : Al proporcionar una imagen de referencia y una secuencia de poses, StableAnimator es capaz de generar animaciones de vídeo de alta calidad, garantizando que la identidad de las personas en el vídeo es coherente con la imagen de referencia.

- Codificador facial global sensible al contenidoMódulo de incrustación facial: este módulo optimiza aún más la incrustación facial interactuando con la incrustación de imágenes para garantizar una alta fidelidad de los detalles faciales en el vídeo generado.

- Adaptador de identidad consciente de la distribución: Durante la generación del vídeo, el módulo garantiza la coherencia de la identidad en el vídeo mediante técnicas de alineación que evitan las interferencias de la capa temporal.

- Optimización Hamilton-Jacobi-BellmanLa calidad y la coherencia de las caras en el vídeo generado se mejoran aún más resolviendo la ecuación HJB durante el proceso de inferencia.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...