Stable Diffusion WebUI Forge: modelos de generación de imágenes optimizados y acelerados

Últimos recursos sobre IAPublicado hace 2 años Círculo de intercambio de inteligencia artificial 81.3K 00

Introducción general

Stable Diffusion WebUI Forge es una plataforma construida sobre Stable Diffusion WebUI (versión Gradio) para simplificar el proceso de desarrollo, optimizar la gestión de recursos y acelerar el procesamiento de inferencias. Entre las funciones que ofrece Forge se incluyen la aceleración del razonamiento en la GPU, la optimización de la gestión de recursos, nuevas formas de simplificar la integración de parches de UNet, mayor comodidad de desarrollo y gestión automatizada de recursos. Además, los desarrolladores han proporcionado ejemplos de extensiones ControlNet para ayudar a los usuarios a desarrollar sus propias funciones.

Lista de funciones

Aceleración de la inferencia en la GPU

Optimización de la gestión de recursos

Parches UNet: un nuevo enfoque de la integración

Fácil desarrollo de ampliaciones

Gestión automatizada de recursos

Utilizar la ayuda

Visite el repositorio GitHub para obtener el código más reciente

Instalar y ejecutar según la documentación

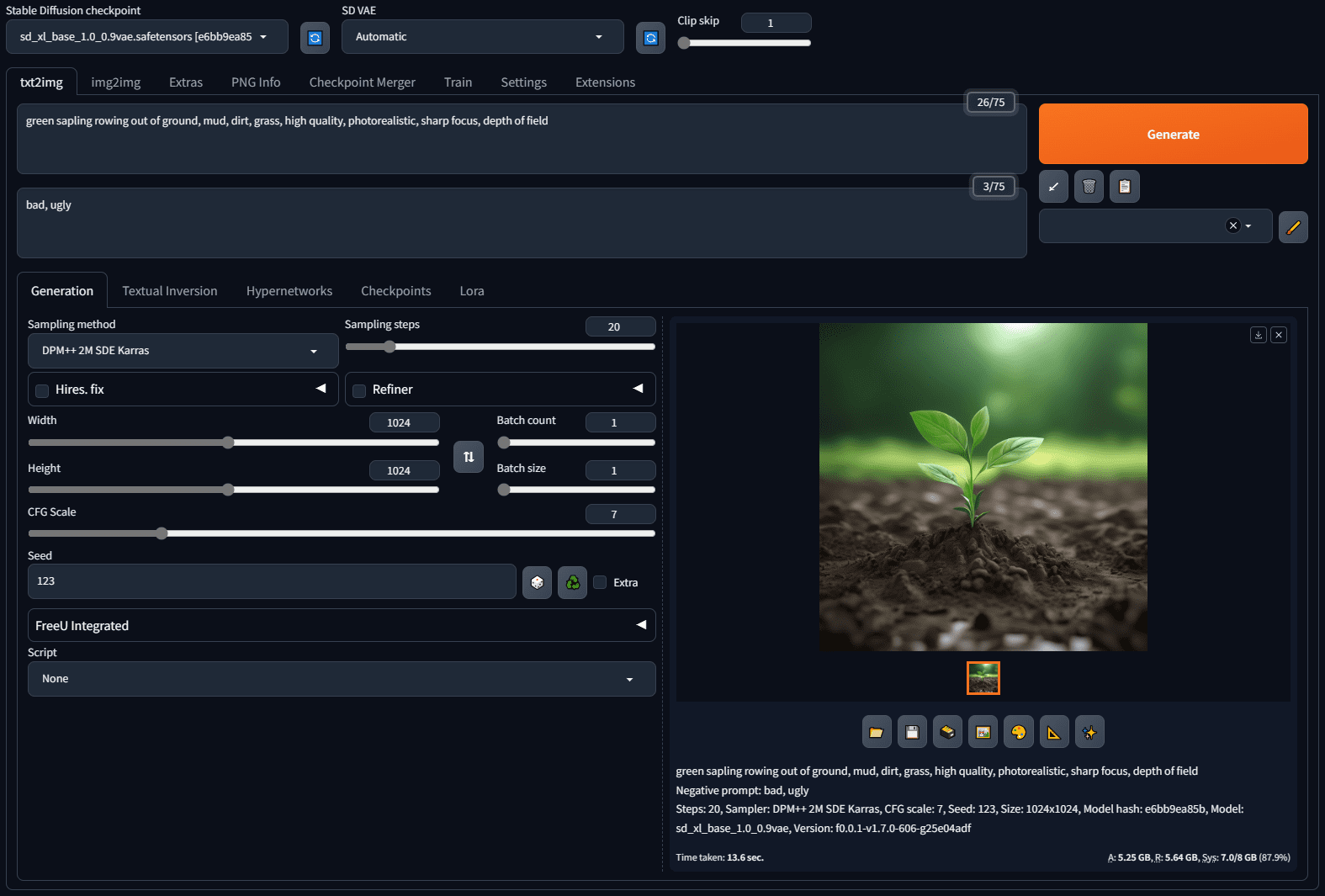

Generación de imágenes con Stable Diffusion WebUI Forge

Desarrollo de extensiones personalizadas con parches UNet y ejemplos ControlNet

Comparado con la WebUI original (para inferencia SDXL a 1024px), puedes esperar los siguientes aumentos de velocidad:

Si utilizas una GPU común, como 8 GB de RAM, puedes esperar un aumento de la velocidad de inferencia (it/s) de ~30~45%, el pico de memoria de la GPU (en el Administrador de tareas) se reducirá de ~700 MB a 1,3 GB, la resolución máxima de difusión (cuando no se produzca salida de memoria) aumentará de ~2x a 3x y el tamaño máximo del lote de difusión (cuando no se produzca salida de memoria) aumentará de ~2x a 3x. La resolución máxima de difusión (sin que se produzcan pérdidas de memoria) aumentará entre 2 y 3 veces, y el tamaño máximo del lote de difusión (sin que se produzcan pérdidas de memoria) aumentará entre 4 y 6 veces.

Si utilizas una GPU de menor rendimiento, como 6 GB de RAM, puedes esperar un aumento de la velocidad de inferencia (it/s) de ~60~75%, un descenso de la memoria máxima de la GPU (en el Administrador de tareas) de ~800 MB a 1,5 GB, un aumento de la resolución máxima de difusión (sin ocurrencias fuera de memoria) de ~3 veces y un aumento del tamaño máximo del lote de difusión (sin ocurrencias fuera de memoria) de ~3 veces. La resolución máxima de difusión (sin ocurrencias fuera de memoria) aumentará en un factor de aproximadamente 3, y el tamaño máximo del lote de difusión (sin ocurrencias fuera de memoria) aumentará en un factor de aproximadamente 4.

Si utilizas una GPU de alto rendimiento como la 4090 con 24 GB de memoria de vídeo, puedes esperar un aumento de la velocidad de inferencia (it/s) de aproximadamente 3~6%, un descenso de la memoria máxima de la GPU (en el Administrador de tareas) de aproximadamente 1 GB a 1,4 GB, un aumento de la resolución máxima de difusión (sin que se produzcan salidas de memoria) de aproximadamente 1,6 veces y un aumento del tamaño máximo del lote de difusión (sin que se produzcan salidas de memoria) de aproximadamente el doble. fuera de memoria) aumentará aproximadamente 2 veces.

Si utiliza ControlNet con SDXL, el recuento máximo de ControlNet (sin salida de memoria) aumentará unas 2 veces, y la velocidad con SDXL+ControlNet aumentará unos 30~45%.

Otro cambio muy importante traído por Forge es el Unet Patcher, usando el Unet Patcher, métodos como Self-Attention Guidance, Kohya High Res Fix, FreeU, StyleAlign, Hypertile, etc. pueden ser implementados en unas 100 líneas de código. utilizando el Unet Patcher.

Gracias a Unet Patcher, muchas cosas nuevas son ahora posibles y soportadas en Forge, incluyendo SVD, Z123, Ip-adaptador enmascarado, controlnet enmascarado, photomaker y más.

Se acabó el "monkeypatching" de UNet y los conflictos con otras extensiones.

Forge también ha añadido una serie de muestreadores que incluyen, entre otros, DDPM, DDPM Karras, DPM++ 2M Turbo, DPM++ 2M SDE Turbo, LCM Karras, Euler A Turbo, y más (LCM ha estado en el webui original desde 1.7.0).

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...