Implantación en línea del modelo de código abierto DeepSeek-R1 con potencia de GPU gratuita

Tutoriales prácticos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 66.2K 00

Gracias a Tencent Cloud Cloud Studio y DeepSeek DeepSeek-R1.

Con el rápido desarrollo de las tecnologías de IA y Big Model, cada vez son más los desarrolladores e investigadores que desean experimentar y poner a punto Big Models por sí mismos para comprender y aplicar mejor estas avanzadas tecnologías. Sin embargo, el elevado coste de la aritmética en la GPU a menudo se convierte en un cuello de botella que impide a todos explorar. Afortunadamente, Tencent Cloud Studio proporciona recursos aritméticos de GPU gratuitos y, combinados con los big models DeepSeek-R1 introducidos por DeepSeek, podemos implantar y ejecutar fácilmente estos potentes modelos en la nube sin gastar ni un céntimo.

En este artículo se explica cómo utilizar Tencent Cloud Estudio en la nube de recursos GPU gratuitos para desplegar e interactuar con el macromodelo DeepSeek-R1. Comenzaremos con el uso de Cloud Studio e iremos paso a paso a través de la instalación y configuración de Ollama, mostrando cómo desplegar el macromodelo DeepSeek-R1. DeepSeek-R1 y habla con él, y acabarás con un DeepSeek-R1 completo y gratuito + un conjunto de Código Roo Programa de cartera de programación gratuita.

1. Cloud Studio

1.1 Introducción a Cloud Studio

Tencent Cloud Cloud Studio es un entorno de desarrollo integrado (IDE) basado en la nube que proporciona una gran cantidad de herramientas y recursos de desarrollo para ayudar a los desarrolladores a codificar, depurar y desplegar de forma más eficiente. Recientemente, Cloud Studio lanzó recursos gratuitos de computación GPU, los usuarios pueden utilizar 10.000 minutos de servidores GPU de forma gratuita cada mes, configurado con 16G de memoria de vídeo, 32G de RAM y CPU de 8 núcleos. esto es sin duda una gran ayuda para los desarrolladores que necesitan recursos de computación de alto rendimiento. (Recuerde que debe apuntar a cerrar la máquina después de su uso, la próxima puesta a punto y luego abrirlo, el medio ambiente se guarda automáticamente, 10.000 minutos al mes simplemente no se puede agotar)

1.2 Registro e inicio de sesión

Para utilizar Cloud Studio, primero tienes que registrar una cuenta de Tencent Cloud. Una vez completado el registro, inicie sesión en Cloud Studio y verá una interfaz de usuario limpia que ofrece una variedad de plantillas de desarrollo para elegir. Estas plantillas cubren una amplia gama de escenarios, desde el desarrollo básico en Python hasta complejas implementaciones de grandes modelos. Recuerde introducir la versión Pro.

1.3 Selección de la plantilla Ollama

Dado que nuestro objetivo es desplegar DeepSeek-R1 modelo grande, así que podemos elegir Ollama Plantillas.Ollama es una herramienta de gestión y ejecución de grandes modelos que simplifica el proceso de descarga, instalación y ejecución de modelos. Tras seleccionar una plantilla Ollama, Cloud Studio configura automáticamente el entorno Ollama por nosotros, eliminando la necesidad de instalación manual.

Espere a que arranque, haga clic en enter (Ollama ya está desplegado en el entorno, sólo tiene que ejecutar el comando de instalación directamente)

2. Ollama

2.1 Introducción a Ollama

Ollama es una herramienta de código abierto dedicada a la gestión y ejecución de modelos de gran tamaño. Soporta una gran variedad de formatos de modelos y puede manejar automáticamente las dependencias de los modelos , haciendo que el despliegue y la ejecución de los modelos sea muy simple.El sitio web oficial de Ollama proporciona una gran cantidad de recursos de modelos , los usuarios pueden elegir el modelo adecuado de acuerdo a sus necesidades para descargar y ejecutar .

2.2 Parámetros del modelo y selección

En el sitio web oficial de Ollama, el número de parámetros de cada modelo está marcado en la parte inferior de cada modelo, como 7B, 13B, 70B, etc. Aquí la "B" significa billón. Aquí la "B" significa mil millones, lo que indica el número de parámetros del modelo. Cuanto mayor es el número de parámetros, mayor es la complejidad y la capacidad del modelo, pero también consume más recursos informáticos.

Para los recursos de GPU gratuitos proporcionados por Tencent Cloud Studio (16G de memoria de vídeo, 32G de RAM, CPU de 8 núcleos), podemos elegir modelos de 8B o 13B para su implementación. Si tienes una configuración de hardware superior, también puedes probar modelos con parámetros más grandes para obtener mejores resultados.

2.3 Instalación de Ollama

Después de seleccionar la plantilla de Ollama en Cloud Studio, el sistema instalará automáticamente Ollama por nosotros. si está utilizando Ollama en otros entornos, puede instalarlo con el siguiente comando:

curl -fsSL https://ollama.com/install.sh | shUna vez finalizada la instalación, puede comprobar que Ollama se ha instalado correctamente mediante el siguiente comando:

ollama --versionEl siguiente paso es que Ollama despliegue DeepSeek-R1...

3. Despliegue gratuito de DeepSeek-R1

3.1 Introducción a DeepSeek-R1

DeepSeek-R1 es un gran modelo de alto rendimiento de DeepSeek que ofrece buenos resultados en diversas tareas de procesamiento del lenguaje natural, especialmente en las áreas de generación de textos, sistemas de diálogo y preguntas y respuestas. El número de parámetros de DeepSeek-R1 oscila entre 8B y 70B, lo que permite a los usuarios elegir el modelo adecuado para su implementación en función de su configuración de hardware.

3.2 Descarga y despliegue

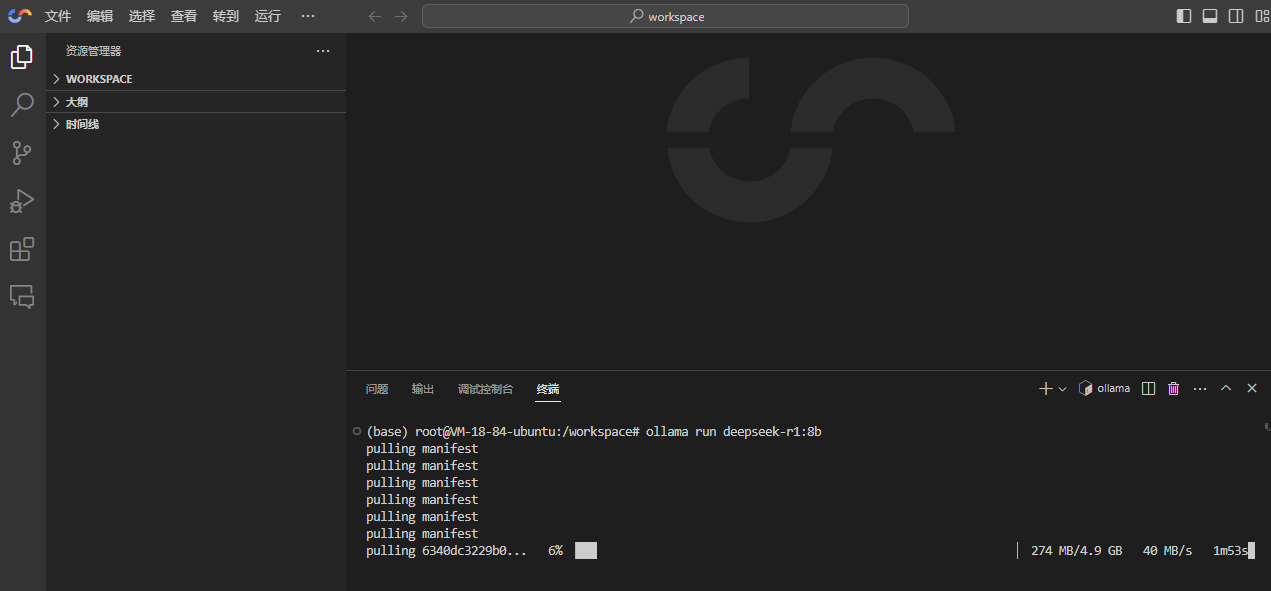

Desplegar DeepSeek-R1 es muy sencillo puesto que Cloud Studio ya instala Ollama automáticamente. Solo tenemos que ejecutar el siguiente comando:

ollama run deepseek-r1:8b

Todos los modelos disponibles para DeepSeek-R1 están aquí: https://ollama.com/library/deepseek-r1 , ¡recomendado! ollama run deepseek-r1:14b (Este es el modelo Qwen destilado).

3.3 Ejecuciones del modelo

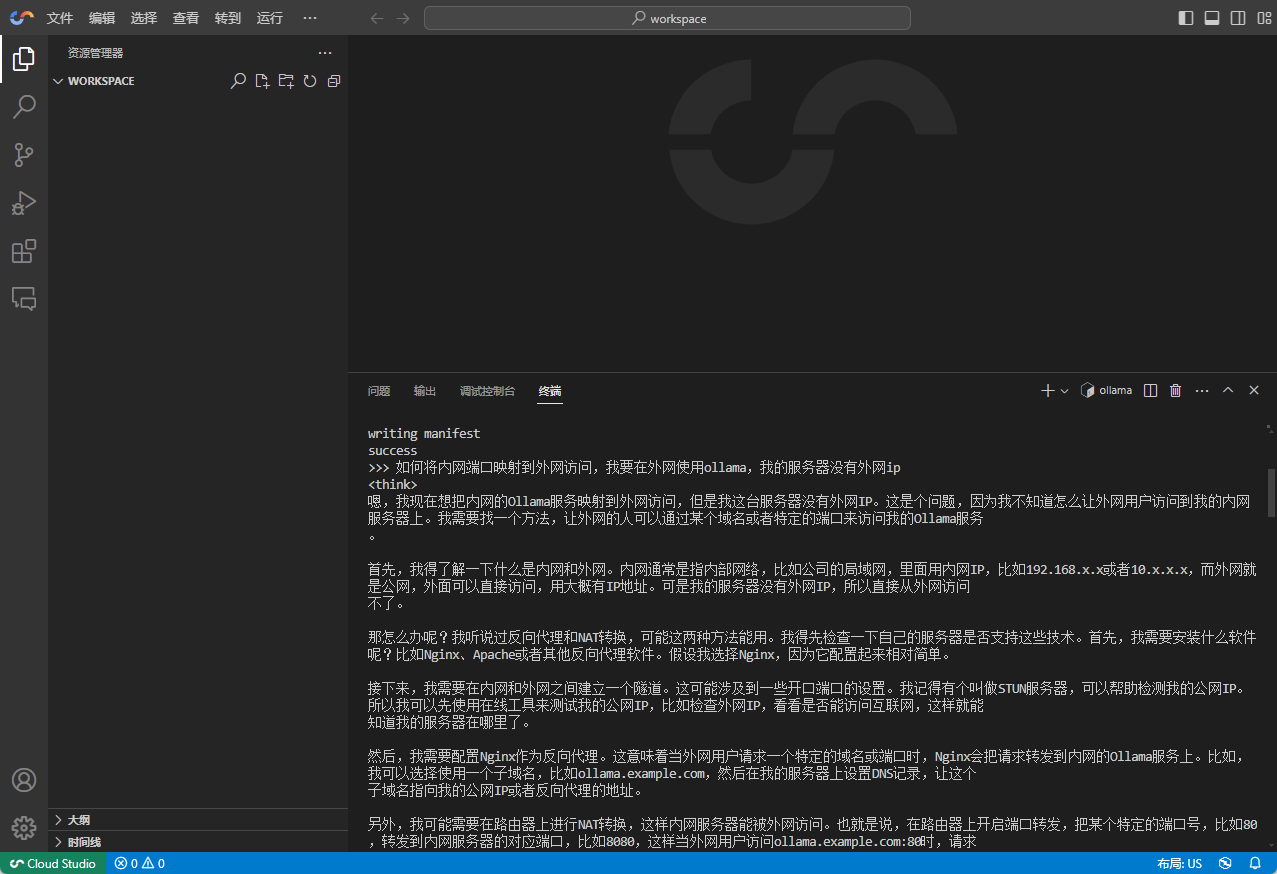

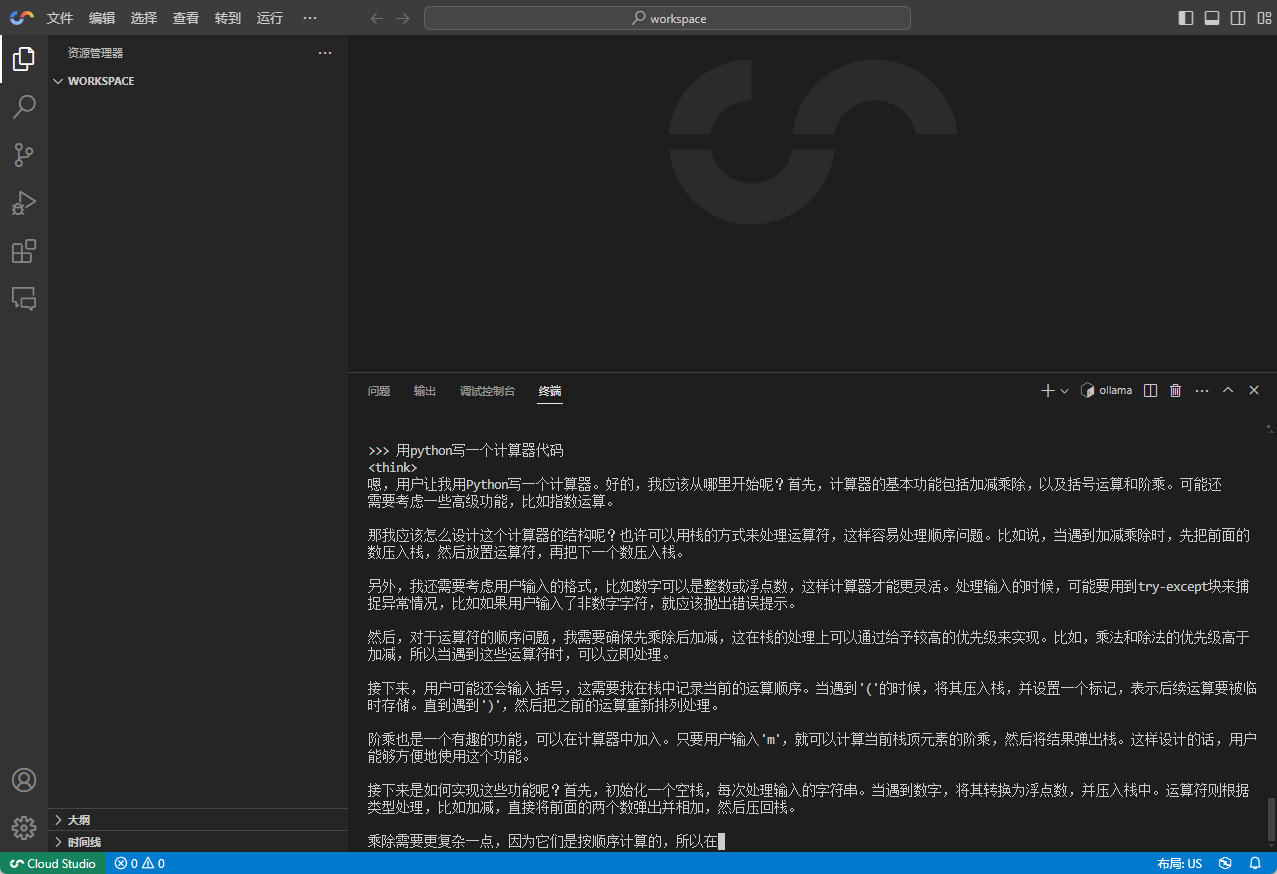

Después de esperar a que el modelo termine de descargarse, Ollama iniciará automáticamente DeepSeek-R1 y entrará en modo interactivo. En este punto, puede introducir preguntas o comandos directamente en el terminal para hablar con DeepSeek-R1.

4. Empieza a chatear con DeepSeek-R1

4.1 Diálogo básico

El diálogo con DeepSeek-R1 es muy sencillo, basta con introducir la pregunta o instrucción en el terminal y el modelo generará una respuesta inmediatamente.

4.2 Tareas complejas

- Por ejemplo, la generación de código con DeepSeek-R1

4.3 Ajuste del modelo

Si no está satisfecho con el rendimiento de DeepSeek-R1 o quiere que el modelo funcione mejor en algunas tareas específicas, puede intentar ajustar el modelo. El proceso de ajuste fino suele implicar la preparación de algunos conjuntos de datos específicos del dominio y el reentrenamiento del modelo utilizando estos conjuntos de datos.Ollama proporciona interfaces sencillas para ayudar a los usuarios a realizar el ajuste fino del modelo.

4.4 Uso en herramientas de programación de IA

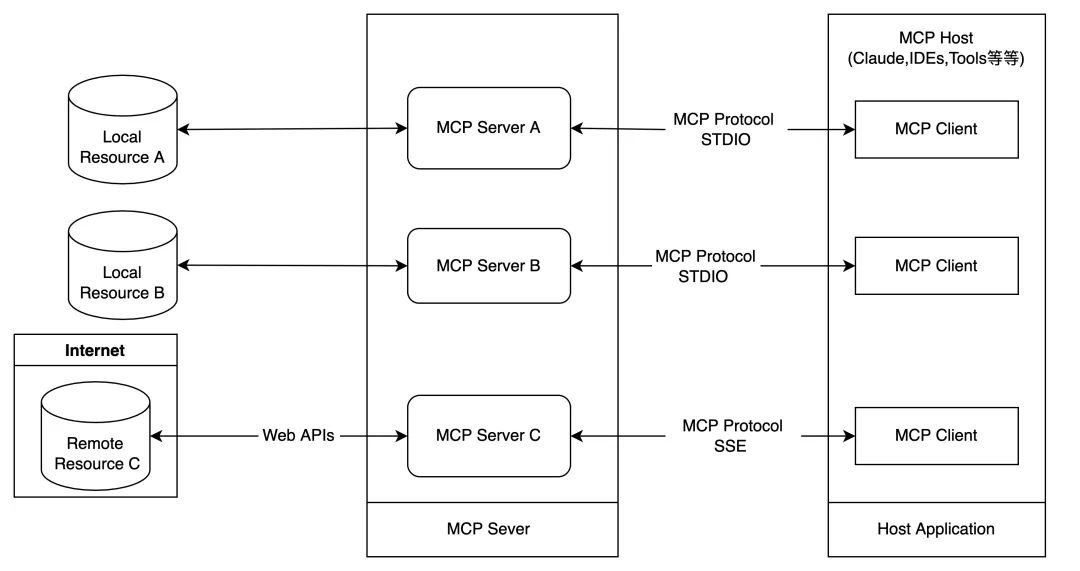

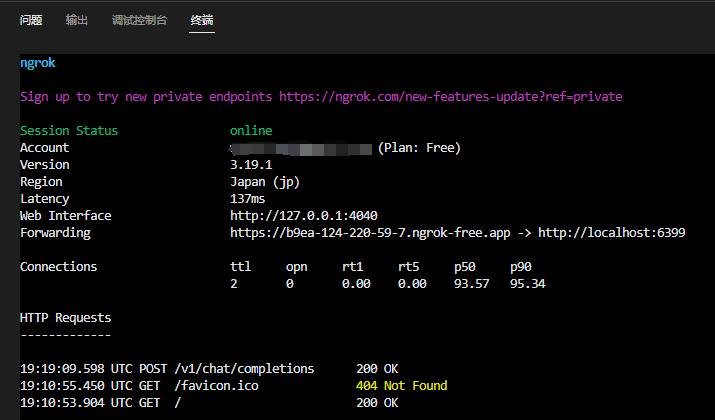

Usarlo en el terminal no es ciertamente el escenario principal, queremos usar el servicio en otras herramientas de chat o herramientas de programación de IA para ser prácticos. Cloud Studio no proporciona una dirección de acceso externa. En este caso, ngrok/Cpolar es una buena solución.

Sólo proporcionar ideas, no una explicación detallada: el primer paso para consultar el puerto de la intranet Ollama, el segundo paso para instalar ngrok, el tercer paso para asignar el puerto Ollama a ngrok, iniciar el servicio se obtiene la siguiente dirección:

Nota: Se supone que su ollama serve El servicio ya está en 6399 puede utilizar el siguiente comando para iniciar Ngrok y asignar el puerto a la extranet:ngrok http 6399

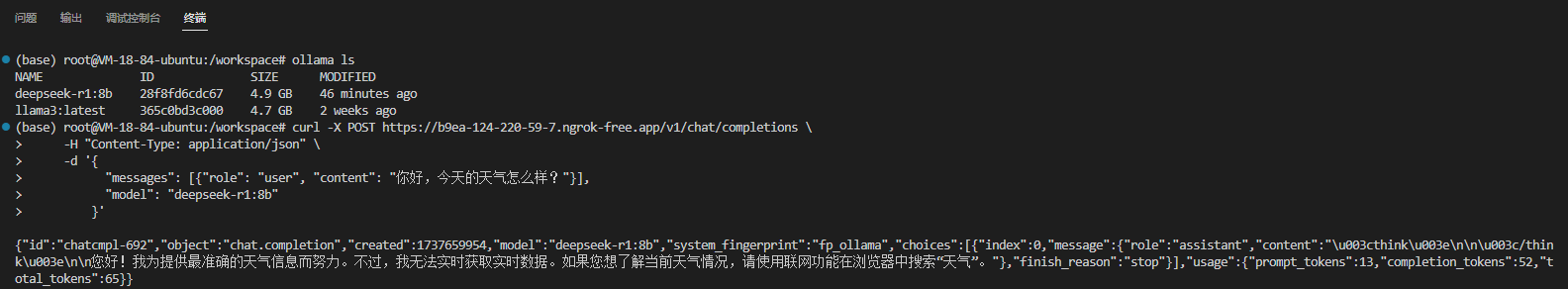

Compruebe que la extranet funciona: (para empalmar la dirección completa)

Recomendamos utilizar un complemento nativo del navegador para experimentar las funciones relacionadas con Ollama. Ayuda de página : (rellene directamente https://xxx.ngrok-free.app/ para cargar automáticamente todos los modelos de Ollama)

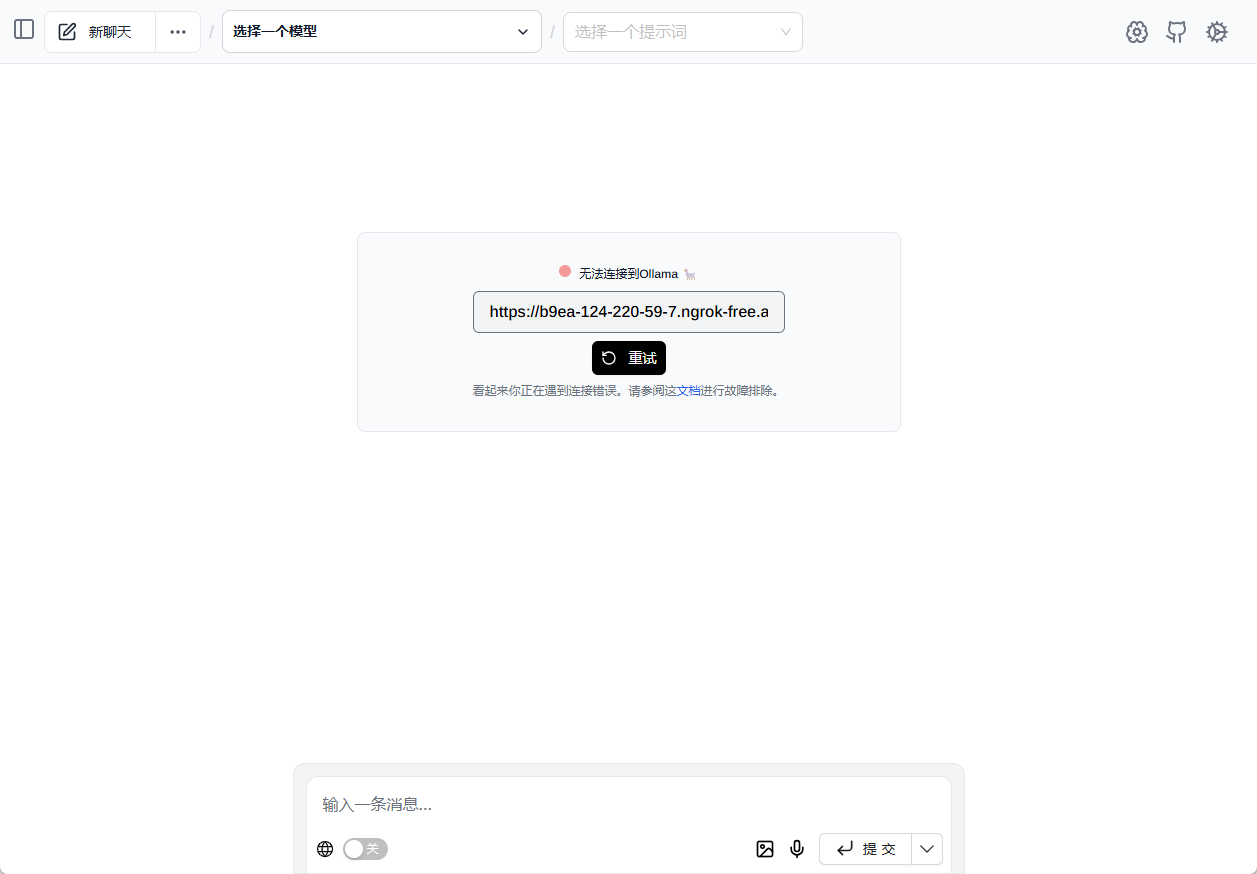

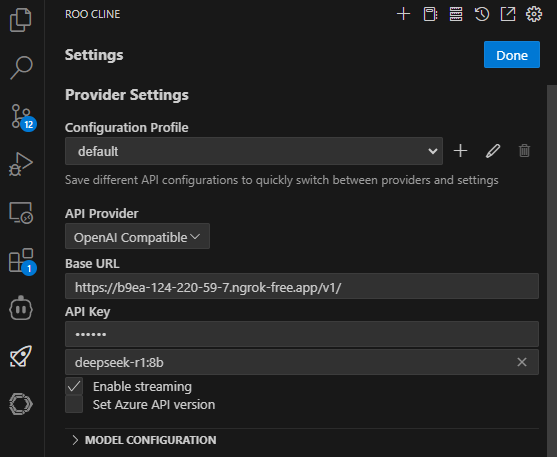

existe Código Roo (Roo Cline) Configurar la API en el cliente: (Roo Code es un excelente plugin de programación de IA)

Observe que se ha añadido v1 a la URL original y a la CLAVE de la API.

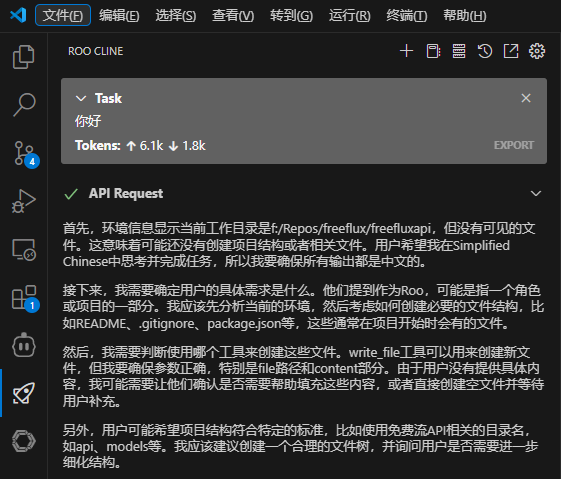

Guarda y prueba el diálogo:

5. Resumen

Con los recursos de GPU gratuitos de Tencent Cloud Cloud Studio, combinados con Ollama y DeepSeek-R1, podemos implementar y ejecutar fácilmente grandes modelos en la nube sin preocuparnos por los elevados costes de hardware. Tanto si estás manteniendo una simple conversación como trabajando en una tarea compleja, DeepSeek-R1 proporciona un potente soporte. Esperamos que este artículo pueda ayudarle a desplegar DeepSeek-R1 sin problemas y comenzar su viaje de exploración de grandes modelos.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...