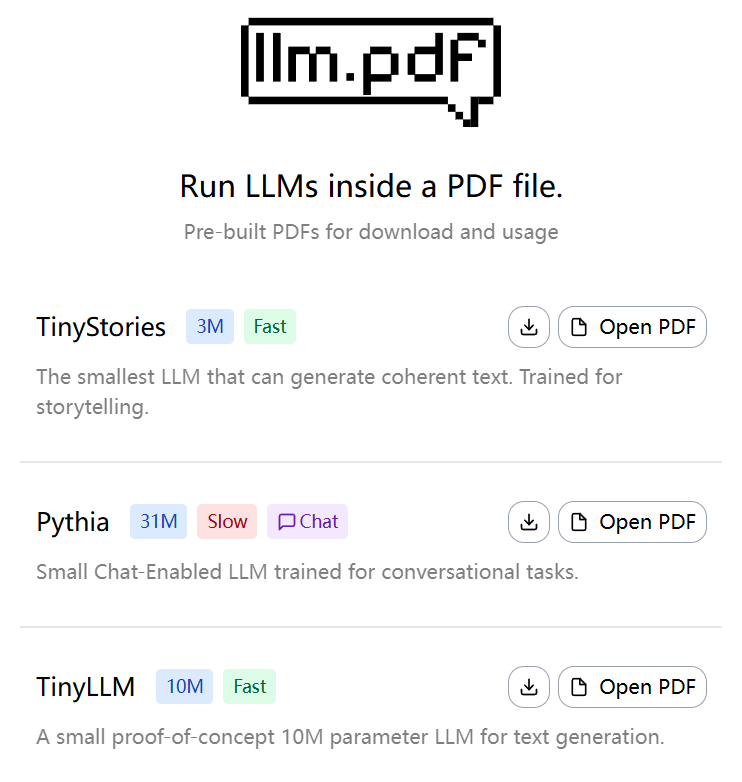

RLAMA: un sistema RAG de interrogación inteligente de documentos locales operado desde la línea de comandos

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 62.2K 00

Introducción general

RLAMA es un sistema RAG (Retrieval Augmentation Generation) de inteligencia documental desarrollado por DonTizi y alojado en GitHub, cuya característica principal es la funcionalidad mediante operaciones de línea de comandos. Los usuarios pueden conectarse a Ollama que indexa rápidamente documentos en carpetas en una base de conocimientos interactiva con preguntas y respuestas inteligentes. Ya se trate de un archivo de código, un documento técnico o un documento ofimático, RLAMA está a la altura de las circunstancias y se ejecuta de forma completamente local, eliminando la necesidad de servicios en la nube y salvaguardando la privacidad de los datos. Con soporte para múltiples formatos de archivo y una instalación sencilla, RLAMA es una opción potente para la gestión localizada de documentos, especialmente para desarrolladores y entusiastas de la tecnología acostumbrados a las operaciones de línea de comandos.

Lista de funciones

- Creación de un sistema RAG en la línea de comandos: Genera una base de conocimientos de cuestionarios inteligentes indexando documentos de carpetas con comandos.

- Preguntas y respuestas sobre la interacción con la línea de comandos: Utiliza la sesión de terminal para consultar los RAG El contenido del documento en el sistema.

- Administración del sistema RAG: Mantenga fácilmente la base de conocimientos listando y borrando sistemas RAG con comandos.

- Integración del modelo local: Se conecta sin problemas a los modelos locales de Ollama, manteniendo una localización completa.

- Gestión de versiones y actualizaciones: Utilice el comando para comprobar la versión o actualizar el sistema al estado más reciente.

- Soporte multiformato: Compatible con una amplia gama de formatos, incluidos texto, código y documentos ofimáticos.

- Desinstalación por línea de comandos: Proporciona datos y herramientas de limpieza de comandos.

Utilizar la ayuda

Proceso de instalación

RLAMA es una implementación de línea de comandos de Document Intelligence Quiz para macOS, Linux y Windows, y se detallan los siguientes pasos:

1. Condiciones previas

- Instalar OllamaEl modelo Ollama debe ejecutarse localmente. Visite el sitio web de Ollama para descargarlo e instalarlo, ejecute el programa

ollama run llama3(u otros modelos) para confirmar disponibilidad, dirección por defectohttp://localhost:11434. - conexión de redLa instalación requiere una conexión a Internet para descargar scripts o dependencias.

- Dependencias opcionalesPara admitir más formatos (p. ej., .pdf, .docx), se recomienda ejecutar el comando

install_deps.shHerramientas de instalación (por ejemplopdftotext).

2. Instalación mediante script de línea de comandos (recomendado)

Introdúcelo en el terminal:

curl -fsSL https://raw.githubusercontent.com/dontizi/rlama/main/install.sh | sh

- El script completa automáticamente la descarga y la configuración y, cuando termina, ejecuta la aplicación

rlama --versionCompruebe la versión (por ejemplov0.1.0) Confirmación del éxito.

3. Instalación manual del código fuente (opcional)

Si se requiere personalización:

- Almacén de clonación:

git clone https://github.com/DonTizi/rlama.git cd rlama - Compilar e instalar (requiere entorno Go):

go build go install - Mueva el ejecutable al PATH (p. ej.

/usr/local/bin), ejecuterlama --helpValidación.

4. Verificación de la instalación

Corriendo:

rlama --help

La visualización de una lista de comandos se considera correcta.

Funciones principales

Creación de un sistema RAG desde la línea de comandos

Convierta los documentos en una base de conocimientos de cuestionarios inteligentes. Por ejemplo, la carpeta ./docs abarcar readme.md responder cantando guide.pdf::

- Asegúrese de que el modelo Ollama se ejecuta (p. ej.

ollama run llama3). - Introduce el comando:

rlama rag llama3 mydocs ./docsllama3Nombre del modelo.mydocsNombre del sistema RAG../docs: Ruta del documento.

- Ejemplo de salida:

Indexing documents in ./docs... Processed: readme.md Processed: guide.pdf RAG system "mydocs" created successfully!

Preguntas y respuestas interactivas a través de la línea de comandos

Consultar el sistema GAR existente:

- Comienza la sesión:

rlama run mydocs - Introduzca la pregunta:

如何安装 rlama? - Obtenga respuestas:

可通过终端运行 `curl -fsSL https://raw.githubusercontent.com/dontizi/rlama/main/install.sh | sh` 安装。 - importación

exitSalida.

Gestión del sistema RAG

- Sistema de listado::

rlama listMuestra de salida:

Available RAG systems: - mydocs - Borrar el sistema::

rlama delete mydocsu omitir la confirmación:

rlama delete mydocs --force

Versiones y actualizaciones

- Comprobar versión::

rlama --versiontal vez

rlama -vLa visualización es la siguientev0.1.0. - Actualizar el sistema::

rlama update(botánica) coca (préstamo)

--forceActualizaciones obligatorias.

Desinstalación del sistema

- Herramientas de extracción::

rlama uninstall - Limpieza de datos: Los datos se almacenan en el

~/.rlamaCorre:rm -rf ~/.rlama

Funciones destacadas

1. Operaciones desde la línea de comandos

Todas las funciones de rlama se implementan a través de la línea de comandos, lo que resulta sencillo y eficaz. Por ejemplo, una línea de comandos rlama rag mistral docs ./project Indexa instantáneamente carpetas enteras, apto para usuarios que dominan la línea de comandos.

2. Compatibilidad con documentos multiformato

Se admiten varios tipos de archivos:

- Texto:

.txty.mdy.htmly.jsony.csvetc. - Código:

.goy.pyy.jsy.javay.cppetc. - Documentación:

.pdfy.docxy.pptxy.xlsxetc.

estar en movimiento./scripts/install_deps.shApoyo reforzado. Ejemplo:

rlama rag gemma code-docs ./src

3. Funcionamiento localizado

Los datos se procesan localmente en todo momento, sin necesidad de la nube, adecuado para documentos sensibles. Por ejemplo, indexación de documentos confidenciales de la empresa:

rlama rag llama3 contracts ./legal

Consejos y resolución de problemas

- Mando de precisión: Introduzca el parámetro completo, por ejemplo

rlama run mydocsen lugar de taquigrafía para garantizar la precisión. - Asunto OllamaSi la conexión falla, compruebe el

http://localhost:11434Ejecutarollama psVer estado. - Soporte de formatosSi la extracción falla, ejecute

install_deps.shInstale la dependencia. - Mala respuesta: Confirme que el documento está indexado e intente ser más específico sobre el problema.

- petición (de ayuda): Las incidencias se pueden enviar a GitHub Issues con comandos y versiones.

Con los comandos anteriores, los usuarios pueden dominar rápidamente rlama, gestionar documentos locales y aplicar preguntas y respuestas inteligentes.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...