Research Rabbit: investigación web y redacción de informes utilizando LLM nativo, profundizando automáticamente en temas especificados por el usuario y generando resúmenes.

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 68.8K 00

Introducción general

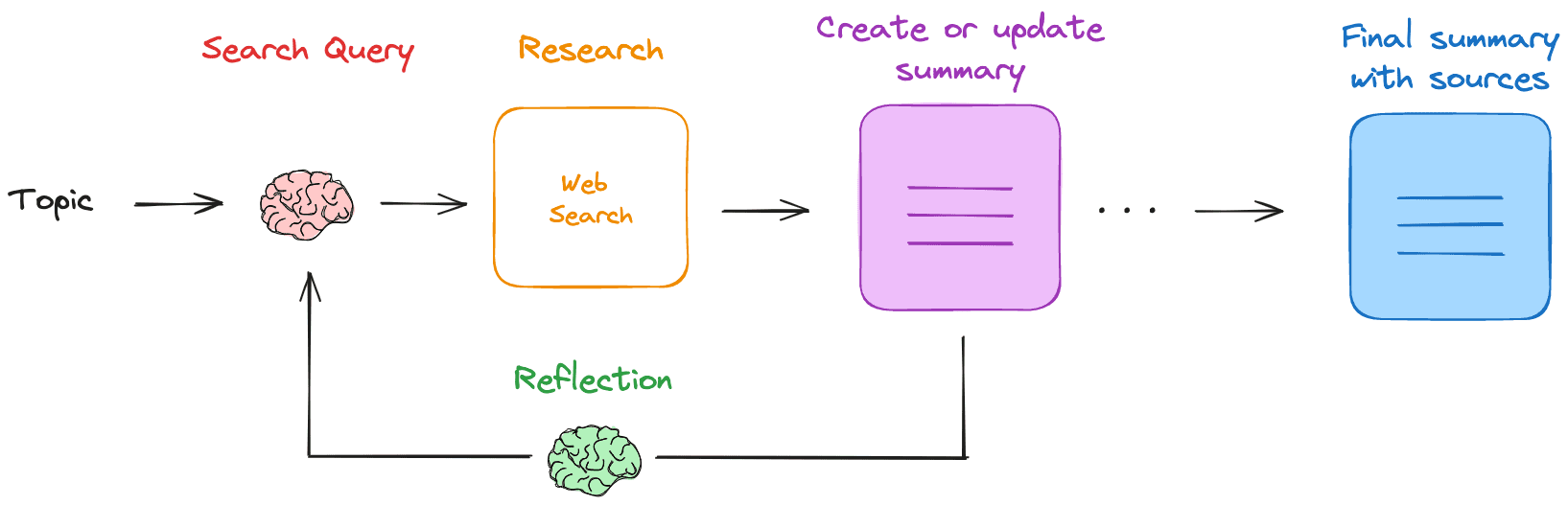

Research Rabbit es un asistente nativo de investigación y resumen web basado en LLM (Large Language Model). Después de que el usuario proporcione un tema de investigación, Research Rabbit genera una consulta de búsqueda, obtiene resultados web relevantes y los resume. Repite este proceso, rellena las lagunas de conocimiento y, por último, genera un resumen Markdown que incluye todas las fuentes. La herramienta se ejecuta de forma totalmente local, lo que garantiza la privacidad y seguridad de los datos.

Lista de funciones

- Generar consultas de búsquedaGeneración de consultas de búsqueda basadas en temas proporcionados por el usuario.

- Búsqueda en la Web: Utilice un motor de búsqueda configurado (por ejemplo, Tavily) para encontrar los recursos pertinentes.

- Resumen de resultados: Resumir resultados de búsqueda en la web utilizando LLM local.

- resumen reflexivo: Identificar las lagunas de conocimiento y generar nuevas consultas de búsqueda.

- una actualización iterativa: Realiza repetidamente búsquedas y resúmenes para perfeccionar gradualmente la investigación.

- funcionamiento localEl objetivo es garantizar la privacidad de los datos: todas las operaciones se realizan localmente para garantizar la privacidad de los datos.

- Resumen Markdown: Genera un resumen Markdown final con todas las fuentes.

Utilizar la ayuda

Proceso de instalación

- Tirar de LLM local: Extraiga los LLM locales necesarios de Ollama, por ejemplo

ollama pull llama3.2. - Obtener clave API de TavilyRegistrar Tavily y obtener la clave API, establecer variables de entorno

export TAVILY_API_KEY=<your_tavily_api_key>. - almacén de clones: Ejecutar

git clone https://github.com/langchain-ai/research-rabbit.gitAlmacén de clonación. - Instalación de dependencias: Vaya al directorio del proyecto y ejecute

uvx --refresh --from "langgraph-cli[inmem]" --with-editable . --python 3.11 langgraph devInstale la dependencia. - Asistente de inicio: Inicie el servidor LangGraph y acceda al archivo

http://127.0.0.1:2024Consulte la documentación de la API y la interfaz web.

Proceso de utilización

- Configuración de LLMEstablece el nombre del LLM local que se utilizará en la interfaz web de LangGraph Studio (por defecto).

llama3.2). - Fijar la profundidad de la investigaciónConfigura la profundidad de las iteraciones del estudio (por defecto 3).

- Introduzca un tema de investigaciónInicie el Asistente de Investigación introduciendo el tema de investigación en la pestaña Configuración.

- Ver el procesoEl asistente genera una consulta, realiza una búsqueda en Internet, resume los resultados mediante LLM y repite el proceso.

- Obtener el resumenUna vez finalizada la investigación, el asistente genera un resumen Markdown con todas las fuentes, que el usuario puede ver y editar.

Funciones principales

- Generar consultas de búsquedaEl asistente generará automáticamente una consulta de búsqueda tras introducir un tema de investigación.

- Búsqueda en la WebEl asistente utiliza el motor de búsqueda configurado para encontrar los recursos pertinentes.

- Resumen de resultadosEl asistente utiliza el LLM local para resumir los resultados de la búsqueda y generar un informe preliminar.

- resumen reflexivoEl asistente identifica las lagunas de conocimiento en el resumen y genera nuevas consultas de búsqueda para continuar la investigación.

- una actualización iterativaEl asistente realizará búsquedas y resúmenes de forma iterativa para afinar gradualmente la investigación.

- Generación de resúmenes MarkdownUna vez finalizada la investigación, el asistente genera un resumen final en Markdown con todas las fuentes, que el usuario puede ver y editar.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...