Pyramid Flow: una versión de código abierto de "Kringle" lanzada por Racer, basada en SD3 y que funciona en GPU de menos de 8 GB (versión de despliegue con un solo clic).

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 53.6K 00

Introducción general

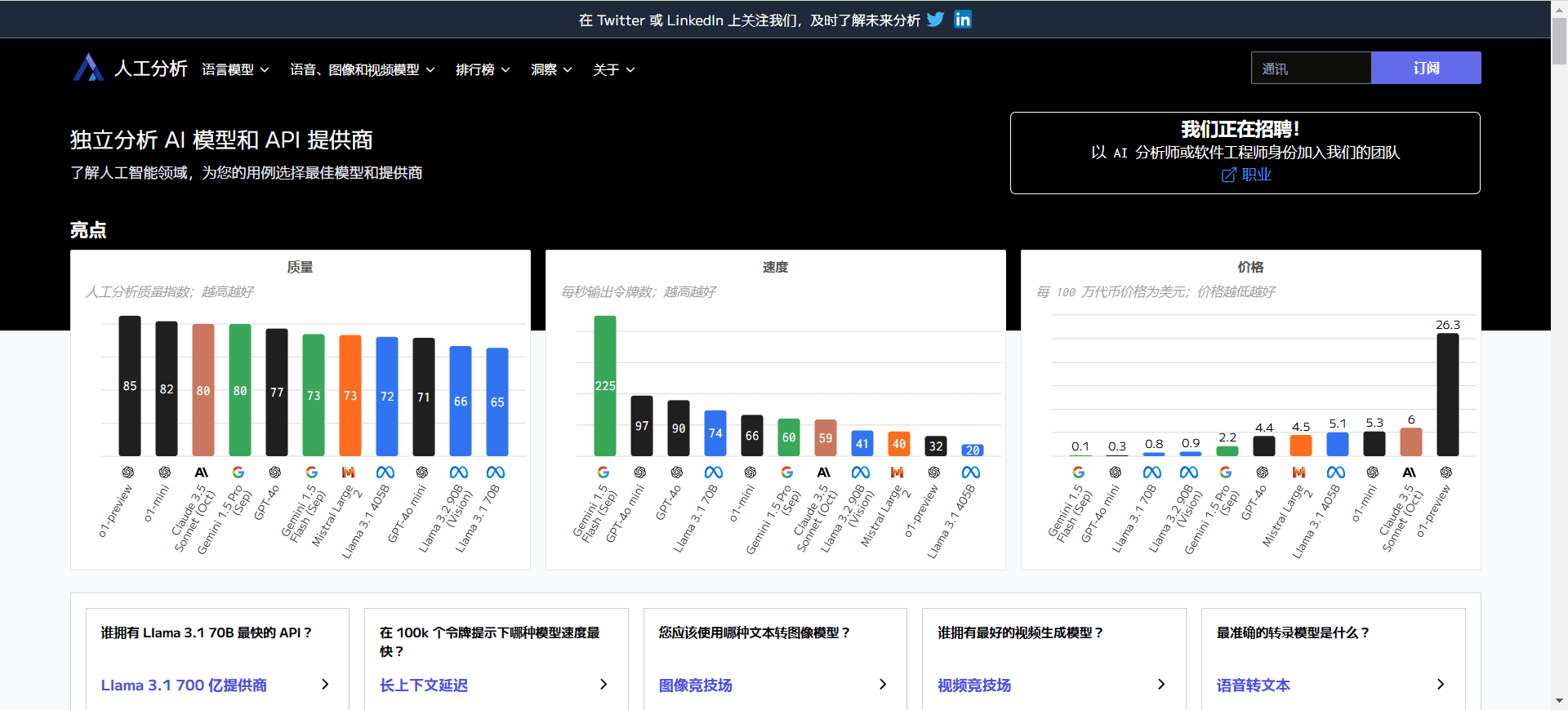

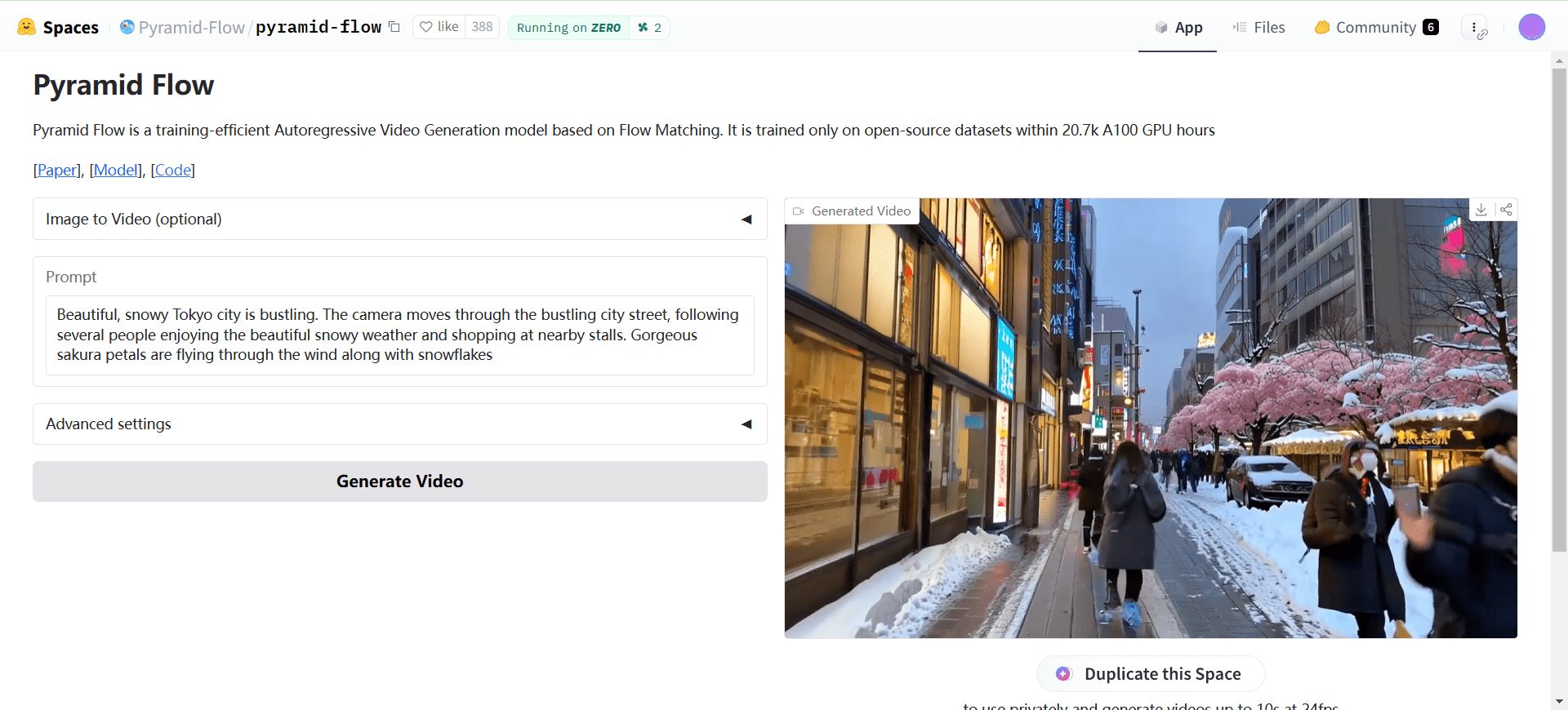

Pyramid Flow es un eficaz método autorregresivo de generación de vídeo basado en la técnica Flow Matching. El método permite generar y descomprimir contenidos de vídeo con mayor eficiencia computacional interpolando entre diferentes resoluciones y niveles de ruido.Pyramid Flow es capaz de generar vídeos de 10 segundos de alta calidad con una resolución de 768p a 24 FPS y admite la generación de imagen a vídeo. Todo el marco de trabajo está optimizado de extremo a extremo, utilizando un único modelo DiT, entrenado en 20,7k horas de entrenamiento en la GPU A100.

Experiencia en línea: https://huggingface.co/spaces/Pyramid-Flow/pyramid-flow

Lista de funciones

- Generación eficiente de vídeo: Genera vídeo de 10 segundos de alta calidad con una resolución de 768p a 24 FPS.

- Generación de imagen a vídeo: Soporte para generar vídeo a partir de imágenes.

- Soporte multirresolución: Los puntos de control del modelo están disponibles en resoluciones de 768p y 384p.

- Descarga de la CPU: Se admiten dos tipos de descarga de la CPU para reducir los requisitos de memoria de la GPU.

- Soporte Multi-GPUProporciona scripts de inferencia multi-GPU que soportan el paralelismo de secuencias para ahorrar memoria por GPU.

Utilizar la ayuda

Entorno

- Crear un entorno utilizando conda:

cd Pyramid-Flow conda create --name pyramid-flow python=3.8.10 conda activate pyramid-flow - Instale la dependencia:

pip install -r requirements.txt

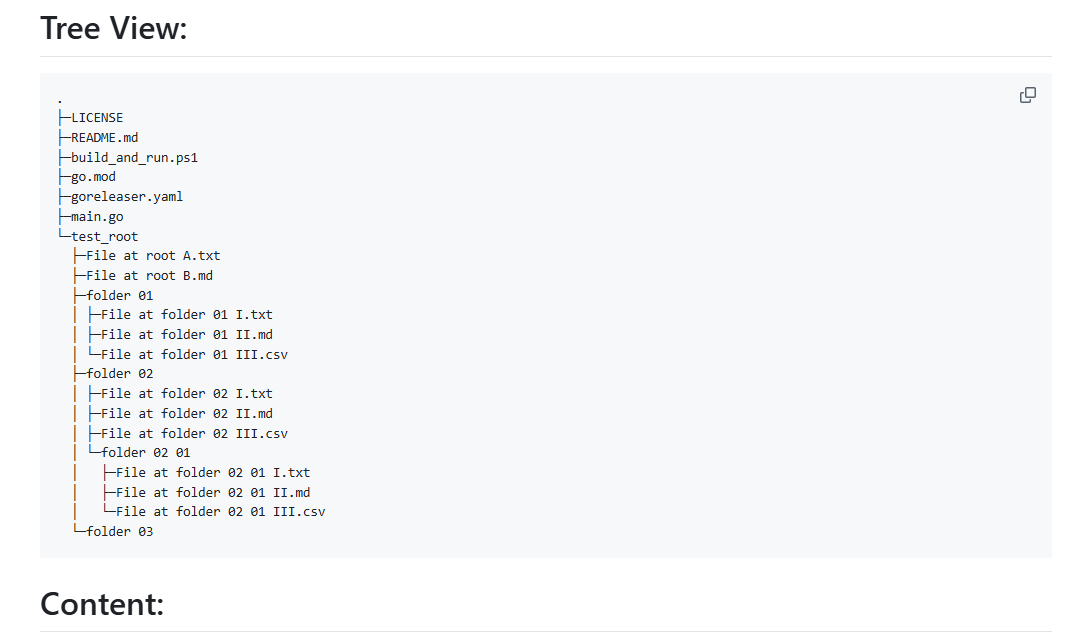

Descarga y carga de modelos

- Descarga los puntos de control del modelo de Huggingface:

# 下载 768p 和 384p 模型检查点 - Modelos de carga:

model_dtype, torch_dtype = 'bf16', torch.bfloat16 model = PyramidDiTForVideoGeneration( 'PATH', # 下载的检查点目录 model_dtype, model_variant='diffusion_transformer_768p', # 或 'diffusion_transformer_384p' ) model.vae.enable_tiling() model.enable_sequential_cpu_offload()

Generación de texto a vídeo

- Configura los parámetros de generación y genera el vídeo:

frames = model.generate( prompt="你的文本提示", num_inference_steps=[20, 20, 20], video_num_inference_steps=[10, 10, 10], height=768, width=1280, temp=16, # temp=16: 5s, temp=31: 10s guidance_scale=9.0, # 384p 设为 7 video_guidance_scale=5.0, output_type="pil", save_memory=True, ) export_to_video(frames, "./text_to_video_sample.mp4", fps=24)

Generación de imagen a vídeo

- Configura los parámetros de generación y genera el vídeo:

prompt = "FPV flying over the Great Wall" with torch.no_grad(), torch.cuda.amp.autocast(enabled=True, dtype=torch_dtype): frames = model.generate_i2v( prompt=prompt, input_image=image, num_inference_steps=[10, 10, 10], temp=16, video_guidance_scale=4.0, output_type="pil", save_memory=True, ) export_to_video(frames, "./image_to_video_sample.mp4", fps=24)

Inferencia multi-GPU

- Inferencia utilizando múltiples GPUs:

# 在 2 个或 4 个 GPU 上运行推理脚本

Edición Niu One Click Deployment

El código de descifrado del archivo de inicio se encuentra en la dirección de descarga. Si la descarga del modelo se interrumpe a menudo tras el arranque, consulta el documento oficial para descargar el archivo del modelo por separado, que pesa unos 30 G.

Contraseña de descompresión de archivos: niugee.com

Archivos compartidos a través de Netflix: PyramidFlow-Niu Deployment-Free Local One-Click Package

Enlace: https://pan.baidu.com/s/1yV4wafDkquBNwG8bS0zjDg?pwd=p5fw Código de extracción: p5fw (Nueva versión 1.1)

Google Drive:

https://drive.google.com/drive/u/1/folders/1SIvP6qP2Z4CRHpbsfXawl3tksv5ZBRGo (Nueva versión 1.1)

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...