Open-o3 Video - Un modelo de razonamiento en vídeo de código abierto de la Universidad de Pekín United Bytes

Últimos recursos sobre IAPublicado hace 5 meses Círculo de intercambio de inteligencia artificial 25.5K 00

Qué es Open-o3 Video

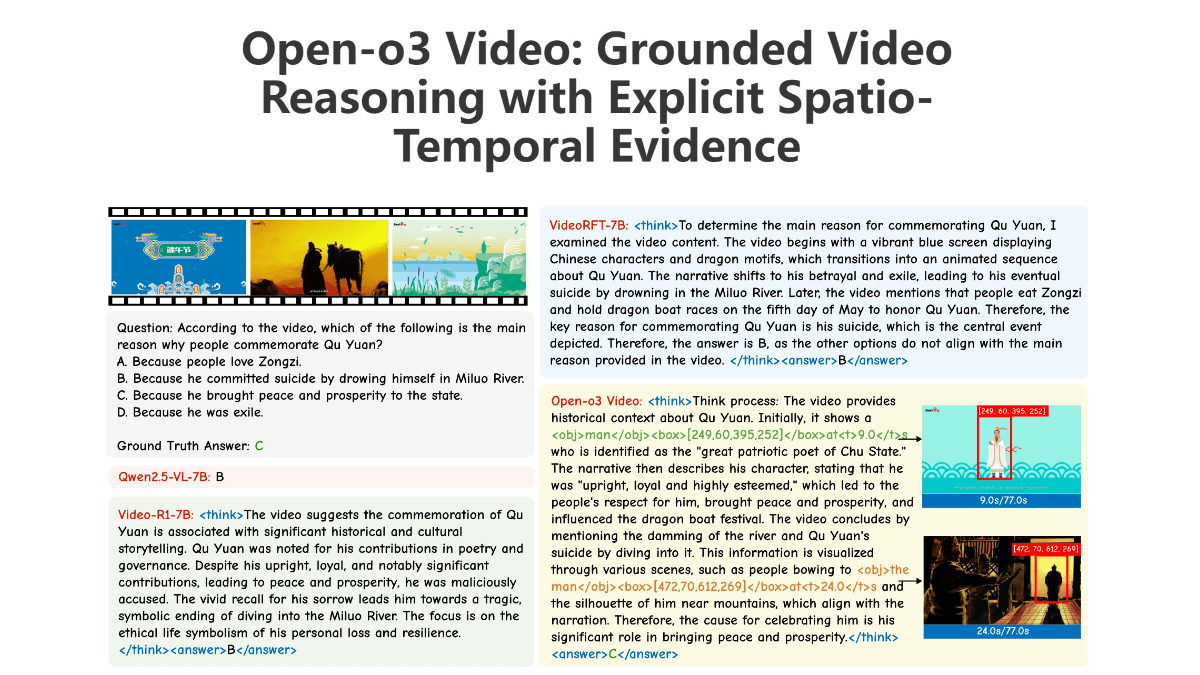

Open-o3 Video es un modelo de inferencia de vídeo de código abierto desarrollado conjuntamente por la Universidad de Pekín y ByteDance, centrado en mejorar la inferencia de vídeo mediante pruebas temporales y espaciales. Al etiquetar explícitamente las pruebas clave con marcas de tiempo y recuadros delimitadores, ayuda al modelo a comprender e interpretar mejor el contenido del vídeo. El modelo se entrena mediante una estrategia en dos fases: se inicia en frío mediante un ajuste fino supervisado (SFT) y luego se combina con la optimización del aprendizaje por refuerzo (RL) para garantizar la precisión de las respuestas y la alineación espaciotemporal. El equipo también creó los conjuntos de datos de alta calidad STGR-CoT-30k y STGR-RL-36k para proporcionar una rica señal supervisada espaciotemporal para el entrenamiento del modelo.

Características de Open-o3 Video

- Las pruebas temporales mejoran el razonamientoOpen-o3 Video incorpora pruebas temporales y espaciales en el proceso de razonamiento mediante el etiquetado explícito de marcas de tiempo y cuadros delimitadores clave para mejorar la precisión y la interpretabilidad de la comprensión del vídeo.

- Soporte de conjuntos de datos de alta calidadEl equipo construyó dos conjuntos de datos de alta calidad, STGR-CoT-30k y STGR-RL-36k, para proporcionar ricas señales espaciotemporales supervisadas para el entrenamiento del modelo y garantizar la mejora de la capacidad de inferencia.

- Estrategia de formación en dos etapasEl objetivo es optimizar la exactitud de la inferencia, la alineación temporal y la precisión espacial del modelo mediante múltiples mecanismos de recompensa.

- Rendimiento superiorEn la prueba de referencia V-STAR, Open-o3 Video supera significativamente a otros modelos, con métricas mAM y mLGM que alcanzan 35,5% y 49,0%, respectivamente, lo que demuestra una gran capacidad de inferencia de vídeo.

- Código abierto y facilidad de usoEl código y el modelo se han publicado en GitHub y Hugging Face para facilitar su uso y desarrollo por parte de investigadores y desarrolladores, con el fin de promover una amplia aplicación de la tecnología de comprensión de vídeo.

Principales ventajas de Open-o3 Video

- Integración espacio-temporal de pruebasEl modelo etiqueta explícitamente las marcas de tiempo y los cuadros delimitadores durante el proceso de inferencia, combinando estrechamente la información temporal y espacial con las rutas de inferencia, lo que mejora significativamente la precisión y la interpretabilidad de la inferencia de vídeo.

- Impulsado por conjuntos de datos de alta calidadEl equipo de desarrollo construyó dos conjuntos de datos de alta calidad (STGR-CoT-30k y STGR-RL-36k) para proporcionar señales supervisadas espaciotemporales uniformes, que proporcionan una base de datos sólida para el entrenamiento de modelos y garantizan el rendimiento de los modelos en escenarios complejos.

- Formación optimizada en dos etapasEl objetivo es optimizar la precisión de la inferencia, la alineación temporal y la precisión espacial del modelo a través de múltiples mecanismos de recompensa para mejorar el rendimiento del modelo de forma integral.

- Excelente rendimientoEn la prueba V-STAR, Open-o3 Video supera significativamente a otros modelos similares en métricas clave (por ejemplo, mAM y mLGM), lo que demuestra su gran competitividad en la inferencia de vídeo.

- Capacidad de fusión multimodalOpen-o3 Video: Basado en potentes modelos multimodales (por ejemplo, Qwen3-VL-8B), Open-o3 Video es capaz de procesar eficientemente texto, imagen e información temporal en vídeos para un razonamiento e interpretación más precisos.

¿Cuál es el sitio web oficial de Open-o3 Video?

- Página web del proyecto:: https://marinero4972.github.io/projects/Open-o3-Video/

- Repositorio Github:: https://github.com/marinero4972/Open-o3-Video

- Biblioteca de modelos HuggingFace:: https://huggingface.co/marinero4972/Open-o3-Video/tree/main

- Documento técnico arXiv:: https://arxiv.org/pdf/2510.20579

A quién va dirigido Open-o3 Video

- Investigadores en inteligencia artificialLos investigadores centrados en la comprensión de vídeo, el aprendizaje multimodal y el procesamiento del lenguaje natural pueden utilizar el modelo para la investigación de vanguardia y la optimización de algoritmos.

- Ingeniero en visión por ordenadorLos ingenieros que trabajan en análisis de vídeo, detección de objetivos y generación de contenidos de vídeo pueden aprovechar los modelos para mejorar el rendimiento de los proyectos y la eficacia del desarrollo.

- científico de datosEl modelo permite a los científicos de datos que necesitan procesar y analizar datos de vídeo a gran escala obtener resultados de inferencia de vídeo más precisos.

- profesores y estudiantes de enseñanza superiorEl profesorado y los estudiantes de informática y disciplinas relacionadas con la inteligencia artificial pueden utilizarlo como herramienta de enseñanza e investigación para explorar las últimas tecnologías en el campo de la comprensión de vídeo.

- Equipo técnico de la empresaLos equipos tecnológicos de las empresas en los campos de la creación de contenidos de vídeo, la seguridad inteligente y la conducción automática pueden aplicar los modelos a escenarios empresariales reales para mejorar la competitividad de los productos.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...