OOTDiffusion: Modelos de código abierto para vestir a los personajes

Tutoriales prácticos sobre IAPublicado hace 2 años Círculo de intercambio de inteligencia artificial 58.9K 00

OOTDiffusion es una herramienta de código abierto para el ajuste virtual de prendas de vestir basada en la tecnología de modelado por difusión latente, diseñada para proporcionar una experiencia de ajuste virtual altamente controlada. En este tutorial se detallan sus características, su uso y los pasos de instalación y despliegue.

I. Resumen funcional

OOTDiffusion ofrece principalmente las siguientes funciones:

1. Generación y fusión de imágenes de prendas de alta calidadMediante técnicas de modelado de difusión latente, OOTDiffusion es capaz de generar imágenes de prendas de alta calidad que se fusionan de forma natural y realista con las imágenes modelo proporcionadas por el usuario.

2. Ajuste automático de la ropaLa prenda se ajusta automáticamente a la forma del cuerpo del modelo en función del sexo y el tipo de cuerpo del usuario, lo que garantiza un ajuste perfecto.

3. Experiencia de adaptación personalizadaEl usuario puede adaptar el ajuste a sus necesidades y preferencias, incluida la elección de diferentes estilos y colores de ropa.

4. Admite modelos de medio cuerpo y cuerpo entero: Existen modelos de medio cuerpo (para prendas de la parte superior del cuerpo, como camisetas y blusas) y modelos de cuerpo entero (para prendas de cuerpo entero, incluidos tops, pantalones y vestidos).

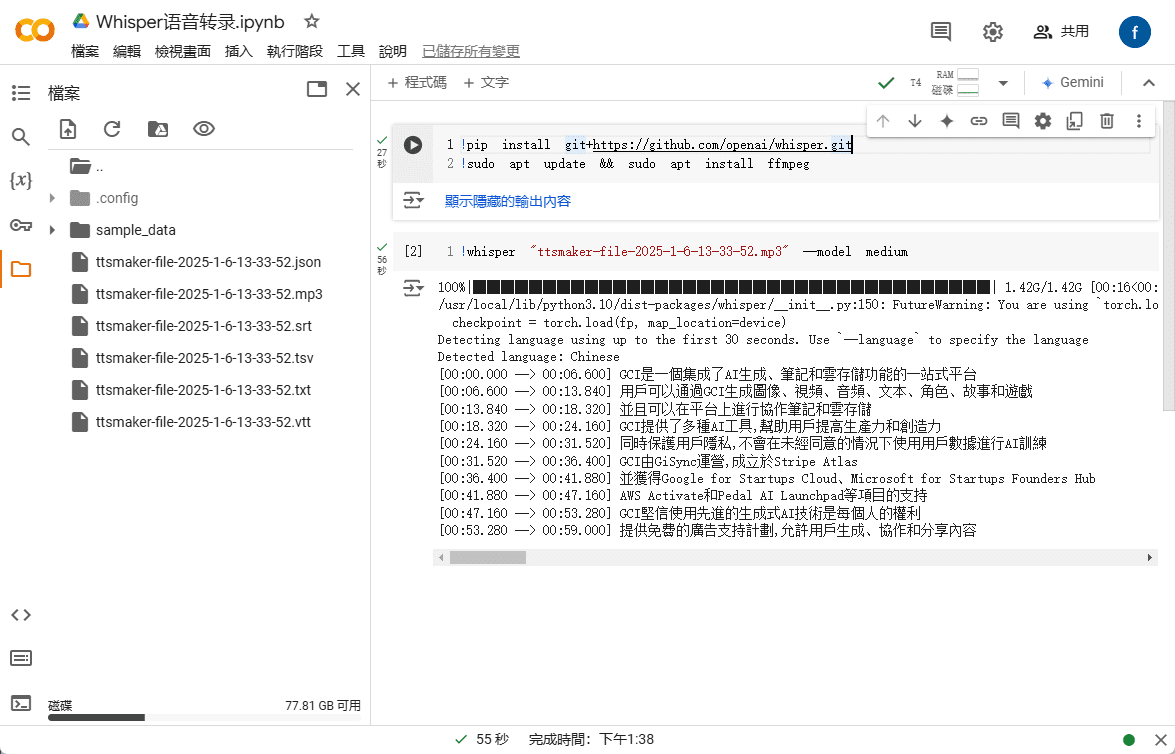

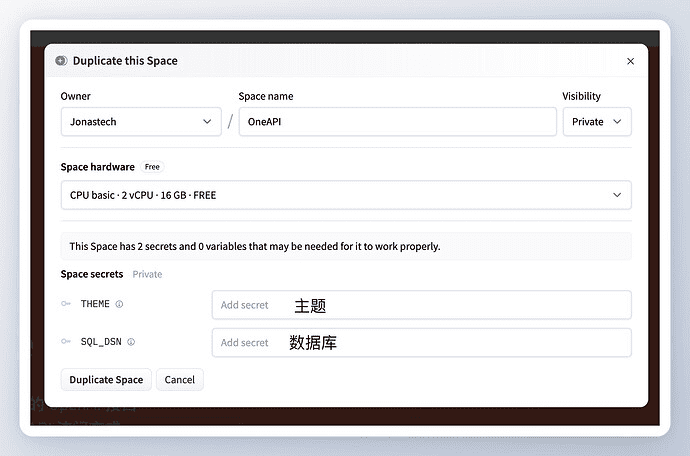

II. Instalación y despliegue

Requisitos medioambientales

Python 3.6 o superior

PyTorch 1.7 o posterior

CUDA 10.2 o superior (si se utiliza aceleración por GPU)

mover

1. Clonación del código base::

git clone https://github.com/levihsu/OOTDiffusion.git

2. Instalación de dependencias::

cd OOTDiffusion

pip install -r requisitos.txt

III. Métodos de utilización

Parámetros de configuración

Antes de utilizar OOTDiffusion, es necesario configurar algunos parámetros para adaptarlos a sus necesidades específicas:

trayectoria del modeloEspecifique la ruta a su archivo de modelo.

Camino de la ropaEspecifique la ruta del archivo de imagen de su disfraz.

índice de zoomAjusta la escala entre la imagen de la prenda y la imagen del modelo.

tiempos de muestreoAjuste el número de muestras de la imagen generada para optimizar la calidad de la imagen.

empezar a probarse

Utilice el siguiente comando para iniciar una adaptación virtual:

python run_ootdiffusion.py --model_path [ruta del modelo] --clothing_path [ruta de la ropa] --scale_factor [escala] --num_samples [número de muestras]

IV. Ejemplos

Suponiendo que haya preparado la imagen del modelo y la imagen de la ropa, puede seguir el siguiente ejemplo:

python ejecutar_ootdiffusion.py ---ruta_modelo . /modelos/modelo_ejemplo.png --ruta_ropa . /ropa/ropa_ejemplo.png -factor_escala 1.0 --num_muestras 100

Este comando generará una imagen que mezclará de forma natural la prenda especificada en el modelo especificado.

V. Precauciones

Asegúrese de que todos los archivos de imagen tienen fondos limpios para obtener mejores resultados de mezcla.

Ajuste el número de muestras y la escala para un ajuste óptimo en función del rendimiento de su sistema.

Siguiendo estos pasos, podrá utilizar eficazmente OOTDiffusion para pruebas virtuales de ropa, proporcionando una solución innovadora y práctica tanto para el entretenimiento personal como para presentaciones comerciales.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...