Tutorial de instalación y uso de Ollama

Tutoriales prácticos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 72.9K 00

Ha habido muchos números anteriores sobre Ollama La información de los tutoriales de instalación y despliegue es bastante dispersa, por lo que esta vez hemos elaborado un tutorial completo de un solo paso sobre cómo utilizar Ollama en un ordenador local. Este tutorial está pensado para que los principiantes eviten las trampas del uso de Ollama, y para aquellos que puedan hacerlo, recomendamos la lectura de la documentación oficial de Ollama. A continuación, proporcionaré una guía paso a paso para instalar y utilizar Ollama.

Por qué elegir Ollama para la instalación local de grandes modelos

Muchos recién llegados no entienden, como me pasó a mí, que hay otras herramientas en línea con mejores prestaciones para desplegar grandes modelos, como:Inventario de marcos LLM similares a Ollama: múltiples opciones para grandes modelos desplegados localmente ¿Por qué recomienda instalar Ollama al final?

En primer lugar, por supuesto, es fácil de instalar en ordenadores personales, pero uno de los puntos más importantes es que el rendimiento del modelo para el despliegue autónomo está mejor optimizado para los parámetros, y la instalación no es propensa a errores. Por ejemplo, la misma configuración de instalación en ordenador QwQ-32B Utilizar Ollama para una posible suavidad de uso, cambiar a "más potente". llama.cpp Puede atascarse, e incluso las respuestas de salida no son correctas. Hay muchas razones detrás de esto y no puedo explicarlas claramente, así que no lo haré, sólo sé que Ollama contiene llama.cpp en la parte inferior, y debido a una mejor optimización, se ejecuta más estable que llama.cpp en su lugar.

¿Qué tipo de archivos de modelos grandes puede ejecutar Ollama?

Ollama admite archivos de modelo en los dos formatos siguientes con diferentes motores de inferencia:

- Formato GGUF: a través de

llama.cppRazonamiento. - formato de los sensores de seguridad: a través de

vllmRazonamiento.

Es decir:

- Si se utiliza un modelo en formato GGUF, Ollama llamará a la función

llama.cppRealizar inferencias eficientes en CPU/GPU. - Si se utiliza un modelo en formato safetensors, Ollama hace uso de la función

vllmAdemás, a menudo se recurre a las GPU para realizar inferencias de alto rendimiento.

Por supuesto, no tiene por qué importarle, basta con que sepa que la mayoría de los archivos que instale están en formato GGUF. ¿Por qué haces hincapié en GGUF?

Apoyo del GGUF Cuantitativos (por ejemplo, Q4, Q6_K)La capacidad deMantiene un buen rendimiento de inferencia con una huella gráfica y de memoria muy reducida.Aunque los sensores de seguridad suelen ser modelos FP16/FP32 completos, son mucho más grandes y ocupan más recursos. Puede obtener más información aquí:Qué es la cuantificación de modelos: explicación de los tipos de datos FP32, FP16, INT8, INT4.

Requisitos mínimos de configuración de Ollama

Sistema operativo: Linux: Ubuntu 18.04 o posterior, macOS: macOS 11 Big Sur o posterior

RAM: 8 GB para modelos 3B, 16 GB para modelos 7B, 32 GB para modelos 13B

Espacio en disco: 12GB para la instalación de Ollama y el modelo base, espacio adicional necesario para almacenar los datos del modelo, dependiendo del modelo que esté utilizando. Se recomienda reservar 6G de espacio en la unidad C.

CPU: Se recomienda utilizar cualquier CPU moderna con al menos 4 núcleos, y para ejecutar el modelo 13B, se recomienda utilizar una CPU con al menos 8 núcleos.

GPU (opcional): No necesitas una GPU para ejecutar Ollama, pero puede mejorar el rendimiento, especialmente al ejecutar modelos más grandes. Si tienes una GPU, puedes utilizarla para acelerar el entrenamiento de modelos personalizados.

Instalar Ollama

Visite: https://ollama.com/download

Sólo tiene que elegir de acuerdo con el entorno informático, la instalación es muy simple, lo único que hay que prestar atención a aquí es que el entorno de red puede conducir a fallos para instalar correctamente.

instalación en macOS: https://ollama.com/download/Ollama-darwin.zip

Instalación en Windows: https://ollama.com/download/OllamaSetup.exe

Instalación de Linux:curl -fsSL https://ollama.com/install.sh | sh

Imagen Docker: (aprenda por sí mismo en el sitio web oficial)

CPU o GPU Nvidia:docker pull ollama/ollama

GPU de AMD:docker pull ollama/ollama:rocm

Una vez completada la instalación verás el icono de Ollama en la esquina inferior derecha de tu escritorio, si hay una alerta verde en el icono, significa que necesitas actualizar.

Configuración de Ollama

Ollama es muy fácil de instalar, pero la mayoría de los ajustes que necesita para cambiar las "variables de entorno", que es muy poco amigable para los recién llegados, la lista de todas las variables para aquellos que necesitan para hacer referencia a (no es necesario recordar):

| parámetros | Etiquetado y configuración |

|---|---|

| OLLAMA_MODELOS | Indica el directorio donde se almacenan los archivos del modelo, el directorio por defecto esDirectorio de usuario actualasumir (oficina) C:\Users%username%.ollama\modelsSistema Windows No se recomienda ponerlo en la unidad CLos discos pueden colocarse en otros discos (p. ej. E:\ollama\models) |

| OLLAMA_HOST | es la dirección de red en la que escucha el servicio ollama, y por defecto es127.0.0.1 Si desea permitir que otros ordenadores accedan a Ollama (por ejemplo, otros ordenadores de una LAN), la opciónAjustes recomendadosestar bien 0.0.0.0 |

| OLLAMA_PORT | Indica el puerto por defecto en el que escucha el servicio ollama, que por defecto es11434 Si hay un conflicto de puertos, puede modificar la configuración a otros puertos (p. ej.8080etc.) |

| OLLAMA_ORIGINES | Indica el origen de la solicitud del cliente HTTP, utilizando una lista de medias columnas separadas por comas. Si el uso local no está restringido, puede establecerse con un asterisco * |

| OLLAMA_KEEP_ALIVE | Indica el tiempo de supervivencia del modelo grande una vez cargado en memoria, por defecto es5mSon 5 minutos. (por ejemplo, un número llano 300 significa 300 segundos, 0 significa que el modelo se desinstala en cuanto se procesa la respuesta a la solicitud, y cualquier número negativo significa que se ha mantenido vivo) Se recomienda ajustar el 24h El modelo permanece en la memoria durante 24 horas, lo que aumenta la velocidad de acceso. |

| OLLAMA_NUM_PARALLEL | Indica el número de peticiones concurrentes procesadas, por defecto es1 (es decir, procesamiento en serie de solicitudes) Las recomendaciones se ajustan a las necesidades reales |

| OLLAMA_MAX_QUEUE | Indica la longitud de la cola de peticiones, el valor por defecto es512 Se recomienda ajustarse a las necesidades reales, las solicitudes que superen la longitud de la cola serán descartadas |

| OLLAMA_DEBUG | indica la salida del registro de depuración, que puede configurarse en la fase de desarrollo de la aplicación como1 (es decir, genera información de registro detallada para la resolución de problemas) |

| OLLAMA_MAX_LOADED_MODELS | Indica el número máximo de modelos cargados en memoria al mismo tiempo, por defecto es1 (es decir, sólo puede haber 1 modelo en memoria) |

1. Modificar el directorio de descarga de archivos de modelos grandes

En los sistemas Windows, los ficheros modelo descargados por Ollama se almacenan por defecto en un directorio específico bajo la carpeta del usuario. En concreto, la ruta por defecto suele serC:\Users\<用户名>\.ollama\models. Toma.<用户名>se refiere al nombre de usuario de inicio de sesión actual del sistema Windows.

Por ejemplo, si el nombre de usuario de inicio de sesión del sistema esyangfanentonces la ruta de almacenamiento por defecto del fichero modelo puede serC:\Users\yangfan\.ollama\models\manifests\registry.ollama.ai. En este directorio, los usuarios pueden encontrar todos los archivos de modelos descargados a través de Ollama.

Nota: Las rutas de instalación de sistemas más nuevos suelen ser:C:\Users\<用户名>\AppData\Local\Programs\Ollama

Las descargas de modelos grandes pueden ser fácilmente de varios gigabytes, si su espacio en la unidad C es pequeño, el primer paso que debe hacer es modificar el directorio de descarga de archivos de modelos grandes.

1. Encontrar el punto de entrada de las variables de entorno

La forma más fácil: Win+R para abrir la ventana de ejecución, escriba sysdm.cplSi desea utilizar esta opción, entre para abrir Propiedades del sistema, seleccione la pestaña Avanzadas y haga clic en Variables de entorno.

Otros métodos:

1. Inicio->Configuración->Acerca de->Configuración avanzada del sistema->Propiedades del sistema->Variables de entorno.

2. Este ordenador -> Clic derecho -> Propiedades -> Configuración avanzada del sistema -> Variables de entorno.

3. Inicio->Panel de control->Sistema y seguridad->Sistema->Configuración avanzada del sistema->Propiedades del sistema->Variables de entorno.

4. Cuadro de búsqueda en la parte inferior del escritorio->Input->Environmental Variables

Al entrar, verá la siguiente pantalla:

2. Modificar las variables de entorno

Busque el nombre de la variable OLLAMA_MODELS en Variables del Sistema y haga clic en Nueva si no está allí.

Si OLLAMA_MODELS ya existe, selecciónelo y haga doble clic con el botón izquierdo del ratón, o selecciónelo y haga clic en "Editar".

El valor de la variable se cambia al nuevo directorio, aquí me he adelantado y lo he cambiado de la unidad C a la unidad E que tiene más espacio en disco.

Después de guardar, se recomienda iniciar el ordenador desde un nuevo arranque y volver a utilizarlo para obtener un resultado más seguro.

2. Modificar la dirección y el puerto de acceso por defecto

En el navegador, introduzca la URL: http://127.0.0.1:11434/ , verá el siguiente mensaje, indicando que se está ejecutando, aquí hay algunos riesgos de seguridad que deben ser modificados, todavía en las variables de entorno.

1.Modificar OLLAMA_HOST

Si no es así, añada una nueva, si es 0.0.0.0 para permitir el acceso a extranet, cámbiela a 127.0.0.1

2.Modificar OLLAMA_PORT

Si no lo tiene, añádalo y cambie 11434 por cualquier puerto, como por ejemplo:11331(El rango de modificación del puerto es de 1 a 65535), empiece por 1000 para evitar conflictos de puertos. Tenga en cuenta que se utiliza el inglés ":".

Recuerda reiniciar tu ordenador para leer las recomendaciones sobre seguridad de Ollama:DeepSeek incendia Ollama, ¿está a salvo su despliegue local? ¡Desconfíe de la aritmética "robada"!

Instalación de grandes modelos

Ir a la URL: https://ollama.com/search

Seleccionar modelo, seleccionar tamaño de modelo, comando copiar

Acceso a herramientas de línea de comandos

Pegue el comando para instalarlo automáticamente

Se está descargando aquí, así que si va lento, ¡considera la posibilidad de cambiar a un entorno de Internet más feliz!

Si desea descargar modelos de gran tamaño que Ollama no ofrece, sin duda puede hacerlo, la gran mayoría de ellos son archivos GGUF en huggingface, y he tomado una versión especial cuantificada de la DeepSeek-R1 32B se utiliza como ejemplo para la demostración de la instalación.

1. Instalar el modelo de versionado cuantitativo huggingface formato base de comandos

Recuerde el siguiente formato de comando de instalación

ollama run hf.co/{username}:{reponame}

2. Selección de la versión cuantitativa

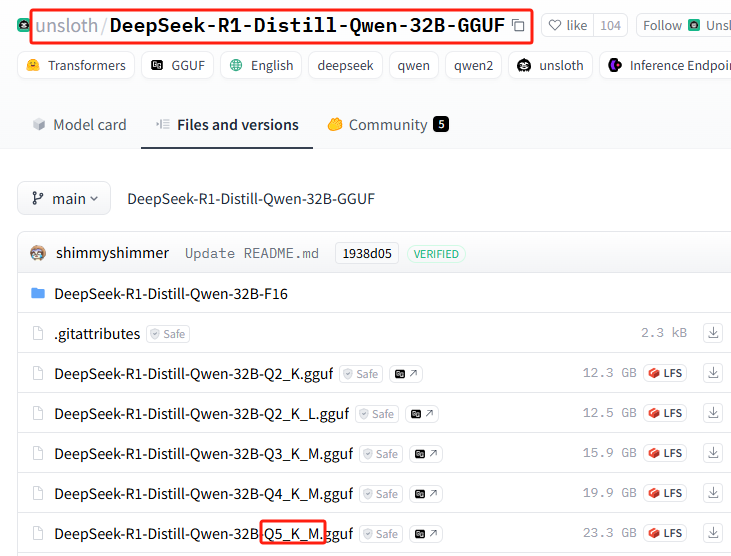

Lista de todas las versiones cuantificadas: https://huggingface.co/unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF/tree/main

Esta instalación utiliza: Q5_K_M

3. Orden de instalación de empalmes

{username}=unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF

{reponame}=Q5_K_M

Empálmalo para obtener el comando de instalación completo:ollama run hf.co/unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF:Q5_K_M

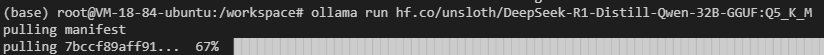

4. Realice la instalación en Ollama

Ejecute el comando de instalación

Puede que experimentes fallos en la red (buena suerte con eso), repite el comando de instalación unas cuantas veces más...

¿Todavía no funciona? Prueba con el siguiente comando.hf.co/Modifíquese la sección como siguehttps://hf-mirror.com/(cambiar a la dirección espejo doméstica), el remiendo final del comando de instalación completo es el siguiente:

ollama run https://hf-mirror.com/unsloth/DeepSeek-R1-Distill-Qwen-32B-GGUF:Q5_K_M

Hay disponible un tutorial completo para esta sección:Implantación privada sin GPU locales DeepSeek-R1 32B

Comandos básicos de Ollama

| comando | descripciones |

|---|---|

ollama serve | Lanzar Ollama |

ollama create | Creación de modelos a partir de archivos de modelos |

ollama show | Visualización de la información sobre el modelo |

ollama run | modelo operativo |

ollama stop | Detener un modelo en ejecución |

ollama pull | Extracción de modelos del registro |

ollama push | Envío de modelos al registro |

ollama list | Lista de modelos |

ollama ps | Lista de modelos en funcionamiento |

ollama cp | Modelos de réplica |

ollama rm | Borrar modelo |

ollama help | Mostrar información de ayuda para cualquier comando |

| simbolizan | descripciones |

|---|---|

-h, --help | Mostrar información de ayuda de Ollama |

-v, --version | Visualización de la información sobre la versión |

Al introducir comandos en varias líneas, puede utilizar la tecla """ Realiza un salto de línea.

utilizar """ Fin de línea.

Para finalizar el servicio de inferencia de modelos de Ollama, puede utilizar el comando /bye.

Uso de Ollama en una herramienta de diálogo nativa de IA

La mayoría de las principales herramientas de diálogo nativas de IA ya están adaptadas a Ollama por defecto y no requieren ninguna configuración. Por ejemplo Ayuda de página OpenwebUI.

Sin embargo, algunas herramientas locales de diálogo con IA requieren que introduzcas tú mismo la dirección API.http://127.0.0.1:11434/: (tenga en cuenta si se modifica el puerto)

Algunas herramientas de diálogo AI basadas en la web admiten ciertamente la configuración, por ejemplo SiguienteChat :

Si quieres que Ollama que se ejecuta en tu ordenador local esté totalmente expuesto para uso externo, aprende cpolar o ngrok por tu cuenta, lo cual está fuera del alcance del uso de principiante.

El artículo parece ser muy largo, de hecho, dentro de los 4 puntos de conocimiento muy simple, aprender el uso futuro de Ollama básicamente sin trabas, vamos a revisar de nuevo:

1. Configuración de las variables de entorno

2. Dos formas de instalar un modelo grande

3. Recuerde los comandos básicos de ejecutar, eliminar modelo

4. Uso en diferentes clientes

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...