MuseV+Muse Talk: Marco completo de generación de vídeo humano digital | Retrato a vídeo | Pose a vídeo | Sincronización de labios

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 87.8K 00

Introducción general

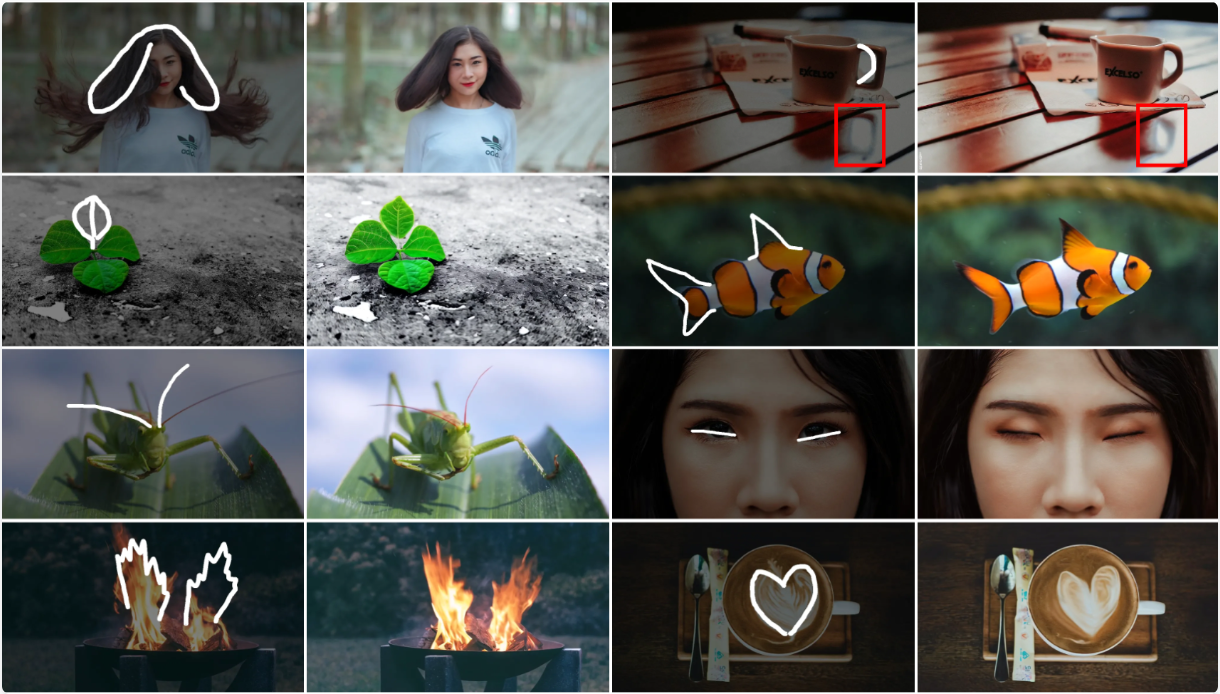

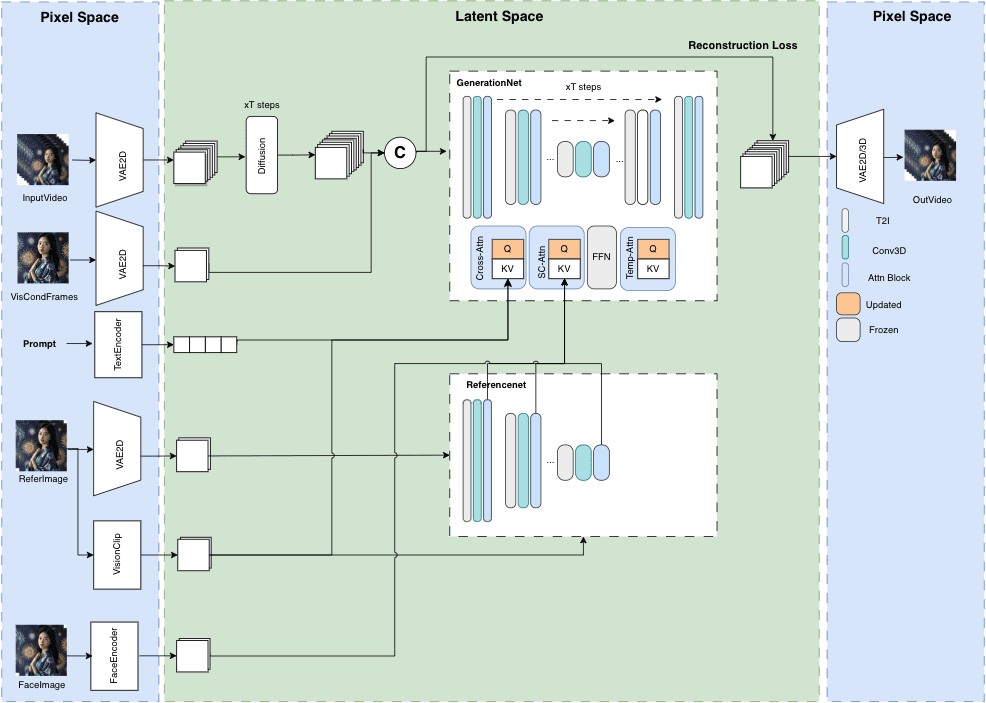

MuseV es un proyecto público en GitHub cuyo objetivo es la generación de vídeo avatar de longitud ilimitada y alta fidelidad. Se basa en la tecnología de difusión y proporciona varias funciones como Image2Video, Text2Image2Video, Video2Video y más. Se proporcionan detalles de la estructura del modelo, casos de uso, guía de inicio rápido, scripts de inferencia y agradecimientos.

MuseV es un marco de generación de vídeo humano virtual basado en un modelo de difusión con las siguientes características:

Admite la generación de longitudes infinitas mediante un novedoso esquema de eliminación de ruido visual condicional en paralelo sin el problema de la acumulación de errores, especialmente para escenas con posiciones de cámara fijas.

Se proporciona un modelo preentrenado para la generación de vídeos de avatares entrenado en un conjunto de datos de tipos de personajes.

Admite la generación de imagen a vídeo, texto a imagen a vídeo y vídeo a vídeo.

Compatible con el ecosistema de generación de gráficos de Stable Diffusion, incluidos base_model, lora, controlnet, etc.

Soporte para múltiples tecnologías de imagen de referencia, incluyendo IPAdapter, ReferenceOnly, ReferenceNet, IPAdapterFaceID.

Más adelante distribuiremos también el código de formación.

Lista de funciones

Generación de vídeos de duración ilimitada

Imágenes humanas virtuales de alta fidelidad

Soporte versátil: Imagen2Vídeo, Texto2Imagen2Vídeo, Vídeo2Vídeo

Estructura clara del modelo y casos de uso

Guiones de inicio rápido y razonamiento

Utilizar la ayuda

Visite los repositorios de GitHub para actualizaciones y recursos descargables

Siga la Guía de inicio rápido para la configuración inicial del proyecto

Genere contenidos de vídeo utilizando los guiones de inferencia proporcionados

Método de uso combinado:

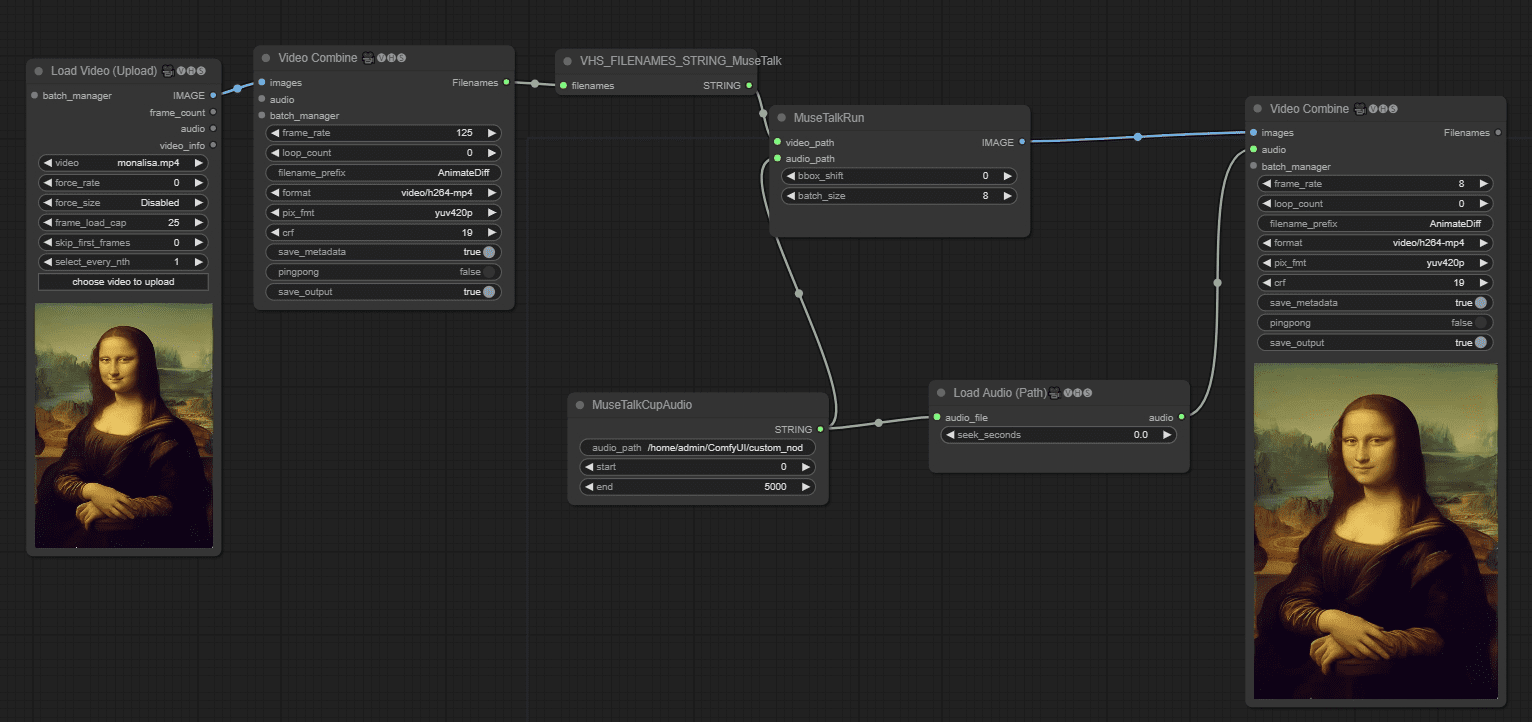

Método 1: Grabación de vídeo en directo + Muse Talk

Método 2: Imagen + MuseV + Muse Talk

un producto acabado

A partir de una imagen fija de vídeo en bucle, hacer que el personaje de anime hablar, los labios del personaje de dibujos animados en sí no se encuentra lo que hace que sea extraño para hablar, la próxima vez que usted debe cambiar la imagen con "labios", preferiblemente una "persona real". 45 segundos de vídeo en el funcionario Espere unos 15 minutos para el entorno de prueba.

Hacer que el vídeo hable en los flujos de trabajo ComfyUI

Lanzamos MuseTalk MuseTalk es un modelo de sincronización bucal de alta calidad en tiempo real (30fps+ en NVIDIA Tesla V100). MuseTalk puede aplicarse con vídeo de entrada, como el generado por MuseV, como una solución de avatar completa.

MuseV Online Experience / Paquete de instalación en Windows con un solo clic

El modelo de sincronización bucal MuseTalk, compañero de MuseV

Enlace: https://pan.quark.cn/s/ed896ceda5c8

Código del extracto: JygA

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...