Vídeo MOFA: la tecnología de adaptación del campo de movimiento convierte imágenes fijas en vídeo

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 51.6K 00

Introducción general

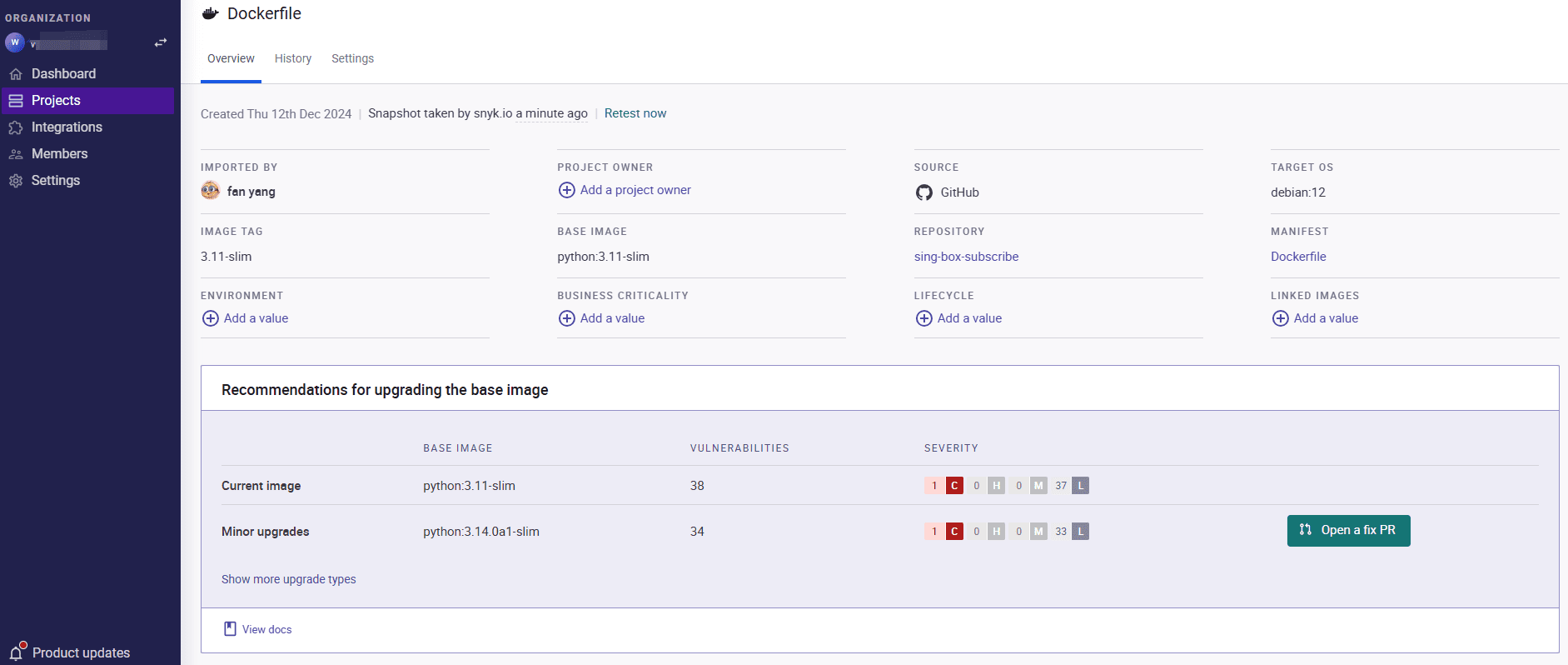

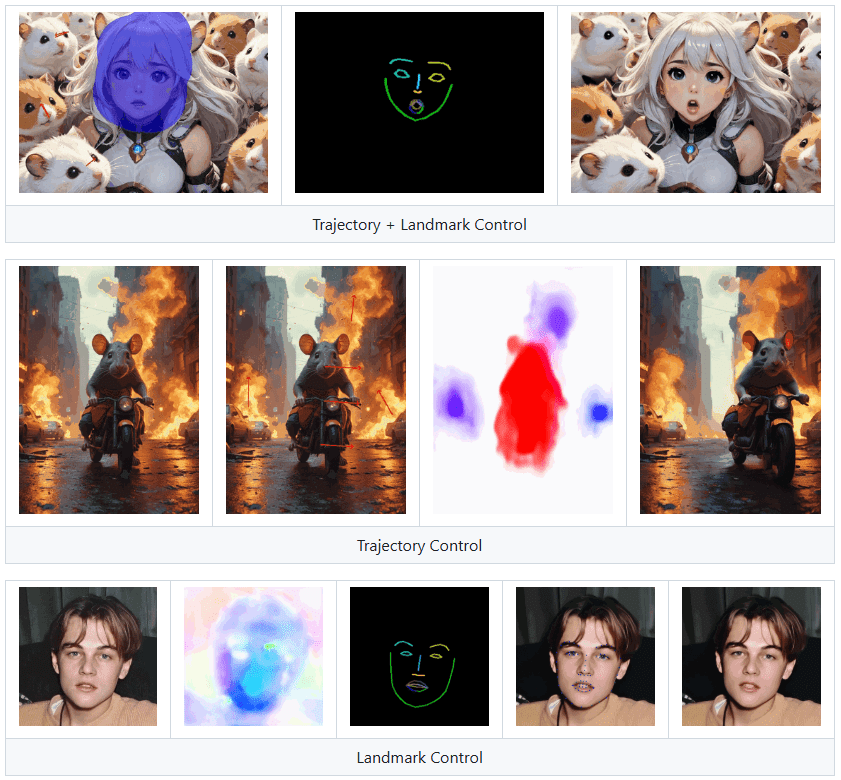

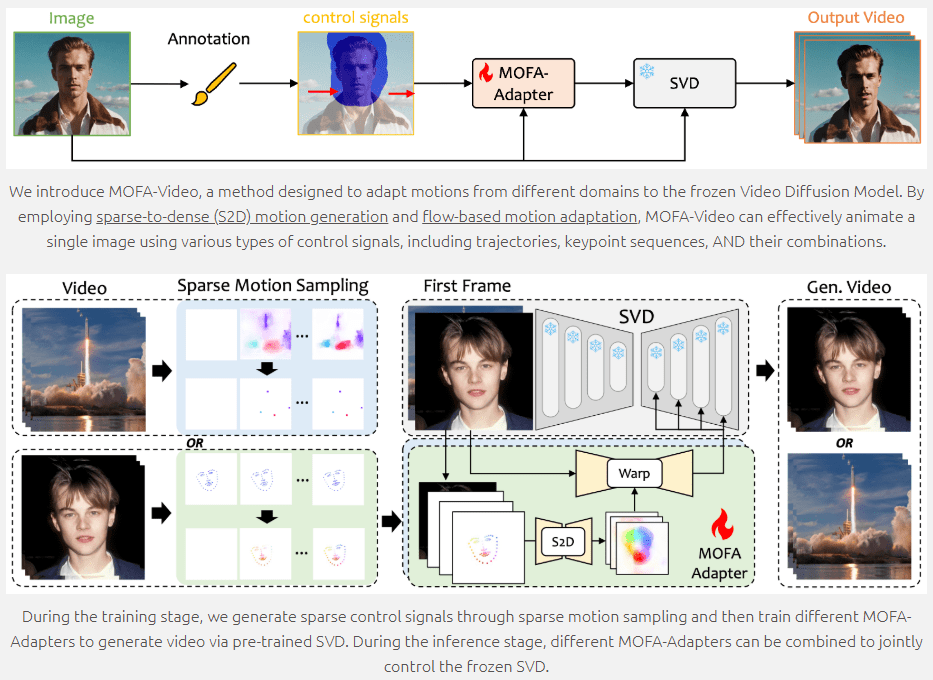

MOFA-Video es una herramienta de generación de animación de imágenes de última generación que utiliza técnicas generativas de adaptación de campos de movimiento para convertir imágenes estáticas en vídeo dinámico. Desarrollado en colaboración con la Universidad de Tokio y Tencent AI Lab, y que se presentará en ECCV 2024, MOFA-Video admite una gran variedad de señales de control, incluidas trayectorias, secuencias de puntos clave y combinaciones de las mismas, lo que permite una animación de imágenes de alta calidad. Los usuarios pueden acceder al código y a los recursos relacionados a través del repositorio de GitHub para empezar a utilizarlo fácilmente.

Landmark Control puede hacer hablar a las personas en imágenes, pero no es adecuado para su uso como clon de una persona digital.

Lista de funciones

- Generación de animación de imágenes: convierte imágenes fijas en vídeo en movimiento.

- Múltiples señales de control: soporta trayectorias, secuencias de puntos clave y combinaciones de las mismas.

- Adaptación del campo de movimiento: animación mediante generación de movimiento de disperso a denso y adaptación del movimiento basada en el flujo.

- Scripts de formación e inferencia: código completo para la formación y la inferencia

- Gradio Demo: Demostración en línea y descarga de puntos de control

- Código abierto: poner el código y los recursos a disposición del público en GitHub

Utilizar la ayuda

Entorno

- almacén de clones

git clone https://github.com/MyNiuuu/MOFA-Video.git

cd ./MOFA-Video

- Crear y activar un entorno Conda

conda create -n mofa python==3.10

conda activate mofa

- Instalación de dependencias

pip install -r requirements.txt

pip install opencv-python-headless

pip install "git+https://github.com/facebookresearch/pytorch3d.git"

- Descargar puntos de control Descargue los puntos de control del repositorio HuggingFace y colóquelos en la carpeta

./MOFA-Video-Hybrid/models/cmp/experiments/semiauto_annot/resnet50_vip+mpii_liteflow/checkpointsCatálogo.

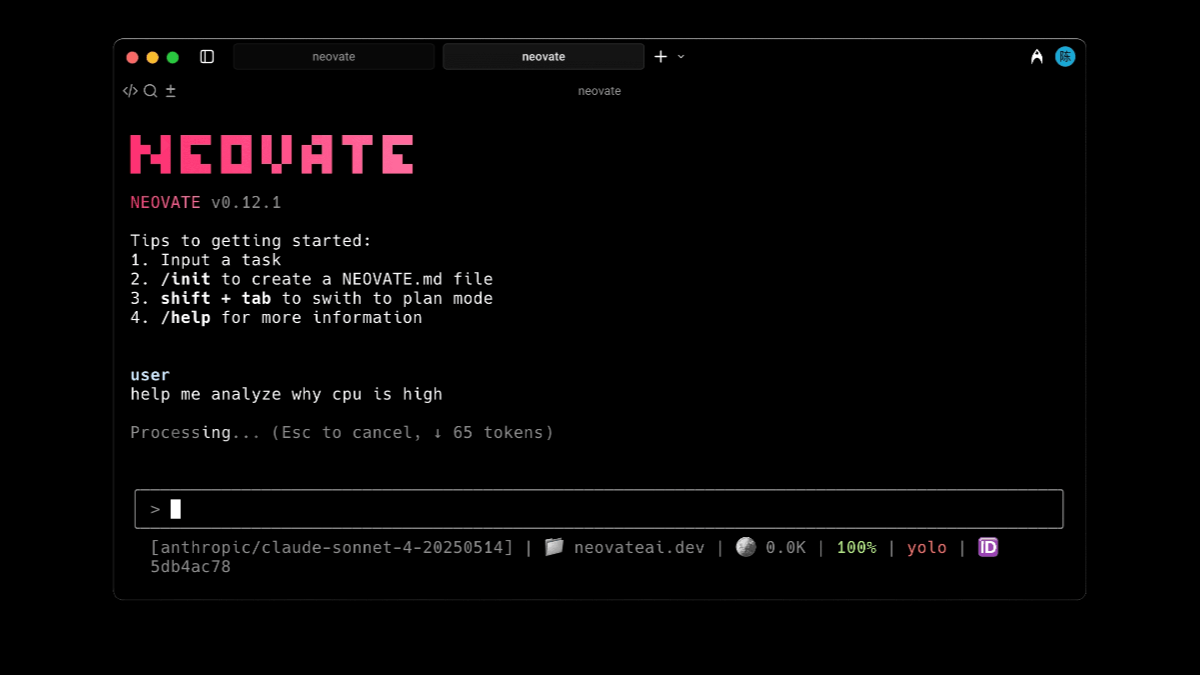

Demostración con Gradio

- Animación facial con audio

cd ./MOFA-Video-Hybrid

python run_gradio_audio_driven.py

- Animación facial con vídeo de referencia

cd ./MOFA-Video-Hybrid

python run_gradio_video_driven.py

La interfaz de Gradio mostrará las instrucciones pertinentes, así que siga las instrucciones de la interfaz para realizar la operación de razonamiento.

Formación y razonamiento

MOFA-Video proporciona scripts completos de entrenamiento e inferencia, que pueden personalizarse según sea necesario. Para obtener instrucciones detalladas, consulte el archivo README en el repositorio de GitHub.

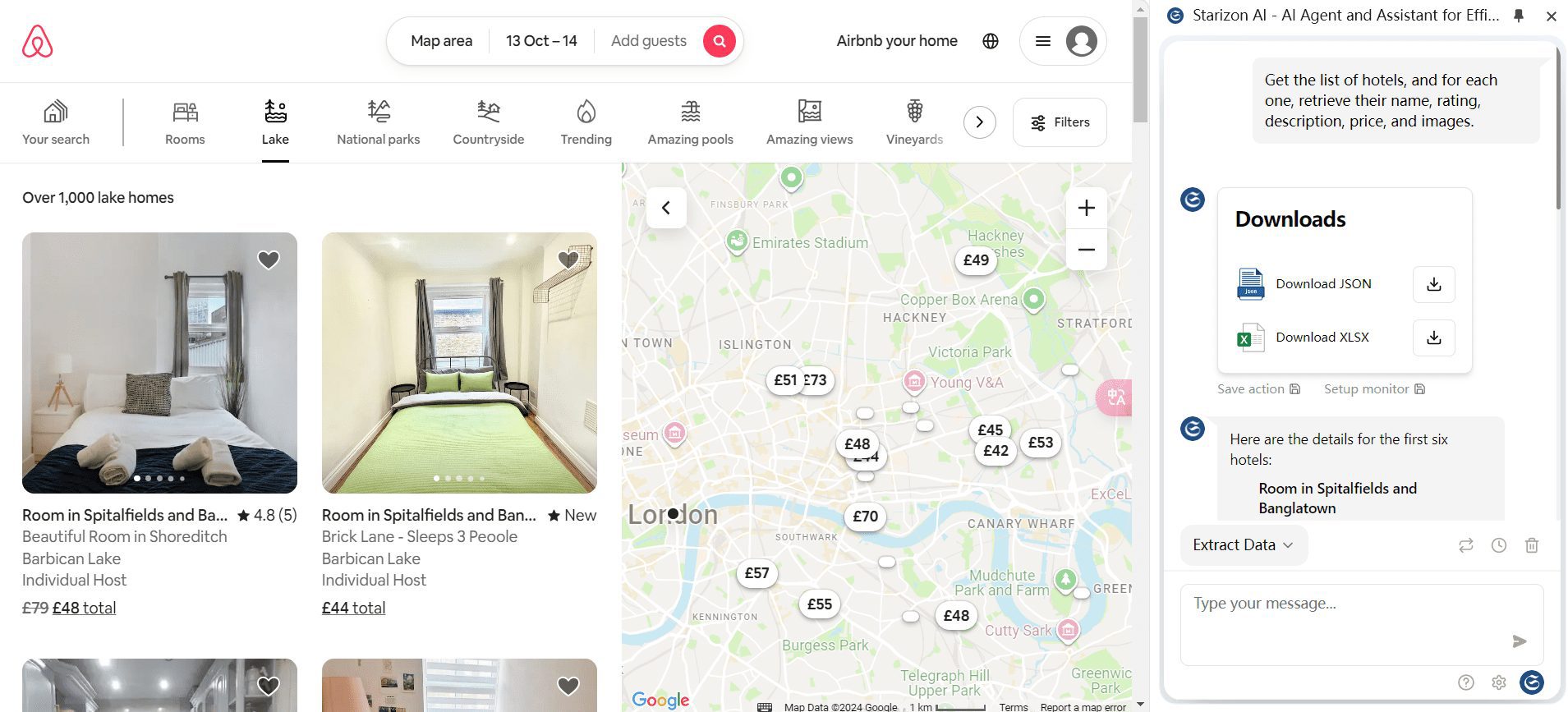

Funciones principales

- Generación de animación de imágenes: Cargue una imagen estática, seleccione las señales de control (trayectoria, secuencia de puntos clave o una combinación de ellas) y haga clic en el botón Generar para generar un vídeo dinámico.

- Múltiples señales de control: los usuarios pueden elegir distintas combinaciones de señales de control para conseguir efectos de animación más ricos.

- Adaptación del campo de movimiento: Garantice efectos de animación suaves y naturales mediante la generación de movimiento de disperso a denso y técnicas de adaptación del movimiento basadas en el flujo.

MOFA-Video ofrece numerosas funciones e instrucciones detalladas para que los usuarios generen animaciones de imágenes y personalicen la formación según sus necesidades, y consigan fácilmente efectos de animación de imágenes de alta calidad.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...