MiMo-VL: el modelo multimodal de código abierto de Xiaomi

Últimos recursos sobre IAActualizado hace 10 meses Círculo de intercambio de inteligencia artificial 48.3K 00

Qué es MiMo-VL

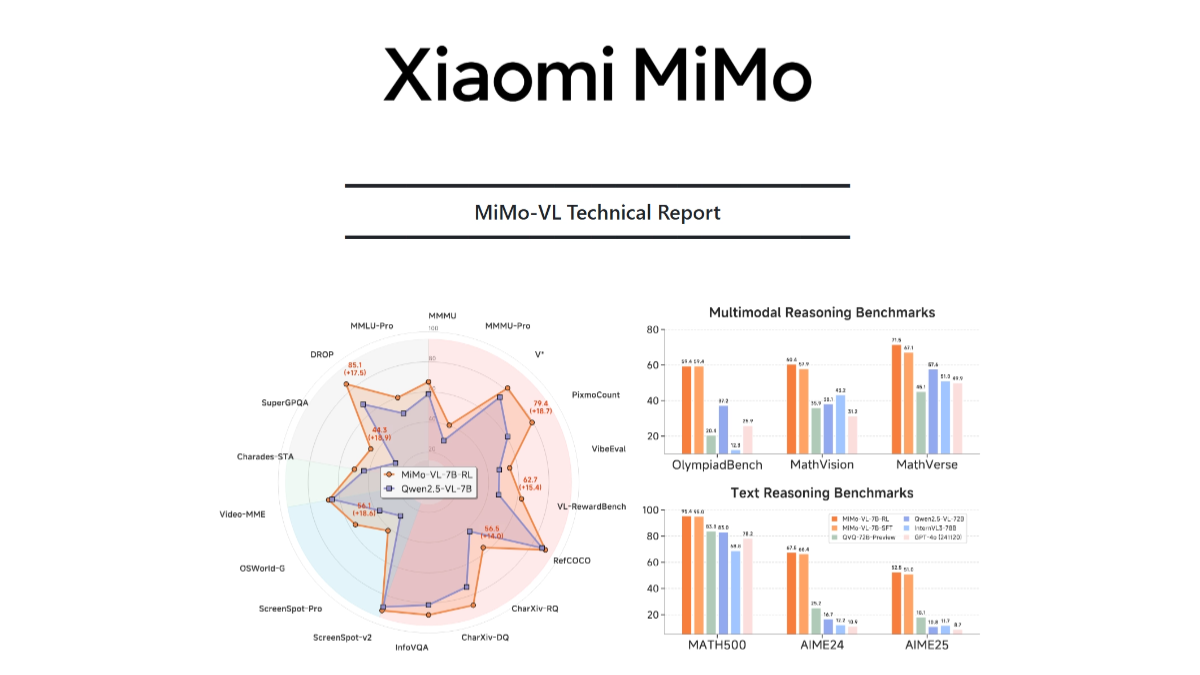

MiMo-VL es el gran modelo multimodal de código abierto de Xiaomi, que consta de un codificador visual, una capa de proyección multimodal y un modelo de lenguaje. El codificador visual se basa en Qwen2.5-ViT, que admite entradas con resolución nativa y conserva más detalles; el modelo de lenguaje es el MiMo-7B de desarrollo propio de Xiaomi, optimizado para el razonamiento complejo. El modelo se basa en una estrategia de preentrenamiento en varias fases, entrenada con 2,4T de tokens de datos multimodales, que abarcan tipos de datos como pares imagen-texto, pares vídeo-texto y secuencias de operaciones GUI. Basado en el algoritmo híbrido de aprendizaje por refuerzo en línea (MORL), el modelo de inferencia, el rendimiento perceptivo y la experiencia del usuario mejoran en todos los aspectos. MiMo-VL obtiene buenos resultados en la inferencia de imágenes complejas, la interacción con interfaces gráficas de usuario, la comprensión de vídeos y el análisis sintáctico de documentos largos. Por ejemplo, alcanza 66,7% en MMMU-val, superando a Gemma 3 27B; 59,4% en OlympiadBench 59,4% en OlympiadBench, superando al modelo 72B.

Características principales de MiMo-VL

- Cuestionario y razonamiento de imágenes complejasComprender con precisión el contenido de imágenes complejas dando explicaciones y respuestas razonables.

- Funcionamiento e interacción con la interfaz gráfica de usuario: Admite hasta más de 10 pasos de operaciones GUI para comprender y ejecutar instrucciones complejas.

- Vídeo y comprensión lingüística: Comprensión del contenido del vídeo, razonamiento y cuestionario en conjunción con el lenguaje.

- Análisis sintáctico y razonamiento de documentos largos: Procesamiento de documentos largos para el razonamiento complejo y la extracción de información.

- Optimización de la experiencia del usuarioMejora de la inferencia, el rendimiento perceptivo y la experiencia del usuario basada en el aprendizaje híbrido por refuerzo en línea.

Dirección del sitio web oficial de MiMo-VL

- Repositorio Github::https://github.com/XiaomiMiMo/MiMo-VL

- Biblioteca de modelos HuggingFace::https://huggingface.co/collections/XiaomiMiMo/mimo-vl

- Documentos técnicos::https://github.com/XiaomiMiMo/MiMo-VL/blob/main/MiMo-VL-Technical-Report

Cómo utilizar MiMo-VL

- Plataforma Cara Abrazada::

- Acceso a la biblioteca de modelos Hugging FaceAcceso a MiMo-VLBiblioteca de modelos de caras abrazadasPágina.

- Modelos de cargaUtiliza la biblioteca Python de Hugging Face para cargar el modelo MiMo-VL. Ejemplo:

from transformers import AutoModelForVision2Seq, AutoProcessor

model = AutoModelForVision2Seq.from_pretrained("XiaomiMiMo/mimo-vl")

processor = AutoProcessor.from_pretrained("XiaomiMiMo/mimo-vl")- Tratamiento de los datos de entradaDatos de entrada: los datos de entrada, como imágenes, vídeos o texto, se preprocesan en función del procesador.

- Generar salidaIntroducción de los datos procesados en el modelo y obtención de la salida del modelo.

- Repositorio GitHub::

- Clonación de repositorios de GitHub: AccesoRepositorio GitHubclone el repositorio localmente.

git clone https://github.com/XiaomiMiMo/MiMo-VL.git- Instalación de dependenciasInstale las dependencias de Python necesarias según el archivo requirements.txt del repositorio.

pip install -r requirements.txt- código en ejecuciónSiga las instrucciones del repositorio para ejecutar el código de ejemplo o abrir una aplicación.

Principales ventajas de MiMo-VL

- Gran capacidad de fusión multimodal: Procesamiento de datos multimodales como imágenes, vídeo y texto para comprender escenarios complejos.

- Excelente rendimiento de inferenciaExcelente rendimiento en varias pruebas, como 66,71 TP3T en MMMU-val y 59,41 TP3T en OlympiadBench.

- Optimización de la experiencia del usuario: Basado en el aprendizaje por refuerzo mixto en línea (MORL), los comportamientos de los modelos se ajustan dinámicamente en función de los comentarios de los usuarios para mejorar su experiencia.

- Amplia gama de aplicacionesAplicable a diversos campos, como la atención al cliente inteligente, el hogar inteligente y la investigación científica.

- Código abierto y apoyo comunitario: Proporcionar código fuente abierto y apoyo comunitario para facilitar la investigación y el desarrollo de los desarrolladores.

Personas con derecho a MiMo-VL

- Investigadores de IA: Se centra en la investigación en los ámbitos de la fusión multimodal, el razonamiento complejo, la visión y la comprensión del lenguaje.

- Desarrolladores e ingenierosEl desarrollo de aplicaciones inteligentes, como el servicio inteligente de atención al cliente, el hogar inteligente, la sanidad inteligente, etc., requiere la integración de funcionalidades multimodales.

- científico de datos: Tratamiento y análisis de datos multimodales para mejorar el rendimiento de los modelos y la eficacia del tratamiento de datos.

- Educadores y estudiantes: Ayudas a la enseñanza y el aprendizaje, por ejemplo, resolución de problemas matemáticos, aprendizaje de programación, etc.

- Profesionales médicos: Ayuda al análisis de imágenes médicas y a la comprensión de textos para mejorar la eficacia y la precisión del diagnóstico.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...