LLM API Engine: generación y despliegue rápidos de API mediante lenguaje natural

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 55.6K 00

Introducción general

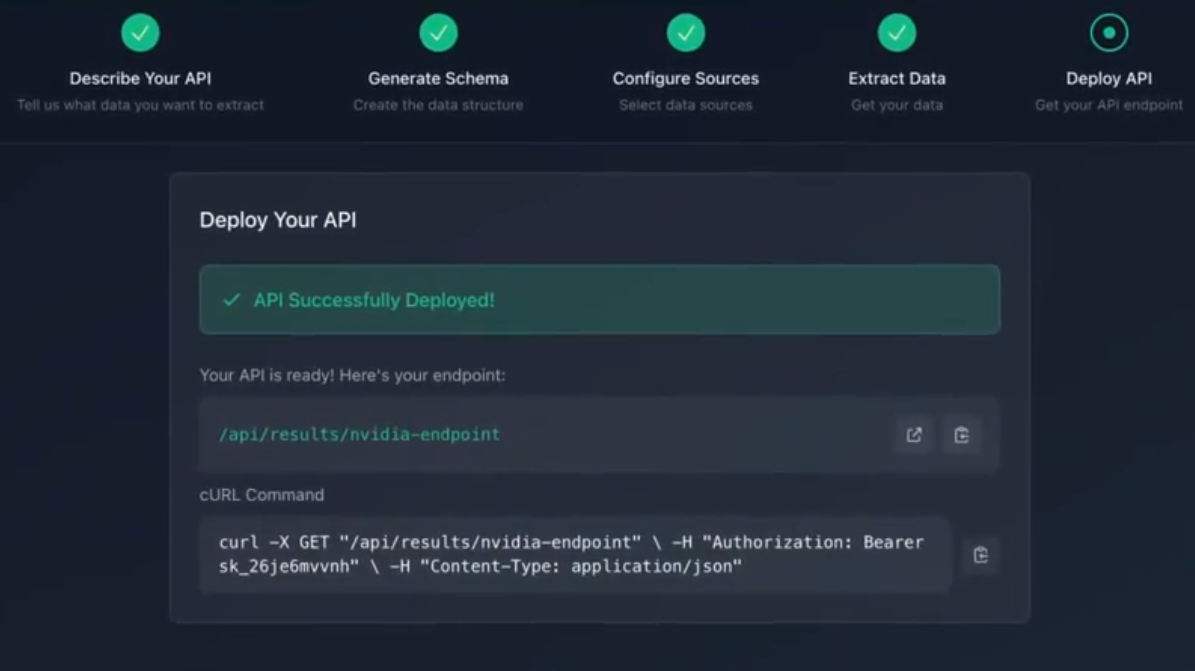

LLM API Engine es un proyecto de código abierto diseñado para ayudar a los desarrolladores a crear e implementar rápidamente API impulsadas por IA.El proyecto aprovecha el Large Language Model (LLM) y la tecnología de rastreo web inteligente para permitir a los usuarios crear API personalizadas a través de descripciones en lenguaje natural.Las características clave incluyen la generación automática de estructuras de datos, actualizaciones de datos en tiempo real, salida de datos estructurados y opciones de implementación flexibles. El motor de API LLM tiene una arquitectura modular que admite la implementación de puntos finales de API en múltiples plataformas, como Cloudflare Workers, Vercel Edge Functions y AWS Lambda.

Lista de funciones

- Conversión de texto a API: Genera APIs con descripciones sencillas en lenguaje natural.

- Generación automática de estructuras de datos: Generación automática de estructuras de datos mediante tecnología OpenAI.

- Rastreo web inteligente: Rastreo de datos de páginas web mediante la tecnología Firecrawl.

- Actualización de datos en tiempo realSoporte para rastreos cronometrados y actualizaciones de datos en tiempo real.

- Despliegue instantáneo de APIDespliegue rápido de puntos finales de API.

- Salida de datos estructuradosValida los datos de salida mediante el esquema JSON.

- Arquitectura de almacenamiento y caché: Utiliza Redis para caché y almacenamiento.

Utilizar la ayuda

Proceso de instalación

- almacén de clones::

git clone https://github.com/developersdigest/llm-api-engine.git

cd llm-api-engine

- Instalación de dependencias::

npm install

- Creación de un archivo de variables de entornoCrear en el directorio raíz del proyecto

.envy añada las siguientes variables:

OPENAI_API_KEY=your_openai_key

FIRECRAWL_API_KEY=your_firecrawl_key

UPSTASH_REDIS_REST_URL=your_redis_url

UPSTASH_REDIS_REST_TOKEN=your_redis_token

NEXT_PUBLIC_API_ROUTE=http://localhost:3000

- Ejecutar el servidor de desarrollo::

npm run dev

Abra su navegador para acceder ahttp://localhost:3000Ver aplicación.

Función Flujo de operaciones

- Creación de puntos finales de API::

- Visite la página de inicio de la aplicación y haga clic en el botón "Crear nueva API".

- Introduzca el nombre y la descripción de la API y seleccione el tipo de fuente de datos (por ejemplo, rastreo web).

- Utilizar el lenguaje natural para describir las estructuras de datos y las reglas de rastreo necesarias.

- Haga clic en el botón "Generar API", el sistema generará automáticamente los puntos finales de la API y las estructuras de datos.

- Configuración y gestión de la API::

- Consulte la lista de API creadas en la pantalla Gestión de API.

- Haga clic en una API para ir a la página de detalles, donde puede editar la configuración de la API, ver los registros de rastreo y probar los puntos finales de la API.

- Configurado mediante la API de almacenamiento Redis, con soporte para cambios y actualizaciones en cualquier momento.

- Despliegue de puntos finales de API::

- Seleccione la plataforma de despliegue (por ejemplo, Vercel, AWS Lambda, etc.).

- Configure los parámetros de despliegue según los requisitos de la plataforma y pulse el botón "Desplegar".

- Una vez completado el despliegue, puede ver la URL y el estado del punto final de la API en la pantalla "Gestión de la API".

- Uso de los puntos finales de la API::

- Llame a los puntos finales de la API en su aplicación para obtener datos estructurados.

- Admite el acceso a los puntos finales de la API mediante solicitudes HTTP que devuelven datos en formato JSON.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...