llamafile: Distribuye y ejecuta LLMs utilizando un único archivo, simplifica el despliegue de LLMs, soporte multiplataforma para LLMs.

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 56.3K 00

Introducción general

llamafile es una herramienta del proyecto Mozilla Builders diseñada para simplificar el despliegue y funcionamiento del Large Language Model (LLM). Combinando el llama.cpp Junto con Cosmopolitan Libc, llamafile simplifica el complejo proceso de despliegue de LLM en un único archivo ejecutable que admite la ejecución local en una amplia gama de sistemas operativos sin necesidad de instalación. La herramienta no sólo admite diálogos de texto, sino que también gestiona la introducción de imágenes para garantizar la privacidad de los datos.

Lista de funciones

- Operación con un solo archivoEmpaqueta el modelo LLM y el entorno de ejecución en un único ejecutable.

- Compatibilidad multiplataformaCompatible con Windows, macOS, Linux, FreeBSD, OpenBSD y NetBSD.

- funcionamiento localNo se requiere conexión a Internet y todo el procesamiento de datos se realiza localmente para garantizar la privacidad y la seguridad.

- apoyo multimodal: Admite la introducción de texto e imágenes, lo que proporciona ricas funciones interactivas.

- Compatible con la API OpenAI: Proporciona una interfaz compatible con la API OpenAI para facilitar la integración con las aplicaciones existentes.

- alto rendimientoNúcleo de multiplicación de matrices optimizado para un funcionamiento más rápido en CPU y GPU.

- proyecto de código abiertoCódigo fuente abierto, contribuciones activas de la comunidad, actualizaciones y optimizaciones continuas.

Utilizar la ayuda

Instalación y funcionamiento

- Descargar llamafile: Acceso Página de GitHub Descarga la última versión de llamafile.

- Delegación de la autoridad ejecutiva(para usuarios de macOS, Linux y BSD):

chmod +x path/to/llamafile - Ejecutar llamafile::

- Para usuarios de macOS, Linux y BSD:

./path/to/llamafile - Para usuarios de Windows: Cambie el nombre del archivo a

.exey ejecutar:.\path\to\llamafile.exe

- Para usuarios de macOS, Linux y BSD:

Función Operación

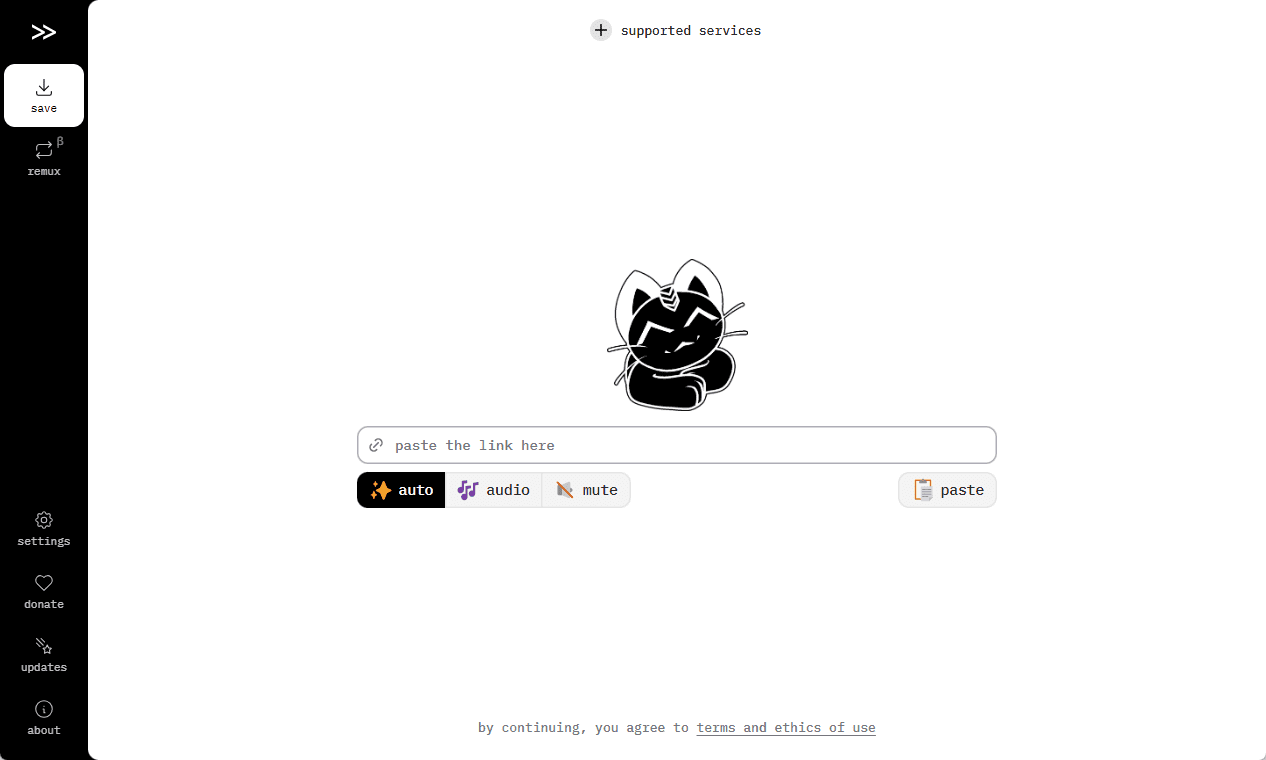

- Inicio de la Interfaz WebDespués de ejecutar llamafile, el navegador abrirá automáticamente una pantalla de chat (si no lo hace, visítala manualmente).

http://127.0.0.1:8080/). - Uso de la interfaz API de OpenAILlamafile proporciona una interfaz compatible con la API de OpenAI y admite casos de uso comunes de la API. Se puede invocar con los siguientes comandos:

curl http://localhost:8080/v1/chat/completions -H "Content-Type: application/json" -d '{ "model": "LLaMA_CPP", "messages": [{"role": "user", "content": "Hello, world!"}] }' - entrada de imagen: Sube imágenes y haz preguntas sobre ellas, por ejemplo:

curl -X POST http://localhost:8080/v1/images -F "image=@path/to/image.jpg" -F "prompt=Describe this image" - modo de línea de comandosLlamafile también admite el modo de línea de comandos para operaciones programadas:

./path/to/llamafile --cli -p "Your prompt here"

problemas comunes

- Cuestiones de competenciaSi se encuentra con problemas de permisos, asegúrese de que el archivo tiene permisos de ejecución (utilice la función

chmod +xcomando). - Límite de tamaño de los archivos: Los usuarios de Windows deben tener en cuenta que el tamaño de un único archivo ejecutable no puede superar los 4 GB, y que se pueden utilizar archivos de peso externos para resolver este problema.

- Cuestiones de dependenciaLos usuarios de macOS deben instalar Xcode Comando Line Tools, es posible que los usuarios de Linux tengan que instalar el SDK de CUDA o el SDK de ROCm para poder utilizar la aceleración por GPU.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...