Lepton Search: motor de búsqueda conversacional de IA de código abierto|Lepton Search

Últimos recursos sobre IAPublicado hace 2 años Círculo de intercambio de inteligencia artificial 52K 00

Búsqueda Lepton Introducción general

Lepton Search es un motor de búsqueda de IA conversacional, lanzado por Jia Yangqing y construido utilizando la plataforma de IA Lepton.Lepton Search busca proactivamente datos en la web y los organiza en respuestas estructuradas y lógicas basadas en las preguntas en lenguaje natural de un usuario, acompañadas de la fuente de la información.Lepton Search no sólo responde a preguntas intelectuales comunes como "¿Es un electrón un leptón?" o "¿Cuándo llegó el hombre por primera vez a la Luna?". Lepton Search también puede responder a preguntas complejas como "¿Por qué cayó la manzana?" o "¿Cómo escribo un chatbot en Python?". El código de Lepton Search es de código abierto, por lo que los desarrolladores pueden desplegarlo y modificarlo ellos mismos, o utilizar la plataforma Lepton AI para crear rápidamente sus propias aplicaciones de IA conversacional.

Lepton Search Home

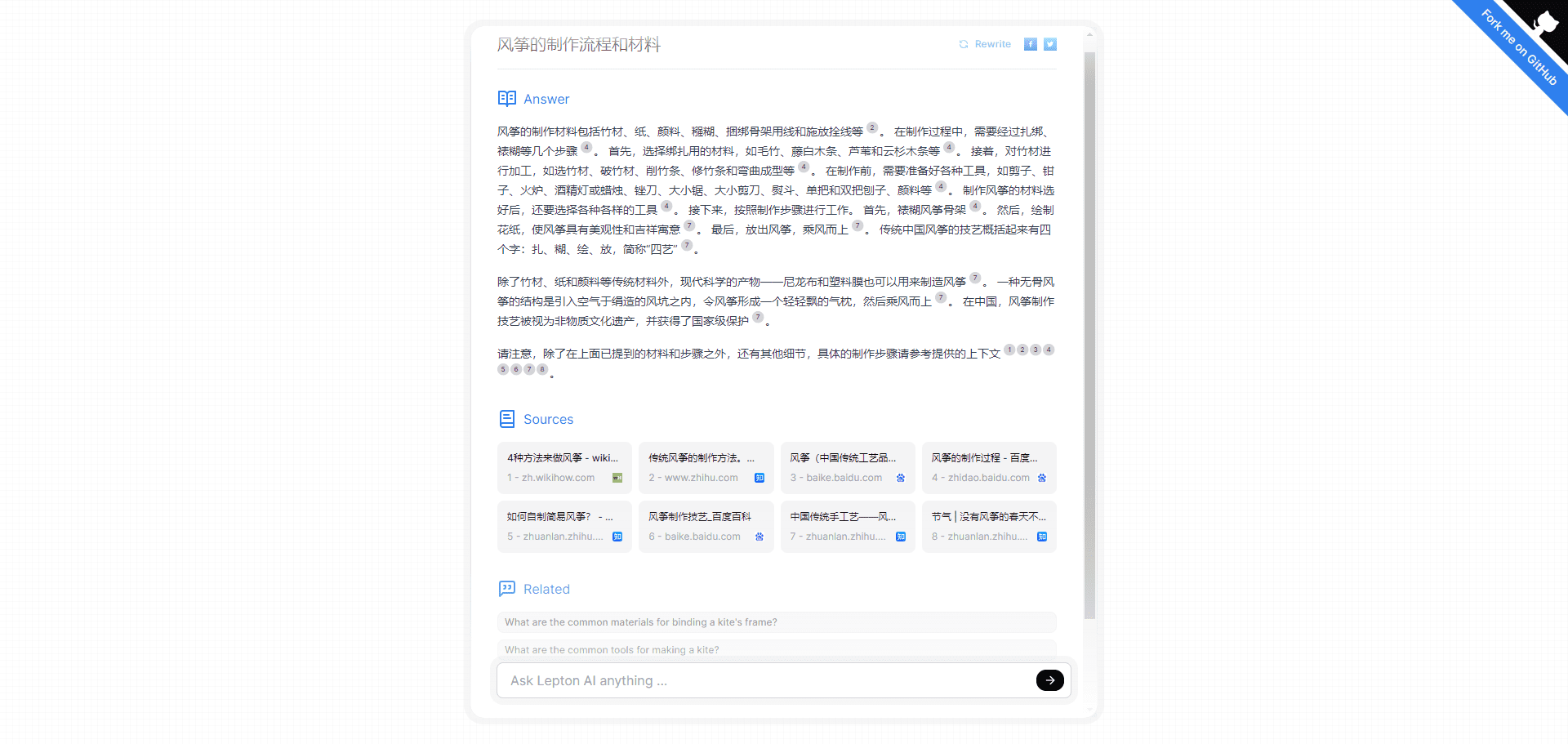

Lepton Search Página de resultados de la búsqueda

Lista de funciones de búsqueda de Lepton

- Admite entrada y salida en lenguaje natural

- Admite muchos tipos de preguntas, incluidas las basadas en el conocimiento, las basadas en la causa y las basadas en el método.

- Admite múltiples fuentes de datos, como Wikipedia, Twitter, Google, Bing, etc.

- Admite varios idiomas, como inglés, chino, japonés, etc.

- Admite diversos métodos de visualización, como texto, imágenes, tablas, gráficos, etc.

- Admite múltiples métodos de interacción, como web, línea de comandos, API, etc.

Ayuda para la búsqueda de Lepton

- En la versión web, escriba la pregunta que desea buscar y pulse Intro o haga clic en el botón de búsqueda para ver las respuestas de Lepton Search.

- Consulta la documentación en el repositorio oficial de GitHub.

- Puedes construir tu propio motor de búsqueda según la demo oficial.

- Los desarrolladores pueden utilizar libremente el código fuente abierto bajo la Licencia Apache.

Comentario del código de búsqueda Lepton

# Importación de las bibliotecas y módulos necesarios

import concurrent.futures # para la ejecución concurrente de tareas

importar glob # para la correspondencia de patrones de rutas de archivos

import json # para procesar datos JSON

import os # Se utiliza para manipular el sistema de archivos

importar re # para la concordancia de expresiones regulares

import threading # para operaciones de roscado

importar solicitudes # Se utiliza para iniciar solicitudes de red

import traceback # Utilizado para rastrear información de excepciones

from typing import Anotado, Lista, Generador, Opcional # para anotaciones de tipo# Importación de clases y excepciones relacionadas con FastAPI

from fastapi import HTTPException

from fastapi.responses import HTMLResponse, StreamingResponse, RedirectResponse

importar httpx # para peticiones HTTP

from loguru import logger # para el registro# Importación de bibliotecas y módulos Lepton relacionados con la IA

importar leptonai

from leptonai import Cliente

from leptonai.kv import KV # para almacenamiento clave-valor

from leptonai.photon import Photon, StaticFiles # para el desarrollo de aplicaciones Photon

from leptonai.photon.types import to_bool # para conversión booleana

from leptonai.api.workspace import WorkspaceInfoLocalRecord # para información del espacio de trabajo

from leptonai.util import tool # contiene algunas utilidadesValores constantes del modelo RAG #

BING_SEARCH_V7_ENDPOINT = "https://api.bing.microsoft.com/v7.0/search" # Puntos finales de la API de búsqueda de Bing

BING_MKT = "es-US" # Bing Search Marketplace

GOOGLE_SEARCH_ENDPOINT = "https://customsearch.googleapis.com/customsearch/v1" # Puntos finales de la API de búsqueda personalizada de Google

SERPER_SEARCH_ENDPOINT = "https://google.serper.dev/search" # Puntos finales de la API de búsqueda de Serper

SEARCHAPI_SEARCH_ENDPOINT = "https://www.searchapi.io/api/v1/search" # SearchApi Puntos finales de la API de búsqueda# Número de resultados encontrados

RECUENTO_DE_REFERENCIAS = 8# Tiempo de espera de búsqueda

DEFAULT_SEARCH_ENGINE_TIMEOUT = 5# Consulta por defecto

_default_query = "¿Quién dijo 'larga vida y prosperidad'?"Plantilla de texto de consulta para el modelo RAG #

_rag_query_text = """Eres un asistente de inteligencia artificial de gran tamaño construido por Lepton AI. Cuando recibas una pregunta de un usuario, proporciona una respuesta limpia, concisa y precisa. Se le dará una serie de contextos relacionados con la pregunta, cada uno precedido por un número de cita como [[cita:x]], donde x es un número. Utilice estos contextos y, cuando proceda, cite el número de contexto al final de cada frase.

Su respuesta debe ser correcta, precisa y redactada por un experto en un tono neutro y profesional. Por favor, limítese a 1024 tokens. No proporcione información que no sea relevante para la pregunta y no se repita. Si el contexto dado no proporciona suficiente información, diga "Falta información sobre... Falta información sobre...".

Cite el contexto en formato de número de cita, por ejemplo [cita:x]. Si una frase procede de más de un contexto, enumere todas las citas aplicables, por ejemplo [cita:3][cita:5]. A excepción de los códigos, nombres específicos y citas, su respuesta debe estar en la misma lengua que la pregunta.

He aquí una serie de contextos:

{contexto}

Recuerda, no repitas ciegamente el contexto al pie de la letra. Aquí el problema es del usuario:

"""

# Lista de palabras con discapacidad

palabras_de_parada = [

"",

"[Fin]",

"[fin]",

"Referencias".

"fuentes:fuentes".

"Fin",

]# Generar texto de alerta sobre temas relevantes

_more_questions_prompt = """Usted es un asistente útil para ayudar a los usuarios a formular preguntas pertinentes basadas en la pregunta original y su contexto asociado. Por favor, identifique los temas sobre los que merece la pena hacer un seguimiento y hágalos en preguntas de no más de 20 palabras. Asegúrese de que en las preguntas de seguimiento se incluye información específica, como eventos, nombres, lugares, etc., para que puedan formularse de forma independiente. Por ejemplo, si en la pregunta original se preguntaba por el Proyecto Manhattan, en la pregunta de seguimiento, en lugar de decir simplemente "el proyecto", utiliza el nombre completo, "El Proyecto Manhattan". Las preguntas complementarias deben formularse en el mismo idioma que la pregunta original.

He aquí el contexto de la pregunta:

{contexto}

No olvide formular tres preguntas adicionales basadas en la pregunta original y en el contexto pertinente. No repita la pregunta original. Cada pregunta relacionada no debe tener más de 20 palabras. Ésta es la pregunta original:

"""

# Se definen las siguientes funciones de búsqueda para interactuar con diferentes motores de búsqueda

def buscar_con_bing(consulta: cadena, clave_suscripción: cadena).

# Búsqueda con el motor de búsqueda Bing y devolución de información contextual

pasedef search_with_google(query: str, subscription_key: str, cx: str).

# Buscar y devolver información contextual utilizando el motor de búsqueda de Google

pasedef buscar_con_serper(consulta: cadena, clave_suscripción: cadena).

# Buscar y devolver información contextual utilizando el motor de búsqueda Serper

pasedef search_with_searchapi(query: str, subscription_key: str).

# Búsqueda con SearchApi.io y devolución de información contextual

paseClase RAG #, heredada de Photon, utilizada para construir el motor RAG

clase RAG(Fotón).

# Inicialización de clases y definición de métodos

pase# Si este script se ejecuta directamente, se inicia la aplicación RAG

si __name__ == "__main__".

trapo = RAG()

rag.launch()

dirección de código abierto

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...