Tutorial: Integración perfecta de la base de conocimientos FastGPT en el flujo de trabajo n8n (basado en el protocolo MCP)

Tutoriales prácticos sobre IAPublicado hace 11 meses Círculo de intercambio de inteligencia artificial 72K 00

Antecedentes: Retos de la integración de n8n con la base de conocimientos del GAR

n8n está ganando tracción como una potente herramienta de flujo de trabajo automatizado de código abierto. Fundada en 2019 por Jan Oberhauser, antiguo diseñador visual de Piratas del Caribe, pretende ofrecer una solución de automatización más flexible y menos costosa que herramientas como Zapier. Con una filosofía de ser "libre y sostenible, abierta y pragmática", n8n se centra en la idea de automatizar el flujo de trabajo a través de Visualización y código Modo dual, que permite a los usuarios conectar distintas aplicaciones para automatizar procesos complejos (documentación oficial: https://docs.n8n.io/). Una vez que los usuarios se familiarizan con él, la creación de flujos de trabajo sencillos suele ser bastante rápida, y el soporte para publicar flujos de trabajo en la red pública con un solo clic proporciona una gran comodidad.

A menudo se describe a n8n como el "Lego de la automatización", haciendo hincapié en su flexibilidad y combinabilidad.

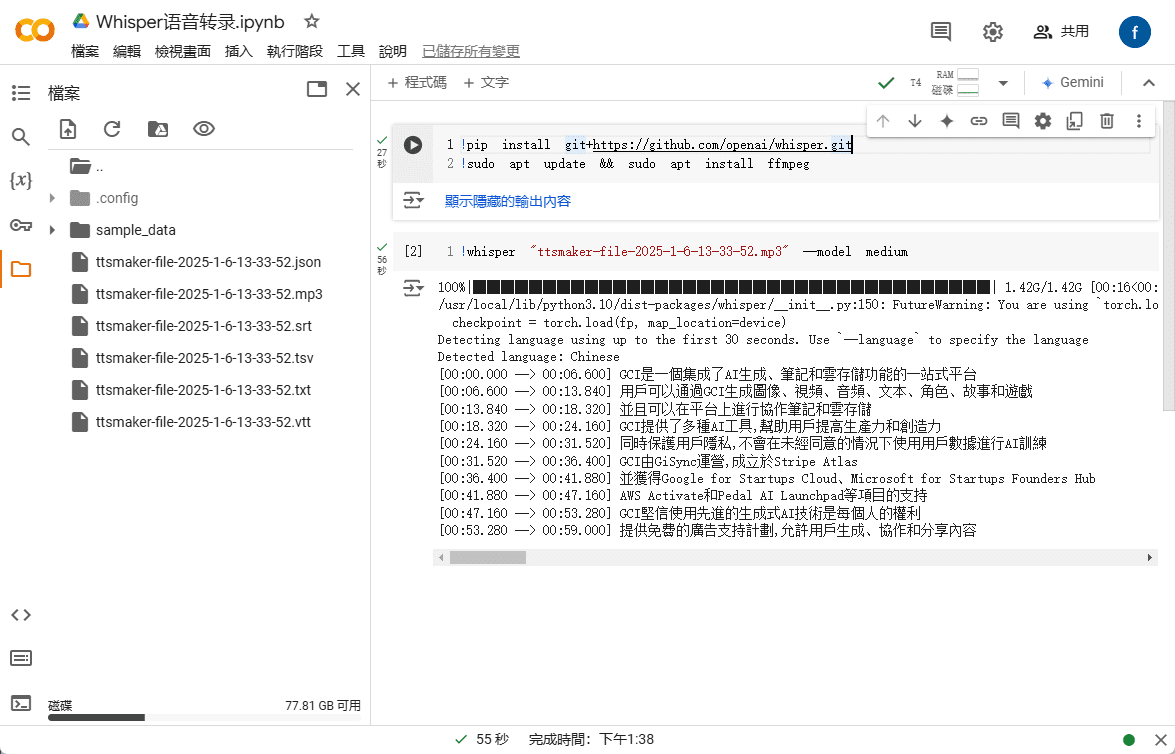

Sin embargo, en el contexto de la creciente popularidad de las aplicaciones de IA, ha surgido una necesidad común: ¿cómo integrar eficazmente las bases de conocimiento RAG (Retrieval-Augmented Generation) en n8n? RAG es una tecnología que combina la recuperación de información y la generación de textos, lo que permite a los grandes modelos lingüísticos hacer referencia a bases de conocimiento externas al responder preguntas, proporcionando así respuestas más precisas y contextualizadas. RAG es una tecnología que combina la recuperación de información y la generación de textos para permitir que grandes modelos lingüísticos se remitan a una base de conocimientos externa al responder preguntas, proporcionando así respuestas más precisas y contextualizadas.

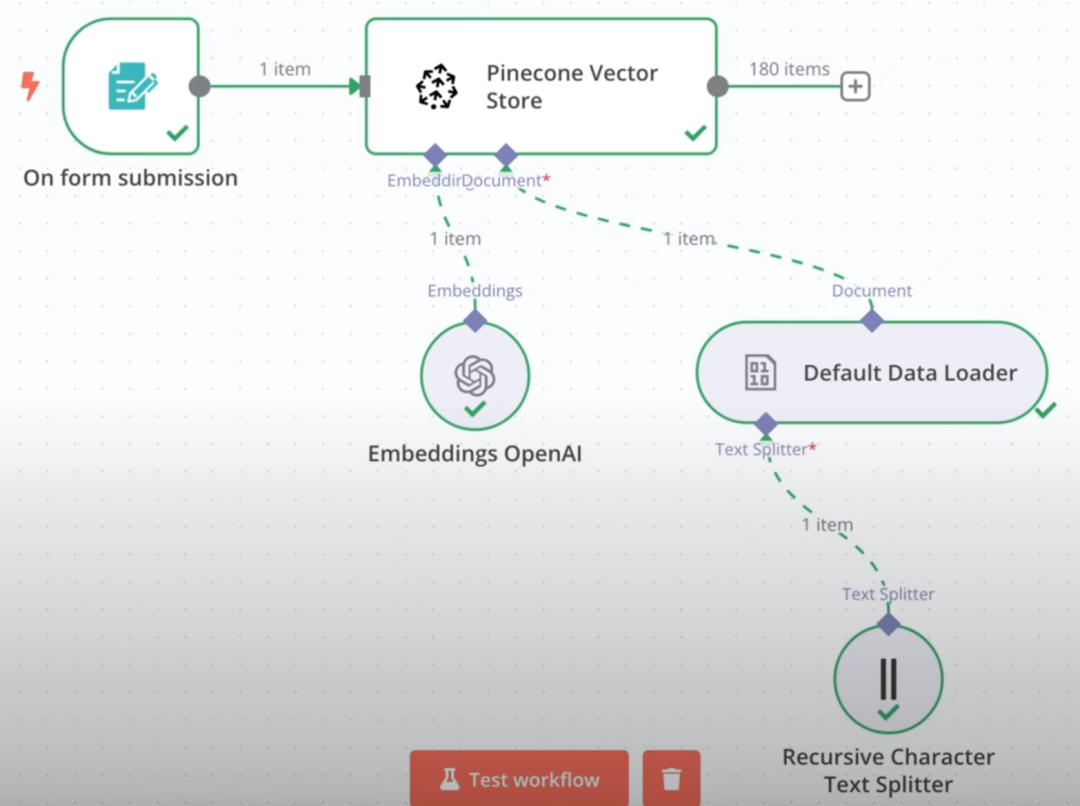

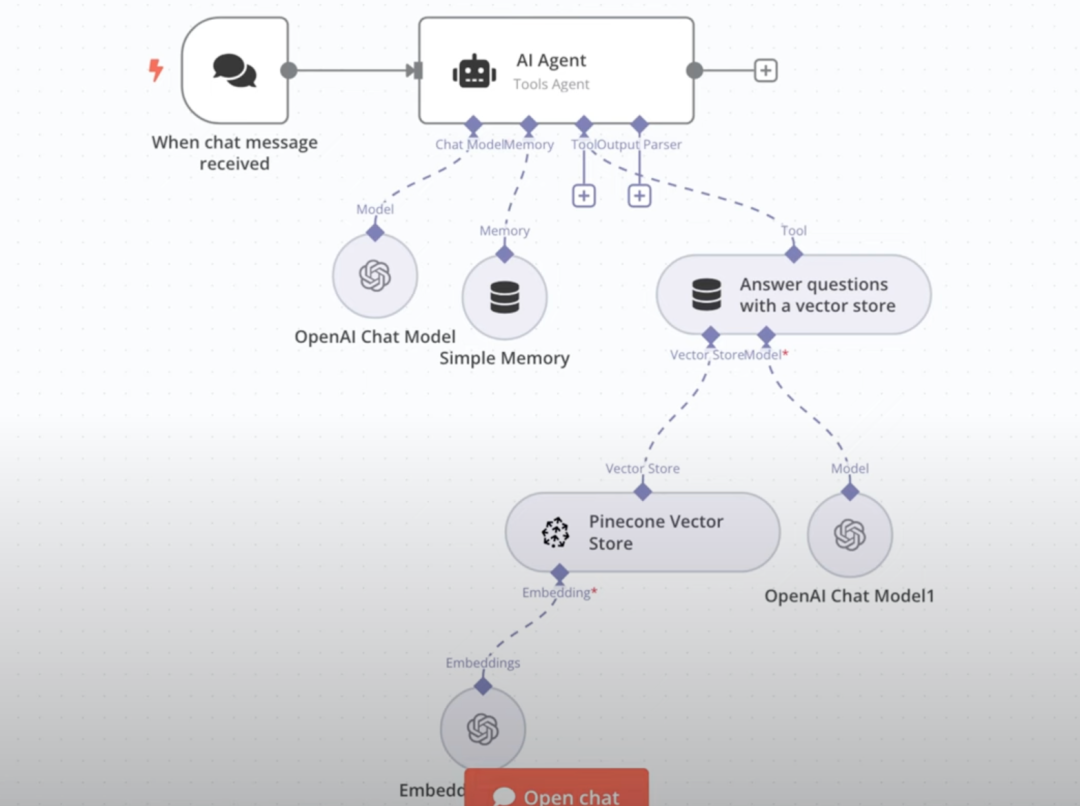

Construir directamente en n8n RAG Las bases de conocimiento han demostrado ser un proceso relativamente complejo. Suelen requerir que los desarrolladores construyan manualmente dos flujos de trabajo distintos: uno para gestionar la carga de archivos, la vectorización y el almacenamiento en una base de datos, y otro para implementar interacciones de preguntas y respuestas basadas en RAG.

Ejemplo: flujo de trabajo de carga de archivos a la izquierda, flujo de trabajo de preguntas y respuestas RAG a la derecha.

Incluso si se construye con éxito, esta solución nativa puede resultar insatisfactoria en términos de experiencia. Esto nos llevó a pensar: ¿es posible conectar a n8n soluciones externas de bases de conocimiento maduras, como la popular FastGPT?

Solución: aprovechar los protocolos FastGPT y MCP

FastGPT es una aclamada plataforma de aplicaciones LLM de código abierto, especialmente conocida por sus potentes funciones RAG y su facilidad de uso. Una reciente actualización de FastGPT (siga su GitHub: https://github.com/labring/FastGPT) aporta una interesante característica: compatibilidad con MCP (Meta Component Protocol).

MCP Diseñado para resolver el problema de interoperabilidad entre diferentes aplicaciones y servicios de IA, FastGPT puede entenderse como un protocolo de "socket universal" que no sólo admite el acceso a otros servicios como cliente MCP, sino que también sirve como servidor MCP, exponiendo sus capacidades (por ejemplo, la base de conocimientos) a otras plataformas compatibles con MCP.

Casualmente, n8n ha soportado recientemente de forma oficial el protocolo MCP. Esto significa que es posible publicar las capacidades de la base de conocimientos de FastGPT a través de MCP, y luego acceder a ellas directamente como una "herramienta" en n8n. Esta solución ha demostrado ser completamente viable y el proceso de interfaz es bastante fluido. Utilizando la madura implementación RAG de FastGPT, los resultados de las preguntas y respuestas de la base de conocimientos integrada suelen ser muy buenos.

Todo el proceso de la operación puede resumirse en los siguientes pasos:

- Despliegue el entorno n8n (local o servidor).

- Despliegue o actualice FastGPT a una versión compatible con MCP.

- Cree y configure el MCP-Server en FastGPT para proporcionar servicios externamente.

- Acceda a este servidor MCP FastGPT en un flujo de trabajo n8n.

Implantación o actualización de FastGPT

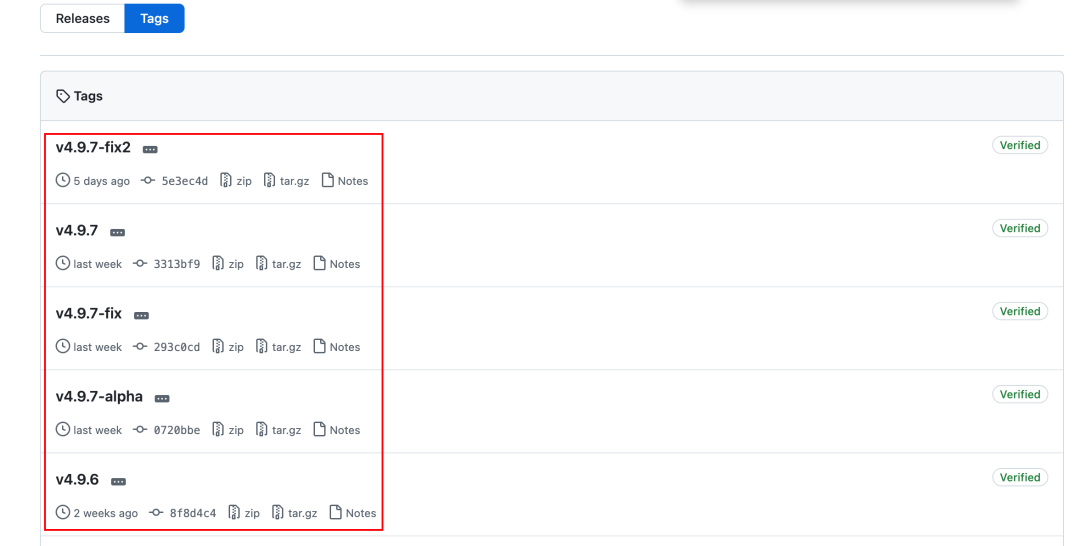

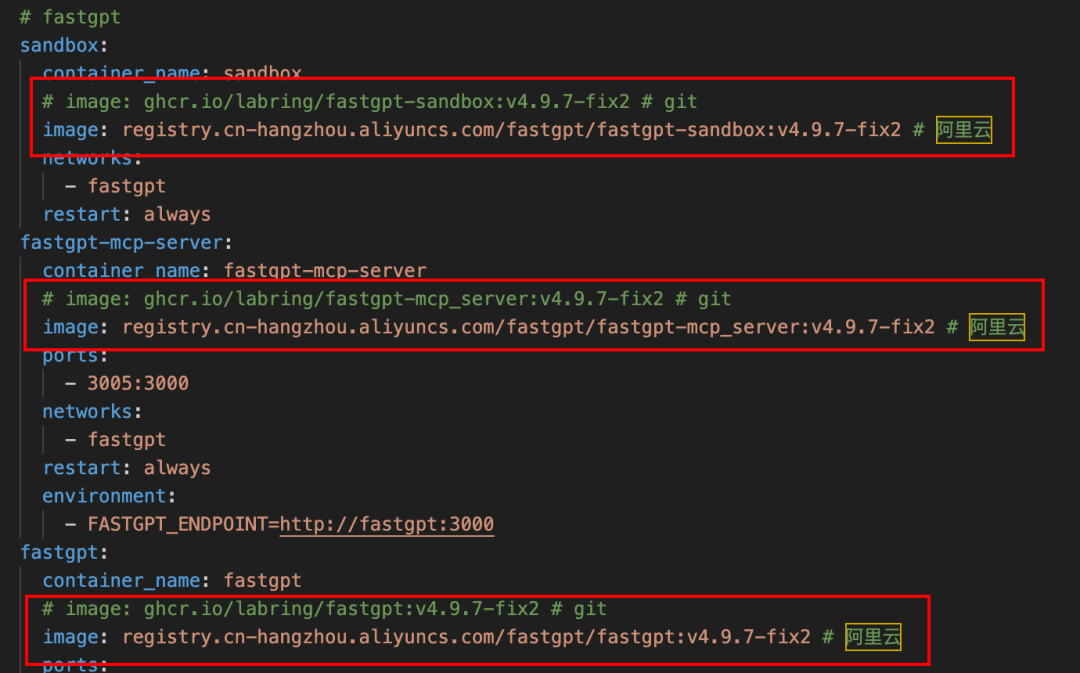

FastGPT ha soportado MCP desde la versión v4.9.6 y se recomienda usar la última versión estable (v4.9.7-fix2 en el momento de escribir esto). Aquí está la introducción del uso de docker-compose Una forma de desplegar o actualizar (requiere un entorno Docker preinstalado).

Es necesario preparar los dos documentos siguientes:

- FastGPT Más reciente

docker-compose.ymlDocumentación. - FastGPT Más reciente

config.jsonDocumentación.

Ambos archivos pueden obtenerse en el repositorio GitHub de FastGPT:

docker-compose-pgvector.yml: https://github.com/labring/FastGPT/blob/main/deploy/docker/docker-compose-pgvector.ymlconfig.json: https://raw.githubusercontent.com/labring/FastGPT/refs/heads/main/projects/app/data/config.json

Nota: Si no tienes acceso directo a GitHub, intenta encontrar otra forma de conseguirlo o utiliza una fuente espejo doméstica.

Los siguientes pasos se aplican a las nuevas implantaciones y actualizaciones:

- Si vas a actualizar, asegúrate primero de hacer una copia de seguridad de la antigua.

docker-compose.ymly los volúmenes de datos asociados. - Los últimos datos disponibles se obtendrán del

docker-compose.ymlresponder cantandoconfig.jsonLos archivos se colocan en el mismo directorio.

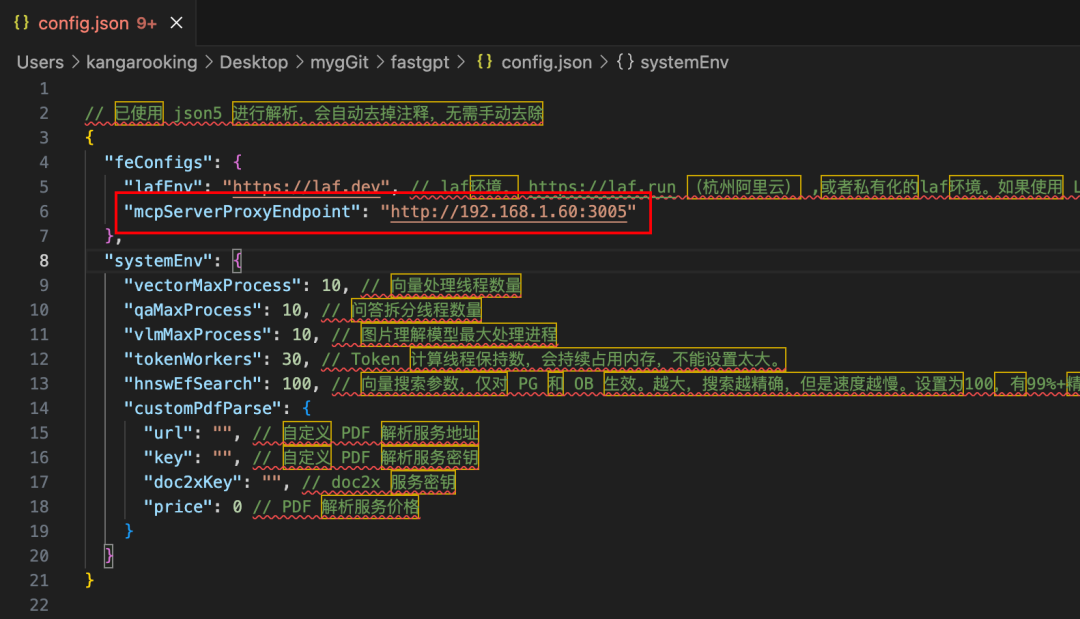

existe config.json En el documento hay que prestar especial atención a mcp.server.host Elemento de configuración.

- Si tanto FastGPT como n8n están desplegados en el entorno Docker local, puede establecer el parámetro

mcp.server.hostse establece en la dirección IP local de la máquina, y el puerto suele fijarse en3005. - Si se despliega en un servidor en la nube, debe configurarse con la dirección IP o el nombre de dominio de la extranet del servidor.

Tras confirmar que la configuración es correcta, abra un terminal o una línea de comandos en el directorio de archivos y ejecute el siguiente comando:

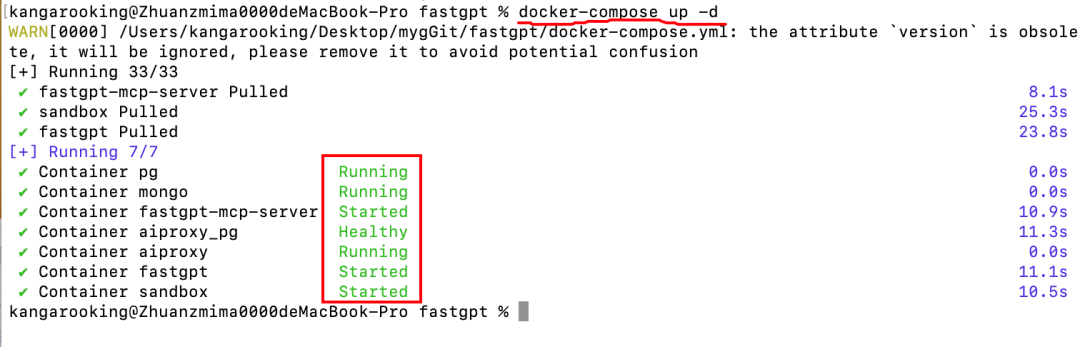

docker-compose up -d

Cuando vea una salida de registro similar a la siguiente figura y todos los contenedores estén funcionando con normalidad, significa que el despliegue o la actualización se han realizado correctamente.

Consejo: Si tiene problemas para extraer imágenes Docker, pruebe a modificar la directiva docker-compose.yml sustituya la dirección del servidor de réplica oficial por la dirección del servidor de réplica nacional (por ejemplo, AliCloud mirror).

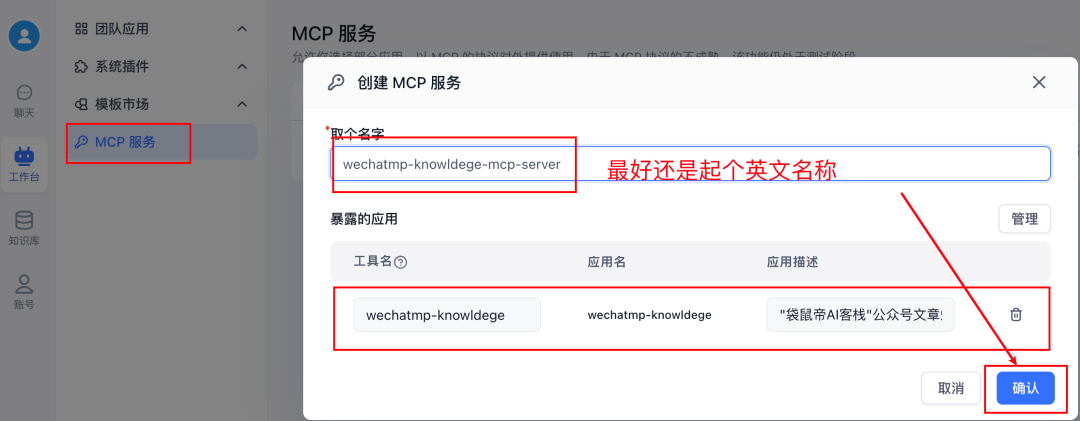

Creación de un servicio MCP en FastGPT

Tras instalar o actualizar correctamente FastGPT, acceda a la interfaz web de FastGPT a través de un navegador (por defecto es http://127.0.0.1:3000).

Vaya a Workbench -> Servicio MCP -> Nuevo ServicioAquí puedes crear un Servidor-MCP que exponga sus capacidades al mundo exterior. Aquí puede crear MCP-Servidores que exponen sus capacidades al mundo exterior.

Tras crear el servicio, haga clic en direcciónPuede ver que puede añadir "herramientas" a este servicio MCP. Estas herramientas pueden ser aplicaciones como Bot, Workflow, etc. creadas en FastGPT.

Aquí hay una cuestión clave: parece que no es posible añadir directamente la "base de conocimientos" creada en FastGPT al servicio MCP como herramienta independiente por derecho propio. Si un Bot con acceso a una Base de Conocimientos se añade al servicio MCP como herramienta, entonces el lado n8n, cuando es llamado por MCP, puede obtener el contenido procesado (por ejemplo, resumido, reescrito) por el modelo grande dentro del Bot, en lugar del fragmento original recuperado de la Base de Conocimientos. Esto puede no ser lo esperado, especialmente en escenarios donde el texto original necesita ser citado con precisión.

Una solución inteligente es utilizar la función de FastGPT flujo de trabajo Función. Se puede crear un flujo de trabajo sencillo en FastGPT cuya función principal sea realizar búsquedas en la base de conocimientos y especificar los formatos de respuesta necesarios.

Los pasos concretos son los siguientes:

- Cree un nuevo flujo de trabajo en FastGPT.

- Añadir sólo Búsqueda en la base de conocimientos nodos y Respuesta designada (u otros nodos lógicos, según sea necesario).

- configure Búsqueda en la base de conocimientos seleccione la base de conocimientos de destino y defina los parámetros pertinentes (por ejemplo, relevancia mínima, número máximo de citas, etc.).

- configure Respuesta designada nodo que determina cómo dar salida a los resultados de la recuperación (por ejemplo, dar salida directamente al bloque de texto original).

- Haga clic en la esquina superior derecha del Guardar y publicar.

IMPORTANTE: Se recomienda que el nombre del flujo de trabajo esté en inglés y asegúrese de rellenar la descripción de la aplicación. Esta información se muestra en n8n y ayuda a identificar la herramienta.

Una vez finalizada la creación y publicación del flujo de trabajo, vuelva a la pantalla Servicios MCP Interfaz de gestión.

- Cree un nuevo servicio MCP (o edite uno existente).

- Añada el flujo de trabajo que acaba de crear y que contiene la búsqueda en la base de conocimientos como herramienta en este servicio.

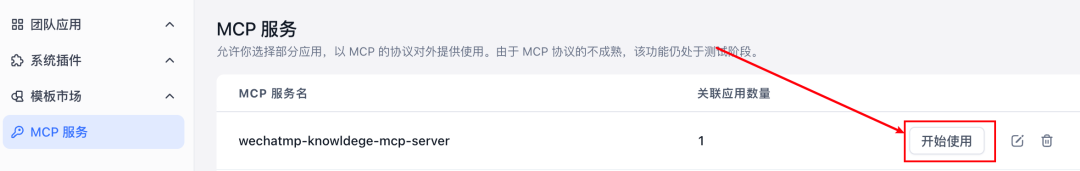

Cuando termine de añadir, haga clic en empezar a utilizar.

En la ventana emergente, busque la opción ESS copie la dirección indicada. Esta dirección es el punto de acceso para el servidor MCP FastGPT que acaba de crear.

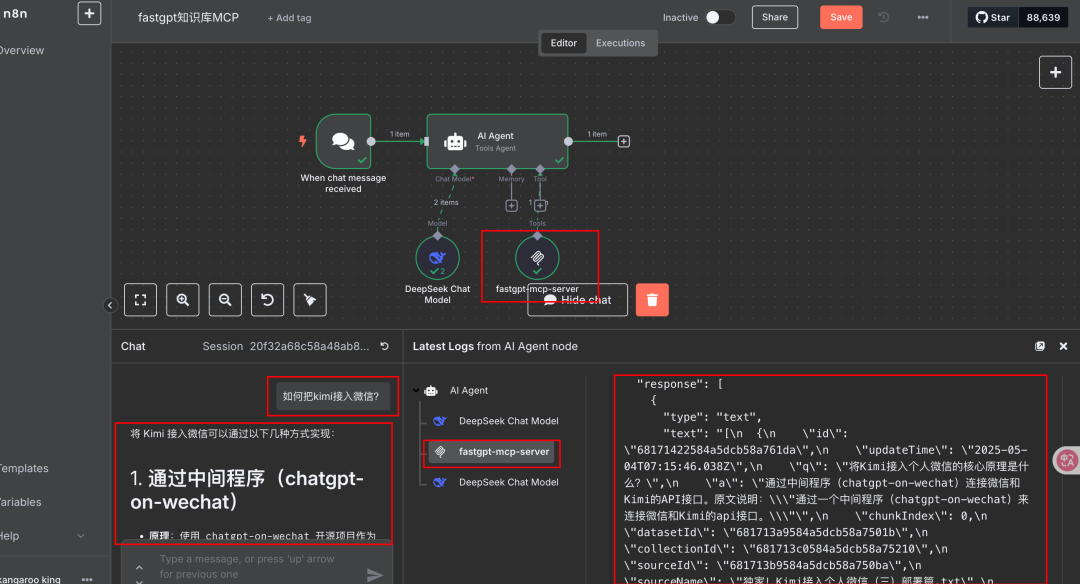

Acceso a los servicios MCP de FastGPT en el n8n

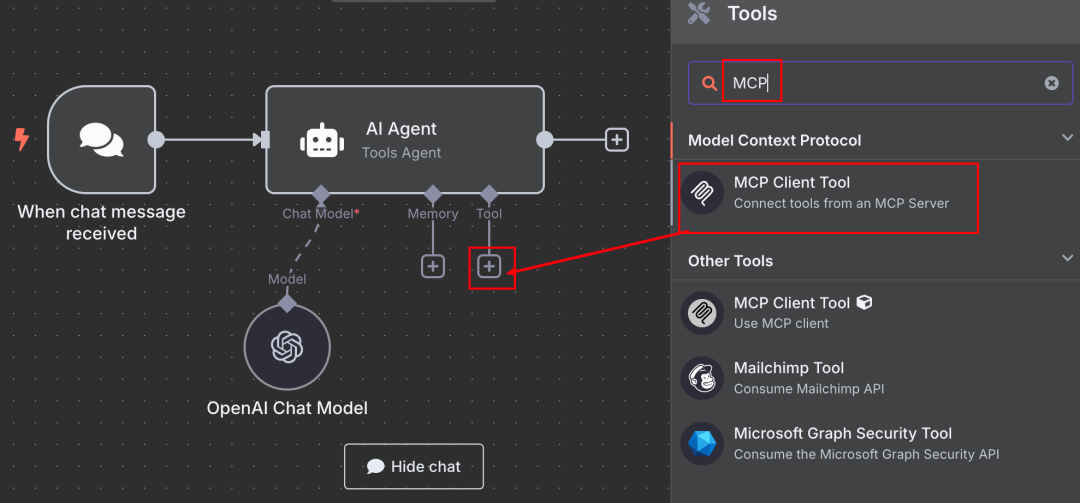

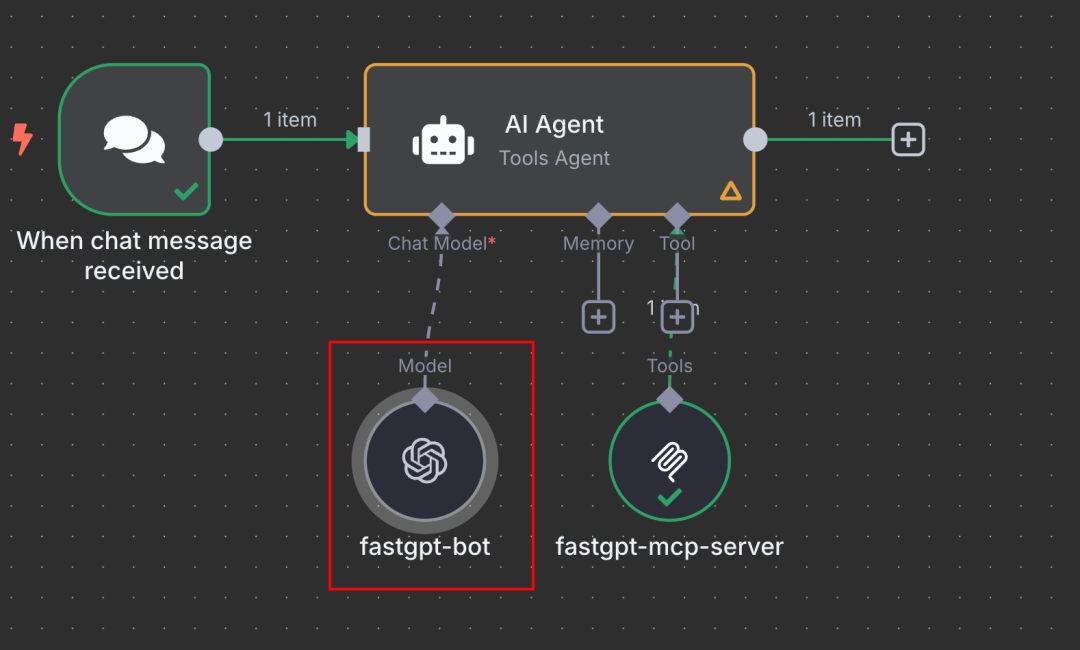

Ahora, cambia a la pantalla de edición del flujo de trabajo del n8n.

- Elija un nodo apropiado, por ejemplo Agente de IA nodos en su Herramienta Configuración, haga clic en el signo más +.

- Busque y añada la información oficial Herramienta cliente MCP Nodos.

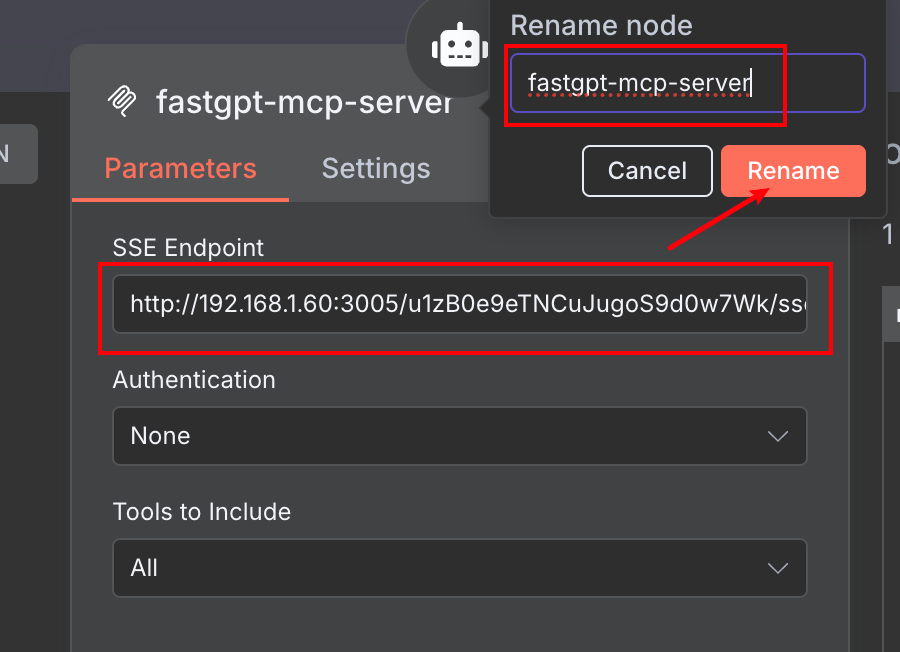

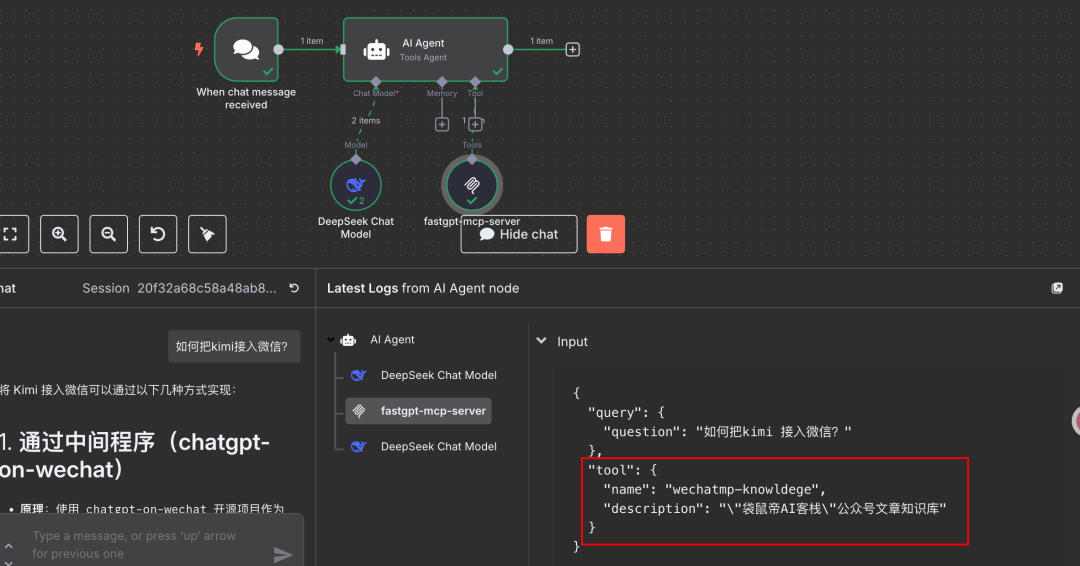

- existe Herramienta cliente MCP en la pantalla de configuración del

- Pegue la dirección SSE que ha copiado anteriormente de FastGPT en el campo URL del servidor Campos.

- Puede establecer un nombre descriptivo para este nodo de la Herramienta (p. ej.

FastGPT Knowledge Base via MCP) para facilitar la llamada en el Agente.

Una vez configurado, puede probarlo en el cuadro de diálogo Chat de n8n (u otros activadores). Formule una pregunta que requiera una llamada a la base de conocimientos. Si la configuración es correcta, podrá ver que n8n invoca correctamente el servicio MCP de FastGPT y obtiene la información relevante de la base de conocimientos de FastGPT como base para la respuesta.

Como ya se ha mencionado, la base de conocimientos RAG de FastGPT suele considerarse bastante eficaz en plataformas de aplicaciones LLM ligeras.

Además, puede ver que el nombre y el conjunto de introducción para el flujo de trabajo en FastGPT se muestran como información de la herramienta en el lado n8n para ayudar al Agente a entender y elegir qué herramienta utilizar.

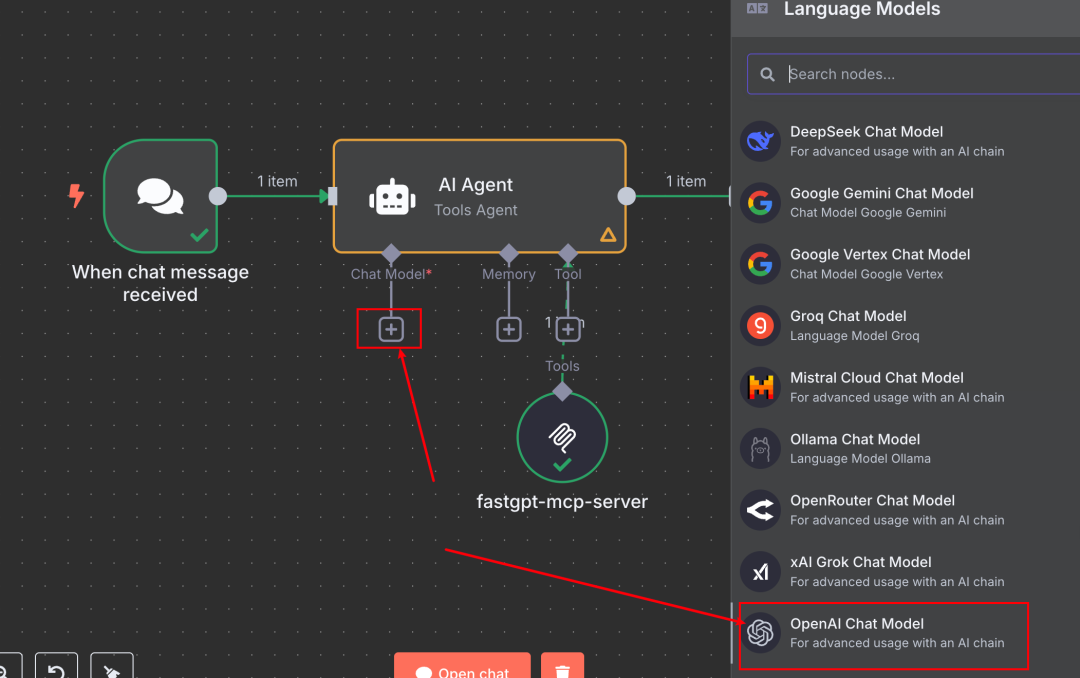

Ampliación de ideas y acceso alternativo

Acceder a la base de conocimientos FastGPT (encapsulada en un flujo de trabajo) a n8n a través de MCP es un enfoque eficaz y flexible. Partiendo de esta base, también puede ampliarse:

- Configuración de FastGPT plug-in (componente de software) tal vez Bot con base de conocimientos se presenta al exterior como un servicio MCP.

- Utilizando FastGPT API FastGPT permite publicar la aplicación creada (por ejemplo, un Bot con una base de conocimientos) como una interfaz compatible con el formato de la API OpenAI.

Este enfoque API también se puede utilizar para acceder a la base de conocimientos FastGPT en n8n:

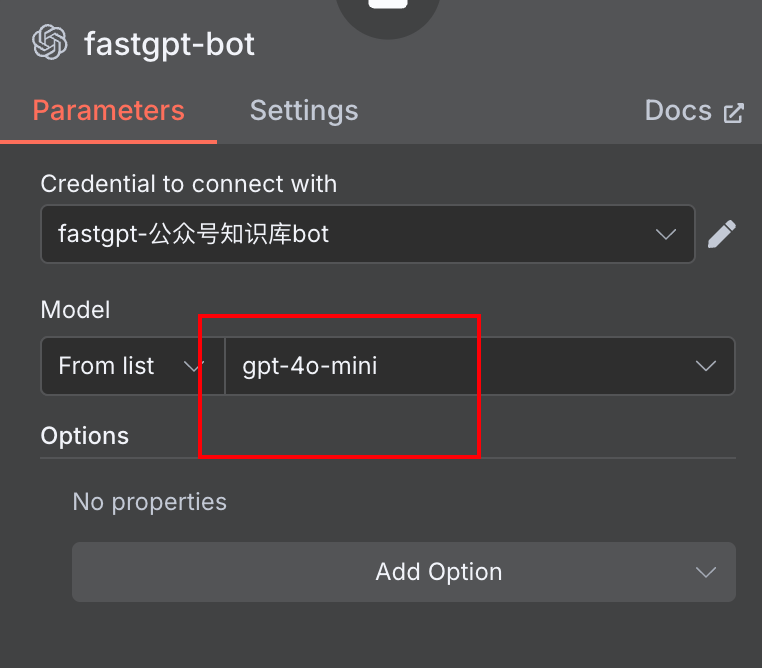

- En n8n's Agente de IA (o cualquier otro nodo que necesite llamar a LLM), añada un nuevo nodo Modelo de chat.

- opción Modelo de chat compatible con OpenAI Tipo.

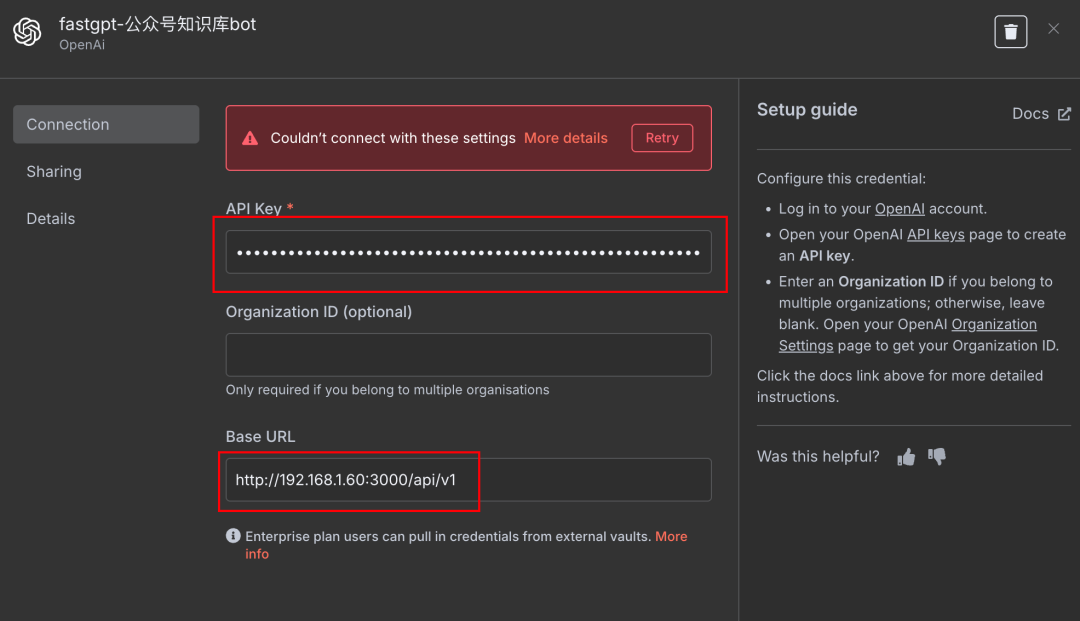

- Credenciales de configuración:

Base URLRellene la dirección API proporcionada por FastGPT.API KeyIntroduzca la clave API correspondiente a la aplicación FastGPT.

Model NameSe puede rellenar arbitrariamente, y el modelo real en efecto será el configurado en el FastGPT Bot.

De este modo, n8n envía la solicitud al punto final de la API de FastGPT, que FastGPT procesa y devuelve el resultado. Esto equivale a llamar al Bot de FastGPT (y a su base de conocimientos) como un servicio big model externo.

Compare los enfoques MCP y API:

- Método MCP::

- Pros: más en línea con la noción de "herramientas" de n8n, puede utilizarse en combinación con otras herramientas en Agente, más nativo; metadatos potencialmente más ricos (por ejemplo, descripciones de herramientas).

- Contras: relativamente más pasos de configuración (creación de flujos de trabajo, configuración de servicios MCP).

- Método API::

- Pros: relativamente fácil de configurar, sólo hay que obtener la dirección API y la clave; sencillo para escenarios en los que FastGPT se utiliza como motor único de preguntas y respuestas.

- Desventajas: en n8n se comporta como una llamada a un modelo externo más que como una "herramienta" combinable; la configuración del modelo (por ejemplo, temperatura, max_tokens, etc.) puede necesitar ser coordinada en el lado n8n y en el lado FastGPT.

Los desarrolladores pueden elegir el método de integración adecuado en función de sus necesidades y preferencias específicas.

Edición y aplicaciones

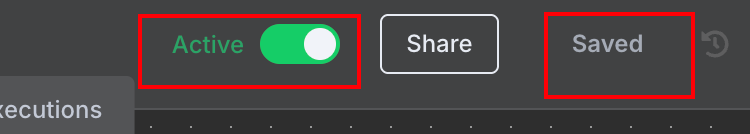

Independientemente de cómo se integre la base de conocimientos FastGPT, es fácil publicarla para uso externo una vez que haya terminado de depurar el flujo de trabajo n8n.

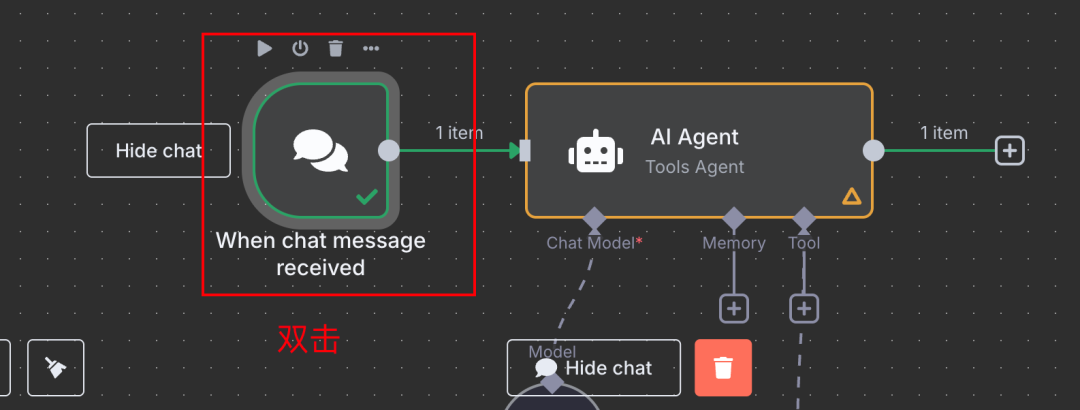

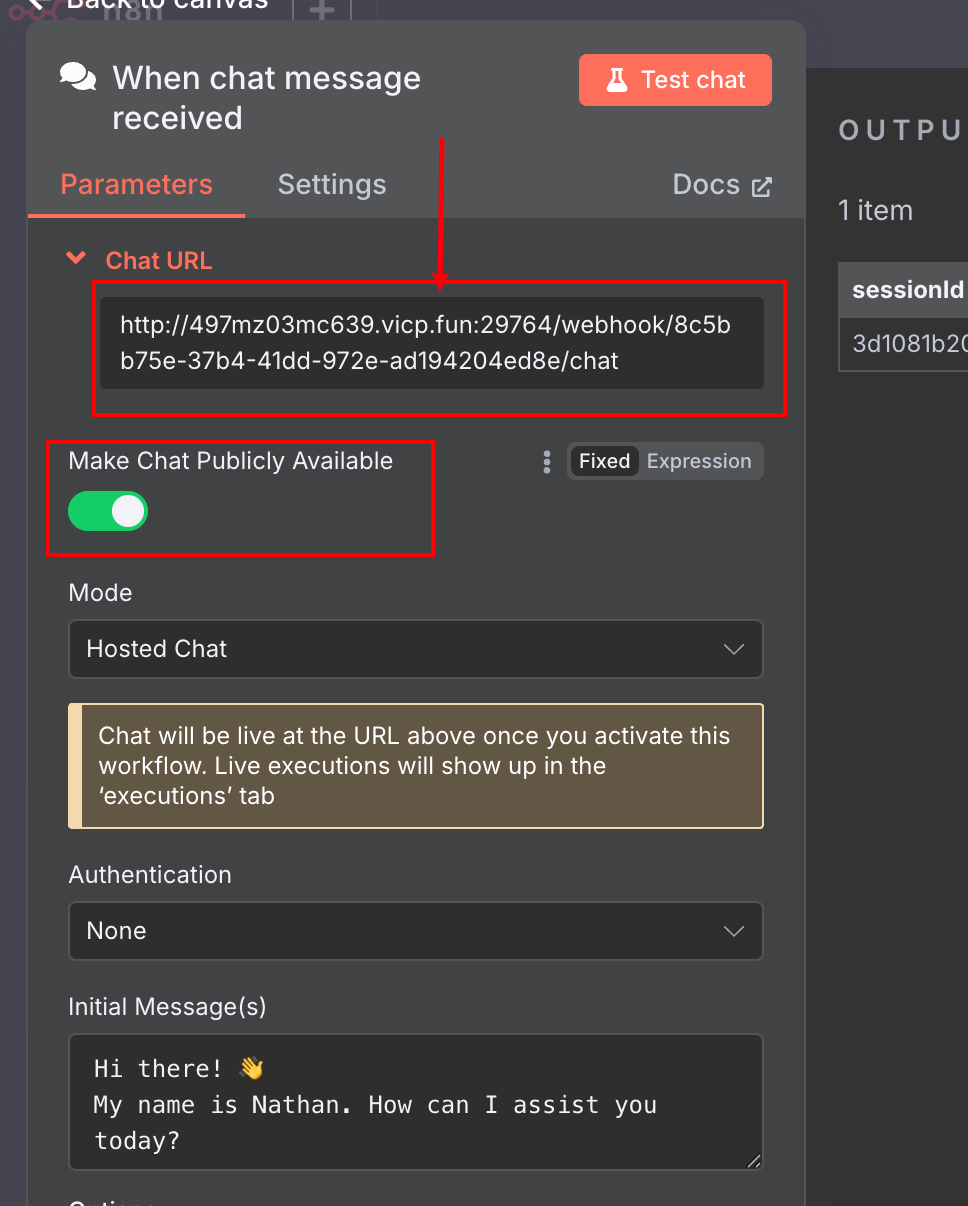

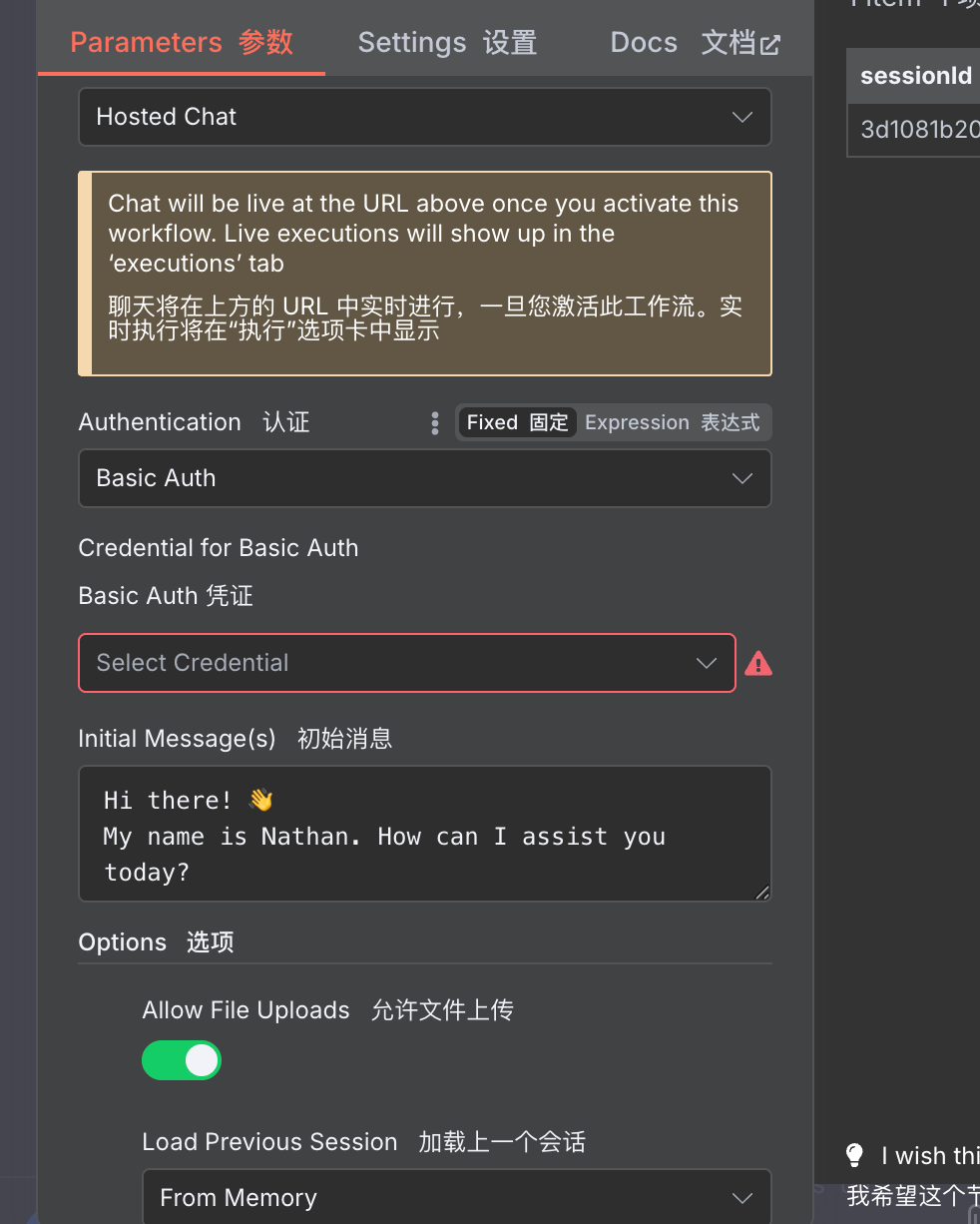

Por ejemplo, utilizando el Mensaje de chat Cuando se utiliza como nodo desencadenante:

- doble clic Mensaje de chat Nodos.

- abre Poner el chat a disposición del público Opciones.

- El sistema genera un enlace URL de Chat público, que puedes copiar para compartir.

- No lo olvides. Guardar además Activar Flujo de trabajo.

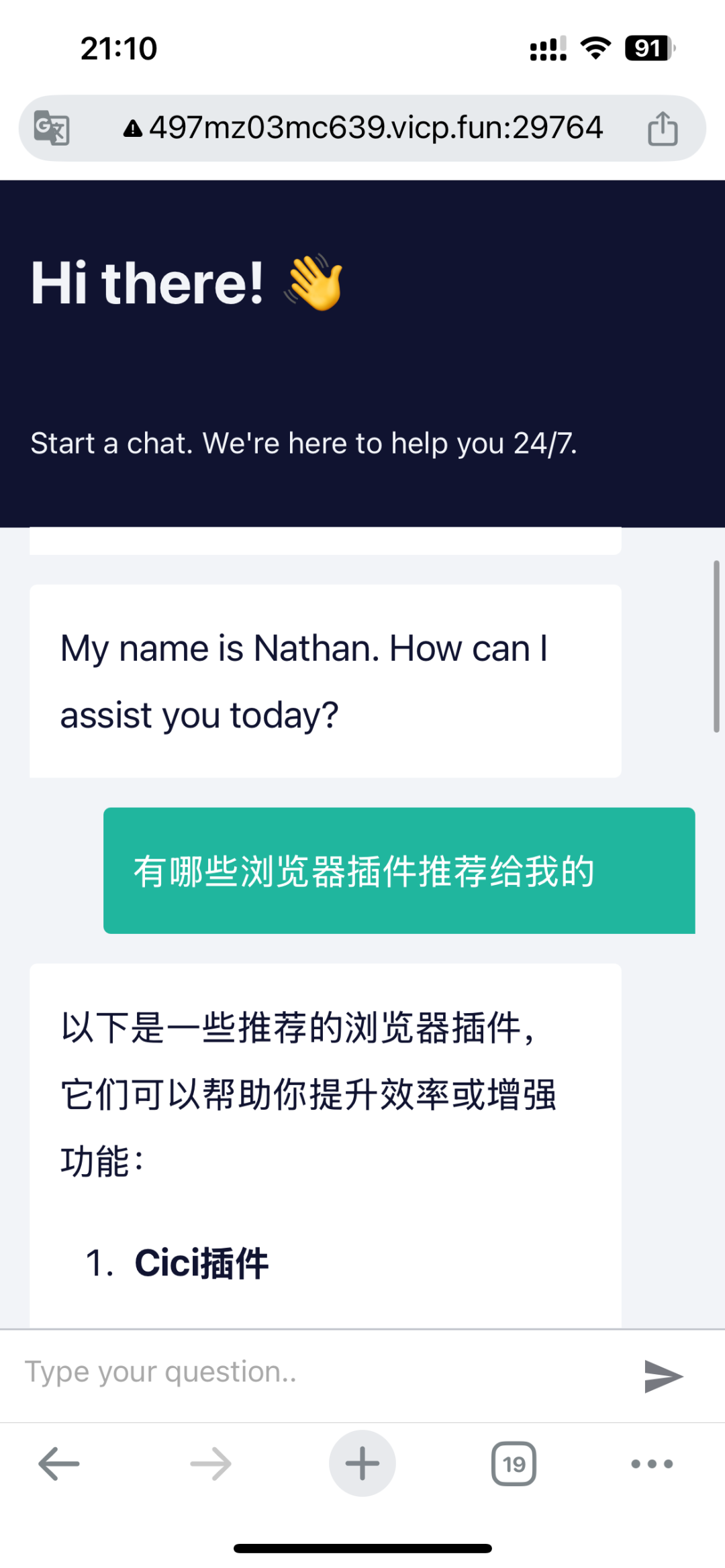

Incluso se puede acceder a esta página pública de chat y utilizarla en el navegador de un dispositivo móvil.

Vale la pena mencionar que esta página de chat pública proporcionada por n8n también admite muchas personalizaciones, como configurar el acceso con contraseña, permitir a los usuarios cargar archivos, etc.

Esto hace que n8n sea ideal para crear rápidamente prototipos de productos MVP (Producto Mínimo Viable), o para crear flujos de trabajo de IA que mejoren la eficiencia de personas y equipos.

aparte de Mensaje de chat muchos de los otros nodos de activación de n8n (por ejemplo, Webhook) también admiten la publicación para el acceso a la extranet, lo que proporciona un grado de libertad extremadamente alto. Si n8n se despliega localmente, el acceso a la extranet puede lograrse mediante técnicas como la penetración en la intranet.

Reflexiones finales: la propuesta de valor de n8n

Una pregunta habitual cuando se habla de este tipo de herramientas de automatización de bajo código/sin código es: ¿por qué no implementarlas en código? Para los desarrolladores familiarizados con la programación, utilizar código parece más sencillo y controlable.

Es cierto que herramientas como n8n tienen una curva de aprendizaje, y puede llevar algún tiempo empezar. Sin embargo, una vez que se domina, la eficiencia de la construcción y la iteración de flujos de trabajo a menudo supera con creces la del desarrollo de código tradicional, especialmente en escenarios que implican la integración de múltiples API y servicios. El sólido ecosistema de nodos de n8n y el apoyo de la comunidad pueden satisfacer una amplia gama de necesidades de automatización, desde las más simples a las más complejas, permitiendo que las ideas despeguen rápidamente.

Por supuesto, para proyectos de nivel empresarial que requieren un alto grado de personalización, un rendimiento extremo o implican una lógica subyacente compleja, el desarrollo de código puro sigue siendo necesario. Pero para un gran número de escenarios de automatización, creación de herramientas internas, prototipado rápido y otras necesidades, n8n y sus herramientas similares ofrecen una opción muy eficaz y flexible. La integración de excelentes aplicaciones de IA como FastGPT a través de protocolos como MCP amplía aún más los límites de las capacidades de n8n.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...