GLM-4.1V-Thinking - una familia de modelos de lenguaje visual de código abierto de Smart Spectrum AI

Últimos recursos sobre IAActualizado hace 9 meses Círculo de intercambio de inteligencia artificial 47.1K 00

¿Qué es GLM-4.1V-Thinking?

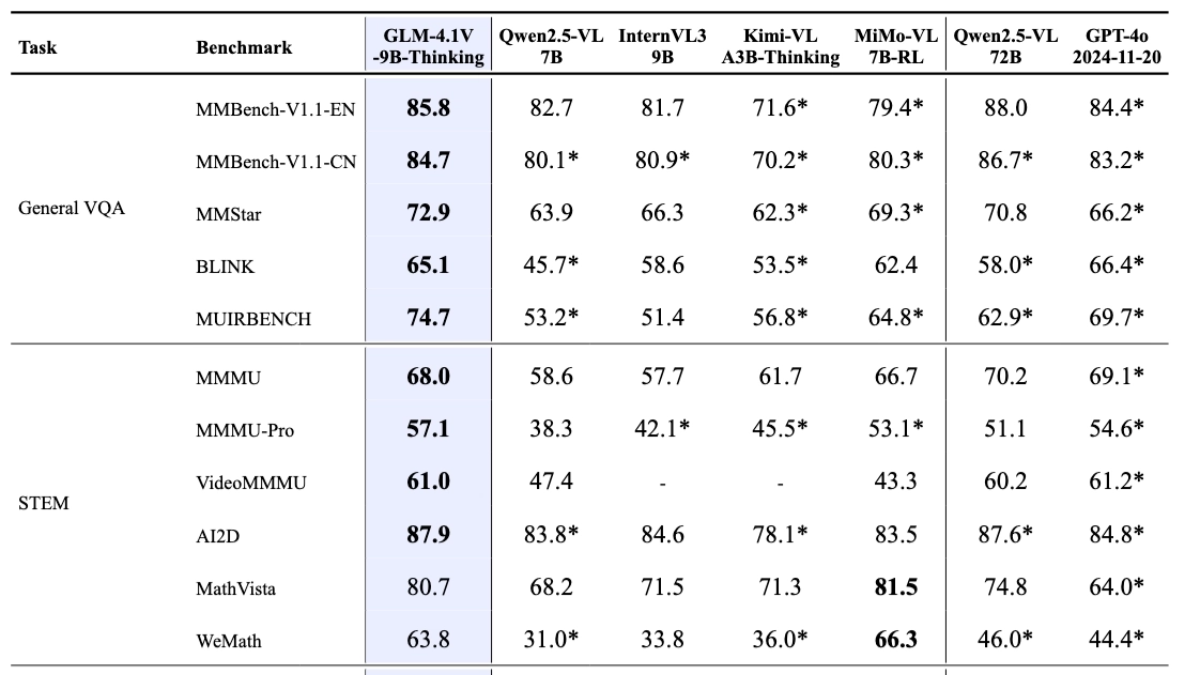

GLM-4.1V-Thinking es un modelo de lenguaje visual de código abierto lanzado por Smart Spectrum AI, diseñado para tareas cognitivas complejas, GLM-4.1V-Thinking admite entradas multimodales, que abarcan imágenes, vídeos y documentos. Basado en la arquitectura GLM-4V, el modelo introduce un mecanismo de razonamiento de cadena de pensamiento, refuerza las estrategias de aprendizaje con muestreo de cursos y mejora significativamente el razonamiento causal y la estabilidad entre modos. La versión ligera de GLM-4.1V-9B-Thinking (GLM-4.1V-9B-Modelo base y GLM-4.1V-9B-Thinking con pensamiento profundo y capacidad de razonamiento) tiene un recuento de parámetros de 10B, y ha obtenido la mejor puntuación de los modelos de nivel 10B en 23 de 28 revisiones autorizadas, de las cuales 18 son iguales al recuento de parámetros de 72B de Qwen- 2.5-VL, lo que demuestra plenamente el excelente rendimiento del modelo de pequeño tamaño. El modelo tiene amplias perspectivas de aplicación en diversos campos, como el asesoramiento educativo, la creación de contenidos, la interacción inteligente, las aplicaciones industriales, así como el entretenimiento y la vida.

Características principales de GLM-4.1V-Thinking

- Gran comprensión visual: Identifique y analice con precisión una amplia gama de contenidos en imágenes, incluida la detección sencilla de objetivos, tareas más complejas de clasificación de imágenes o cuestionarios visuales que requieren una comprensión exhaustiva de la imagen y responder a preguntas.

- Alto nivel de procesamiento de vídeo: Excelentes capacidades de análisis de temporización y modelado de lógica de eventos para apoyar el procesamiento en profundidad de entradas de vídeo para la comprensión de vídeo, generando descripciones de vídeo precisas y respondiendo a preguntas relacionadas con el contenido de vídeo.

- Análisis sintáctico completo de documentosAdmite el tratamiento simultáneo de imágenes y contenido textual en los documentos, la comprensión de documentos largos, el análisis sintáctico preciso de cuadros y gráficos, y las preguntas y respuestas basadas en el contenido del documento, todo ello de forma eficaz.

- Excelente capacidad de razonamientoEn matemáticas y ciencias, resolución de problemas de razonamiento complejo, incluida la resolución de problemas matemáticos de varios pasos, la comprensión de fórmulas y el razonamiento lógico en ciencias, proporcionando un sólido apoyo para el aprendizaje y la investigación en disciplinas afines.

- El razonamiento lógico es precisoApoyo al razonamiento lógico complejo y al análisis causal, respondiendo a tareas como el razonamiento en varios pasos y los juicios lógicos, ayudando a los usuarios a comprender y analizar mejor una amplia gama de situaciones complejas.

- El razonamiento intermodal es eficaz: Combina orgánicamente la información visual y verbal para un razonamiento intermodal eficaz, completando tareas como la comprensión gráfica, el cuestionario visual y el anclaje visual, y proporcionando un potente apoyo para el procesamiento integrado de la información multimodal.

Ventajas de rendimiento de GLM-4.1V-Thinking

En 28 evaluaciones autorizadas como MMStar, MMMU-Pro, ChartQAPro, OSWorld, etc., GLM-4.1V-Thinking ha obtenido excelentes resultados, de los cuales 23 elementos han alcanzado el mejor rendimiento de los modelos de clase 10B, y 18 elementos están a la par o incluso superan a Qwen-2.5-VL, que tiene un recuento de parámetros tan alto como 72B, lo que demuestra plenamente el potente rendimiento de los modelos de pequeño volumen. Esto demuestra plenamente el potente rendimiento de un modelo de pequeño volumen.

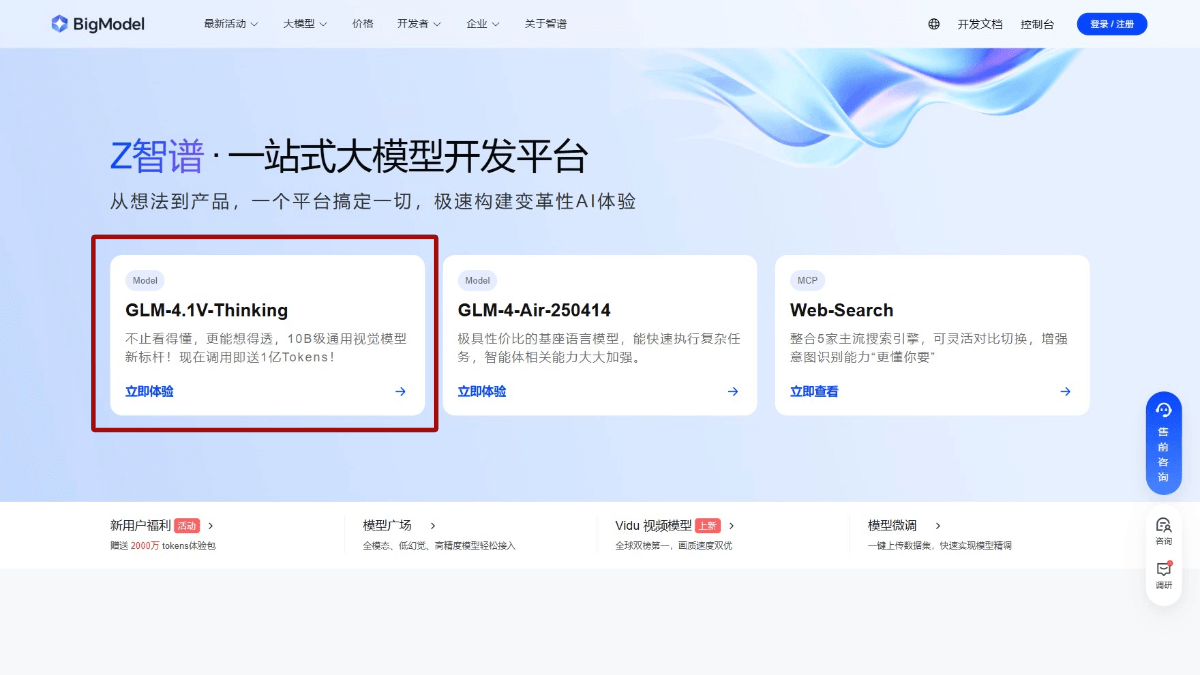

Dirección del sitio web oficial de GLM-4.1V-Thinking

- Repositorio GitHub:: https://github.com/THUDM/GLM-4.1V-Thinking

- Biblioteca de modelos HuggingFace:: https://huggingface.co/collections/THUDM/glm-41v-thinking-6862bbfc44593a8601c2578d

- Documento técnico arXiv:: https://arxiv.org/pdf/2507.01006v1

- Demostración de la experiencia en línea:: https://huggingface.co/spaces/THUDM/GLM-4.1V-9B-Thinking-Demo

Cómo utilizar GLM-4.1V-Thinking

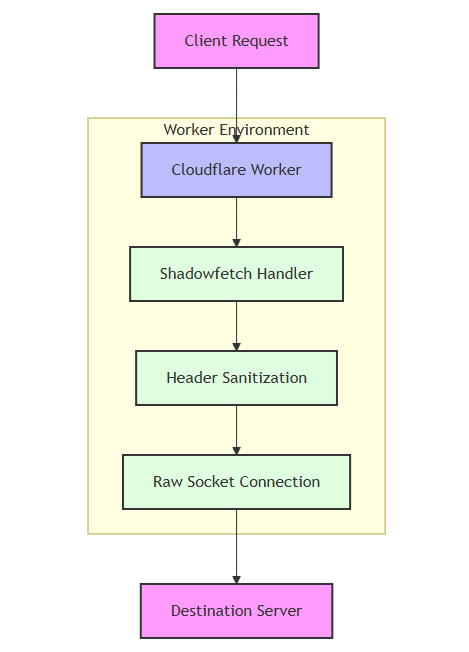

- Uso de la interfaz API::

- Obtener clave APICrea una aplicación para obtener una clave API exclusiva en la plataforma Smart Spectrum AI: https://bigmodel.cn/注册账号.

- Llamada a la APIModelo: De acuerdo con la documentación de la API, llame a la interfaz del modelo con una solicitud HTTP para enviar datos de entrada (por ejemplo, URL de imágenes o datos codificados en Base64, texto, etc.) al modelo y obtener la salida del modelo. Por ejemplo, llame con código Python:

import requests

import json

api_url = "https://api.zhipuopen.com/v1/glm-4.1v-thinking"

api_key = "your_api_key"

input_data = {

"image": "image_url_or_base64_encoded_data",

"text": "your_input_text"

}

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

response = requests.post(api_url, headers=headers, data=json.dumps(input_data))

result = response.json()

print(result)- Uso de modelos de código abierto::

- Descargar modelos: Visite la plataforma Hugging Face, busque la página GLM-4.1V-Thinking Models y descargue los archivos de modelo necesarios.

- Modelos de cargaCarga el modelo descargado con un marco de aprendizaje profundo como PyTorch. Ejemplo:

from transformers import AutoModelForVision2Seq, AutoProcessor

import torch

model_name = "THUDM/glm-4.1v-thinking"

model = AutoModelForVision2Seq.from_pretrained(model_name)

processor = AutoProcessor.from_pretrained(model_name)- inferir conclusionesPreprocesar los datos de entrada (por ejemplo, rutas de imágenes o URL, texto, etc.) en el modelo y obtener la salida del modelo. Ejemplo:

image_url = "image_url_or_image_path"

text = "your_input_text"

inputs = processor(images=image_url, text=text, return_tensors="pt")

with torch.no_grad():

outputs = model(**inputs)

result = processor.decode(outputs.logits[0], skip_special_tokens=True)

print(result)- Uso de plataformas de experiencia en línea::

- Enlaces a la experiencia de acceso: Visite la página de la experiencia GLM-4.1V-Thinking directamente en la plataforma Hugging Face.

- datos de entradaCarga datos, como imágenes, o introduce texto en una página web.

- Obtener resultadosHaga clic en el botón "Ejecutar", espere a que el modelo se procese y vea el resultado, sin necesidad de escribir código complejo ni desplegar el modelo.

Principales ventajas de GLM-4.1V-Thinking

- Soporte de entrada multimodal: Admite múltiples entradas, como imágenes, vídeos, documentos, etc., y es capaz de procesar exhaustivamente información de múltiples fuentes para satisfacer las necesidades de tareas complejas.

- Razonamiento sólido: Introducción de un mecanismo de razonamiento en cadena que genera un proceso de razonamiento detallado con pensamiento paso a paso para mejorar el rendimiento y la interpretabilidad de tareas complejas.

- Estrategias de formación eficacesUna estrategia de aprendizaje por refuerzo basada en el muestreo por cursos que ajusta dinámicamente la dificultad del entrenamiento y combina el preentrenamiento a gran escala con el ajuste fino para mejorar el rendimiento y la eficiencia.

- Excelente rendimientoEl recuento de parámetros 10B es un modelo de tamaño reducido que ha destacado en varias revisiones autorizadas, demostrando una gran eficacia y estabilidad.

- Código abierto y facilidad de uso: La función de código abierto reduce el umbral de uso y ofrece diversas formas de utilizarlo, lo que facilita a los desarrolladores su rápida integración y doble desarrollo.

Personas a las que va dirigido GLM-4.1V-Thinking

- Asesoramiento educativoInstrucción asistida por el profesor, que proporciona a los estudiantes recursos de aprendizaje más ricos y pasos más detallados para la resolución de problemas.

- creador de contenidosLos redactores publicitarios, los operadores de redes sociales, los reporteros de noticias y otros profesionales generan contenidos creativos combinando imágenes y texto para mejorar la eficacia y la calidad de la creación.

- Empresas y promotoresLas empresas integran modelos en los sistemas inteligentes de atención al cliente para mejorar la calidad del servicio, admitir entradas multimodales, comprender mejor las necesidades de los usuarios y ofrecer respuestas precisas.

- Desarrollo de aplicaciones industrialesLos profesionales de las finanzas, la sanidad y la industria realizan tareas como el análisis de datos, la generación de informes y la supervisión de equipos para mejorar la eficacia y la precisión.

- investigador (científico)El objetivo de la investigación es analizar y procesar datos multimodales para apoyar tareas de razonamiento complejas y avanzar en la investigación en campos relacionados.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...