Gaze-LLE: herramienta de predicción de la mirada de una persona en vídeo

Últimos recursos sobre IAActualizado hace 12 meses Círculo de intercambio de inteligencia artificial 57.7K 00

Introducción general

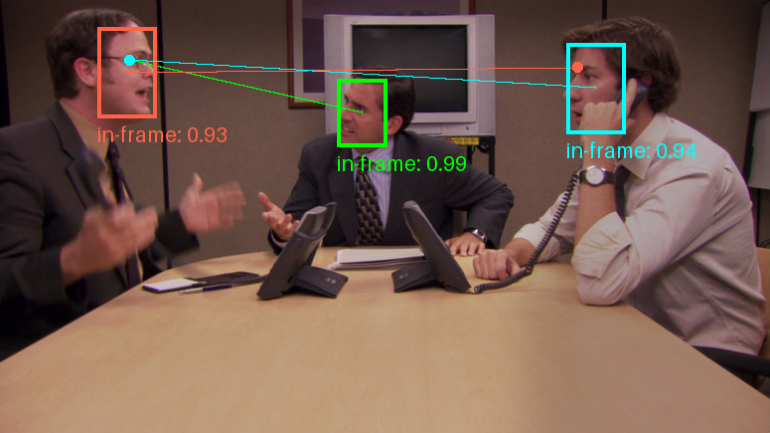

Gaze-LLE es una herramienta de predicción de la mirada basada en un codificador de aprendizaje a gran escala. Desarrollado por Fiona Ryan, Ajay Bati, Sangmin Lee, Daniel Bolya, Judy Hoffman y James M. Rehg, el proyecto tiene como objetivo permitir una predicción eficiente del objetivo de la mirada con modelos visuales de base preentrenados como DINOv2. La arquitectura de Gaze-LLE es limpia y sencilla, y sólo congela el codificador visual preentrenado para aprender un decodificador de mirada ligero, lo que reduce la cantidad de parámetros en 1-2 órdenes de magnitud en comparación con trabajos anteriores, y no requiere modalidades de entrada adicionales como la información de profundidad y pose.

Lista de funciones

- Centrarse en la previsión de objetivosPredicción eficaz de los objetivos de la mirada basada en codificadores visuales preentrenados.

- Predicción multi-miradapermite predecir la mirada de varios individuos en una misma imagen.

- Modelo de preentrenamiento: Proporciona una variedad de modelos preentrenados para admitir diferentes redes troncales y datos de entrenamiento.

- Arquitectura ligeraAprendizaje de decodificadores ligeros de la mirada sólo con codificadores visuales preentrenados congelados.

- Sin modos de entrada adicionales: No se requieren entradas adicionales de información de profundidad y actitud.

Utilizar la ayuda

Proceso de instalación

- Almacén de clonación:

git clone https://github.com/fkryan/gazelle.git

cd gazelle

- Cree un entorno virtual e instale las dependencias:

conda env create -f environment.yml

conda activate gazelle

pip install -e .

- Opcional: Instale xformers para acelerar los cálculos de atención (si el sistema lo admite):

pip3 install -U xformers --index-url https://download.pytorch.org/whl/cu118

Uso de modelos preentrenados

Gaze-LLE proporciona una variedad de modelos preentrenados que los usuarios pueden descargar y utilizar según sus necesidades:

- gaceladinov2vitb14Modelo basado en DINOv2 ViT-B con datos de entrenamiento de GazeFollow.

- gaceladinov2vitl14Modelo basado en DINOv2 ViT-L con datos de entrenamiento de GazeFollow.

- gaceladinov2vitb14_inoutUn modelo basado en DINOv2 ViT-B con datos de entrenamiento para GazeFollow y VideoAttentionTarget.

- gacelagrandevitl14_inoutUn modelo basado en DINOv2 ViT-L con datos de entrenamiento para GazeFollow y VideoAttentionTarget.

ejemplo de uso

- Cargar el modelo en PyTorch Hub:

import torch

model, transform = torch.hub.load('fkryan/gazelle', 'gazelle_dinov2_vitb14')

- Consulta el bloc de notas de demostración en Google Colab para aprender a detectar el objetivo de la mirada de todo el mundo en una imagen.

vigilar las previsiones

Gaze-LLE permite predecir la mirada de varias personas, es decir, una sola imagen se codifica una vez y luego se utilizan las características para predecir los objetivos de la mirada de varias personas en la imagen. El modelo genera un mapa de calor espacial que representa la probabilidad de la ubicación del objetivo de la mirada en la escena con valores que oscilan entre [0,1], donde 1 representa la mayor probabilidad de la ubicación del objetivo de la mirada.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...