FramePack: 6G de memoria gráfica de bajo crecimiento rápido de vídeo largo proyecto de código abierto

Últimos recursos sobre IAActualizado hace 11 meses Círculo de intercambio de inteligencia artificial 103.7K 00

Introducción general

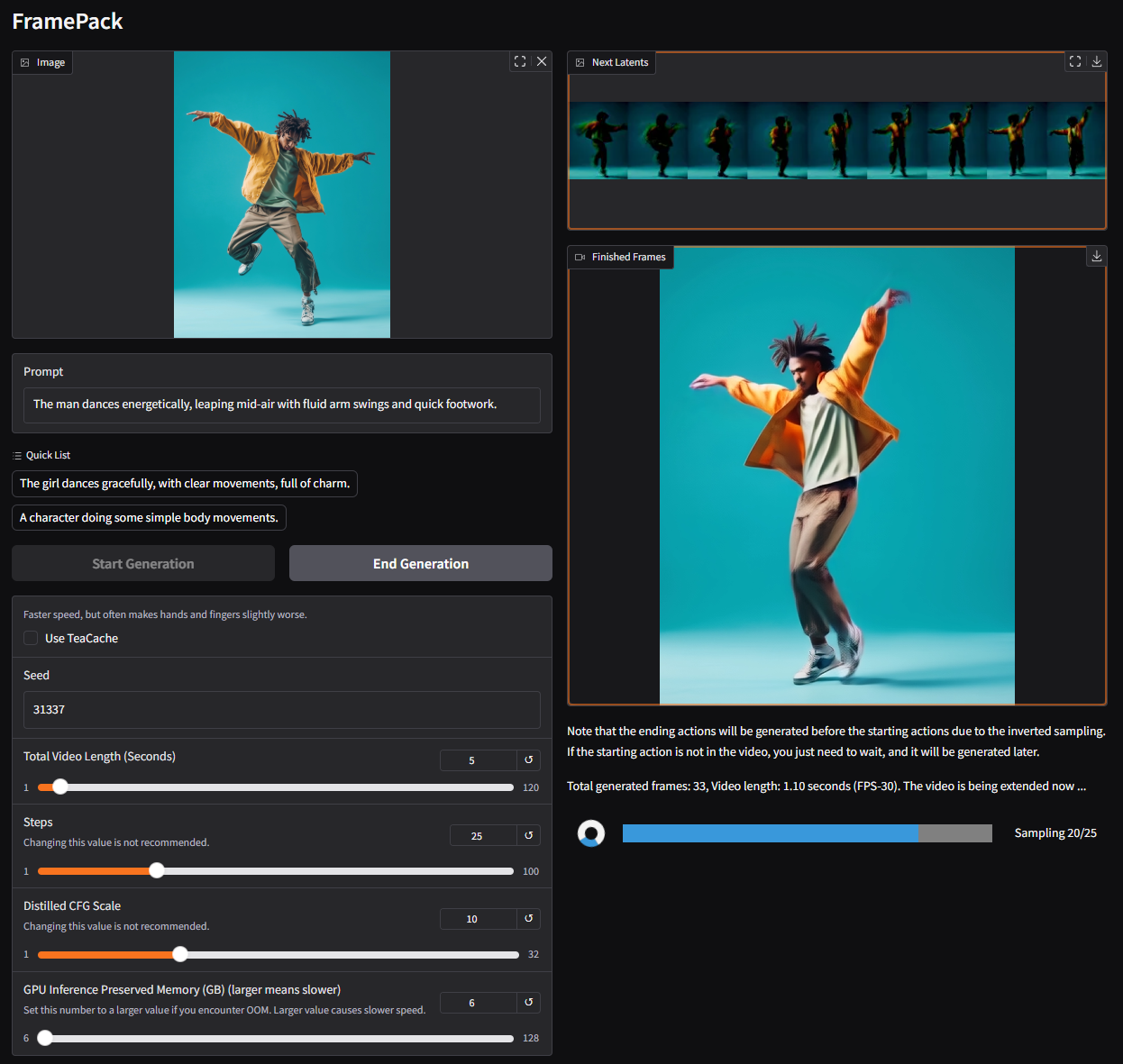

FramePack es una herramienta de generación de vídeo de código abierto centrada en hacer más prácticas las técnicas de difusión de vídeo. Desvincula el esfuerzo de generación de la longitud del vídeo comprimiendo los fotogramas de entrada a una longitud fija mediante una red neuronal única de predicción del siguiente fotograma. framePack puede generar miles de fotogramas a 30 fps con tan sólo 6 GB de memoria gráfica, lo que lo hace apto para la GPU de consumo medio. El proyecto ha sido desarrollado por Lvmin Zhang y se basa en el modelo de vídeo Hunyuan, optimizado para sólo 1.300 millones de parámetros de modelo, lo que combina eficiencia y ligereza. framePack FramePack ofrece una interfaz Gradio fácil de usar que admite la generación de imágenes a vídeo a una velocidad optimizada de hasta 1,5 segundos por fotograma. Es adecuado para creadores de contenidos, desarrolladores y usuarios en general interesados en la generación de vídeo.

Lista de funciones

- Generación de imagen a vídeo: Genere vídeo en movimiento a partir de una sola imagen con soporte para extensiones de vídeo largas.

- Baja optimización de RAM: se pueden generar 60 segundos de vídeo a 30 fps con tan sólo 6 GB de RAM.

- Predicción del siguiente fotograma: generación de carga de trabajo independiente de la duración del vídeo mediante la compresión del contexto.

- Interfaz de usuario de Gradio: ofrece funciones intuitivas para cargar imágenes, introducir indicaciones y previsualizar los vídeos generados.

- Soporte de múltiples mecanismos de atención: PyTorch, xformers, flash-attn y sage-attention son compatibles.

- Compatibilidad multiplataforma: admite Linux y Windows y es compatible con las GPU de las series NVIDIA RTX 30XX/40XX/50XX.

- Velocidad de generación optimizada: optimizada con teacache para hasta 1,5 segundos por fotograma.

- Admite la formación por lotes: admite la formación por lotes supergrandes similar a la difusión de imágenes.

Utilizar la ayuda

Proceso de instalación

La instalación de FramePack es más técnica y es adecuada para usuarios con cierta experiencia en la configuración de entornos Python y GPU. A continuación se detallan los pasos de instalación para sistemas Windows y Linux, así como referencias a la página oficial de GitHub y recursos web.

Requisitos medioambientales

- sistema operativo: Linux o Windows.

- GPUsNVIDIA RTX series 30XX/40XX/50XX con soporte fp16 y bf16 (GTX 10XX/20XX no probadas).

- memoria: Mínimo 6 GB (genera 60 segundos de vídeo a 30 fps).

- Versión PythonSe recomienda Python 3.10 (nota: las versiones de Python deben coincidir estrictamente, de lo contrario pueden producirse incompatibilidades de biblioteca).

- CUDAEs necesario instalar una versión de CUDA compatible con GPU (por ejemplo, CUDA 12.6).

Pasos de la instalación

- Clonar almacén FramePack

Abra un terminal o símbolo del sistema y ejecute el siguiente comando para clonar el proyecto:git clone https://github.com/lllyasviel/FramePack.git cd FramePack - Creación de un entorno virtual

Para evitar conflictos de dependencias, se recomienda crear un entorno virtual Python:python -m venv venvActive el entorno virtual:

- Ventanas:

venv\Scripts\activate.bat - Linux:

source venv/bin/activate

- Ventanas:

- Instalación de PyTorch y dependencias

Instale PyTorch coincidiendo con la versión CUDA (CUDA 12.6 por ejemplo):pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu126Instale las dependencias del proyecto:

pip install -r requirements.txt - (Opcional) Instalación de Sage Attention o Flash Attention

Para mejorar el rendimiento, puede instalar Sage Attention (debe elegir el archivo de rueda adecuado para su versión de CUDA y Python):pip install https://github.com/woct0rdho/SageAttention/releases/download/v2.1.1-windows/sageattention-2.1.1+cu126torch2.6.0-cp312-cp312-win_amd64.whlNota: Sage Attention puede afectar ligeramente a la calidad de la generación, que puede omitirse para los usuarios noveles.

- Inicio de la interfaz de Gradio

Una vez finalizada la instalación, ejecute el siguiente comando para iniciar la interfaz:python demo_gradio.pyTras el arranque, el terminal muestra algo como

http://127.0.0.1:7860/Puede acceder a la interfaz Gradio de FramePack visitando la URL en su navegador.

Problemas comunes de instalación

- Desajuste de la versión de PythonSi la instalación de la dependencia falla, compruebe que la versión de Python es la 3.10. Utilice la opción

python --versionVer la versión actual. - Conflicto de dependenciaSi

requirements.txtes incompatible, puede eliminar el archivoavynumpyyscipydesignación de la versión, vuelva a instalar la última versión:pip install av numpy scipy - memoria de vídeo insuficienteSi la memoria de vídeo es inferior a 6 GB, la generación puede fallar. Se recomienda utilizar una GPU con mayor memoria o acortar la duración del vídeo.

Utilización

La función principal de FramePack es generar vídeo a partir de una sola imagen y controlar el contenido del vídeo mediante palabras clave. A continuación se detalla el procedimiento de funcionamiento.

1. Acceso a la interfaz de Gradio

activar (un plan) demo_gradio.py A continuación, el navegador mostrará la interfaz de usuario de FramePack. La interfaz se divide en las secciones izquierda y derecha:

- Izquierda: Cargue imágenes e introduzca palabras de aviso.

- Derecha: Muestra el vídeo generado y una vista previa latente (vista previa latente).

2. Cargar imágenes

Haga clic en el área de carga de imágenes de la izquierda y seleccione una imagen local (resolución recomendada 544x704 o tamaño similar) FramePack generará contenido de vídeo basado en esta imagen.

3. Introducción de datos

Introduzca una frase breve que describa la acción del vídeo en el cuadro de texto Palabra de referencia. Se recomiendan palabras de referencia sucintas y orientadas a la acción, por ejemplo:

The girl dances gracefully, with clear movements, full of charm.A robot jumps energetically, spinning in a futuristic city.

FramePack recomienda oficialmente generar la señal de acción mediante GPT en el formato:

Eres un asistente que escribe instrucciones breves centradas en el movimiento para animar imágenes. Cuando el usuario envía una imagen, respondes con una única instrucción concisa que describe el movimiento visual. describiendo el movimiento visual.

4. Generación de vídeo

Haga clic en el botón Generar de la interfaz y FramePack iniciará el proceso. El proceso de generación tiene lugar en segmentos, cada uno de los cuales genera aproximadamente 1 segundo de vídeo, que se une gradualmente para formar un vídeo completo. El progreso de la generación se muestra mediante una barra de progreso y una vista previa potencial. El archivo generado se guarda en la carpeta ./outputs/ carpeta.

5. Visualización y ajuste

Al principio del proceso de generación, es posible que sólo obtenga un vídeo corto (por ejemplo, de 1 segundo). Esto es normal y tendrá que esperar a que se generen más clips para completar el vídeo completo. Si no estás satisfecho con el resultado, puedes ajustar las indicaciones o cambiar la imagen de entrada para regenerar.

Optimizar la velocidad de generación

- comisión teacacheLa activación del teacache en los ajustes de generación aumenta la velocidad de 2,5 a 1,5 seg/fotograma.

- Generación más rápida con GPU de alto rendimiento: por ejemplo, NVIDIA 4090.

- Desactivar sage-attention: Si sage-attention está instalado, puede desactivarse en la primera prueba para garantizar una generación de calidad.

Función destacada Operación

Generación de memoria baja

El punto fuerte de FramePack es su bajo consumo de memoria de vídeo. Al comprimir el contexto de entrada, sólo se necesitan 6 GB de memoria de vídeo para generar 60 segundos de vídeo a 30 fps. No es necesaria ninguna configuración adicional y el sistema optimiza automáticamente la asignación de memoria gráfica.

Predicción de la trama siguiente

FramePack genera vídeo fotograma a fotograma utilizando una red neuronal de predicción del fotograma siguiente. Los usuarios pueden ver previsualizaciones potenciales de cada segmento generado en tiempo real en la interfaz de Gradio para asegurarse de que el contenido del vídeo es el esperado.

Interfaz Gradio

La interfaz de Gradio es sencilla e intuitiva y permite realizar cargas y previsualizaciones rápidas. Los usuarios pueden utilizar la --share para compartir la interfaz con la red pública, o mediante el parámetro --port responder cantando --server Parámetros puerto personalizado y dirección del servidor:

python demo_gradio.py --share --port 7861 --server 0.0.0.0

escenario de aplicación

- creación de contenidos

FramePack es adecuado para que los creadores de vídeo generen vídeos dinámicos cortos. Por ejemplo, generar un vídeo de baile a partir de la imagen de un personaje para la producción de contenidos en redes sociales. Los bajos requisitos de memoria de vídeo facilitan los primeros pasos para el usuario medio. - desarrollo de juegos

Los desarrolladores pueden utilizar FramePack para generar animaciones dinámicas de las escenas, como el movimiento de los personajes o los cambios de entorno, ahorrando tiempo en el modelado manual. Los modelos ligeros admiten posibilidades de renderizado en tiempo real. - Educación y demostración

Los profesores o formadores pueden generar vídeos didácticos a partir de imágenes fijas para demostrar procesos dinámicos (por ejemplo, simulaciones de experimentos científicos.) La interfaz de Gradio es fácil de usar y adecuada para usuarios sin conocimientos técnicos. - computación periférica

El modelo de 1.300 millones de parámetros de FramePack es adecuado para su implantación en dispositivos periféricos, como dispositivos móviles o sistemas integrados para la generación de vídeo localizado.

CONTROL DE CALIDAD

- ¿Con qué GPU es compatible FramePack?

Compatible con GPU NVIDIA RTX series 30XX, 40XX, 50XX con un mínimo de 6 GB de RAM. GTX 10XX/20XX no probadas, pueden no ser compatibles. - ¿Cuánto se tarda en generar un vídeo?

En la NVIDIA 4090, es de 2,5 seg/fotograma sin optimización y de 1,5 seg/fotograma con el teacache activado. Se tardan unos 3-4 minutos en generar 5 segundos de vídeo. - ¿Cómo mejorar la calidad de la generación?

Utilice imágenes de entrada de alta calidad, escriba pistas de acción claras, desactive la sage-attention y desactive el teacache para obtener una generación final de alta calidad. - ¿Es posible generar vídeos extralargos?

Sí, FramePack permite generar miles de fotogramas de vídeo (por ejemplo, 60 segundos a 30 fps). Los requisitos de memoria de vídeo son fijos y no aumentan debido a la duración del vídeo.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...