FastDeploy - Herramienta de Baidu de alto rendimiento para el razonamiento y despliegue de grandes modelos

Últimos recursos sobre IAActualizado hace 8 meses Círculo de intercambio de inteligencia artificial 44.9K 00

¿Qué es FastDeploy?

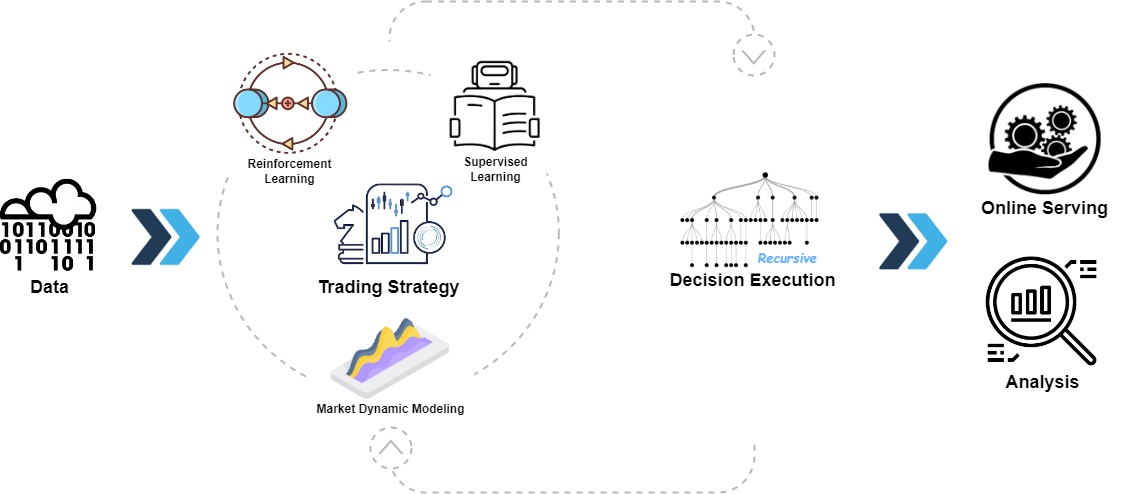

FastDeploy es una herramienta de inferencia y despliegue de alto rendimiento de Baidu, diseñada para grandes modelos lingüísticos (LLM) y modelos lingüísticos visuales (VLM). FastDeploy se ha desarrollado a partir del marco PaddlePaddle, es compatible con múltiples plataformas de hardware (por ejemplo, GPU NVIDIA, XPU Kunlun, etc.) y está equipada con funciones como el equilibrio de carga, la optimización cuantitativa y la inferencia distribuida, FastDeploy es compatible con la API de OpenAI y la API de vLLM para soportar el razonamiento local y con servicio, simplificando el proceso de despliegue de modelos de gran tamaño. La última versión, FastDeploy 2.0, introduce la tecnología de cuantificación de 2 bits para optimizar aún más el rendimiento y facilitar la implantación eficaz de modelos de gran tamaño.

Principales características de FastDeploy

- Despliegue eficiente del razonamientoEs compatible con diversas plataformas de hardware, como las GPU NVIDIA y las XPU Kunlun Core, y proporciona una función de despliegue con un solo clic para simplificar el proceso de despliegue de inferencia de modelos de gran tamaño.

- optimización del rendimientoMejora significativa de la velocidad de inferencia de modelos con técnicas de cuantificación (por ejemplo, cuantificación de 2 bits), optimización de gráficos CUDA y descodificación especulativa.

- inferencia distribuida: Soportar el razonamiento distribuido a gran escala, optimizar la eficiencia de la comunicación y mejorar la eficiencia del razonamiento para modelos a gran escala.

- Equilibrio de carga y programaciónDetección de carga en tiempo real y programación de equilibrio de carga distribuida basada en Redis para optimizar el rendimiento del clúster y garantizar el funcionamiento estable del sistema con cargas elevadas.

- usabilidadProporciona una interfaz Python limpia y una documentación detallada para facilitar a los usuarios una rápida puesta en marcha.

- Técnicas de cuantificación de 2 bitsLa introducción de la cuantificación de 2 bits reduce drásticamente la huella de memoria y los requisitos de recursos de hardware, lo que permite desplegar cientos de miles de millones de modelos a nivel de parámetros en una sola tarjeta.

- compatibilidadLa interfaz vLLM es compatible con la API OpenAI y la interfaz vLLM, y admite tanto el razonamiento local como el servicio, con 4 líneas de código para completar el razonamiento local, y 1 línea de comando para iniciar el servicio.

Dirección del sitio web oficial de FastDeploy

- Página web del proyecto:: https://paddlepaddle.github.io/FastDeploy/

- Repositorio GitHub:: https://github.com/PaddlePaddle/FastDeploy

Cómo utilizar FastDeploy

- Instalación de dependencias: Instala el Flying Paddle Frame y FastDeploy:

pip install paddlepaddle fastdeploy- Prepara el modelo:Descargue y prepare el archivo del modelo (por ejemplo, modelo preentrenado o modelo convertido).

- inferencia local: Razonamiento local con interfaces Python:

from fastdeploy import inference

# 加载模型

model = inference.Model("path/to/model")

# 准备输入数据

input_data = {"input_ids": [1, 2, 3], "attention_mask": [[1, 1, 1]]}

# 进行推理

result = model.predict(input_data)

print(result)- Despliegue orientado a servicios: Inicia el servicio de razonamiento:

fastdeploy serve --model path/to/model --port 8080- optimización del rendimiento: Optimización de modelos mediante técnicas cuantitativas:

from fastdeploy import quantization

quantized_model = quantization.quantize_model("path/to/model", "path/to/quantized_model", quantization_type="2-bit")Principales ventajas de FastDeploy

- Razonamiento de alto rendimientoLa tecnología de la empresa se basa en la cuantificación, CUDA Graph y otras tecnologías para mejorar significativamente la velocidad de inferencia, al tiempo que admite múltiples plataformas de hardware para dar todo el juego al rendimiento del hardware.

- Despliegue eficaz: Proporciona una interfaz Python limpia y herramientas de línea de comandos para soportar el razonamiento local y en servicio y simplificar el proceso de despliegue.

- Optimización de recursosLa última incorporación al sistema es una tecnología de cuantificación de 2 bits que reduce drásticamente la huella de memoria gráfica, admite la implantación de modelos a hiperescala con una sola tarjeta y optimiza la utilización de los recursos del clúster con equilibrio de carga.

- usabilidadLa interfaz es sencilla y está bien documentada para una rápida puesta en marcha, es compatible con las API de OpenAI y las interfaces vLLM, y admite una rápida puesta en marcha de los servicios.

- Aplicación multiescenarioAmplia aplicación al procesamiento del lenguaje natural, las aplicaciones multimodales, las implantaciones de nivel industrial, la investigación académica y las aplicaciones empresariales para satisfacer diversas necesidades.

Para quién es FastDeploy

- Desarrolladores empresariales: Los desarrolladores empresariales despliegan rápidamente grandes modelos, optimizan los recursos para reducir costes y ayudan a mejorar la eficiencia de los servicios empresariales.

- Científicos de datos e investigadores: Experimentos de inferencia de alto rendimiento y estudios multimodales realizados por investigadores para apoyar la optimización de modelos y la experimentación eficientes.

- arquitecto de sistemasEl arquitecto es responsable del diseño de sistemas de inferencia distribuidos a gran escala y de la optimización del equilibrio de carga para garantizar un funcionamiento estable del sistema.

- Desarrolladores de aplicaciones de IADesarrolladores: Desarrollan aplicaciones de procesamiento del lenguaje natural y multimodales para mejorar el rendimiento de las aplicaciones y optimizar la experiencia del usuario.

- Investigadores universitarios: Los académicos investigan la optimización de modelos y las técnicas multimodales para facilitar experimentos eficientes y hacer avanzar la investigación académica.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...