Easy Dataset: una herramienta sencilla para crear grandes conjuntos de datos de modelos afinados

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 65.7K 00

Introducción general

Easy Dataset es una herramienta de código abierto diseñada específicamente para el ajuste fino de grandes modelos (LLM), alojada en GitHub. Ofrece una interfaz fácil de usar que permite a los usuarios cargar archivos, segmentar automáticamente el contenido, generar preguntas y respuestas y, en última instancia, generar conjuntos de datos estructurados adecuados para el ajuste fino. El desarrollador Conard Li creó esta herramienta para ayudar a los usuarios a transformar el conocimiento del dominio en datos de formación de alta calidad. Admite múltiples formatos de exportación, como JSON y Alpaca, y es compatible con todas las API de LLM que siguen el formato OpenAI, lo que facilita la puesta en marcha y la creación rápida de conjuntos de datos, tanto si se es un experto técnico como un usuario ocasional.

Lista de funciones

- Tratamiento inteligente de documentosCuando subes un archivo Markdown, la herramienta lo divide automáticamente en trozos más pequeños.

- Generación de preguntasGeneración automática de preguntas pertinentes a partir del texto segmentado.

- Generación de respuestasLlamada a la API LLM para generar respuestas detalladas para cada pregunta.

- Edición flexiblePermite modificar las preguntas, las respuestas o el contenido de los conjuntos de datos en cualquier momento.

- Múltiples formatos de exportaciónLos conjuntos de datos pueden exportarse a los formatos JSON, JSONL o Alpaca.

- Amplio soporte de modelosCompatible con todas las API LLM que siguen el formato OpenAI.

- interfaz fácil de usar: El diseño es intuitivo y adecuado tanto para usuarios técnicos como no técnicos.

- Consejos personalizadosPermite al usuario añadir avisos del sistema que dirijan al modelo a generar un estilo particular de respuesta.

Utilizar la ayuda

Proceso de instalación

Easy Dataset ofrece dos formas principales de utilizarlo: desplegándolo a través de Docker o ejecutándolo desde fuentes locales. Estos son los pasos detallados:

Instalación mediante Docker

- Instalación de Docker

Si su ordenador aún no dispone de Docker, descargue e instale Docker Desktop. una vez completada la instalación, abra un terminal para comprobar si se ha realizado correctamente:

docker --version

Si aparece el número de versión, significa que está instalado.

- Extrae la imagen y ejecuta

Introduzca el siguiente comando en el terminal para extraer la imagen oficial e iniciar el servicio:

docker run -d -p 3000:3000 -v {你的本地路径}:/app/local-db --name easy-dataset conardli17/easy-dataset:latest

{你的本地路径}Debe sustituirla por la ruta de la carpeta de su ordenador que utiliza para almacenar los datos, por ejemploC:\data(Windows) o/home/user/data(Linux/Mac).-p 3000:3000Indica que el puerto 3000 dentro del contenedor está mapeado al puerto 3000 localmente.-vEs para evitar que los datos se pierdan después de reiniciar el contenedor.

- interfaz de acceso

Una vez iniciado, abra el navegador y escribahttp://localhost:3000Verá la página de inicio de Easy Dataset. Verá la página de inicio de Easy Dataset, haga clic en el botón "Crear proyecto" para empezar.

Ejecución local a través del código fuente

- Preparar el entorno

- Asegúrate de tener Node.js (versión 18.x o superior) y npm instalados en tu ordenador.

- Método de comprobación: Introducir en el terminal

node -vresponder cantandonpm -vSólo hay que ver el número de versión.

- almacén de clones

Introdúcelo en el terminal:

git clone https://github.com/ConardLi/easy-dataset.git

cd easy-dataset

- Instalación de dependencias

Se ejecuta dentro de la carpeta del proyecto:

npm install

- Inicio de los servicios

Introduzca el siguiente comando para compilar y ejecutar:

npm run build

npm run start

Una vez hecho esto, abra su navegador y visite http://localhost:3000Puede acceder a la pantalla Herramientas.

Funciones principales

Crear un proyecto

- Una vez en la página de inicio, haga clic en el botón "Crear proyecto".

- Introduzca el nombre del proyecto, por ejemplo "Mi conjunto de datos".

- Haga clic en "Confirmar" y el sistema creará un nuevo espacio de proyecto para usted.

Carga y tratamiento de documentos

- En la página del proyecto, busque la opción "Dividir texto" o "Dividir texto".

- Haga clic en "Cargar archivo" y seleccione un archivo Markdown local (por ejemplo

example.md). - Tras la carga, la herramienta dividirá automáticamente el contenido del archivo en pequeños segmentos. Cada segmento se muestra en la interfaz y puedes ajustar manualmente el resultado de la división.

Generar preguntas y respuestas

- Vaya a la página "Preguntas" o "Gestión de preguntas".

- Haga clic en el botón "Generar preguntas" y la herramienta generará preguntas basadas en cada texto.

- Compruebe la pregunta generada y, si no está satisfecho, puede modificarla haciendo clic en el botón Editar situado junto a la pregunta.

- Haz clic en "Generar respuestas", selecciona una API de LLM (tienes que configurar la clave API de antemano) y la herramienta generará respuestas para cada pregunta.

- Una vez generadas las respuestas, puede editarlas manualmente para asegurarse de que el contenido cumple los requisitos.

Exportar un conjunto de datos

- Vaya a la pantalla Conjuntos de datos o Gestión de conjuntos de datos.

- Haga clic en el botón "Exportar" y elija el formato de exportación (por ejemplo, JSON o Alpaca).

- El sistema generará un archivo, haga clic en Descargar y guárdelo localmente.

Función destacada Operación

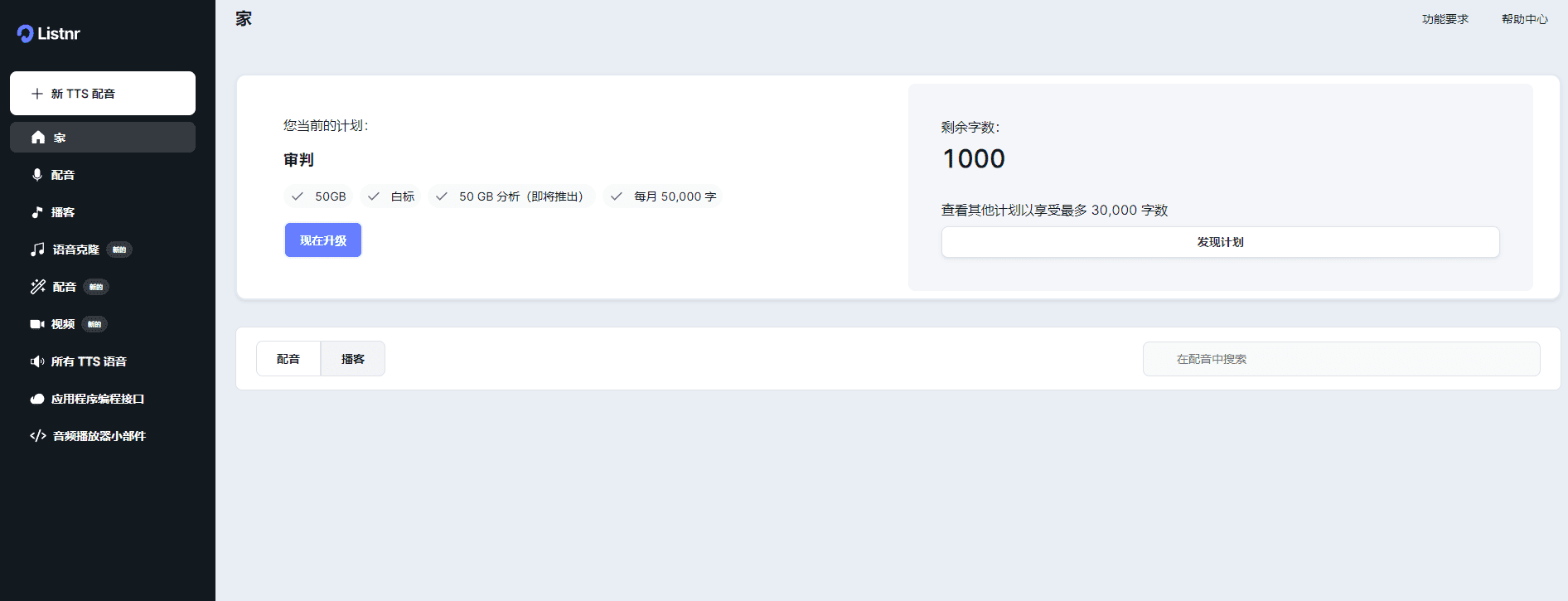

Configuración de la API LLM

- En la página Configuración o Ajustes, busque Configuración del modelo.

- Introduce tu clave API LLM (por ejemplo, la clave API de OpenAI).

- Seleccione el tipo de modelo (se admiten muchos modelos comunes) y guarde la configuración.

- Una vez configurado, se llamará a este modelo cuando se generen respuestas.

Alertas personalizadas del sistema

- En la página Configuración, busque Avisos o Plantillas de avisos.

- Introduzca indicaciones personalizadas, como "Responda a la pregunta en un lenguaje sencillo".

- Una vez guardadas, las respuestas se generarán con el estilo ajustado según sus indicaciones.

Optimización del conjunto de datos

- En la pantalla Conjuntos de datos, haga clic en el botón Optimizar.

- El sistema analiza el conjunto de datos y elimina los duplicados u optimiza el formato.

- El conjunto de datos optimizado es más adecuado para su uso directo en el ajuste del modelo.

advertencia

- Si está desplegando con Docker, no olvide hacer copias de seguridad periódicas.

{你的本地路径}Los datos que contiene. - Cuando se ejecuta localmente, asegúrese de que la red está abierta, ya que la generación de respuestas requiere una conexión a Internet para llamar a la API.

- Si se encuentra con un error, puede consultar la página "Releases" en GitHub para descargar la última versión y solucionar el problema.

escenario de aplicación

- Los creadores de modelos afinan el LLM

Los desarrolladores pueden utilizar Easy Dataset para procesar documentos técnicos, generar pares de preguntas y respuestas, producir rápidamente conjuntos de entrenamiento y mejorar el rendimiento de los modelos en dominios específicos. - Elaboración de material didáctico por parte de los educadores

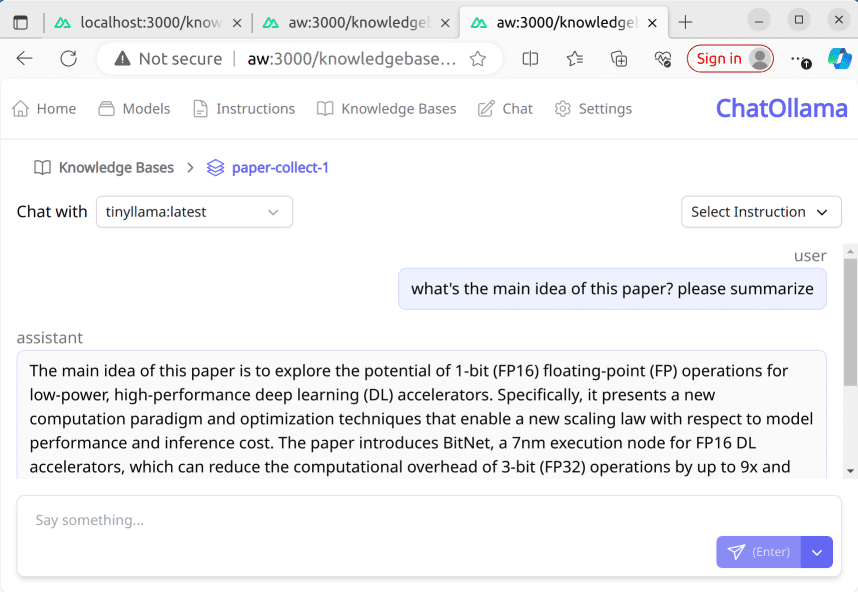

Los profesores pueden cargar folletos del curso y generar preguntas y respuestas para la revisión de los alumnos o la creación de contenidos del curso en línea. - Los investigadores recopilan conocimientos

Los investigadores pueden cargar artículos o informes, extraer preguntas y respuestas clave y organizarlas en datos estructurados para su análisis.

CONTROL DE CALIDAD

- ¿Qué formatos de archivo admite Easy Dataset?

Actualmente el soporte principal es para archivos Markdown (.md), es posible que en el futuro se añadan otros formatos. - ¿Tengo que proporcionar mi propia API LLM?

Sí, la herramienta en sí no proporciona servicios LLM y requiere que el usuario configure su propia clave API, como OpenAI u otros modelos compatibles. - ¿Para qué modelos puede utilizarse el conjunto de datos exportado?

Siempre que el modelo sea compatible con los formatos de OpenAI (por ejemplo, LLaMA, GPT, etc.), el conjunto de datos exportado podrá utilizarse directamente.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...