DreamTalk: ¡Genera expresivos vídeos parlantes con una sola imagen de avatar!

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 70.3K 00

DreamTalk Introducción general

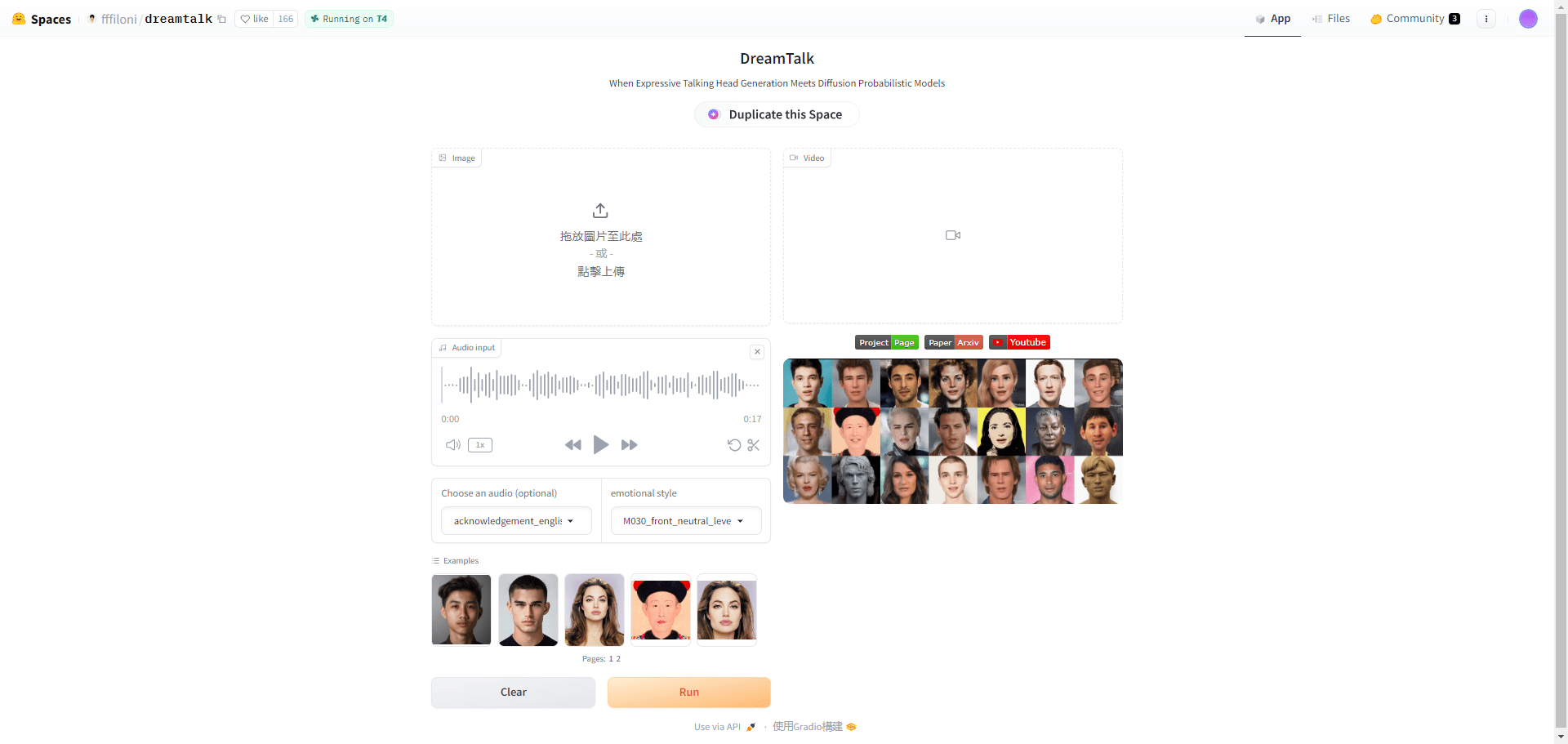

DreamTalk es un marco de generación de cabezas parlantes expresivas basado en modelos de difusión, desarrollado conjuntamente por la Universidad de Tsinghua, Alibaba Group y la Universidad de Ciencia y Tecnología de Huazhong. Consta de tres componentes principales: una red de reducción de ruido, un experto en estilo labial y un predictor de estilo, y es capaz de generar cabezas parlantes diversas y realistas a partir de una entrada de audio. El marco es capaz de manejar audio multilingüe y ruidoso, y proporciona un movimiento facial de alta calidad y una sincronización precisa de la boca.

Lista de funciones de DreamTalk

Genere vídeos de cabezas parlantes realistas a partir del audio

Compatible con varios idiomas y entrada de voz

Admite la salida de múltiples estilos y expresiones

Soporte para avatares de personajes personalizados y referencias de estilo

Demostración en línea y descarga de códigos

Ayuda DreamTalk

Visite la página de inicio del proyecto para obtener más información y vídeos de demostración

Visite la dirección del artículo para leer los detalles técnicos y los resultados experimentales

Visite la dirección de GitHub para descargar el código y el modelo preentrenado

Siga la guía de instalación para configurar el entorno y las dependencias

Ejecuta inference_for_demo_video.py para razonar y generar el vídeo

Ajuste las opciones de entrada y salida según las descripciones de los parámetros

Dirección de DreamTalk Online Experience

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...