Implantación de un modelo de herramienta de chat personalizado "mini" para ordenadores de bajo coste

¿Por qué desplegar un modelo de herramienta de chat privado "mini"?

Muchas personas han utilizado ChatGPT, Wisdom Spectrum, Beanbag, Claude y otros excelentes modelos de lenguaje de gran tamaño, y tienen la necesidad de utilizar en profundidad también va a comprar los servicios de pago de terceros, después de todo, son un rendimiento muy destacado. Por ejemplo, mi principal escenario de trabajo es escribir artículos, entonces voy a elegir Claude.

Aunque me encanta usar Claude, ¿realmente lo uso a diario con mucha frecuencia? La respuesta es, por supuesto, ¡no!

Los umbrales, como los límites de uso, los factores de precio, los problemas de red, etc., reducen de forma natural la frecuencia de uso en situaciones innecesarias. --Si una herramienta no se puede "coger y usar" en cualquier entorno, es que algo falla.

En este caso, utilizar un modelo "pequeño" puede ser una mejor opción, ¿por qué?

"Características del modelo "pequeño

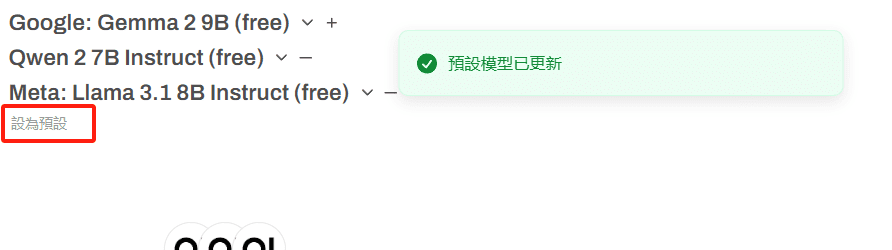

Gemma2, llama3.1:8b, qwen2:7b son lo suficientemente pequeños para el uso diario, con 32k de largo de entrada y salida contextual, la mayoría de los comandos se siguen, expresión china, responder a las preguntas, todos son buenos, y no hay límite de 2.000 palabras para los productos de tipo "Wenxin Yiyin". Las limitaciones... Es suficiente para el uso diario, y consideraremos la posibilidad de especializarnos en tareas especiales. Las ventajas de las miniaturas son las siguientes:

- Compatibilidad con tamaños de contexto no inferiores (o incluso superiores) al modelo de mayor tamaño.

- Tareas cotidianas de escritura sin resultados de baja calidad

- uso ilimitado

- Varias miniaturas pueden emitir respuestas simultáneamente para facilitar la comparación.

- Ejecución más rápida

¿Qué es la implantación privada?

Un chat privado Interfaz WEB para una personalización sencilla y acceso gratuito a modelos "pequeños".

La solución más clásica es desplegar Ollama+Open WebUI localmente, el primero se encarga de ejecutar las miniaturas en el ordenador local y el segundo aloja la interfaz de chat. Considere las extranets para el uso en cualquier momento y lugar delcloudflaretal vezcpolarAsigne la dirección a una red externa (busque el tutorial usted mismo).

vantage

- Los datos del chat son locales y privados

- Flexibilidad para personalizar los modelos locales

inconvenientes

- Difícil de ejecutar de forma persistente (siempre hay que apagar el ordenador, ¿verdad?) Difícil de publicar en una extranet

- Altos requisitos de hardware informático

cuestión que debe abordarse

Lo que intentamos solucionar son las deficiencias:

1. La interfaz de chat de IA desplegada debe publicarse en una extranet con URL de acceso estables para que pueda utilizarse en cualquier momento y lugar.

2. Umbral de hardware del ordenador es principalmente el uso de Ollama para ejecutar el modelo a nivel local, cambió a los fabricantes conocidos de los servicios de la API puede ser, la protección de la privacidad es relativamente bueno y libre. (Computadora general local puede ejecutar hasta modelos pequeños, la red tiene una API gratuita).

Programa óptimo

1. Despliegue doceker local/nube libre WebUI abierta + acceso a APIs de modelos "pequeños

Sólo para uso local, el equipo informático sólo debe ser capaz de ejecutar doceker

2. Autoimplantación/uso de NextChat tripartito + acceso a API de modelo "pequeño

La autoimplantación de NextChat requiere tu propio nombre de dominio, y existe el riesgo de comprometer tus claves al utilizar un NextChat tripartito.

Este plan de despliegue es sólo para personas con experiencia para operar, inexpertos blanco no se recomienda, el buen uso de productos maduros, o se encuentran con problemas anormales retraso no vale la pena.

Opción de despliegue óptimo 1

1. Despliegue de doceker

Local: despliegue local de tutoriales doceker busca por ti mismo

Nube: recursos gratuitos de doceker en la nube, por favor busque por su cuenta, aquí yo uso Koyeb(Intranet no accesible directamente, requiere ciencia y tecnología) (Intranet no accesible directamente, requiere ciencia y tecnología)

2. Despliegue de Open WebUI en doceker

Local: DetallesLeer el documentoSe recomiendan los siguientes comandos de instalación (manténgalos actualizados)

docker run --rm --volume /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower --run-once open-webui

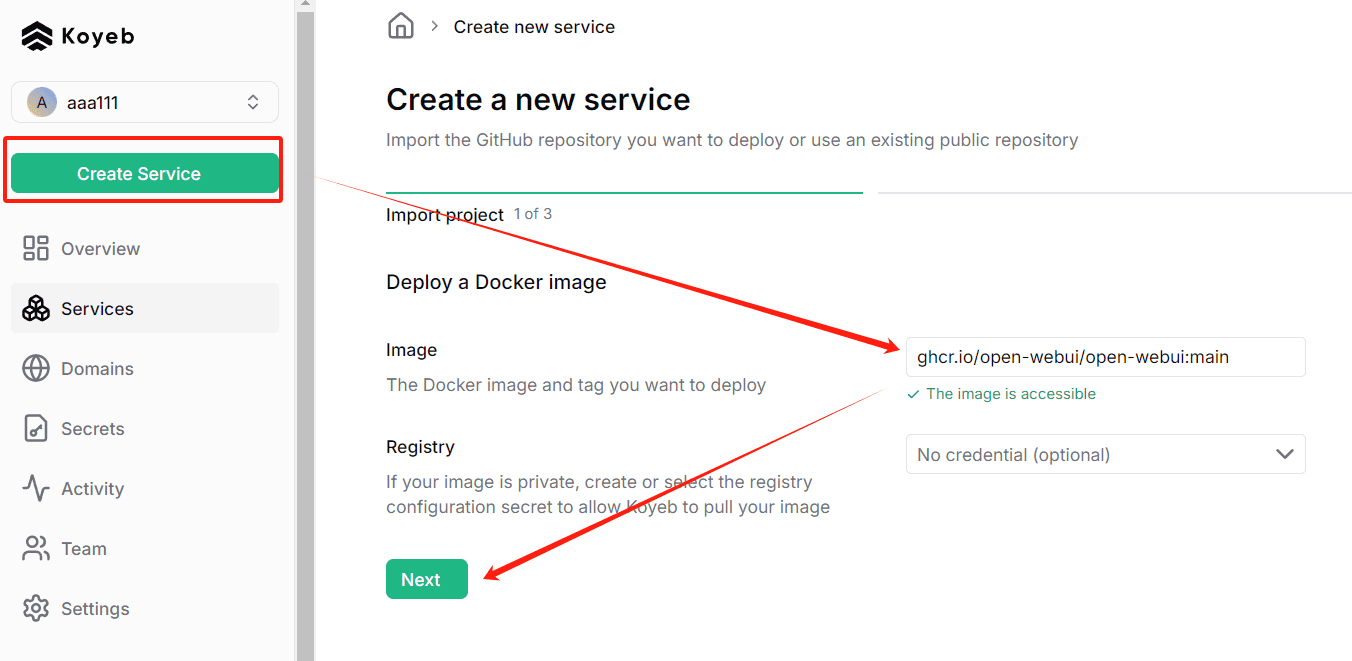

Nube: RegistroKoyebA continuación, haga clic en Crear servicio e introduzca el siguiente comando

ghcr.io/open-webui/open-webui:main

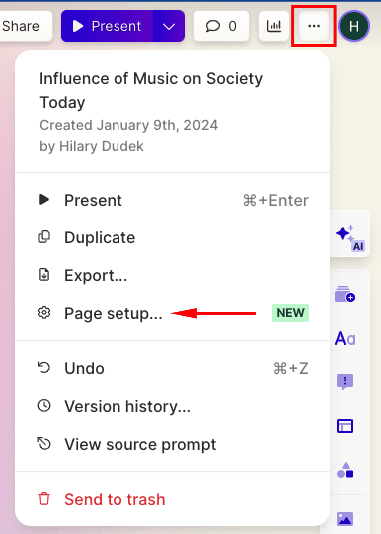

3. Iniciar Abrir WebUI

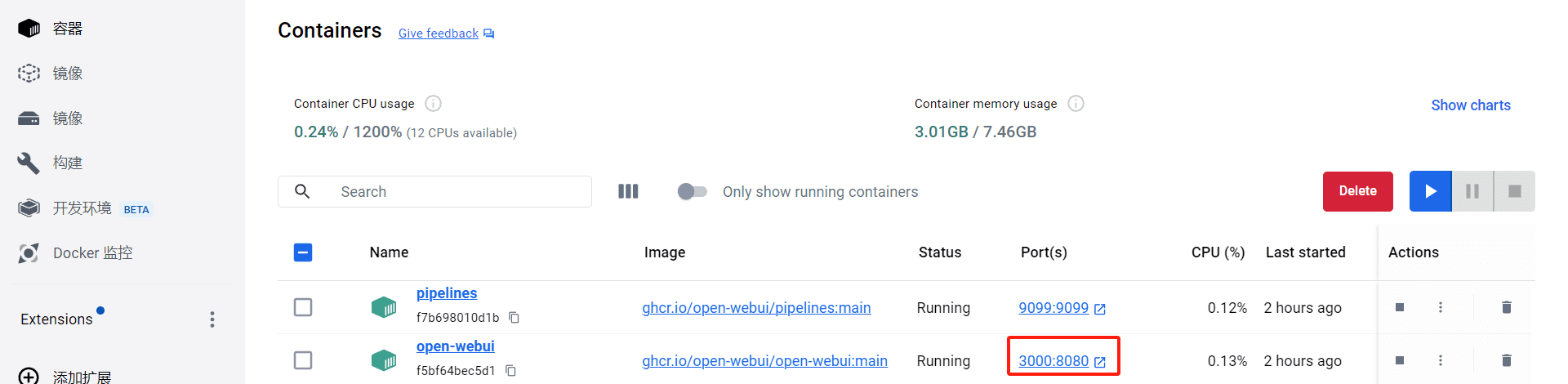

Inicio local, dirección de acceso por defecto: http://localhost:3000/

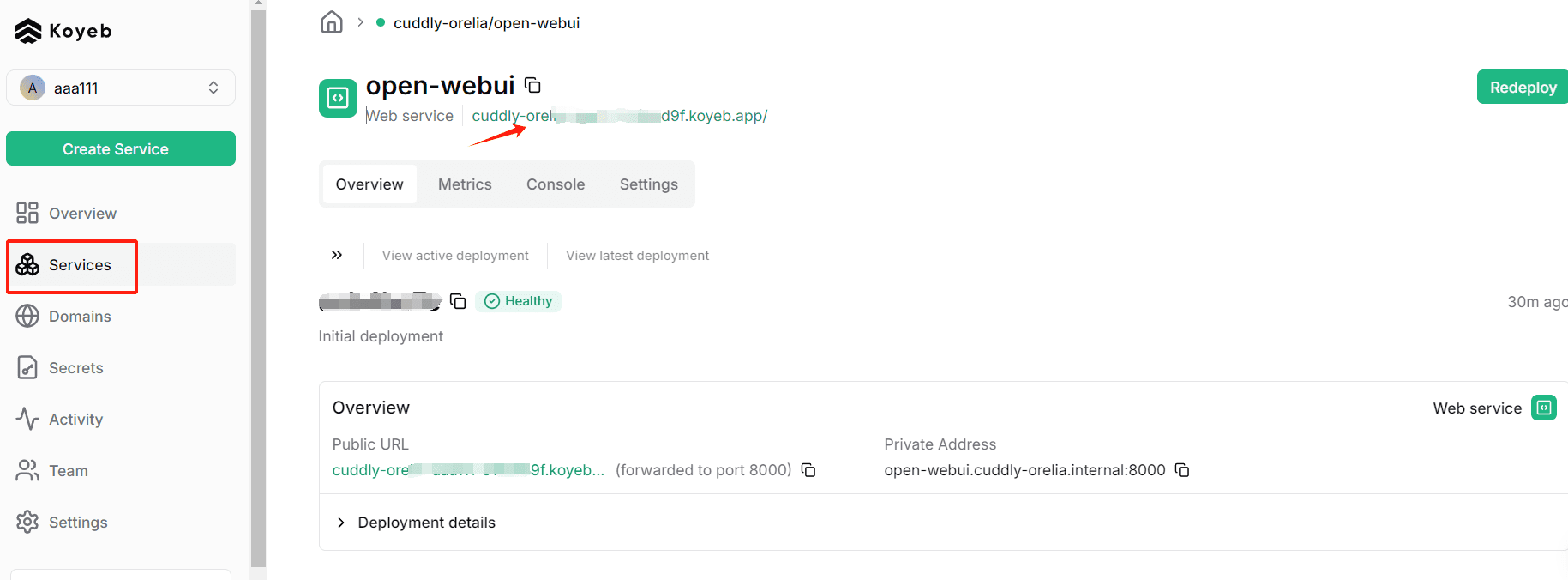

Lanzamiento en la nube, una vez completado el despliegue de Koyeb, se puede hacer clic aquí (la desventaja es que este nombre de dominio no se puede acceder directamente por la intranet, la vinculación del nombre de dominio requiere la apertura de una cuenta de pago)

Después de la puesta en marcha, registrar una cuenta, por defecto, la primera cuenta registrada es la cuenta de administrador. Ya registrado, por lo que sólo la pantalla de inicio de sesión, la primera visita se puede ver el portal de "registro".

4. Solicitar un modelo de API "pequeño" gratuito

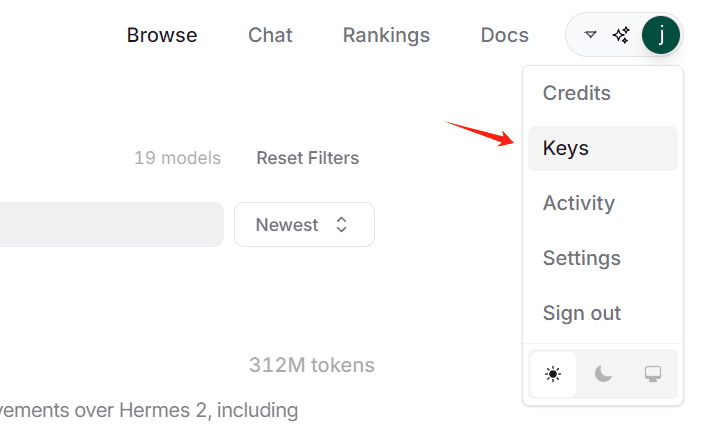

Se recomienda OpenRouter y lleva un año escribiendo novelas utilizando sus modelos gratuitos. Aquí hay una explicación de cómo obtener las API de modelos de OpenRouter.

PD: Proveedores nacionales de API de modelos pequeños gratuitos: Silicon Flow

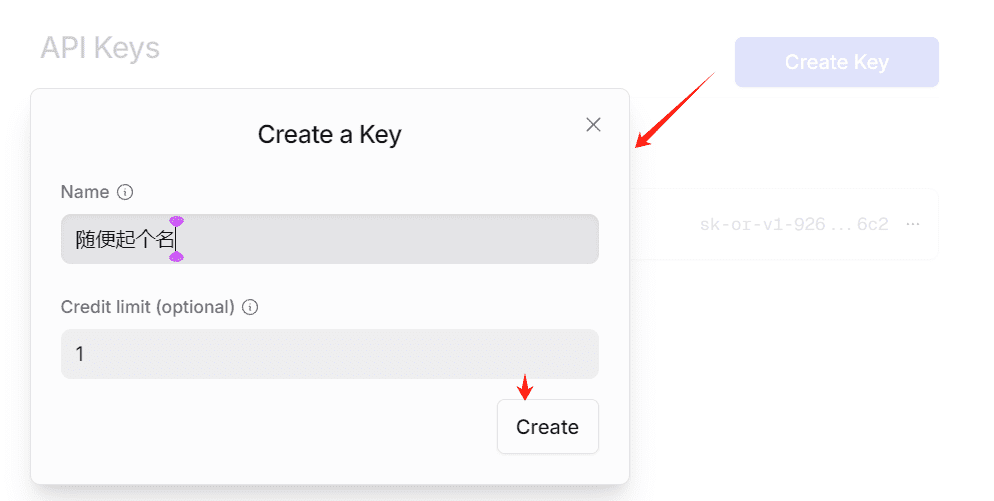

4.1 Crear CLAVE

Obtendrá una cadena de caracteres que empieza por sk-, esto es CLAVE, por favor cópiela y guárdela localmente, no podrá volver a copiarla una vez cerrada la página.

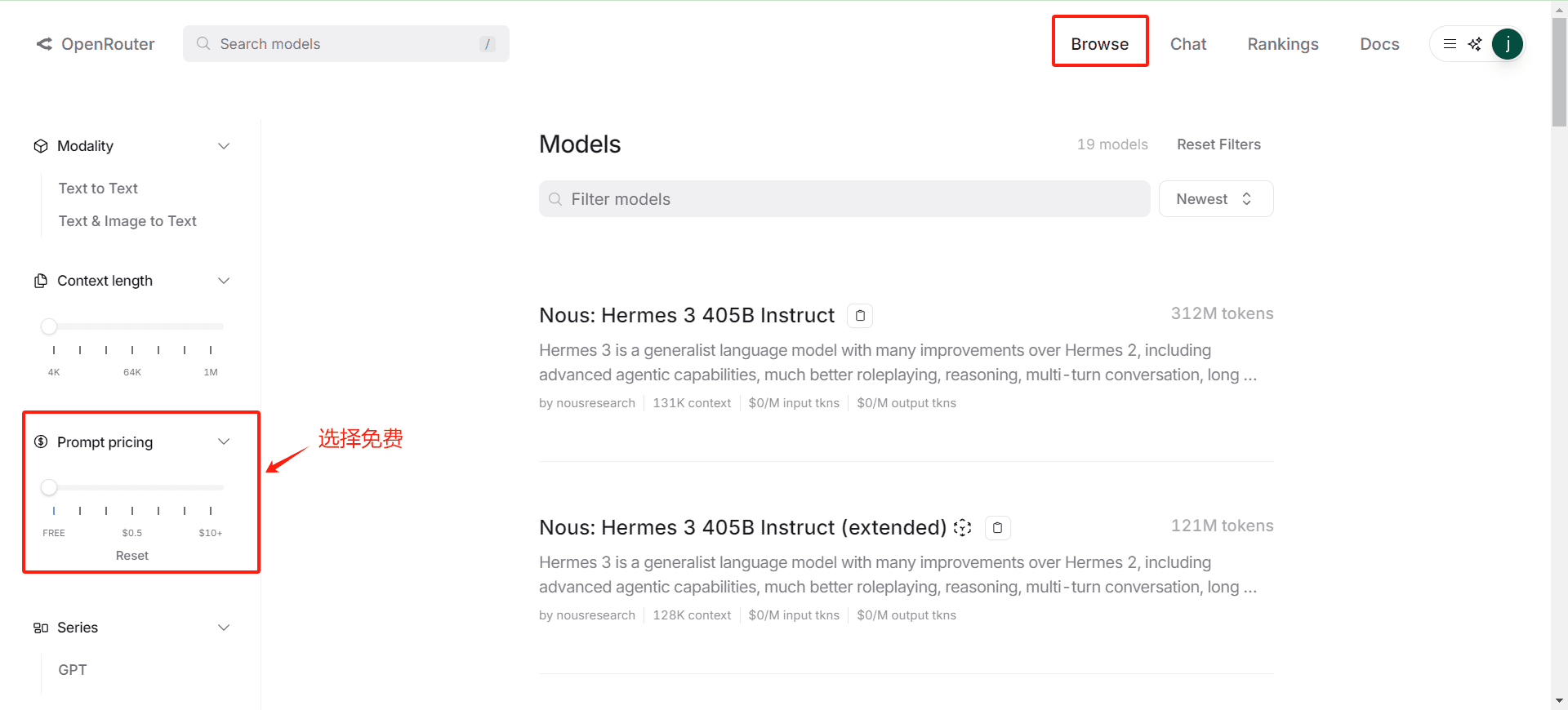

4.2 Confirmación de la lista de modelos libres

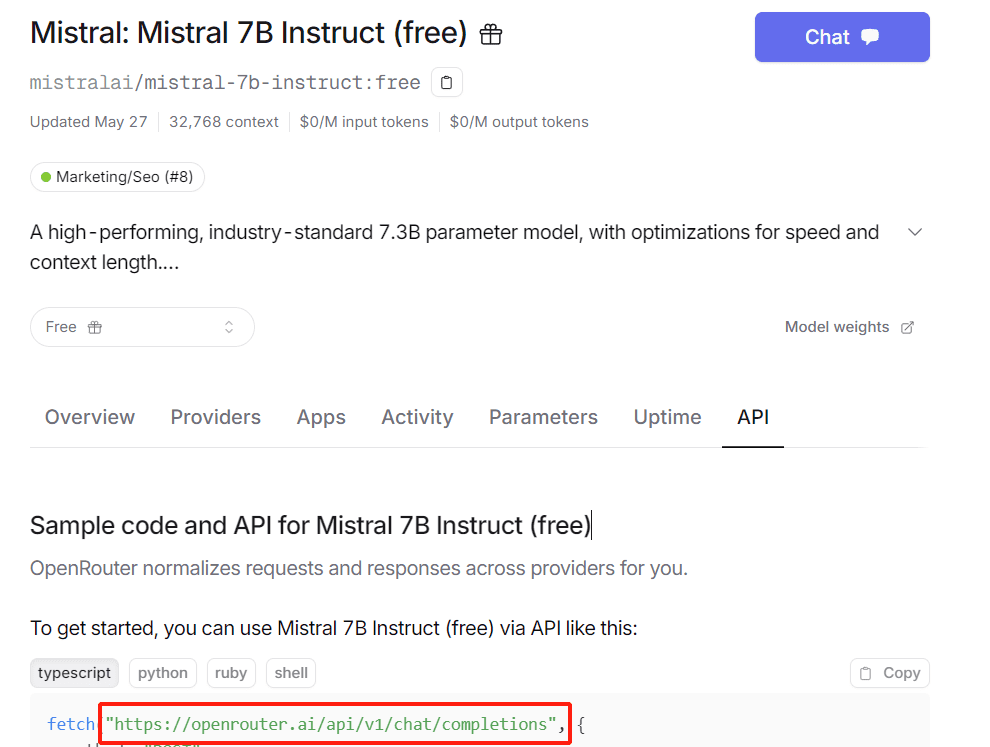

4.3 Obtener la URL de solicitud de la API(matemáticas) género

Vaya a la página de cualquier modelo para verlo, generalmente: https://openrouter.ai/api/v1/chat/completions

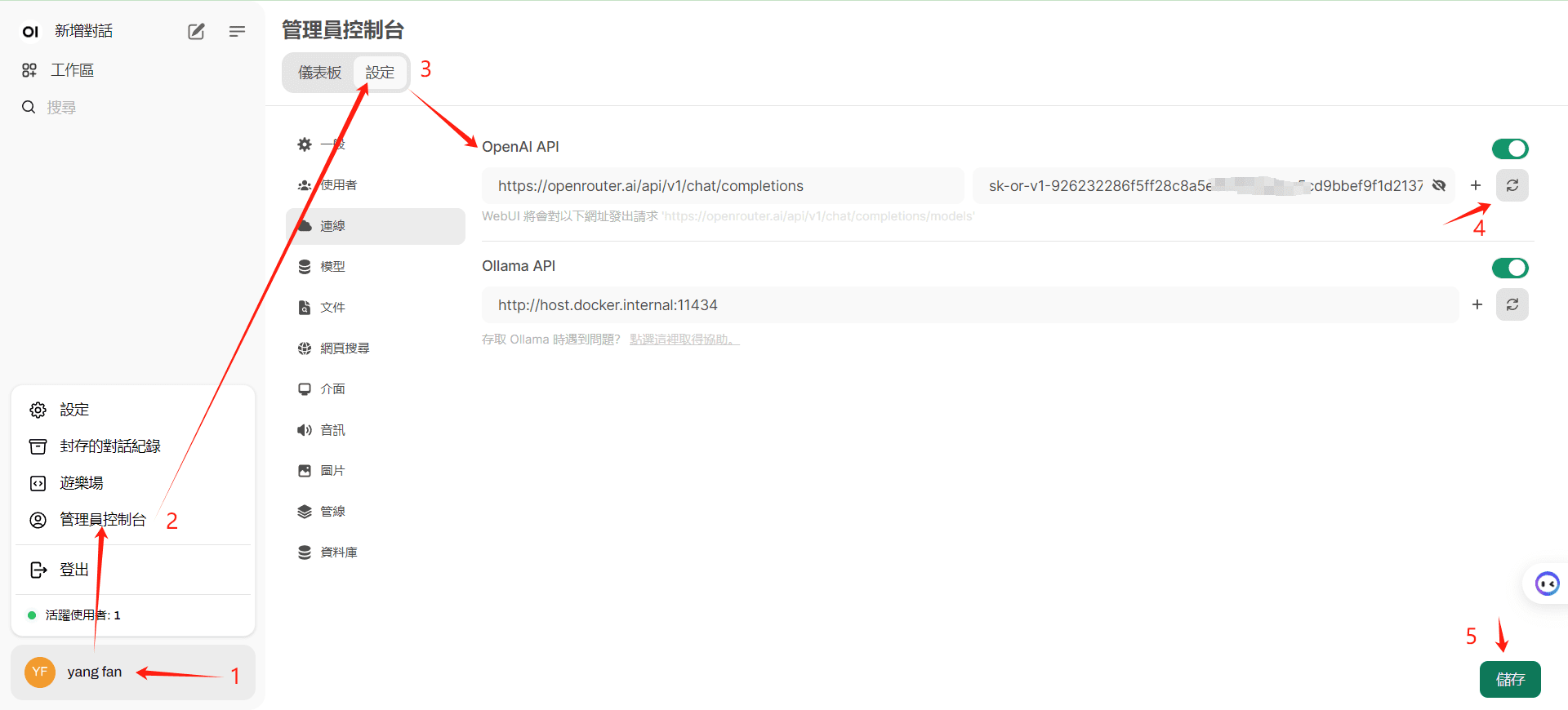

5. Entrar en el modelo de configuración de Open WebUI

Tenga en cuenta que al hacer clic en "4" se confirma que se ha accedido correctamente a la interfaz antes de hacer clic en Guardar.

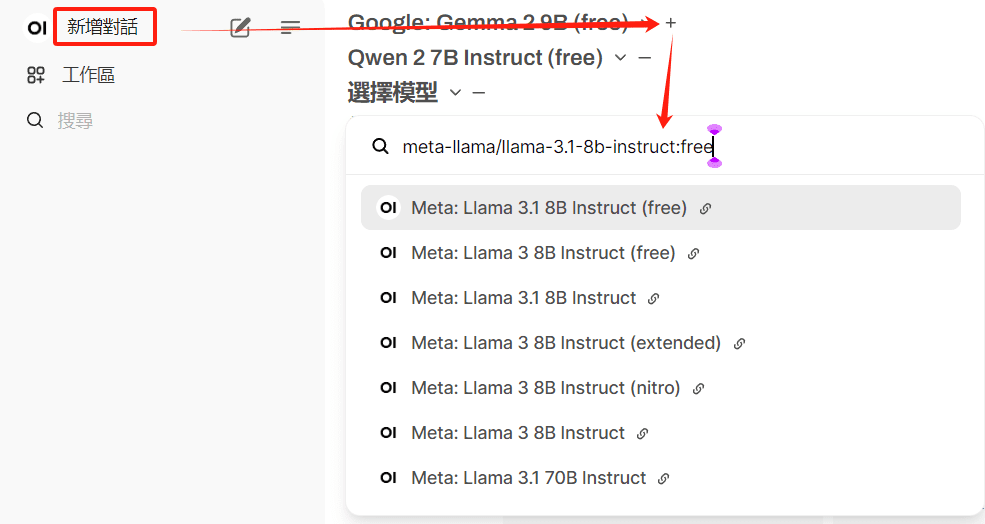

6. Configurar el modelo por defecto

Se pueden seleccionar varios modelos libres

El uso de modelos de pago conllevará la desactivación de la cuenta

Haz clic en Preajustes para guardar los modelos más utilizados

7. Intentar un primer diálogo

Opción de despliegue óptimo 2

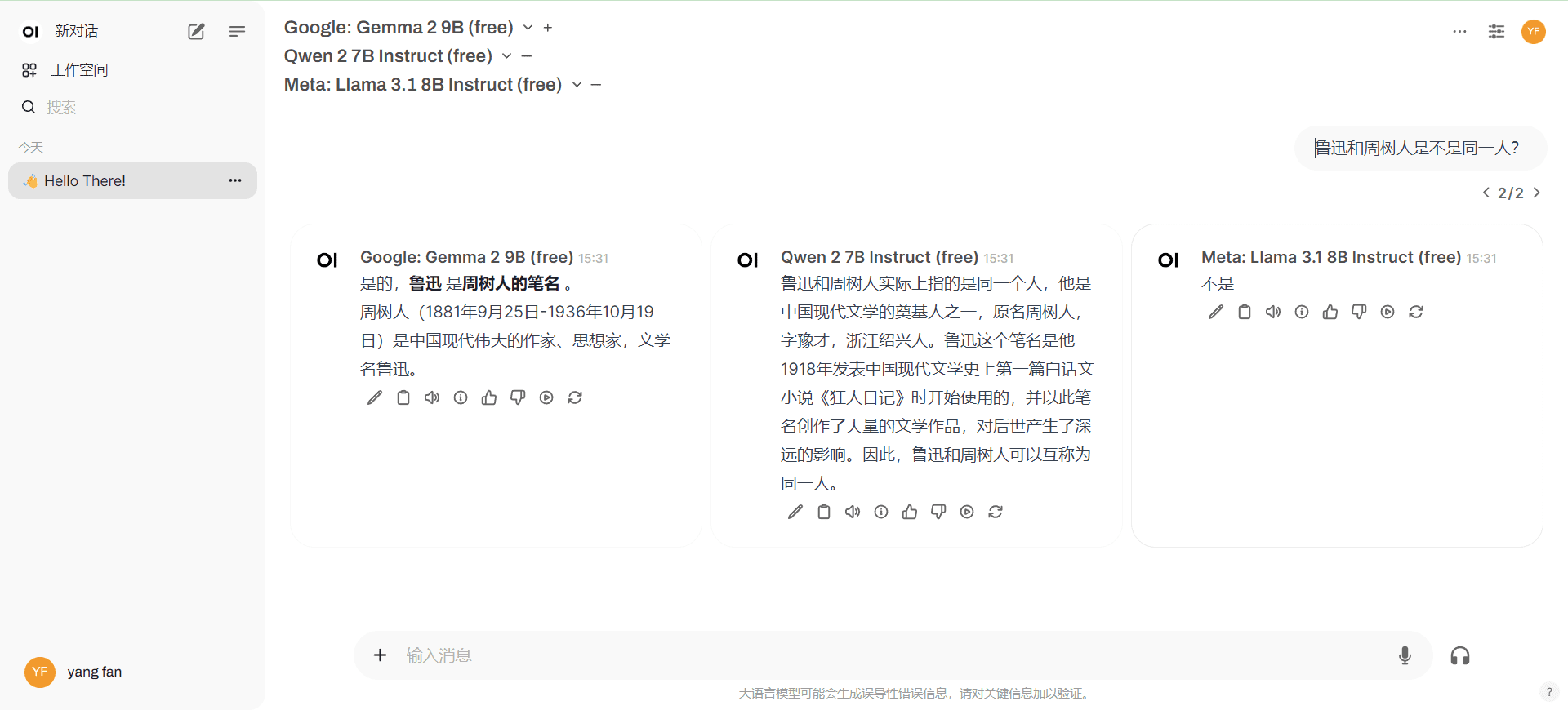

1. Implantación en la nube de NextChat

Implantación gratuita en la nube con un solo clic, consulte la ayuda usted mismo: https://github.com/ChatGPTNextWeb/ChatGPT-Next-Web

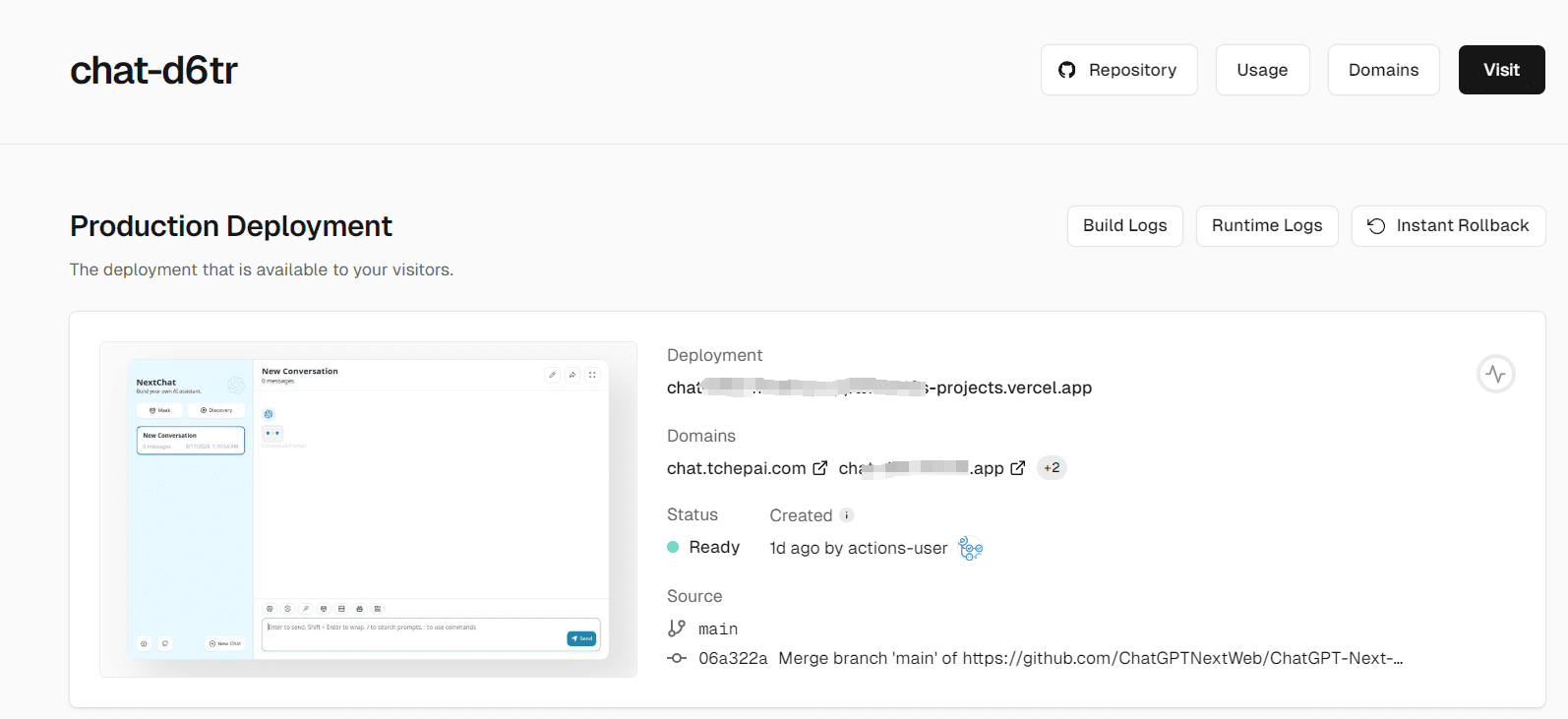

2. Aquí se utiliza el primer despliegue Deploy (vercel).

Sólo tienes que seguir el proceso, y aquí tienes tres cosas que debes tener en cuenta:

- Asegúrese de leer detenidamente la documentación de ayuda y siga el tutorial para configurar su proyecto para que se actualice automáticamente.

- Configure la variable KEY y la contraseña de acceso durante el proceso de instalación de vercel, se recomienda configurarlos previamente.

- Vincular su propio nombre de dominio le permite acceder directamente a las redes nacionales.

3. Variables de configuración

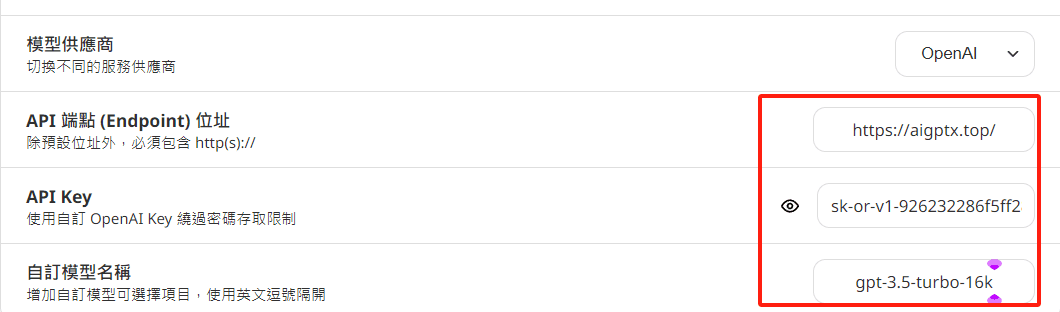

No es como la Opción 1 que puede leer la lista de modelos automáticamente, necesita definir su propia lista de modelos libre, tenga en cuenta el cambio de dirección de interfaz

BASE_URL o OpenAI Endpoint: Establézcalo en https://openrouter.ai/api

OPENAI_API_KEY o Clave de API de OpenAI: Introduzca su OpenRouter Clave API aquí.

CUSTOM_MODELS o Modelos personalizados: Especifique el nombre del modelo tal y como aparece en OpenRouter.

4. Pantalla de finalización de la implantación

5. Nombre de dominio vinculante

Resolver los problemas de acceso en el país

4. Puede configurar la CLAVE API de un modelo por separado en los ajustes

Puede configurar unOhMyGPTUna pequeña cantidad de créditos GPT4 gratis al día, otra dirección para el acceso estable a la API KEY (para evitar la ocultación abusiva):

Otro proyecto gratuito de API KEY: https://github.com/chatanywhere/GPT_API_free

Dirección de NextChat desplegado (tenga cuidado de no introducir información sensible, introduzca su propia CLAVE de API se puede utilizar): https://chat.tchepai.com/

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...