Diffbot GraphRAG LLM: servicio de razonamiento LLM basado en datos externos de grafos de conocimiento en tiempo real.

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 58.2K 00

Introducción general

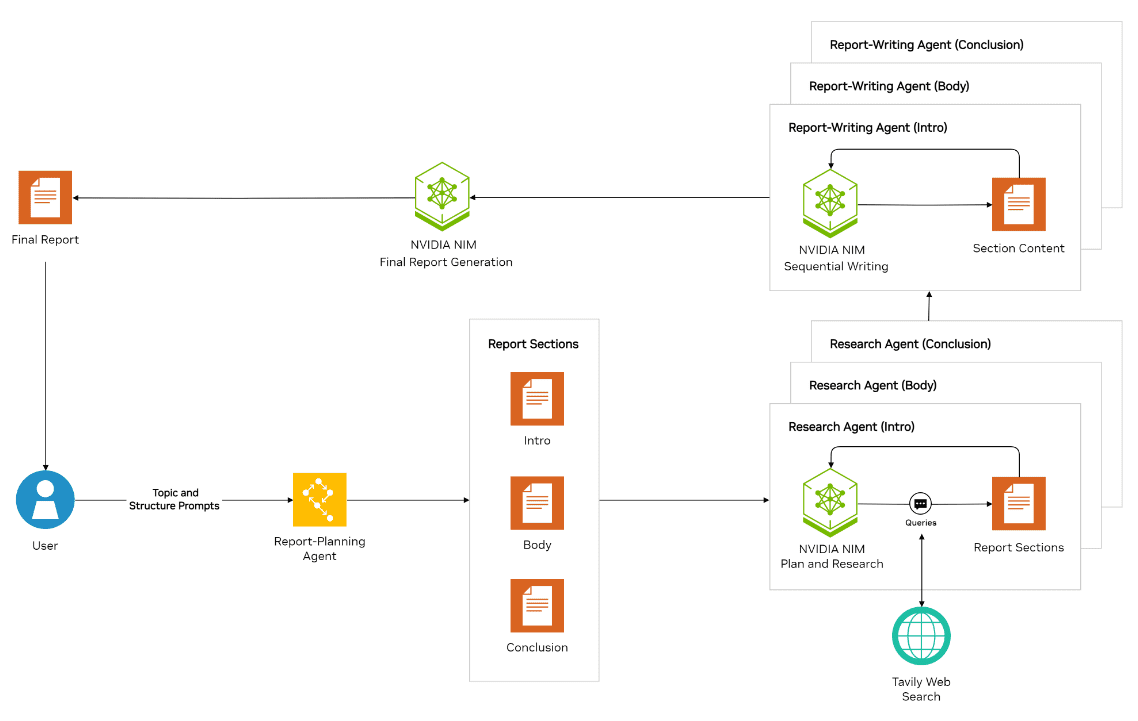

El servidor de razonamiento LLM de Diffbot es un innovador sistema de modelado lingüístico a gran escala con optimizaciones y mejoras especiales basadas en la arquitectura del modelo LLama. La característica más importante del proyecto es la integración deGráfico de conocimientos en tiempo real(Knowledge Graph) frente aBúsqueda Generación mejorada(RAG) para crear el exclusivo sistema GraphRAG. No sólo extrae y procesa información de la web en tiempo real, sino que también realiza una precisa citación de hechos y recuperación de conocimientos. El sistema ofrece dos versiones del modelo: un modelo de 8B parámetros basado en Llama 3.1 (diffbot-small) y un modelo de 70B parámetros basado en Llama 3.3 (diffbot-small-xl). En pruebas de referencia acreditadas, como MMLU-Pro, el sistema muestra un rendimiento excelente, especialmente en el procesamiento de datos en tiempo real, superando a los principales modelos, incluidos GPT-4 y ChatGPT. El proyecto es completamente de código abierto y admite el despliegue local y las llamadas a la API en la nube, lo que proporciona a los desarrolladores un uso flexible.

Experiencia: https://diffy.chat/

Lista de funciones

- Extracción y resumen en tiempo real del contenido de las URL de las páginas web

- Recuperación de hechos y citas precisas basadas en grafos de conocimiento

- Compatibilidad con el lenguaje de consulta Diffbot Knowledge Graph (DQL)

- Comprensión de imágenes y capacidad descriptiva

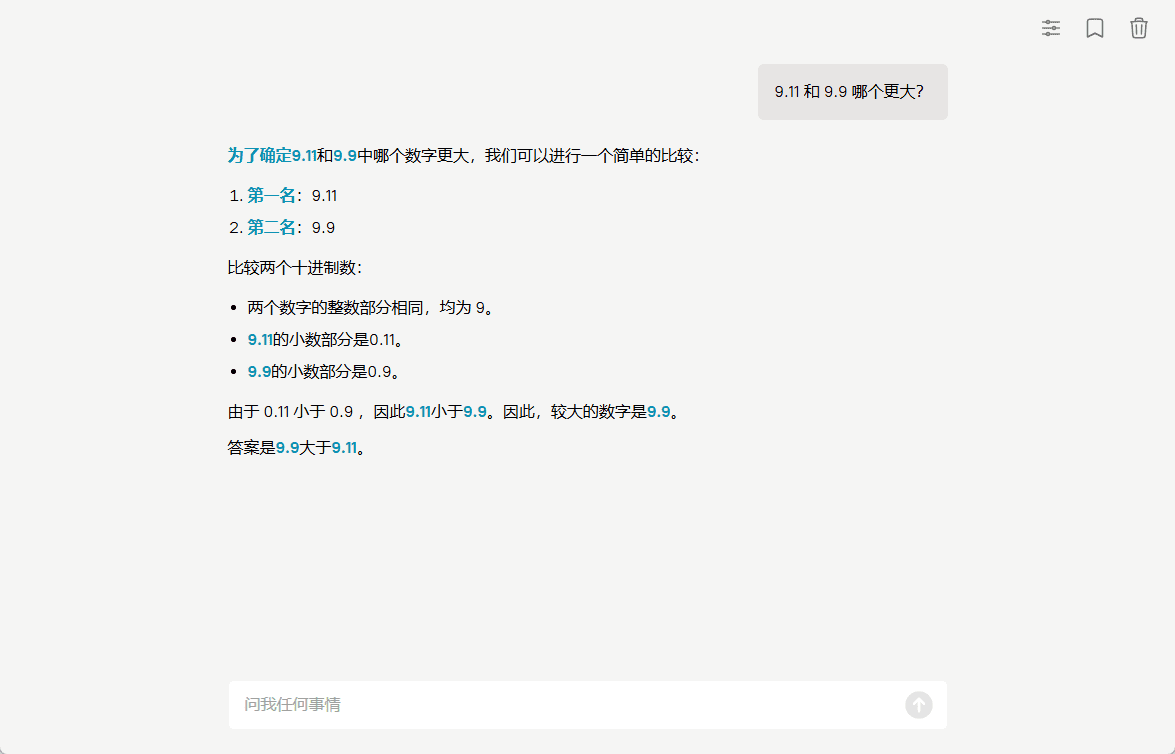

- Integración de funciones aritméticas del código del intérprete de JavaScript

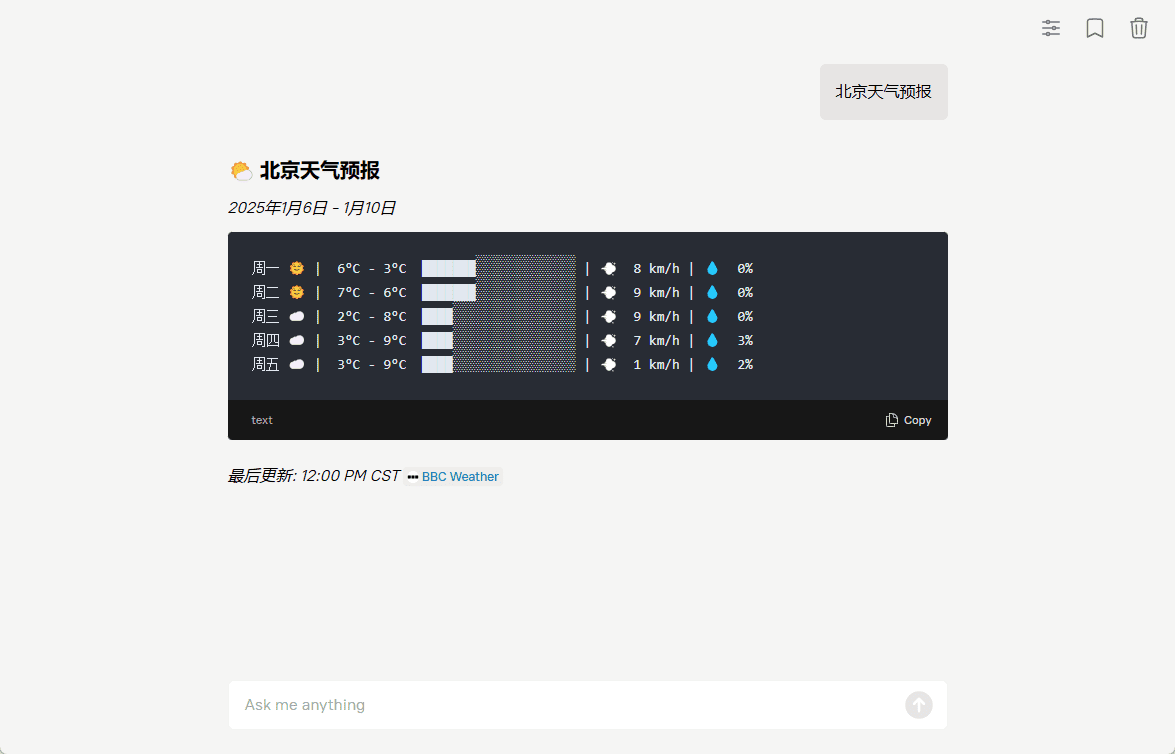

- Generación de previsiones meteorológicas ASCII Art

- Admite la implantación en contenedores Docker

- Proporcionar servicio de interfaz API REST

- Compatibilidad con extensiones de herramientas personalizadas

- Admite múltiples opciones de despliegue de configuración de hardware

Utilizar la ayuda

1. Opciones de implantación

El sistema ofrece dos formas de utilizarlo: despliegue local y llamadas a la API en la nube.

Proceso de implantación local:

- Requisitos de hardware confirmados:

- modelo diffbot-small: se requiere como mínimo una tarjeta gráfica Nvidia A100 40G

- modelo diffbot-small-xl: se requieren como mínimo 2 tarjetas gráficas Nvidia H100 80G (formato FP8)

- Pasos de despliegue de Docker:

# 1. 拉取Docker镜像

docker pull docker.io/diffbot/diffbot-llm-inference:latest

# 2. 运行Docker容器(模型会自动从HuggingFace下载)

docker run --runtime nvidia --gpus all -p 8001:8001 --ipc=host \

-e VLLM_OPTIONS="--model diffbot/Llama-3.1-Diffbot-Small-2412 --served-model-name diffbot-small --enable-prefix-caching" \

docker.io/diffbot/diffbot-llm-inference:latest

Llamadas a la API de la nube:

- Obtener credenciales de acceso:

- Visite https://app.diffbot.com/get-started para registrarse y obtener su código de desarrollador gratuito.

- Ejemplo de código Python:

from openai import OpenAI

client = OpenAI(

base_url = "https://llm.diffbot.com/rag/v1",

api_key = "你的diffbot_token"

)

# 创建对话请求

completion = client.chat.completions.create(

model="diffbot-xl-small",

temperature=0,

messages=[

{

"role": "user",

"content": "你的问题"

}

]

)

print(completion)

2. Descripción del uso de las funciones básicas

- Extracción de contenidos de páginas web:

- El sistema puede procesar cualquier URL web en tiempo real

- Extraiga automáticamente la información clave y genere resúmenes

- Mantener la integridad de la cita de la fuente original

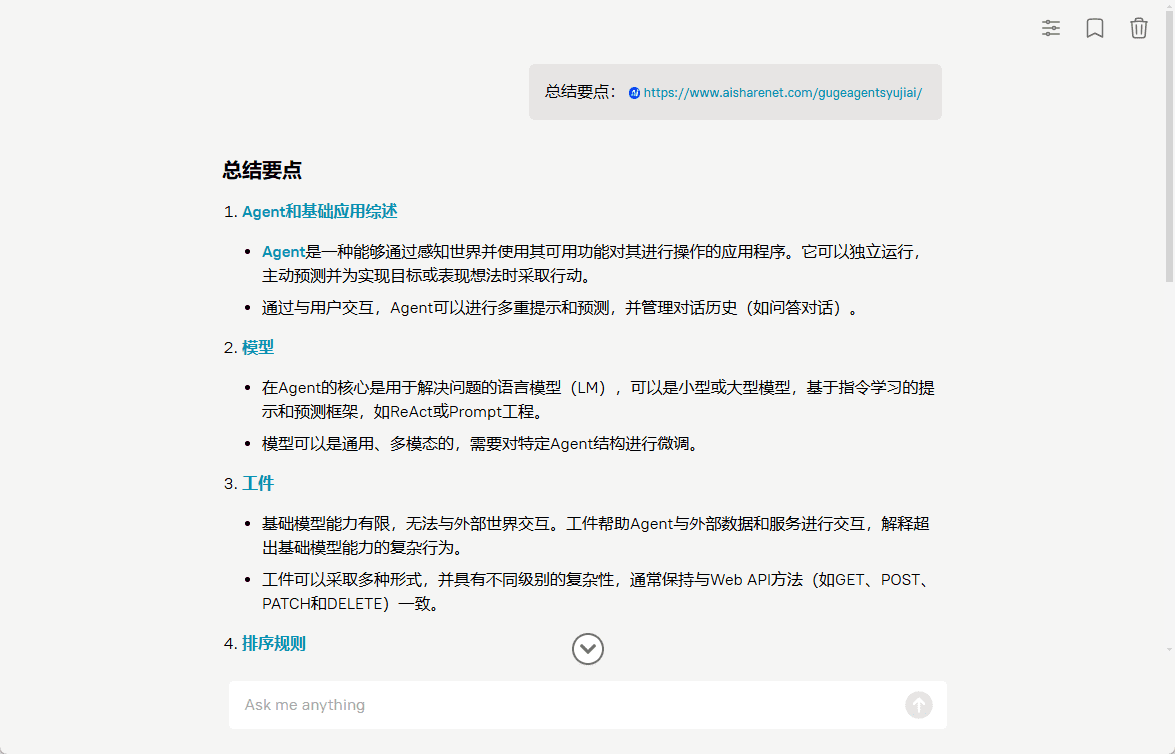

- Consulta de grafos de conocimiento:

- Búsqueda de precisión con Diffbot Query Language (DQL)

- Admite consultas complejas sobre relaciones de conocimiento

- Acceso a la base de conocimientos con actualizaciones en tiempo real

- Capacidad de procesamiento de imágenes:

- Apoyo a la comprensión y descripción de imágenes

- Puede combinarse con texto para generar análisis de imágenes relevantes

- Función de interpretación de códigos:

- Intérprete de JavaScript integrado

- Soporte para cálculos matemáticos en tiempo real

- Se puede procesar la lógica de programas sencillos

3. Extensiones de herramientas personalizadas

Para ampliar la nueva funcionalidad, consulte el documento add_tool_to_diffbot_llm_inference.md del proyecto y siga los pasos para añadir una herramienta personalizada.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...