DeepSeek incendia Ollama, ¿está a salvo su despliegue local? ¡Desconfíe de la aritmética "robada"!

Tutoriales prácticos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 84.4K 00

En los últimos años, la tecnología de modelización de grandes lenguajes (LLM) ha crecido a un ritmo sin precedentes y ha penetrado gradualmente en diversas industrias. Al mismo tiempo, también crece la demanda de despliegue local de LLM. ollama, como cómoda herramienta de despliegue local de grandes modelos, es bien conocida por su facilidad de uso y su capacidad de DeepSeek y otros modelos avanzados son los preferidos por desarrolladores y entusiastas de la tecnología.

Sin embargo, mientras se persigue la comodidad tecnológica, a menudo se pasan por alto fácilmente los riesgos de seguridad. Algunos usuarios despliegan localmente Ollama Tras la prestación del servicio, el puerto de servicio de Ollama puede quedar expuesto a Internet debido a una configuración incorrecta o a una escasa concienciación en materia de seguridad, lo que sienta las bases para posibles riesgos de seguridad. En este documento, analizaremos este riesgo de seguridad de principio a fin, y proporcionaremos las medidas preventivas correspondientes.

1. Conveniencia y riesgos potenciales de seguridad de Ollama

La llegada de Ollama ha reducido las barreras a la implantación local y el uso de grandes modelos lingüísticos, permitiendo a los usuarios ejecutar fácilmente modelos de alto rendimiento como DeepSeek en sus PC o servidores. Esta comodidad ha atraído a un gran número de usuarios, pero también ha creado un problema que no se puede ignorar:El servicio Ollama, en su configuración por defecto, puede correr el riesgo de acceso no autorizado por Internet.

En concreto, si un usuario despliega el servicio Ollama sin realizar las configuraciones de seguridad necesarias, como restringir las direcciones de escucha o establecer reglas de cortafuegos, el puerto 11434, en el que Ollama escucha por defecto, puede estar abierto al público. Esto significa que cualquier usuario de Internet puede acceder a su servicio Ollama a través de la red yEl uso gratuito de sus recursos informáticos puede incluso causar problemas de seguridad más graves.

2. ¿Cómo descubrir los servicios Ollama expuestos en Internet? -- Motor de búsqueda FOFA

Para comprender hasta qué punto están expuestos los servicios de Ollama en Internet, y el abanico de riesgos potenciales, necesitamos la ayuda de un buscador del ciberespacio.FOFA Es una herramienta muy potente que nos ayuda a recuperar y localizar rápidamente servicios web expuestos públicamente en todo el mundo.

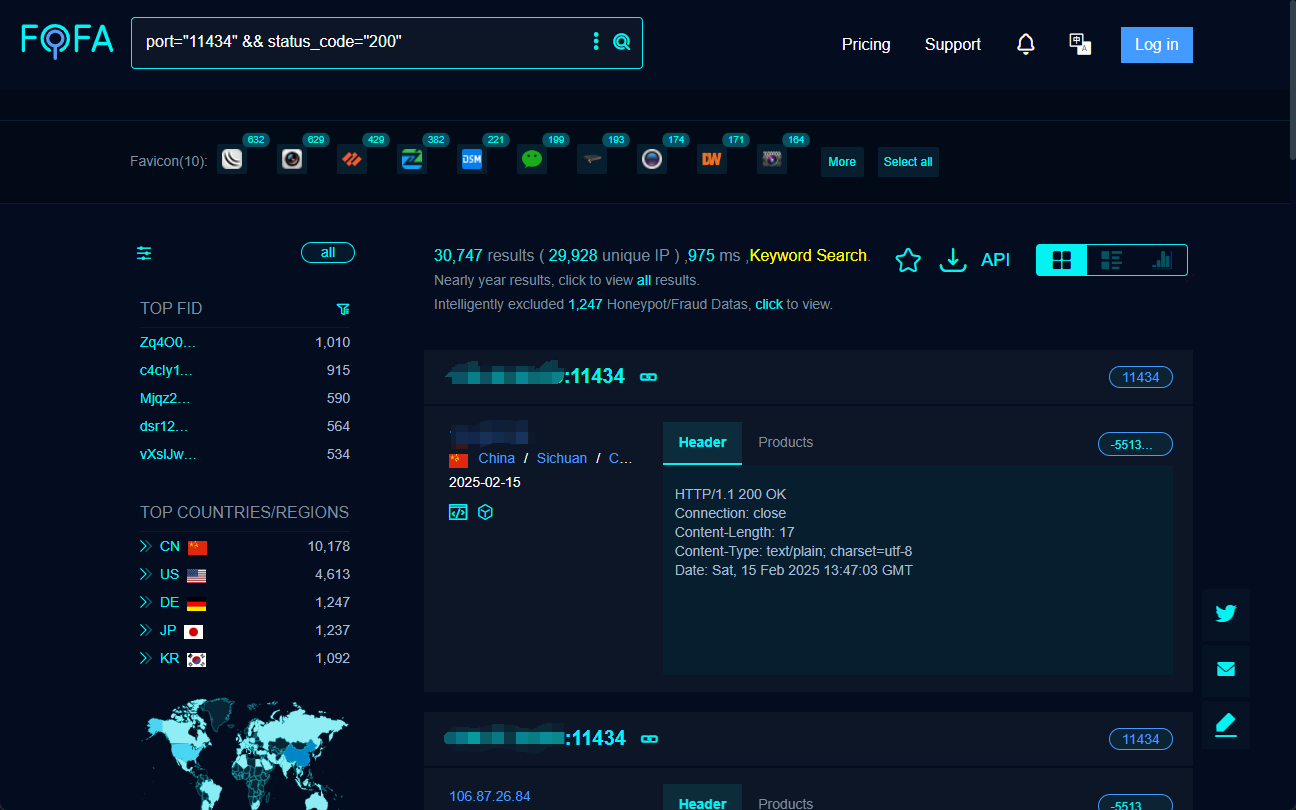

Construyendo cuidadosamente las sentencias de búsqueda FOFA, podemos encontrar eficazmente hosts que exponen puertos de servicio Ollama a Internet. Por ejemplo, la siguiente sentencia de búsqueda FOFA puede ser usada para encontrar objetivos con el puerto abierto 11434 y código de estado 200:

port="11434" && status_code="200"

Realizando la búsqueda anterior, FOFA lista direcciones IP objetivo cualificadas que probablemente estén ejecutando servicios Ollama abiertos al público.

3. ¿Cómo conectar y "putear" el servicio abierto Ollama? -- ChatBox y Cherry Studio

Una vez encontrada la interfaz abierta del servicio Ollama a través de FOFA, el siguiente paso es conectarse e interactuar con ella utilizando herramientas del lado del cliente.ChatBox responder cantando Estudio Cherry son dos programas cliente de IA de uso común, ambos soportan la conexión al servicio Ollama con llamadas a modelos y diálogo.

3.1 Utilizar ChatBox para conectarse al servicio Open Ollama

ChatBox Conocido por su sencillez y facilidad de uso, los pasos para conectarse al servicio Open Ollama son muy simples:

- Descargar e instalar el cliente ChatBox.

- Configure la dirección API: existe ChatBox configure la dirección API con la dirección IP y el puerto del servidor de destino, por ejemplo

http://目标IP:11434/. - Selecciona el modelo e inicia el diálogo: Una vez finalizada la configuración, puede seleccionar el modelo e iniciar un diálogo con el servicio remoto de Ollama.

3.2 Conexión al servicio Open Ollama con Cherry Studio

Estudio Cherry Es más completo y admite funciones avanzadas como la gestión de la base de conocimientos, además de las funciones de diálogo. Los pasos para conectarse son los siguientes:

- Descargar e instalar el cliente Cherry Studio.

- Configure la interfaz de Ollama: existe Estudio Cherry En "Configuración" → "Servicios de modelo" → "Ollama", establezca la dirección API en

http://目标IP:11434. - Añade y valida el modelo: Añade el modelo de destino en la página de gestión de modelos, como "deepseek-r1:1.5b", y prueba la conexión, y podrás utilizarlo tras el éxito.

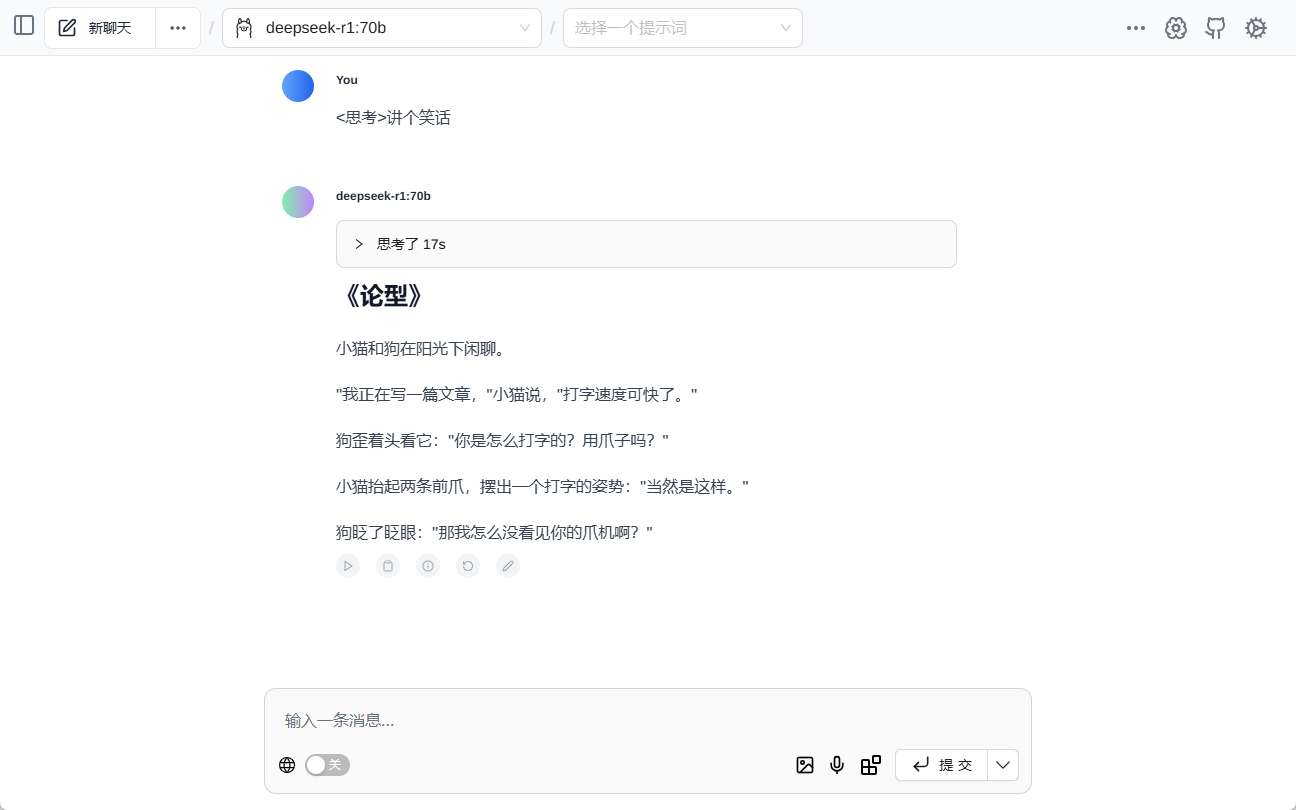

A través de clientes como ChatBox o Cherry Studio, los usuarios pueden conectarse fácilmente a los servicios de Ollama expuestos en Internet yUso gratuito y no autorizado de recursos informáticos y capacidades de modelización ajenos.

Después de obtener una dirección aleatoria, prueba el plugin web que soporta de forma nativa la lectura de modelos Ollama Ayuda de página Diálogo en el centro:

4. Riesgos de seguridad tras el "almuerzo gratis": robo de energía, fuga de datos y trampas legales

Detrás del aparente "almuerzo gratis", hay muchos riesgos de seguridad ocultos y posibles problemas legales:

- Robo aritmético (uso indebido de recursos). El riesgo más inmediato es que la potencia de cálculo de la GPU de un proveedor de servicios Ollama sea utilizada por otros sin compensación, lo que supone un desperdicio de recursos y una degradación del rendimiento. Los atacantes pueden utilizar scripts automatizados para escanear en masa y conectarse a servicios Ollama abiertos, convirtiendo sus GPU en "talleres clandestinos" para entrenar modelos maliciosos.

- Filtración de datos. Si se almacenan o procesan datos sensibles en el servicio Ollama, existe el riesgo de fuga de estos datos en un entorno de red abierto. Los registros de diálogo de los usuarios, los datos de formación, etc. podrían transmitirse a través de canales no cifrados y ser objeto de escuchas malintencionadas o robos.

- Modelos en venta. Los archivos de modelos sin cifrar se descargan y copian fácilmente, y si en los servicios de Ollama se utilizan modelos de gran tamaño de industrias con valor comercial, existe el riesgo de que los modelos sean robados y vendidos, lo que provocaría importantes pérdidas económicas.

- Intrusión en el sistema. El propio servicio Ollama puede tener una vulnerabilidad de seguridad que, si es explotada por un hacker, podría conducir a la ejecución remota de código, permitiendo a un atacante tomar el control total del servidor de una víctima, convirtiéndolo encambiar aParte de una botnet utilizada para lanzar ciberataques a mayor escala.

- Riesgos jurídicos. El acceso y el uso no autorizados de los servicios Ollama de otras personas, o incluso el uso malintencionado de los mismos, pueden violar las leyes y reglamentos pertinentes y enfrentarse a responsabilidades legales.

5. ¿Son más seguros los usuarios chinos? -- La IP dinámica no es una barrera absoluta

Se ha argumentado que "los usuarios chinos están relativamente a salvo de este riesgo de 'blanqueo' debido a sus escasas tenencias independientes de PI". Esta opinión es algo parcial.

Es cierto que un mayor porcentaje de usuarios chinos de banda ancha doméstica utilizan IP dinámicas en comparación con los países occidentales, lo que reduce en cierta medida el riesgo de exposición. La incertidumbre de las IP dinámicas dificulta a los atacantes el seguimiento y la localización de usuarios concretos a lo largo del tiempo.

Pero esto no significa en absoluto que los usuarios chinos puedan estar tranquilos. En primer lugar, todavía hay un gran número de servidores Ollama en el entorno chino de Internet, incluidos muchos con IP fijas. En segundo lugar, incluso las IP dinámicas pueden permanecer inalteradas durante un cierto periodo de tiempo, y aún es posible que un atacante lleve a cabo un ataque durante la ventana en la que la dirección IP no se ha modificado. Y lo que es más importante.La seguridad no puede dejarse en manos de la "suerte" o de las "barreras naturales", sino que debe basarse en medidas de seguridad proactivas.

6. Directrices de seguridad del servicio local de Ollama: evitar convertirse en un "parrillero"

Con el fin de proteger los servicios Ollama desplegados localmente del uso indebido por parte de terceros, los usuarios deben adoptar medidas de seguridad proactivas y eficaces. A continuación se ofrecen algunas directrices para usuarios principiantes:

6.1 Restricción de las direcciones de escucha del servicio Ollama

Cambiar la dirección de escucha del servicio Ollama de la predeterminada 0.0.0.0 modificar para 127.0.0.1No pasa nada.Obliga al servicio Ollama a escuchar sólo las peticiones de la máquina local y denegar el acceso directo desde redes externas. Los pasos son los siguientes:

- Encuentra el archivo de configuración: Los archivos de configuración de Ollama se encuentran normalmente en el directorio

/etc/ollama/config.conf.. Abra el archivo (o créelo si no existe), busque o añada el campobind_addressElemento de configuración. - Modificar la dirección de enlace: comandante en jefe (militar)

bind_addressse establece en el valor de127.0.0.1y garantizar queportajustado a11434. A continuación se muestra un ejemplo de configuración completa:bind_address = 127.0.0.1 port = 11434 - Guarde y reinicie el servicio: Después de guardar el archivo de configuración, ejecute el comando

sudo systemctl restart ollamapara reiniciar el servicio Ollama para que la configuración surta efecto.

6.2 Configuración de reglas de cortafuegos

Mediante la configuración de reglas de cortafuegos, puedeControl preciso del rango de direcciones IP y puertos autorizados para acceder al servicio Ollama. Por ejemplo, puede permitir que sólo las direcciones IP de su LAN accedan al puerto 11434 y bloquear todas las solicitudes de acceso procedentes de la red pública. A continuación se describe cómo configurar el cortafuegos en entornos Windows y Linux respectivamente:

Pasos de configuración del entorno Windows:

- Active la seguridad avanzada Firewall de Windows Defender: En "Panel de control", busque "Sistema y seguridad", haga clic en "Firewall de Windows Defender" y, a continuación, seleccione "Configuración avanzada". Configuración avanzada".

- Crear una nueva regla de entrada: En "Reglas de entrada", haga clic en "Nueva regla...", seleccione el tipo de regla "Puerto" y haga clic en "Siguiente". Siguiente".

- Especifica el puerto y el protocolo: El protocolo se selecciona como "TCP" y el puerto local específico se establece en

11434Haga clic en "Siguiente". - Seleccione la operación: Seleccione "Permitir conexión" y haga clic en "Siguiente".

- Configure el ámbito de aplicación (opcional): Puede configurar los ámbitos de las reglas según sea necesario; por lo general, mantenga la configuración predeterminada y haga clic en Siguiente.

- Especifique el nombre y la descripción: Asigne un nombre fácilmente reconocible a la regla (por ejemplo, "Ollama Service Port Restriction"), añada una descripción (opcional) y haga clic en "Finalizar" para completar la creación de la regla.

Entorno Linux (firewall ufw por ejemplo) Pasos de configuración:

- Activar el cortafuegos ufw: Si ufw aún no está activado, ejecute lo siguiente en el terminal

sudo ufw enablepara activar el cortafuegos. - Permitir el acceso a la LAN: llevar a cabo

sudo ufw allow from 192.168.1.0/24 to any port 11434que permite192.168.1.0/24La dirección IP del segmento LAN accede al puerto 11434. Modifique el intervalo de direcciones IP en función del segmento LAN real. - Denegar otro acceso (opcional): Si la política por defecto es permitir todos los accesos externos, puede ejecutar el comando

sudo ufw deny 11434para denegar el acceso al puerto 11434 a las direcciones IP de todos los demás orígenes. - Ver el estado del cortafuegos: llevar a cabo

sudo ufw status verbosepara comprobar el estado de la regla del cortafuegos y confirmar que la configuración ha surtido efecto.

6.3 Activar la autenticación y el control de acceso

En caso de que necesite proporcionar servicios Ollama externamente, asegúrese de queHabilitación de mecanismos de autenticación. para evitar accesos no autorizados. A continuación se indican algunos métodos de autenticación habituales:

- Autenticación básica HTTP: La autenticación básica HTTP puede configurarse a través de un servidor web como Apache o Nginx. Este método es simple y fácil de usar, pero la seguridad es relativamente baja, adecuada para escenarios que no requieren alta seguridad. Una vez configurada la autenticación básica, los usuarios deben proporcionar su nombre de usuario y contraseña cuando accedan a los servicios de Ollama.

- Clave API: Añadir un mecanismo de verificación de la clave API al front-end del servicio Ollama. Cuando un cliente solicita un servicio de Ollama, debe incluir una clave de API predefinida en la cabecera o en los parámetros de la solicitud. El servidor verifica la validez de la clave y sólo se procesan las solicitudes con la clave correcta. Este enfoque es más seguro que la autenticación básica y es fácil de integrar en las aplicaciones.

- Mecanismos de autorización de autenticación más avanzados, como OAuth 2.0: Para escenarios con mayores requisitos de seguridad, pueden considerarse marcos de autenticación y autorización más complejos, como OAuth 2.0. OAuth 2.0 proporciona un proceso de autorización y autenticación perfecto, admite múltiples modos de autorización y puede lograr un control de acceso de grano fino. Sin embargo, la configuración e integración de OAuth 2.0 es relativamente compleja y requiere un cierto esfuerzo de desarrollo.

La elección del método de autenticación debe basarse en una combinación de factores como los escenarios de aplicación, los requisitos de seguridad y el coste de la implementación técnica del servicio Ollama.

6.4 Utilizar un proxy inverso

Utilizando un servidor proxy inverso (como Nginx) puedeActúa como un front-end para el servicio Ollama, ocultando la dirección IP y el puerto reales del servicio Ollama y proporcionando funciones de seguridad adicionales.Por ejemplo:

- Ocultar el servidor back-end: El servidor proxy inverso actúa como "fachada" del servicio Ollama. Los usuarios externos sólo pueden ver la dirección IP del servidor proxy inverso y no pueden acceder directamente al servidor real donde se encuentra el servicio Ollama, lo que mejora la seguridad.

- Equilibrio de carga: Si el servicio Ollama se despliega en múltiples servidores, el servidor proxy inverso puede implementar el balanceo de carga para distribuir las peticiones de los usuarios a diferentes servidores, mejorando la disponibilidad y el rendimiento del servicio.

- Cifrado SSL/TLS: Los servidores proxy inversos pueden configurarse con certificados SSL/TLS para permitir el acceso cifrado HTTPS y proteger la seguridad de la transmisión de datos.

- Cortafuegos de aplicaciones web (WAF): Algunos servidores proxy inversos integran la funcionalidad WAF para detectar y defenderse de los ataques web más comunes, como la inyección SQL, los ataques de secuencias de comandos en sitios cruzados (XSS), etc., mejorando aún más la seguridad del servicio Ollama.

- Control de acceso: Los servidores proxy inversos pueden configurarse con políticas de control de acceso más flexibles, como el control de acceso basado en la dirección IP, la identidad del usuario, el contenido de la solicitud, etc.

7. Conclusión: concienciación y responsabilidad en materia de seguridad en acción

La popularidad de herramientas de big model desplegadas localmente, como Ollama, ha facilitado la innovación tecnológica y las aplicaciones, pero también ha planteado nuevos retos a la ciberseguridad. El servicio Ollama, expuesto en Internet como "de uso gratuito", puede parecer tentador, pero conlleva riesgos ocultos. Este tipo de comportamiento no sólo puede infringir las leyes y normativas y la ciberetica, sino que también puede suponer una amenaza para su propia ciberseguridad y la de los demás.

Para los implantadores de servicios Ollama, concienciar sobre la seguridad y tomar las medidas de seguridad necesarias es la responsabilidad de proteger sus propios recursos informáticos y la seguridad de los datos, así como de mantener un entorno de red saludable. No convierta sus servidores en "parrillas aritméticas" ni se convierta en cómplice de ciberataques por una negligencia momentánea.

Mientras disfrutan de los dividendos de la tecnología, todos los usuarios de Internet deben estar siempre alerta, establecer una visión correcta de la seguridad de la red y colaborar para construir un ecosistema de aplicaciones de IA seguro, fiable y sostenible.

ALERTA DE RIESGO DE NUEVO: ¡Revise y refuerce su servicio Ollama inmediatamente! ¡La seguridad no es un asunto menor!

La popularidad del modelo DeepSeek y de la herramienta Ollama es sin duda el epítome del desarrollo de la tecnología de IA. Sin embargo, la seguridad es siempre la piedra angular del avance tecnológico que no se puede ignorar. Por favor, usuarios de OllamaRevise inmediatamente la configuración de su despliegue local, evalúe los posibles riesgos de seguridad y adopte las medidas de refuerzo necesarias. No es demasiado tarde para reparar el daño.

Aquellos que aún no hayan instalado Ollama o estén pensando en instalarlo, asegúrense también deReconozca plenamente los riesgos para la seguridad que entraña el despliegue local de herramientas de grandes modelos, evalúe con prudencia sus propias capacidades técnicas y su nivel de protección de la seguridad, y utilícelas adecuadamente bajo la premisa de garantizar la seguridad. Recuerde que la ciberseguridad es responsabilidad de todos, y prevenirla antes de que ocurra es la mejor estrategia.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...