CogVLM2: modelo multimodal de código abierto para la comprensión de vídeos y rondas múltiples de diálogo

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 64.4K 00

Introducción general

CogVLM2 es un modelo multimodal de código abierto desarrollado por el Grupo de Investigación de Minería de Datos de la Universidad de Tsinghua (THUDM), basado en la arquitectura Llama3-8B y diseñado para ofrecer un rendimiento comparable o incluso superior al de GPT-4V. El modelo admite la comprensión de imágenes, el diálogo en varias rondas y la comprensión de vídeo, y es capaz de procesar contenidos de hasta 8K de longitud y admitir resoluciones de imagen de hasta 1344x1344. La familia CogVLM2 consta de varios submodelos optimizados para distintas tareas, como preguntas y respuestas de texto, preguntas y respuestas de documentos y preguntas y respuestas de vídeo. Los modelos no sólo son bilingües, sino que también ofrecen diversas experiencias en línea y métodos de despliegue para que los usuarios los prueben y apliquen.

Información relacionada:¿Cuánto tiempo de vídeo puede entender un modelo grande? Smart Spectrum GLM-4V-Plus: 2 horas

Lista de funciones

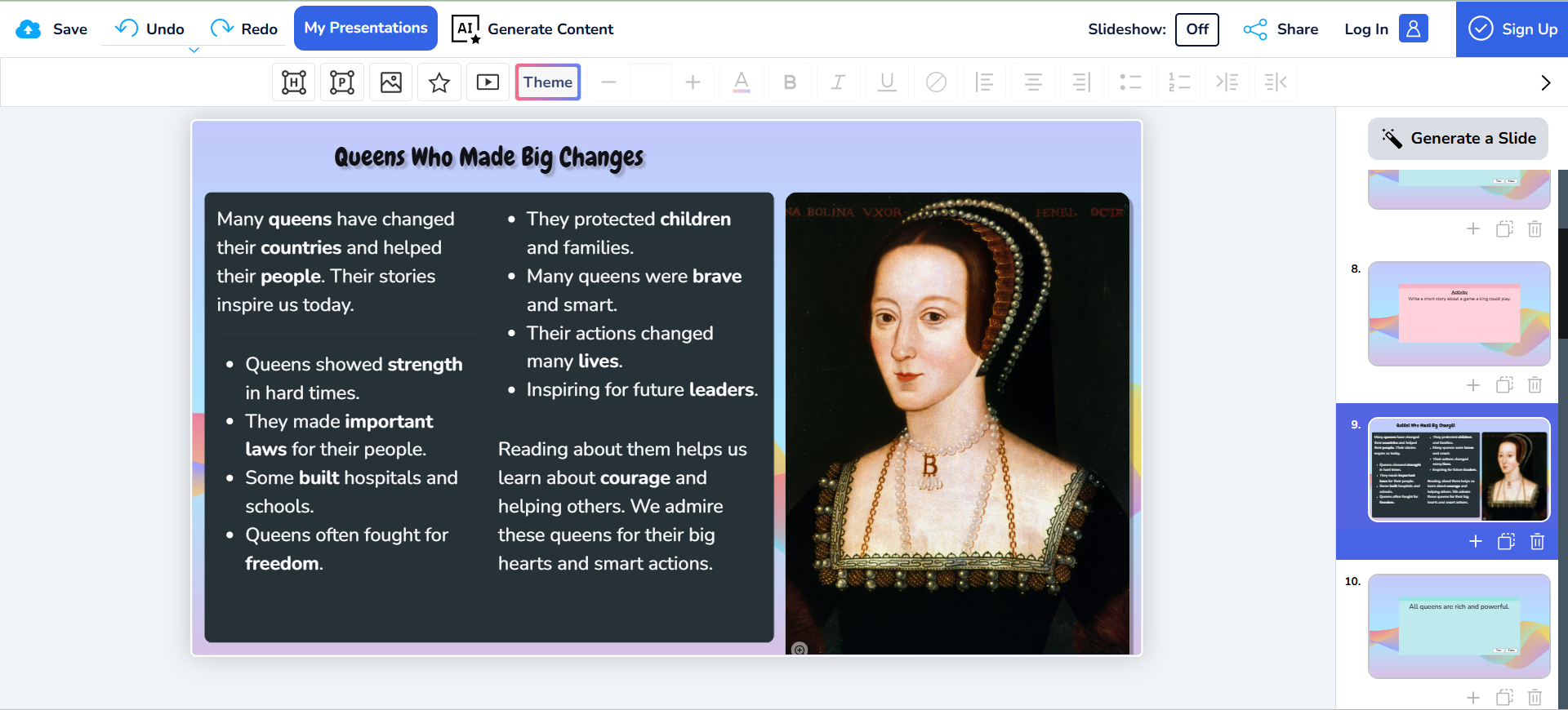

- comprensión gráfica: Favorece la comprensión y el tratamiento de imágenes de alta resolución.

- diálogo a varias bandas: Capaz de múltiples rondas de diálogo, adecuado para escenarios de interacción complejos.

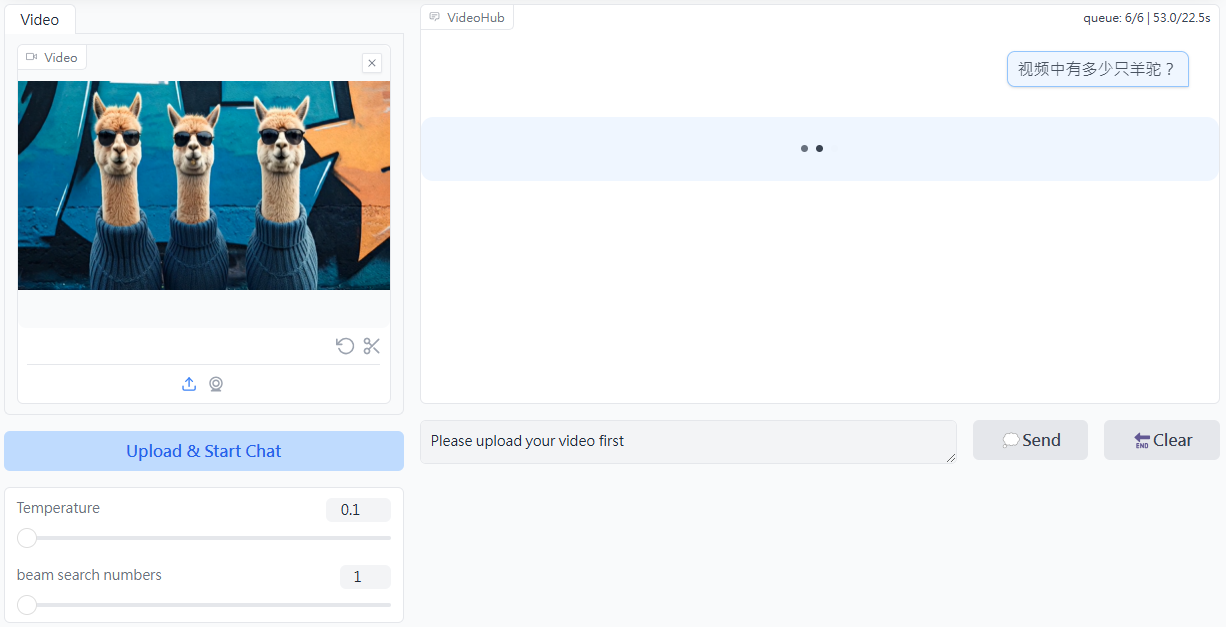

- Comprensión del vídeo: Admite la comprensión de contenidos de vídeo de hasta 1 minuto de duración mediante la extracción de fotogramas clave.

- Soporte multilingüe: Apoyar el bilingüismo chino e inglés para adaptarse a distintos entornos lingüísticos.

- código abierto (informática)Se proporciona el código fuente completo y los pesos del modelo para facilitar el desarrollo secundario.

- Experiencia en línea: Ofrece una plataforma de demostración en línea en la que los usuarios pueden experimentar directamente la funcionalidad del modelo.

- Múltiples opciones de despliegueCompatible con Huggingface, ModelScope y otras plataformas.

Utilizar la ayuda

Instalación y despliegue

- almacén de clones::

git clone https://github.com/THUDM/CogVLM2.git

cd CogVLM2

- Instalación de dependencias::

pip install -r requirements.txt

- Descargar modelos de pesosDescarga los pesos de modelo adecuados y colócalos en el directorio especificado.

ejemplo de uso

comprensión gráfica

- Modelos de carga::

from cogvlm2 import CogVLM2

model = CogVLM2.load('path_to_model_weights')

- imagen de proceso::

image = load_image('path_to_image')

result = model.predict(image)

print(result)

diálogo a varias bandas

- Iniciar el diálogo::

conversation = model.start_conversation()

- mantener un diálogo::

response = conversation.ask('你的问题')

print(response)

Comprensión del vídeo

- Cargar vídeo::

video = load_video('path_to_video')

result = model.predict(video)

print(result)

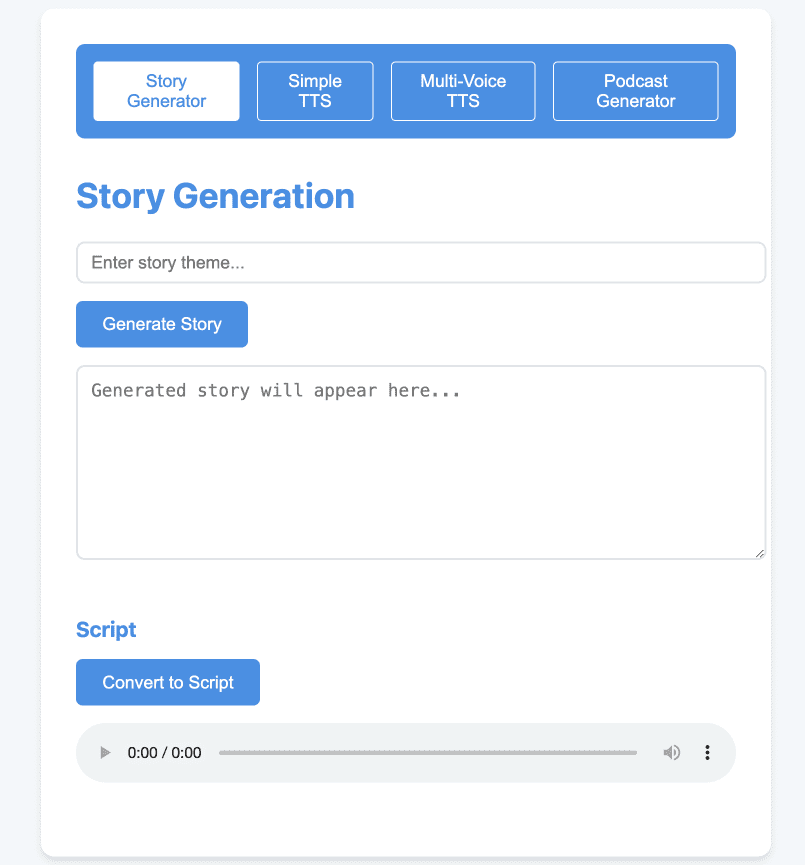

Experiencia en línea

Los usuarios pueden acceder a la plataforma de demostración en línea de CogVLM2 para experimentar la funcionalidad del modelo en línea sin necesidad de implantación local.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...