CogAgent: modelo de lenguaje visual inteligente de código abierto de Smart Spectrum para la automatización de interfaces gráficas

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 65.3K 00

Introducción general

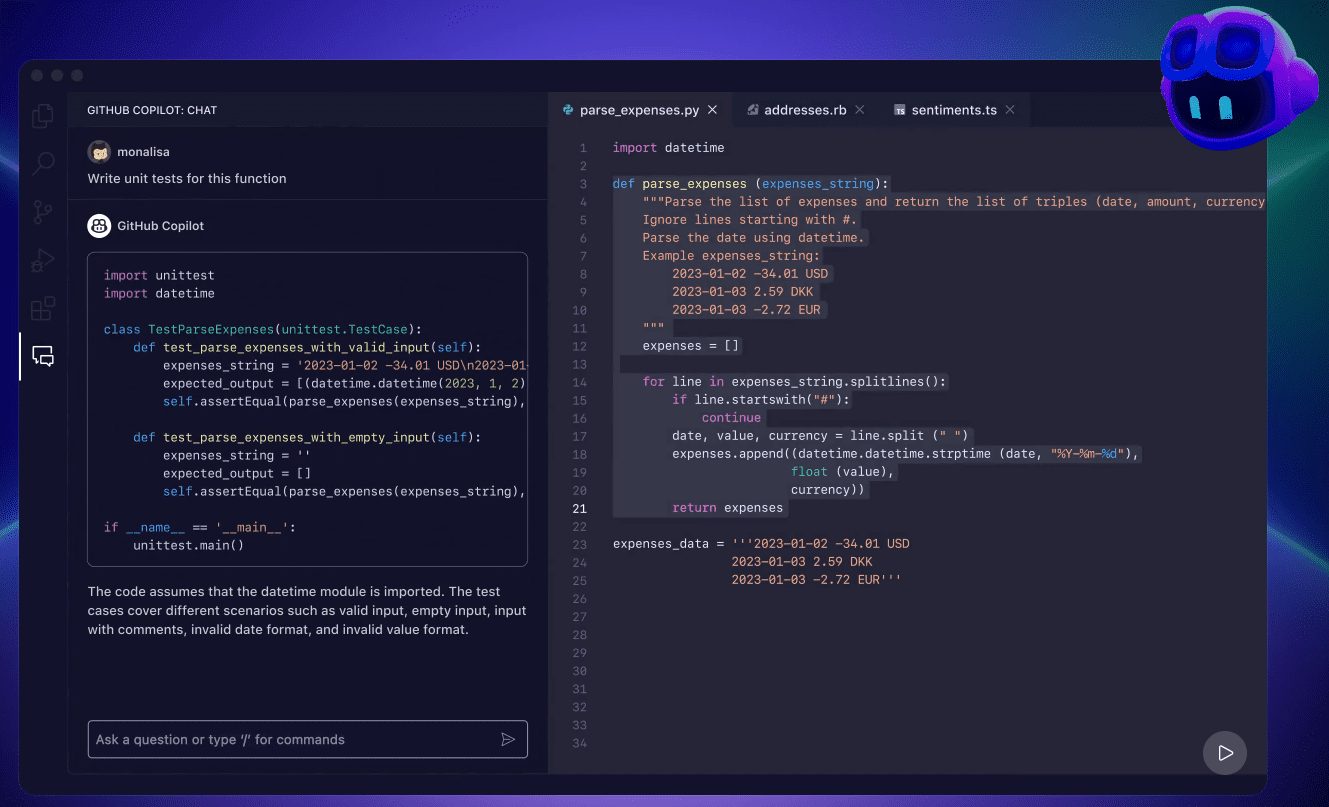

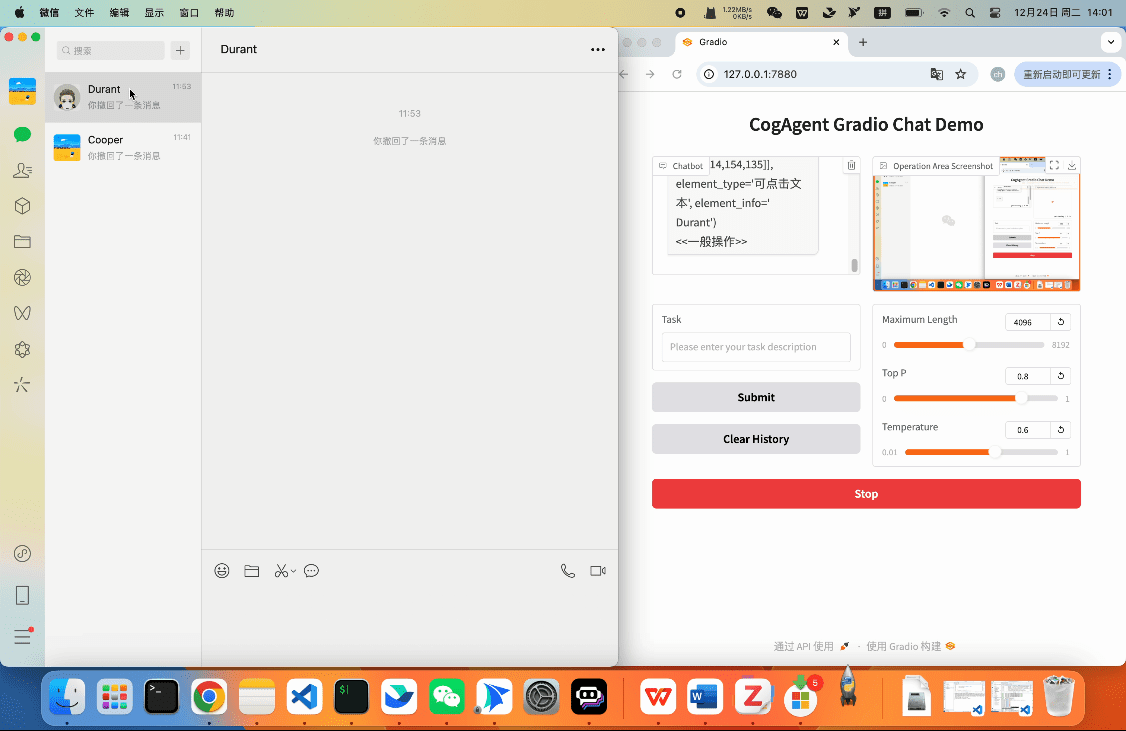

CogAgent es un modelo de lenguaje visual de código abierto desarrollado por el Grupo de Investigación de Minería de Datos de la Universidad de Tsinghua (THUDM), cuyo objetivo es automatizar operaciones de interfaz gráfica de usuario (GUI) multiplataforma. El modelo se basa en CogVLM (GLM-4V-9B), admite interacciones bilingües en inglés y chino, y es capaz de ejecutar tareas a través de capturas de pantalla y lenguaje natural.CogAgent ha logrado un rendimiento líder en tareas de GUI en múltiples plataformas y categorías, y es adecuado para una amplia gama de dispositivos informáticos como Windows, macOS y Android. Su última versión, CogAgent-9B-20241220, ofrece mejoras significativas en la percepción de la interfaz gráfica de usuario, la precisión del razonamiento, la exhaustividad del espacio de operaciones y la generalizabilidad de las tareas.

CogAgent-9B-20241220El modelo se basa en GLM-4V-9B, un modelo base VLM bilingüe de código abierto. Mediante la recopilación y optimización de datos, el entrenamiento en varias fases y la mejora de estrategias, elCogAgent-9B-20241220Se han logrado avances significativos en la percepción de la interfaz gráfica de usuario, la precisión de la predicción de inferencia, la exhaustividad del espacio de acción y la capacidad de generalización entre tareas. El modelo admite la interacción bilingüe (chino e inglés), incluidas las capturas de pantalla y la entrada verbal. Esta versión del modelo CogAgent se ha utilizado en el producto GLM-PC de Smart Spectrum AI.

Lista de funciones

- Comprensión y procesamiento de imágenes de alta resolución (admite resolución 1120x1120)

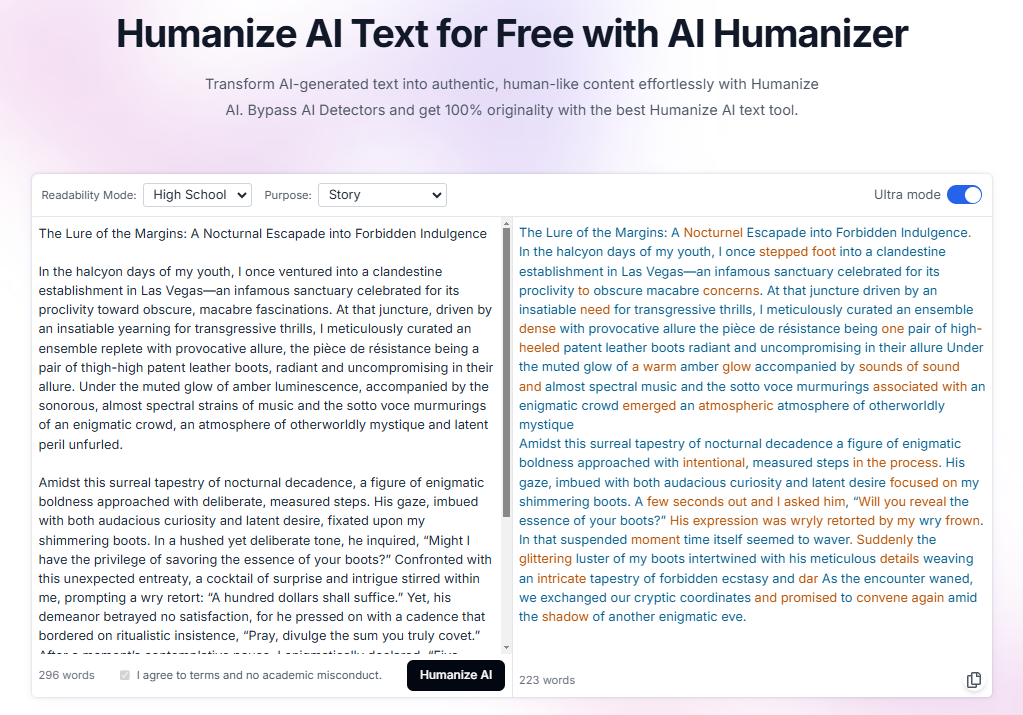

- Capacidad de automatización de la interfaz gráfica de usuario

- Interfaz de interacción compatible con todas las plataformas

- Procesamiento de tareas de preguntas y respuestas visuales (VQA)

- Comprensión y análisis de gráficos (ChartQA)

- Preguntas y respuestas visuales sobre documentos (DocVQA)

- Preguntas y respuestas visuales sobre la información (InfoVQA)

- Comprensión de textos escénicos (ST-VQA)

- Cuestionario visual de conocimientos generales (OK-VQA)

Utilizar la ayuda

1. Configuración medioambiental

1.1 Requisitos básicos:

- Python 3.8 o superior

- Dispositivos GPU compatibles con CUDA

- Espacio de memoria de vídeo suficiente (se recomiendan al menos 16 GB)

1.2 Pasos de la instalación:

# 克隆项目仓库

git clone https://github.com/THUDM/CogAgent.git

cd CogAgent

# 安装依赖

pip install -r requirements.txt

2. Carga y uso del modelo

2.1 Descarga de modelos:

- Descargar el archivo de pesos del modelo de la plataforma Hugging Face

- Se admiten dos versiones: cogagent-18b y cogagent-9b.

2.2 Proceso básico de utilización:

from cogagent import CogAgentModel

# 初始化模型

model = CogAgentModel.from_pretrained("THUDM/CogAgent")

# 加载图像

image_path = "path/to/your/image.jpg"

response = model.process_image(image_path)

# 执行GUI操作

gui_command = model.generate_gui_command(image_path, task_description)

model.execute_command(gui_command)

3. Descripción del uso de las funciones principales

3.1 Función de comprensión de imágenes:

- Admite entradas de múltiples formatos de imagen

- Maneja imágenes de hasta 1120x1120 de resolución

- Proporciona una descripción y un análisis detallados del contenido de las imágenes

3.2 Automatización de la interfaz gráfica de usuario:

- Soporte para reconocer elementos de la interfaz

- Realiza operaciones de clic, arrastrar y soltar, introducción de datos y otras.

- Proporcionar mecanismos de validación de operaciones y tratamiento de errores

3.3 Función visual de pregunta y respuesta:

- Soporte para preguntas en lenguaje natural

- Dar respuestas detalladas sobre la imagen

- Puede enfrentarse a problemas de razonamiento complejos

4. Recomendaciones para optimizar el rendimiento

4.1 Gestión de la memoria:

- Utilice el tamaño de lote adecuado

- Limpiar oportunamente las instancias de modelo no utilizadas

- Control del número de tareas de procesamiento simultáneas

4.2 Optimización de la velocidad de razonamiento:

- Inferencia acelerada con precisión FP16

- Permitir la cuantificación de modelos para reducir el uso de recursos

- Optimización del proceso de preprocesamiento de imágenes

5. Resolución de problemas comunes

5.1 Problemas de memoria:

- Comprobación del uso de la memoria de vídeo

- Redimensionar los lotes adecuadamente

- Utilización de la técnica del punto de control de gradiente

5.2 Problemas de precisión:

- Garantizar la calidad de la imagen de entrada

- Ajuste de la configuración de los parámetros del modelo

- Verificar que los pasos de preprocesamiento son correctos

Funciones principales

- funcionamiento en un solo paso: Realiza acciones de un solo paso, como abrir una aplicación, pulsar un botón, etc., mediante sencillos comandos de lenguaje natural.

- operación multipaso: Da soporte a tareas operativas complejas de varios pasos y a flujos de trabajo automatizados mediante instrucciones secuenciales.

- Grabación y reproducción de tareas: Registra el historial de operaciones del usuario y admite la función de reproducción para depuración y optimización.

- tratamiento de erroresMecanismo de gestión de errores integrado que identifica y gestiona los errores operativos más comunes para garantizar la finalización de las tareas sin problemas.

Funciones destacadas

- Razonamiento eficienteEl modelo BF16 requiere al menos 29 GB de memoria en la GPU, por lo que se recomienda una GPU A100 o H100.

- Despliegue flexible: Admite la implantación en una amplia gama de plataformas de hardware, incluidas HuggingFace, ModelScope y WiseModel.

- Apoyo comunitario: Una comunidad activa de código abierto que ofrece soporte técnico y respuestas a preguntas para ayudar a los desarrolladores a empezar rápidamente.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Puestos relacionados

Sin comentarios...