BrowserAI: ejecución local de modelos de IA en el navegador con WebGPUs

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 70.6K 00

Introducción general

BrowserAI es una herramienta de código abierto que permite a los usuarios ejecutar modelos nativos de IA directamente en el navegador. Desarrollada por el equipo Cloud-Code-AI, es compatible con modelos lingüísticos como Llama, DeepSeek y Kokoro. Los usuarios pueden realizar tareas como la generación de texto, el reconocimiento de voz y la conversión de texto a voz a través del navegador sin necesidad de un servidor o una configuración compleja. Utiliza la tecnología WebGPU para acelerar el cálculo y todos los datos se procesan localmente para proteger la privacidad. BrowserAI es sencillo y fácil de usar, por lo que los desarrolladores pueden utilizarlo para crear aplicaciones de IA, y los usuarios normales también pueden experimentar las funciones de IA. El proyecto es gratuito y está abierto en GitHub, por lo que cualquiera puede descargar el código y utilizarlo o mejorarlo.

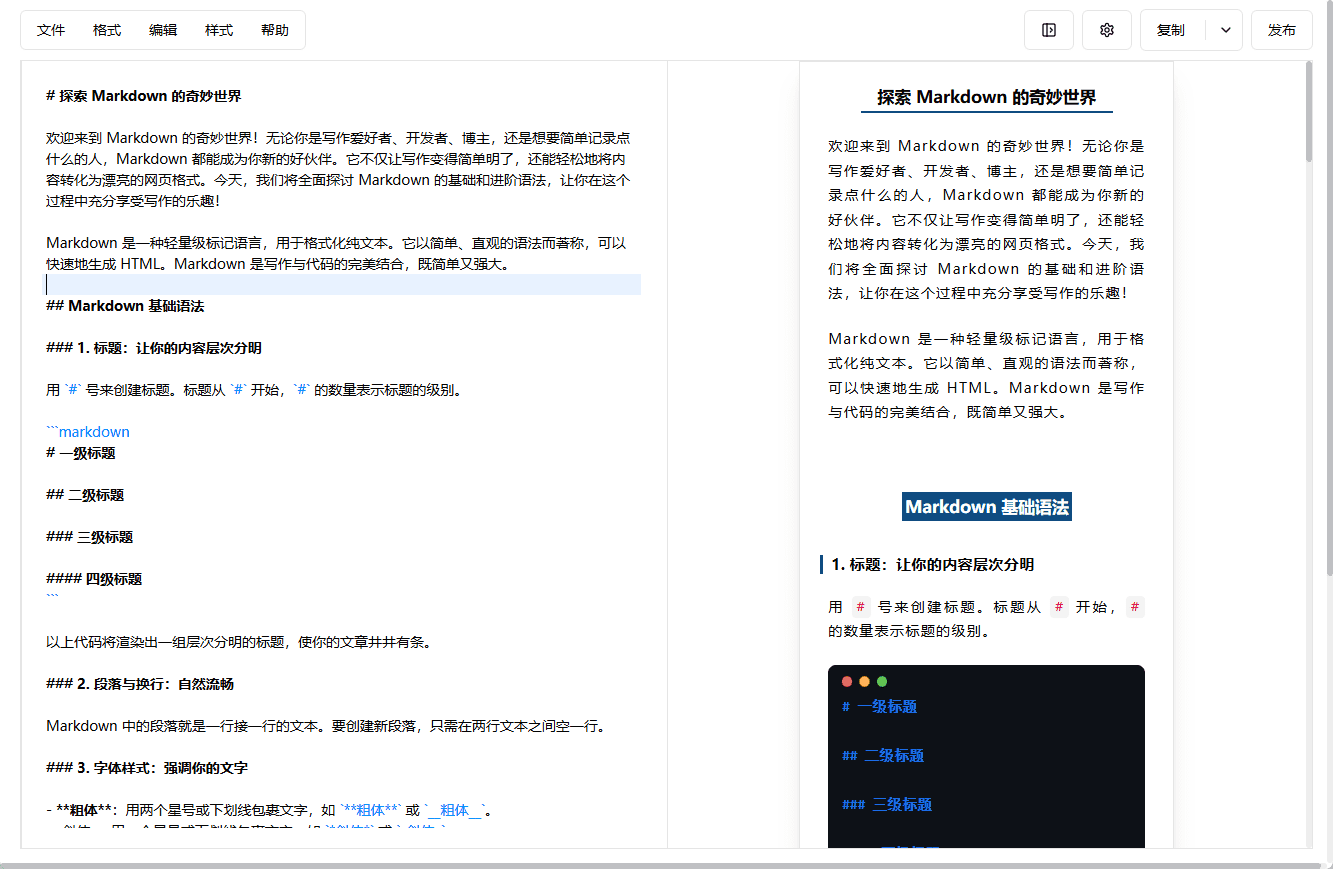

Diálogo de texto de BrowserAI

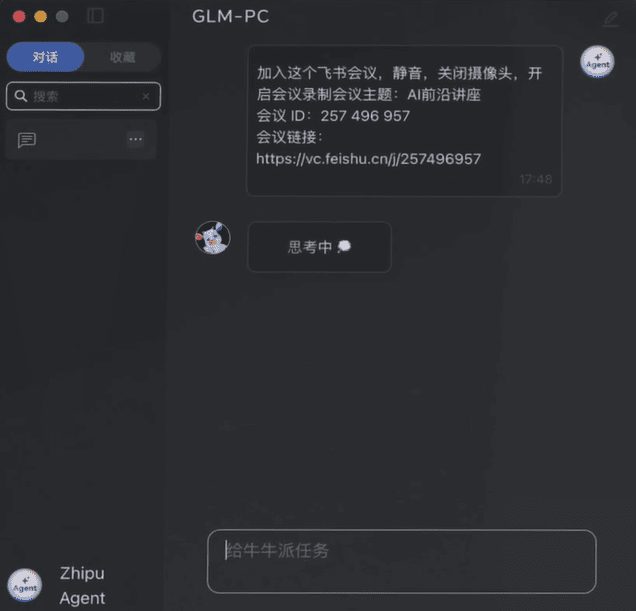

Diálogo de voz BrowserAI

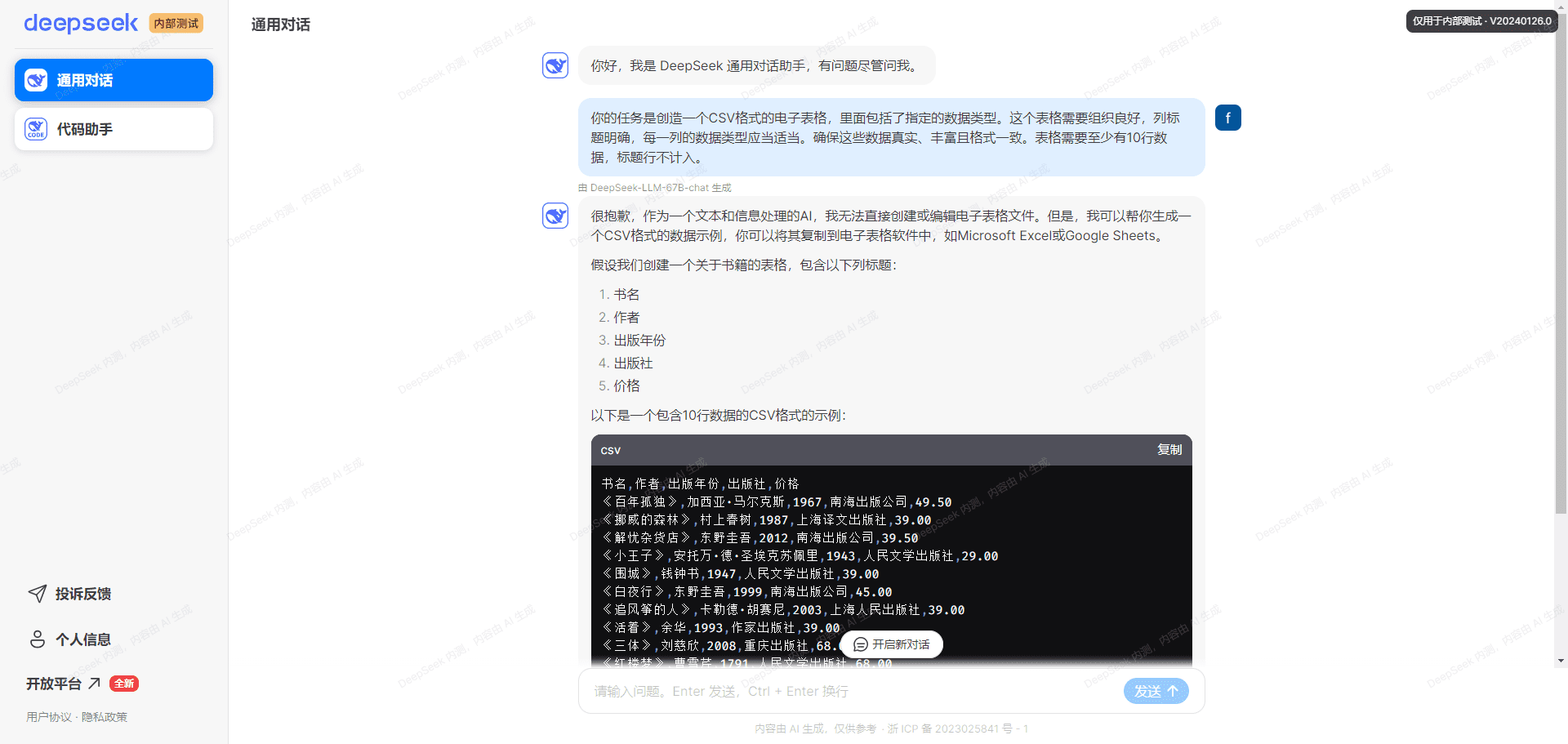

Texto a voz de BrowserAI

Lista de funciones

- Ejecute modelos de IA locales en su navegador sin soporte de servidor.

- Se admite la generación de texto para que los usuarios puedan introducirlo y obtener una respuesta en lenguaje natural.

- Ofrece reconocimiento de voz para convertir audio en texto.

- Admite la conversión de texto a voz, que convierte el texto en audio reproducible.

- Acelerado con WebGPU, se ejecuta con un rendimiento casi nativo.

- Funciona sin conexión y no requiere conexión a Internet después de la primera descarga.

- Código fuente abierto, apoyo a los desarrolladores para personalizar modelos y funciones.

Utilizar la ayuda

Proceso de instalación

BrowserAI no requiere una instalación tradicional, pero sí la preparación del entorno y del código a ejecutar. Estos son los pasos exactos:

- Compruebe su navegador

- Utilice un navegador habilitado para WebGPU, como Chrome 113+ o Edge 113+. En la barra de direcciones del navegador, escriba

chrome://gpuComprueba si la WebGPU está activada. - Asegúrate de que el hardware de tu ordenador admite coma flotante de 16 bits (algunos modelos lo exigen), y una CPU normal lo ejecutará, pero una GPU es más rápida.

- Utilice un navegador habilitado para WebGPU, como Chrome 113+ o Edge 113+. En la barra de direcciones del navegador, escriba

- Descargar código

- Visite https://github.com/Cloud-Code-AI/BrowserAI.

- Haga clic en el botón "Código" y seleccione "Descargar ZIP" para descargarlo, o utilice el comando

git clone https://github.com/Cloud-Code-AI/BrowserAI.git. - Descomprima el archivo o vaya a la carpeta.

- Instalación de Node.js y dependencias

- En primer lugar, instale Node.js, descárguelo e instálelo desde el sitio web oficial de Node.js, y cuando haya terminado, introduzca

node -vConfirme la versión. - Abra un terminal y vaya a la carpeta BrowserAI (por ejemplo

cd BrowserAI). - importación

npm installInstale las dependencias, el proceso puede tardar unos minutos.

- En primer lugar, instale Node.js, descárguelo e instálelo desde el sitio web oficial de Node.js, y cuando haya terminado, introduzca

- Inicio de proyectos

- En el terminal, escriba

npm run devInicie el servidor local. - Abra su navegador y escriba

http://localhost:3000(el terminal le pedirá el número de puerto) y entre en la interfaz BrowserAI.

- En el terminal, escriba

Cómo utilizar las principales funciones

El núcleo de BrowserAI es ejecutar modelos de IA en el navegador, lo que se describe en detalle a continuación.

Función 1: Generación de texto

- procedimiento

- Tras el inicio, la interfaz muestra el cuadro de selección de modelo, que por defecto tiene el valor

llama-3.2-1b-instructy otras opciones. - Haga clic en "Cargar modelo" y espere a que se cargue el modelo (de unos segundos a unos minutos, dependiendo del rendimiento del ordenador).

- Introduzca texto en el cuadro de entrada, como "¿Qué tiempo hace hoy?". y haga clic en "Generar".

- El sistema genera respuestas como "Hace un día precioso para salir". .

- Tras el inicio, la interfaz muestra el cuadro de selección de modelo, que por defecto tiene el valor

- Trucos y consejos

- Modelos pequeños (por ejemplo

TinyLlama-1.1B) se carga rápidamente y es adecuado para ordenadores de gama baja. - Introduzca una pregunta específica para obtener una respuesta más precisa, como "Escriba un artículo técnico de 50 palabras".

- Modelos pequeños (por ejemplo

- escenario de aplicación

- Redacte primeros borradores de artículos, genere diálogos o ponga a prueba modelos de destrezas lingüísticas.

Función 2: Reconocimiento de voz

- procedimiento

- Seleccione un modelo que admita el reconocimiento de voz, como por ejemplo

whisper-tiny-en. - Haga clic en "Cargar modelo" para cargar el modelo.

- Haz clic en "Iniciar grabación" y habla por el micrófono, por ejemplo: "Hola, BrowserAI".

- Haz clic en "Detener grabación", espera unos segundos y la interfaz mostrará el texto transcrito, como "Hola, BrowserAI".

- Seleccione un modelo que admita el reconocimiento de voz, como por ejemplo

- Trucos y consejos

- Asegúrate de que el micrófono funciona correctamente y de que hay poco ruido de fondo para obtener mejores resultados.

- Parámetros opcionales

return_timestampsVer la fecha y hora de cada párrafo.

- escenario de aplicación

- Grabe reuniones, transcriba notas de voz o desarrolle aplicaciones de entrada de voz.

Función 3: Texto a voz

- procedimiento

- opción

kokoro-ttsmodelo, haga clic en "Cargar modelo". - Introduce un texto, como "Bienvenido a la experiencia BrowserAI".

- Seleccione la voz (por ejemplo

af_bella) y la velocidad (por defecto 1,0), haga clic en "Texto a voz". - Genera audio y reprodúcelo automáticamente, o descarga el archivo.

- opción

- Trucos y consejos

- Las frases son más naturales y las velocidades más lentas (por ejemplo, 0,8) son más claras.

- Prueba diferentes opciones de voz para encontrar el tono más adecuado.

- escenario de aplicación

- Crea avisos de voz, genera clips de podcast o dobla vídeos.

Función 4: Personalización para desarrolladores

- procedimiento

- Descargue el archivo del modelo que desea utilizar (por ejemplo, de Hugging Face) y colóquelo en el directorio del proyecto (véase

README.md). - compilador

src/index.tsañade la ruta del modelo. - estar en movimiento

npm run devcarga el nuevo modelo.

- Descargue el archivo del modelo que desea utilizar (por ejemplo, de Hugging Face) y colóquelo en el directorio del proyecto (véase

- Trucos y consejos

- Asegúrese de que el modelo es compatible con WebGPU y WebAssembly.

- Si no conoce el código, plantee una cuestión en GitHub para obtener ayuda.

- escenario de aplicación

- Probar nuevos modelos, desarrollar aplicaciones de IA personalizadas.

El código de ejemplo utiliza

Generación de texto

- Introducción de BrowserAI en el proyecto:

import { BrowserAI } from '@browserai/browserai'; const ai = new BrowserAI(); await ai.loadModel('llama-3.2-1b-instruct'); const response = await ai.generateText('你好,今天天气如何?'); console.log(response);

voz a texto

- Graba y transcribe audio:

const ai = new BrowserAI(); await ai.loadModel('whisper-tiny-en'); await ai.startRecording(); const audio = await ai.stopRecording(); const text = await ai.transcribeAudio(audio); console.log(text);

advertencia

- actuacionesModelos grandes (p. ej.

Llama-3.2-3b) Se requiere un ordenador de gama alta, se recomienda un modelo pequeño para gama baja. - Uso offlineFunciona incluso si te desconectas de Internet después de la primera carga, pero necesitas descargar el modelo con antelación.

- Apoyo comunitario: Se pueden añadir problemas Discordia sondeo Archivo (informático).

BrowserAI es sencillo y potente. Solo tienes que seguir los pasos para configurar tu entorno y experimentar la comodidad de la IA local en tu navegador.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...