Motor Afrodita: un motor de inferencia LLM eficiente que admite múltiples formatos de cuantificación e inferencia distribuida.

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 57.3K 00

Introducción general

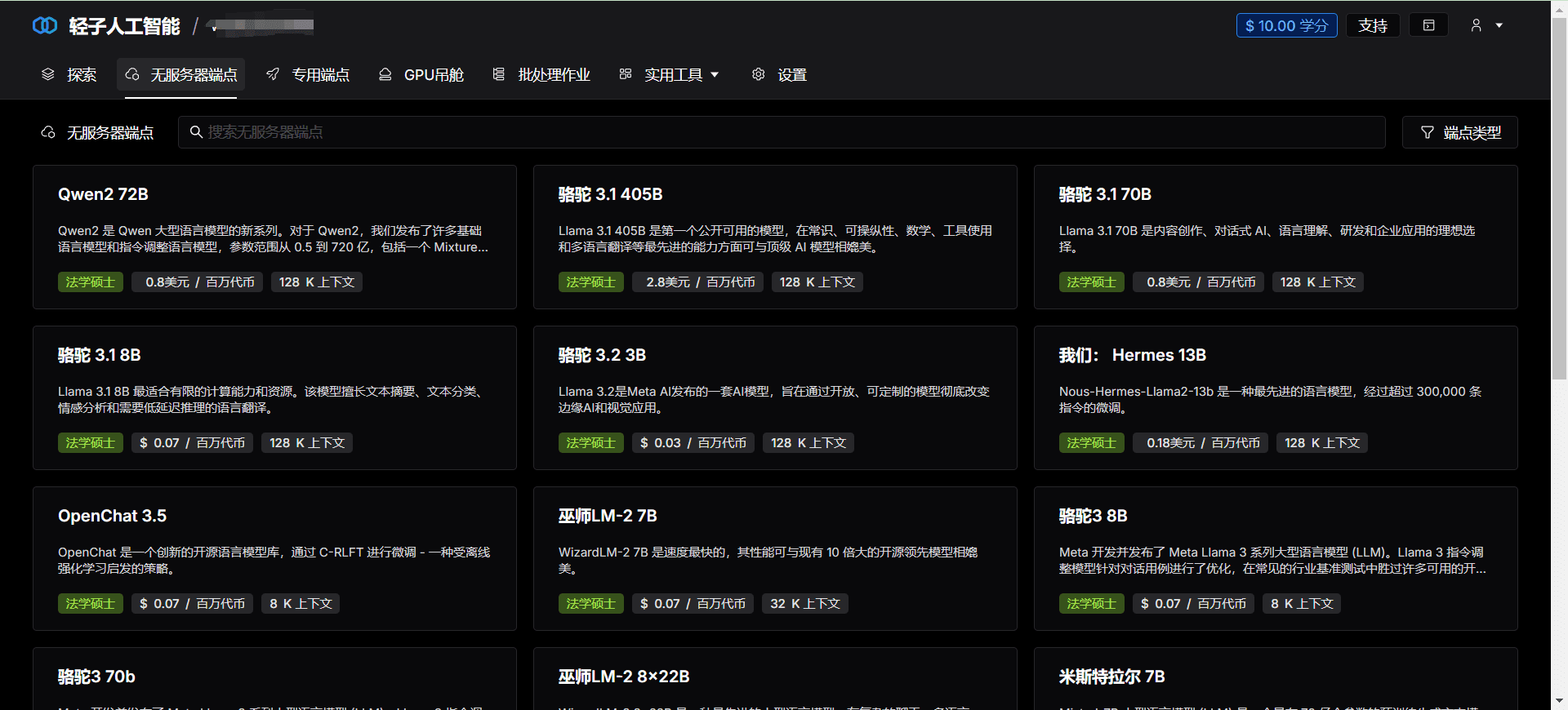

Aphrodite Engine es el motor backend oficial de PygmalionAI, diseñado para proporcionar un punto final de inferencia para los sitios PygmalionAI y apoyar el rápido despliegue de modelos compatibles con Hugging Face. El motor aprovecha la tecnología Paged Attention de vLLM para permitir la gestión eficiente de K/V y el procesamiento secuencial por lotes, lo que mejora significativamente la velocidad de inferencia y la utilización de la memoria. aphrodite Engine admite una amplia gama de formatos de cuantización e inferencia distribuida, y es adecuado para una amplia gama de dispositivos GPU y TPU modernos.

Lista de funciones

- Procesamiento continuo por lotesGestión eficaz de múltiples solicitudes y mejora de la velocidad de inferencia.

- Atención: Optimiza la gestión K/V para mejorar la utilización de la memoria.

- Núcleo optimizado para CUDAMejora del rendimiento de la inferencia.

- Apoyo cuantitativoAdmite múltiples formatos de cuantificación, como AQLM, AWQ, Bitsandbytes, etc.

- inferencia distribuidaSoporte de caché KV de 8 bits para requisitos de gran longitud de contexto y alto rendimiento.

- Compatibilidad con varios dispositivosCompatible con GPUs NVIDIA, AMD, Intel y TPUs Google.

- Despliegue de DockerProporciona imágenes Docker para simplificar el proceso de despliegue.

- Compatible con API: Admite API compatibles con OpenAI para facilitar la integración en los sistemas existentes.

Utilizar la ayuda

Proceso de instalación

- Instalación de dependencias::

- Asegúrese de que las versiones 3.8 a 3.12 de Python están instaladas en su sistema.

- Para los usuarios de Linux, se recomienda el siguiente comando para instalar las dependencias:

sudo apt update && sudo apt install python3 python3-pip git wget curl bzip2 tar- Para los usuarios de Windows, se recomienda una instalación WSL2:

wsl --install sudo apt update && sudo apt install python3 python3-pip git wget curl bzip2 tar - Instalación del motor Afrodita::

- Utilice pip para instalar:

pip install -U aphrodite-engine - modelo de cebado::

- Ejecute el siguiente comando para iniciar el modelo:

bash

aphrodite run meta-llama/Meta-Llama-3.1-8B-Instruct - Esto creará un servidor API compatible con OpenAI con un puerto por defecto de 2242.

- Ejecute el siguiente comando para iniciar el modelo:

Despliegue con Docker

- Extracción de una imagen Docker::

docker pull alpindale/aphrodite-openai:latest

- Ejecutar un contenedor Docker::

docker run --runtime nvidia --gpus all \

-v ~/.cache/huggingface:/root/.cache/huggingface \

-p 2242:2242 \

--ipc=host \

alpindale/aphrodite-openai:latest \

--model NousResearch/Meta-Llama-3.1-8B-Instruct \

--tensor-parallel-size 8 \

--api-keys "sk-empty"

Funciones principales

- Procesamiento continuo por lotes::

- Aphrodite Engine puede procesar varias solicitudes al mismo tiempo gracias a la tecnología de procesamiento por lotes continuo, lo que mejora considerablemente la velocidad de inferencia. Los usuarios solo tienen que especificar los parámetros de procesamiento por lotes al arrancar.

- Atención::

- Esta tecnología optimiza la gestión de K/V y mejora la utilización de la memoria. El usuario no necesita ninguna configuración adicional y el sistema aplica automáticamente la optimización.

- Apoyo cuantitativo::

- Se admiten múltiples formatos de cuantificación, como AQLM, AWQ, Bitsandbytes, etc. El usuario puede especificar el formato de cuantificación deseado al iniciar el modelo:

aphrodite run --quant-format AQLM meta-llama/Meta-Llama-3.1-8B-Instruct - inferencia distribuida::

- Admite caché KV de 8 bits para requisitos de gran longitud de contexto y alto rendimiento. Los usuarios pueden iniciar el razonamiento distribuido con el siguiente comando:

aphrodite run --tensor-parallel-size 8 meta-llama/Meta-Llama-3.1-8B-Instruct - Integración API::

- Aphrodite Engine proporciona API compatibles con OpenAI para facilitar la integración en los sistemas existentes. Los usuarios pueden iniciar el servidor API con el siguiente comando:

bash

aphrodite run --api-keys "your-api-key" meta-llama/Meta-Llama-3.1-8B-Instruct

- Aphrodite Engine proporciona API compatibles con OpenAI para facilitar la integración en los sistemas existentes. Los usuarios pueden iniciar el servidor API con el siguiente comando:

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...