Asistente Deepseek AI "Always-On": creación de un sistema inteligente de interacción por voz basado en Deepseek-V3

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 62.3K 00

Introducción general

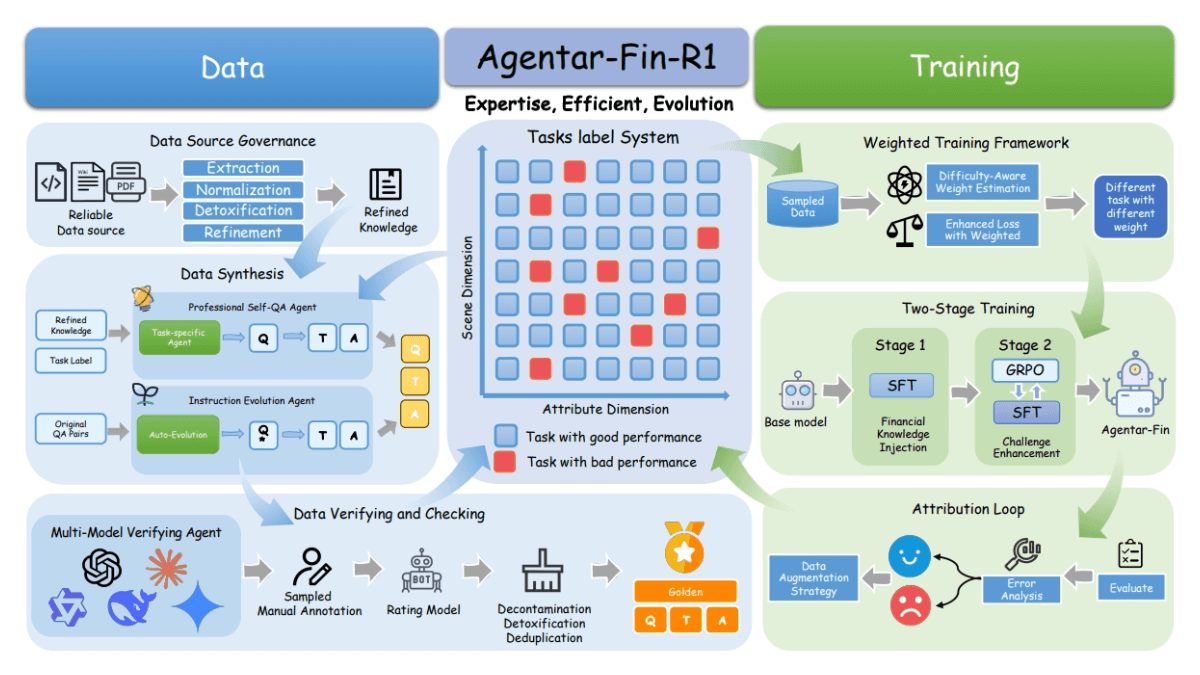

Always-On AI Assistant es un innovador proyecto de asistente de IA que crea un sistema de asistente de IA potente y permanentemente en línea mediante la integración de tecnologías avanzadas como Deepseek-V3, RealtimeSTT y Typer. El proyecto está especialmente optimizado para escenarios de desarrollo de ingeniería, proporcionando una completa interfaz de interacción por voz y un marco de ejecución de comandos. El sistema adopta un diseño modular e incluye una interfaz de chat de asistente básica y un sistema avanzado de comandos de sesión de asistente Typer, compatible con funciones de reconocimiento de voz y conversión de texto a voz en tiempo real. Al integrar la tecnología de síntesis de voz de ElevenLabs y las capacidades de reconocimiento de voz en tiempo real de RealtimeSTT, el proyecto proporciona a los desarrolladores un paradigma completo de desarrollo de asistentes de IA, lo que facilita y agiliza la creación de asistentes de voz inteligentes.

Lista de funciones

- Sistema de reconocimiento y respuesta de voz en tiempo real

- Motor de diálogo inteligente basado en Deepseek-V3

- Marco personalizable de ejecución de comandos Typer

- Funcionamiento multimodo (por defecto, ejecución, ejecución sin memoria)

- Sistema de gestión dinámica de la memoria (Bloc de notas)

- Arquitectura de asistente altamente configurable

- Reconocimiento de voz nativo

- Integración de síntesis de voz de alta calidad de ElevenLabs

- Sistema extensible de plantillas de comandos

- Sesión interactiva en tiempo real

Utilizar la ayuda

1. Configuración medioambiental

1.1 Configuración básica

- Primero clone el proyecto localmente

- Copiar el fichero de configuración del entorno: ejecutar

cp .env.sample .env - Actualice la clave API:

- Establecer DEEPSEEK_API_KEY (para el acceso al modelo AI)

- Ajuste ELEVEN_API_KEY (para síntesis de voz)

- llevar a cabo

uv syncdependencia de sincronización - Opcional: Instale Python 3.11 (utilizando el comando

uv python install 3.11)

1.2 Requisitos del sistema

- Python 3.11 o posterior.

- Conexión de red estable

- Equipo de micrófono (para entrada de voz)

- dispositivo de salida de audio (ordenador)

2. Descripción del uso de las principales funciones

2.1 Interfaz básica del asistente de chat

- Comando de inicio:

uv run python main_base_assistant.py chat - Se abre una pantalla de diálogo básica

- Posibilidad de interacción directa por texto o voz

- Respuesta vocal mediante TTS nativo

2.2 Sistema de comandos de sesión del asistente Typer

- Comando de inicio:

uv run python main_typer_assistant.py awaken --typer-file commands/template.py --scratchpad scratchpad.md --mode execute

- Descripción de los parámetros:

- --typer-file: especifica la ubicación del archivo de plantilla de comandos.

- --scratchpad: establece el archivo de memoria dinámica del asistente

- --mode: establece el modo de ejecución (por defecto/ejecutar/ejecutar-sin-rascar)

2.3 Interacción con los asistentes

- Llamada de atención claramente pronunciada "Ada".

- Di instrucciones, por ejemplo: "Ada, haz ping al servidor espera respuesta".

- El asistente reconoce el habla en tiempo real y ejecuta las órdenes en consecuencia.

- Los resultados de la ejecución se registran en el archivo scratchpad.md

3. Descripción de los componentes arquitectónicos

3.1 Arquitectura de Typer Assistant

- Cerebro: uso de Deepseek V3 como motor principal de IA

- Gestión de tareas: se define mediante prompts/typer-commands.xml

- Memoria dinámica: gestión de estados mediante scratchpad.txt

- Reconocimiento del habla: voz a texto en tiempo real con RealtimeSTT

- Síntesis de voz: la integración con ElevenLabs proporciona una salida de voz natural

3.2 Arquitectura del asistente de infraestructura

- Motor principal: uso de ollama:phi4

- Diseño simplificado: no requiere pistas adicionales ni memoria dinámica.

- Reconocimiento de voz: también con RealtimeSTT

- Salida de voz: mediante el sistema TTS local

4. Configuración de funciones avanzadas

- Las configuraciones del asistente pueden personalizarse mediante el archivo assistant_config.yml

- Soporte para añadir comandos Typer personalizados

- Se pueden ajustar los parámetros de reconocimiento y síntesis de voz

- Soporte para ampliar nuevos módulos funcionales

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...