AI Engineering Academy: 2.12 Autoconsulta RAG: Generación mejorada de aumento de la recuperación con filtrado de metadatos

Base de conocimientos de IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 38.5K 00

presentar (a algn. para un trabajo, etc.)

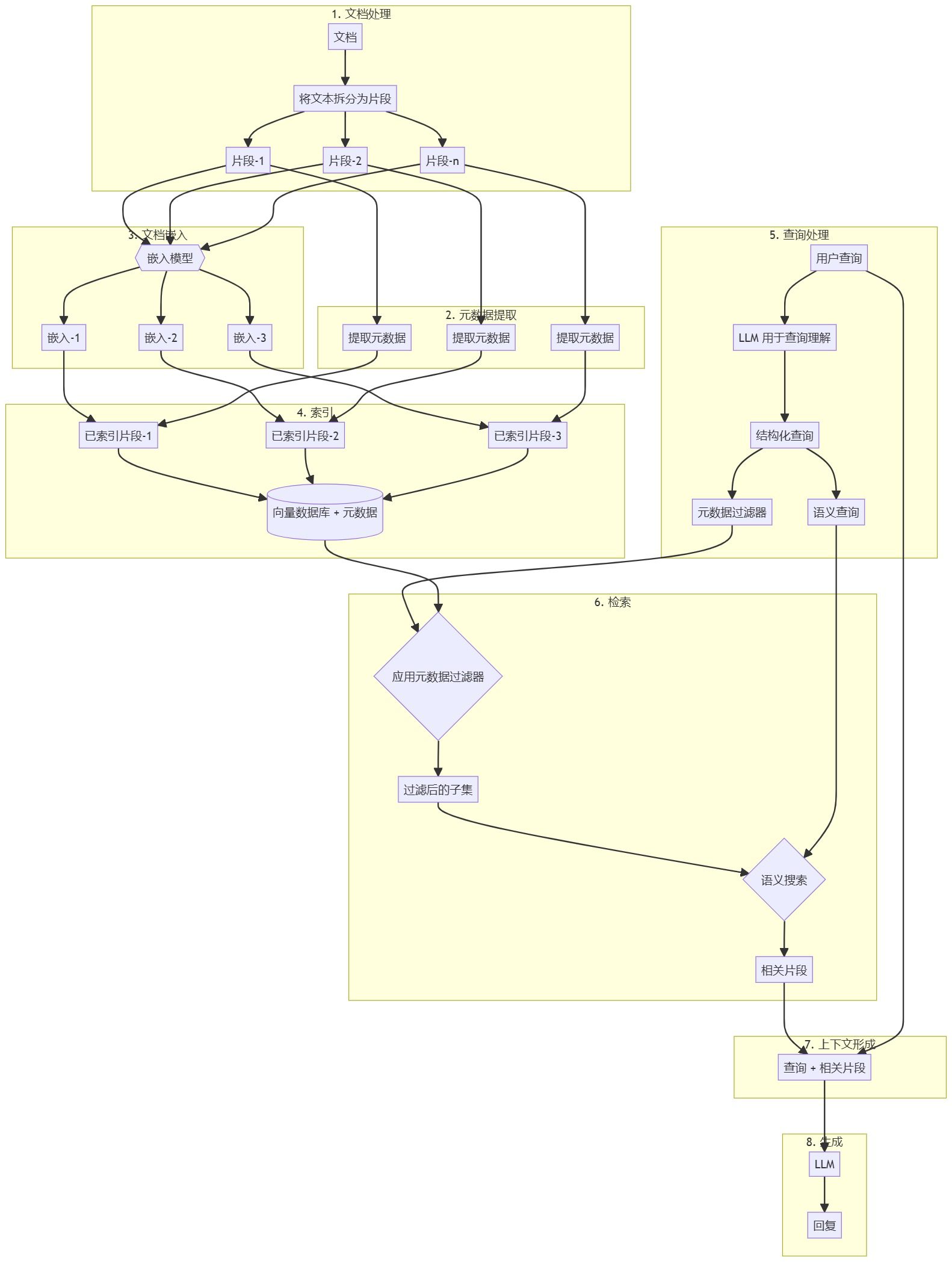

Self-Query RAG (SQRAG) es un método avanzado de generación de aumento de la recuperación (RAG) que mejora la RAG tradicional introduciendo la extracción de metadatos en la fase de ingestión y el análisis sintáctico inteligente de las consultas en la fase de recuperación. RAG Proceso.

https://github.com/adithya-s-k/AI-Engineering.academy/tree/main/RAG/07_Self_Query_RAG

locomotora

Los sistemas tradicionales de GAR suelen tener dificultades para gestionar consultas complejas que implican similitud semántica y restricciones específicas de metadatos. La autoconsulta de RAG resuelve estos problemas aprovechando los metadatos y analizando de forma inteligente las consultas de los usuarios mediante el Modelo de Lenguaje Amplio (LLM).

Detalles metodológicos

Preprocesamiento de documentos y creación de almacenes vectoriales

- Divida los documentos en partes manejables.

- Extraer metadatos (por ejemplo, fecha, autor, categoría) de cada chunk.

- Incrusta cada pepita utilizando el modelo de incrustación adecuado.

- Indexa las pepitas, sus vectores de incrustación y los metadatos asociados en una base de datos de vectores.

Flujo de trabajo RAG de autoconsulta

- Los usuarios envían consultas en lenguaje natural.

- Análisis sintáctico de consultas mediante un modelo de lenguaje amplio (LLM) para comprender la intención del usuario y la estructura de la consulta.

- Generación LLM:

a) Condiciones de filtrado de metadatos basadas en consultas.

b) Consultas de búsqueda semántica para la recuperación de contenidos. - Aplique filtros de metadatos para limitar su búsqueda.

- Realiza una búsqueda semántica en un subconjunto filtrado.

- Los trozos de documentos recuperados se combinan con la consulta original del usuario para formar un contexto.

- Pasa el contexto al Modelo de Lenguaje Amplio (LLM) para generar la respuesta final.

Características principales de la autoconsulta RAG

- Extracción de metadatos: Mejora la representación de documentos con información estructurada.

- Resolución inteligente de consultas: Utiliza LLM para comprender las consultas complejas de los usuarios.

- búsqueda híbridaCombinación de filtrado de metadatos y búsqueda semántica.

- Consulta flexiblePermite a los usuarios especificar implícitamente restricciones de metadatos en lenguaje natural.

Ventajas de este método

- Mejorar la precisión de la búsquedaFiltros de metadatos: los filtros de metadatos ayudan a restringir la búsqueda a los documentos más relevantes.

- Gestión de consultas complejas: puede interpretar y responder a consultas que impliquen similitud de contenidos y restricciones de metadatos.

- Recuperación eficazEl filtrado de metadatos puede reducir significativamente el número de documentos que requieren una búsqueda semántica.

- Contexto mejoradoLos metadatos proporcionan información estructurada adicional que mejora la generación de respuestas.

llegar a un veredicto

La RAG de autoconsulta mejora el proceso tradicional de RAG introduciendo la extracción de metadatos y el análisis sintáctico inteligente de las consultas. Este enfoque hace que la recuperación sea más precisa y eficiente, especialmente en el caso de consultas complejas que implican similitud semántica y restricciones específicas de metadatos. Al aprovechar el Large Language Model (LLM) para la comprensión de las consultas, la RAG de autoconsulta proporciona a los sistemas de AI Q&A respuestas más precisas y contextualmente relevantes.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...