Schwergewicht! Weltweit erstes dezentrales 10B-Modell ausgebildet, Open Source in einer Woche!

Das weltweit erste dezentral trainierte parametrische 10B-Modell ist geboren! Das Team von Prime Intellect gab bekannt, dass es ein bahnbrechendes Werk vollbracht hat: ein dezentrales Trainingsnetzwerk in den USA, Europa und Asien, das erfolgreich ein großes Modell mit 10 B Parametern trainiert hat. Dies ist ein revolutionärer Schritt in der KI-Ausbildung.

Das Team von Prime Intellect gab bekannt, dass es ein bahnbrechendes Werk vollbracht hat: ein dezentrales Trainingsnetzwerk in den USA, Europa und Asien, das erfolgreich ein großes Modell mit 10 B Parametern trainiert hat. Dies ist ein revolutionärer Schritt in der KI-Ausbildung.

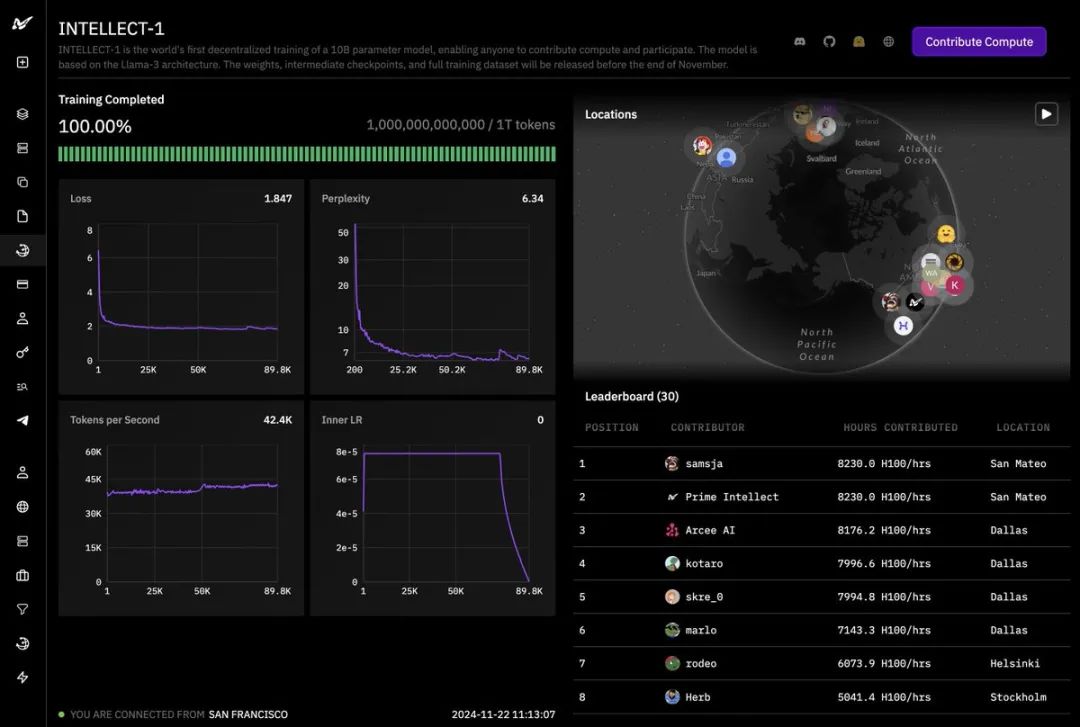

Wie Sie aus dem Trainingspanel ersehen können, hat das Projekt mit dem Namen INTELLECT-1 bereits das Training von 1 Billion (1T) Token abgeschlossen.

Sowohl die Verlust- als auch die Komplexitätskurve zeigen einen wünschenswerten Abwärtstrend, und die Anzahl der pro Sekunde generierten Token bleibt stabil, was darauf hindeutet, dass der Trainingsprozess sehr erfolgreich war. Der Erfolg dieses Projekts wäre ohne die Unterstützung vieler Partner nicht möglich gewesen.

Der Erfolg dieses Projekts wäre ohne die Unterstützung vieler Partner nicht möglich gewesen.

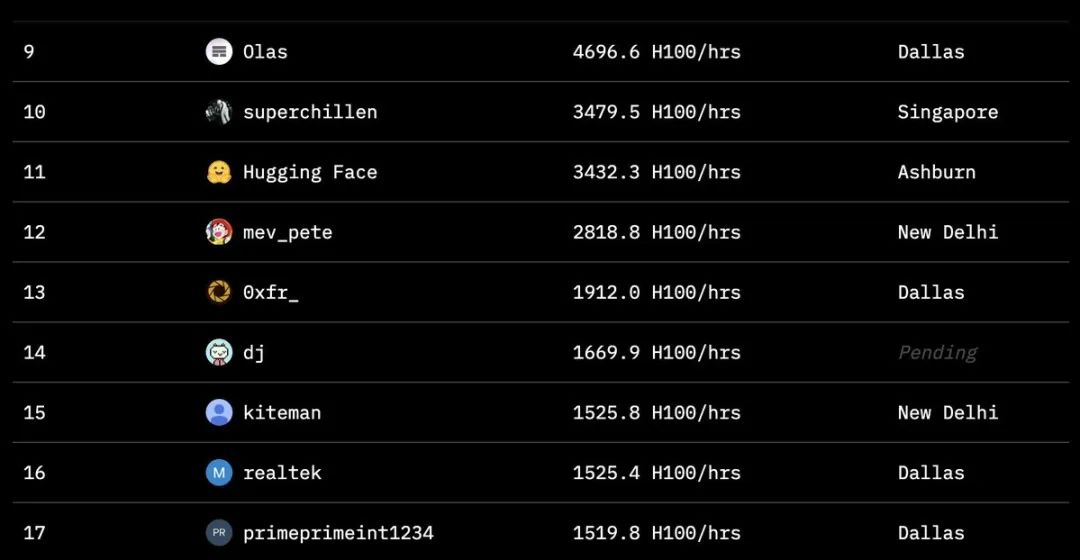

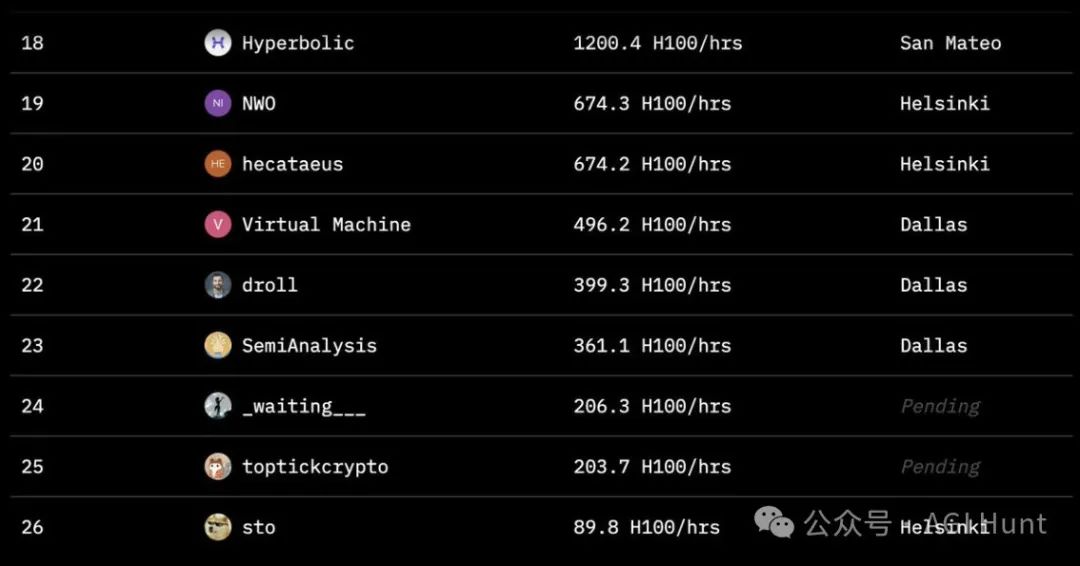

Eine Reihe von Organisationen wie Hugging Face, SemiAnalysis, Arcee.ai, Hyperbolic Labs, Olas, Akash, Schelling AI und andere steuerten wertvolle arithmetische Ressourcen für das Training bei. Dieses beispiellose Modell der Zusammenarbeit zeigt eine neue Art der Zusammenarbeit in der KI. Wie Sie der Rangliste des Projekts entnehmen können, haben Teilnehmer aus der ganzen Welt eine erstaunliche Menge an Rechenzeit zur Verfügung gestellt. Der höchste Beitrag wurde mit 8 230 Stunden geleistet, wobei die Teilnehmer aus San Mateo, Dallas, Helsinki und Stockholm kamen. Dank dieses globalen Modells der arithmetischen Zusammenarbeit ist das KI-Training nicht mehr auf die Rechenzentren einer Handvoll von Tech-Giganten beschränkt.

Wie Sie der Rangliste des Projekts entnehmen können, haben Teilnehmer aus der ganzen Welt eine erstaunliche Menge an Rechenzeit zur Verfügung gestellt. Der höchste Beitrag wurde mit 8 230 Stunden geleistet, wobei die Teilnehmer aus San Mateo, Dallas, Helsinki und Stockholm kamen. Dank dieses globalen Modells der arithmetischen Zusammenarbeit ist das KI-Training nicht mehr auf die Rechenzentren einer Handvoll von Tech-Giganten beschränkt.

Auf technischer Ebene ist die Innovation dieses Projekts ebenso beeindruckend.

Das Team setzte die verteilte DiLoCo-Trainingstechnik ein, um die Herausforderungen des regionsübergreifenden Trainings zu bewältigen. Um die verschiedenen Herausforderungen in einer verteilten Umgebung zu bewältigen, implementierte das Forschungsteam außerdem einen fehlertoleranten Trainingsmechanismus und asynchrone verteilte Checkpointing-Techniken.

Im Hinblick auf die Speicheroptimierung entschied sich das Team für ein Upgrade auf das FSDP2-Framework, mit dem die Probleme der Speicherzuweisung in FSDP1 erfolgreich gelöst wurden.

Gleichzeitig wird die Trainingseffizienz durch die Anwendung der Tensor-Parallel-Computing-Technologie erheblich verbessert.

Hinter diesen technologischen Innovationen steht ein starkes Forschungsteam, das im Stillen arbeitet. Der Projektleiter dankt insbesondere Tristan Rice und Junjie Wang für ihre Beiträge zum fehlertoleranten Training sowie Chien-Chin Huang und Iris Zhang für ihre Arbeit zum asynchronen verteilten Checkpointing. Außerdem wird Yifu Wang für seine Ratschläge zum Tensor-Parallel-Computing gedankt.

Noch spannender ist, dass das Team angekündigt hat, innerhalb einer Woche die vollständige Open-Source-Version zu veröffentlichen, einschließlich des Basismodells, der Checkpoint-Dateien, des Post-Trainingsmodells und des Trainingsdatensatzes. Dies bedeutet, dass Forscher und Entwickler auf der ganzen Welt bald in der Lage sein werden, auf der Grundlage dieses Modells Innovationen und Entwicklungen vorzunehmen.

Es gibt bereits Entwickler, die es kaum erwarten können, mit dem Experimentieren zu beginnen. Ein Entwickler demonstrierte einen Versuch zur Modellinferenz auf zwei 4090-Grafikkarten an der Westküste der Vereinigten Staaten und in Europa. Obwohl die Netzwerkverbindung zwischen den beiden Standorten nicht ideal war, bewies dieses Experiment die Flexibilität und Anpassungsfähigkeit des Modells.

Der Erfolg dieses Projekts ist nicht nur ein technologischer Durchbruch, sondern ein wichtiger Meilenstein für die Demokratisierung der KI für alle.

Es beweist, dass wir durch globale Zusammenarbeit gut positioniert sind, um die Grenzen traditioneller KI-Schulungen zu durchbrechen und mehr Organisationen und Einzelpersonen in die Welle der KI-Entwicklung einzubeziehen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...