Microsoft Erste Schritte mit KI-Agenten: Aufbau vertrauenswürdiger KI-Agenten

kurz

Dieser Kurs behandelt:

- Wie man sichere und wirksame KI-Agenten entwickelt und einsetzt

- Wichtige Sicherheitsüberlegungen bei der Entwicklung von KI-Agenten.

- Wie man bei der Entwicklung von KI-Agenten den Daten- und Nutzerschutz aufrechterhält.

Lernziel

Nach Abschluss dieses Kurses werden Sie wissen, wie:

- Identifizierung und Abschwächung von Risiken bei der Entwicklung von KI-Agenten.

- Umsetzung von Sicherheitsmaßnahmen, um sicherzustellen, dass Daten und Zugang ordnungsgemäß verwaltet werden.

- Erstellen Sie KI-Agenten, die den Datenschutz wahren und ein hochwertiges Nutzererlebnis bieten.

Sicherheit

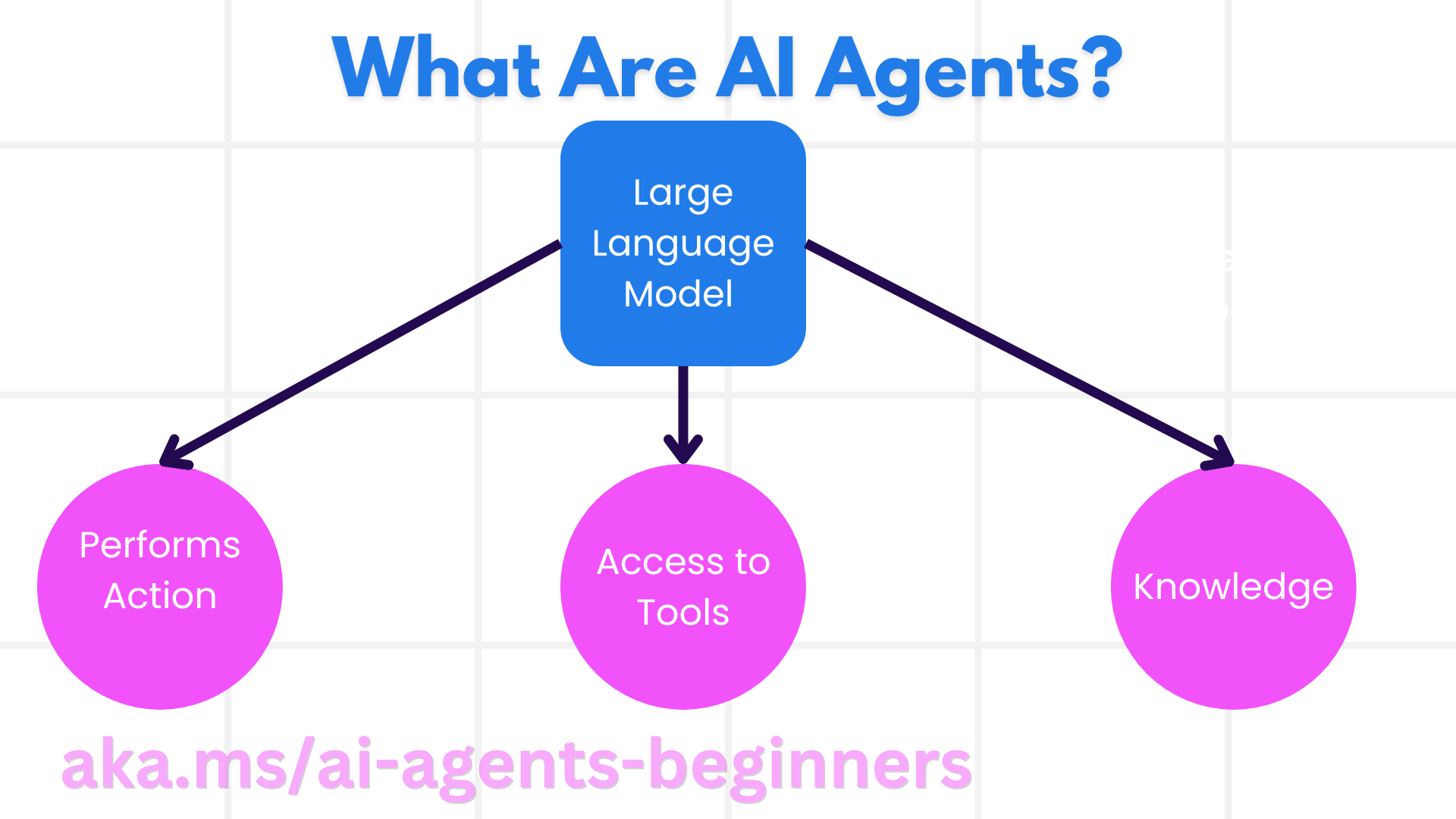

Schauen wir uns zunächst an, wie man sichere Agentic-Anwendungen erstellt. Sicherheit bedeutet, dass der KI-Agent wie vorgesehen funktioniert. Als Entwickler von agentenbasierten Anwendungen verfügen wir über die Methoden und Werkzeuge, um die Sicherheit zu maximieren:

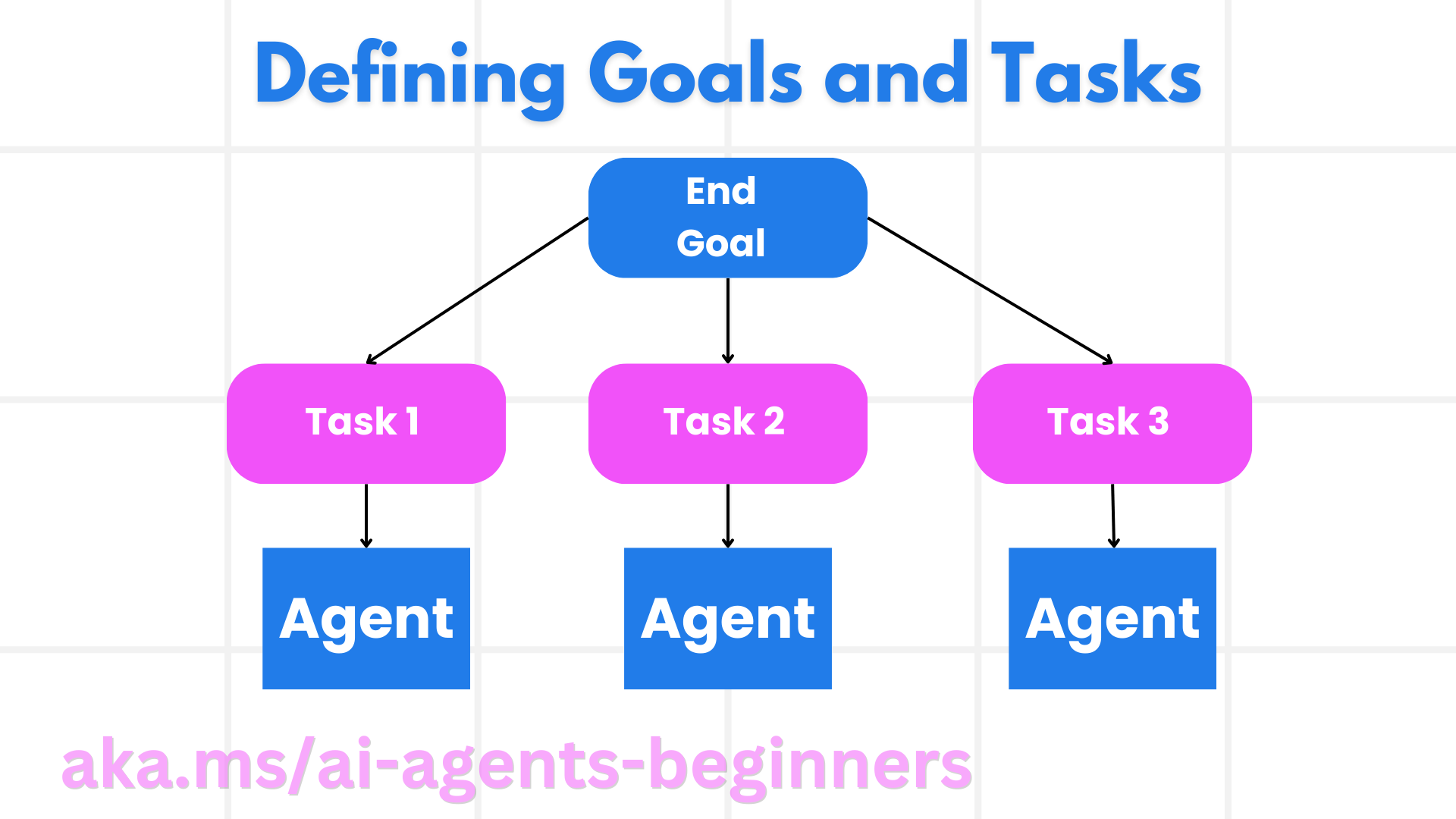

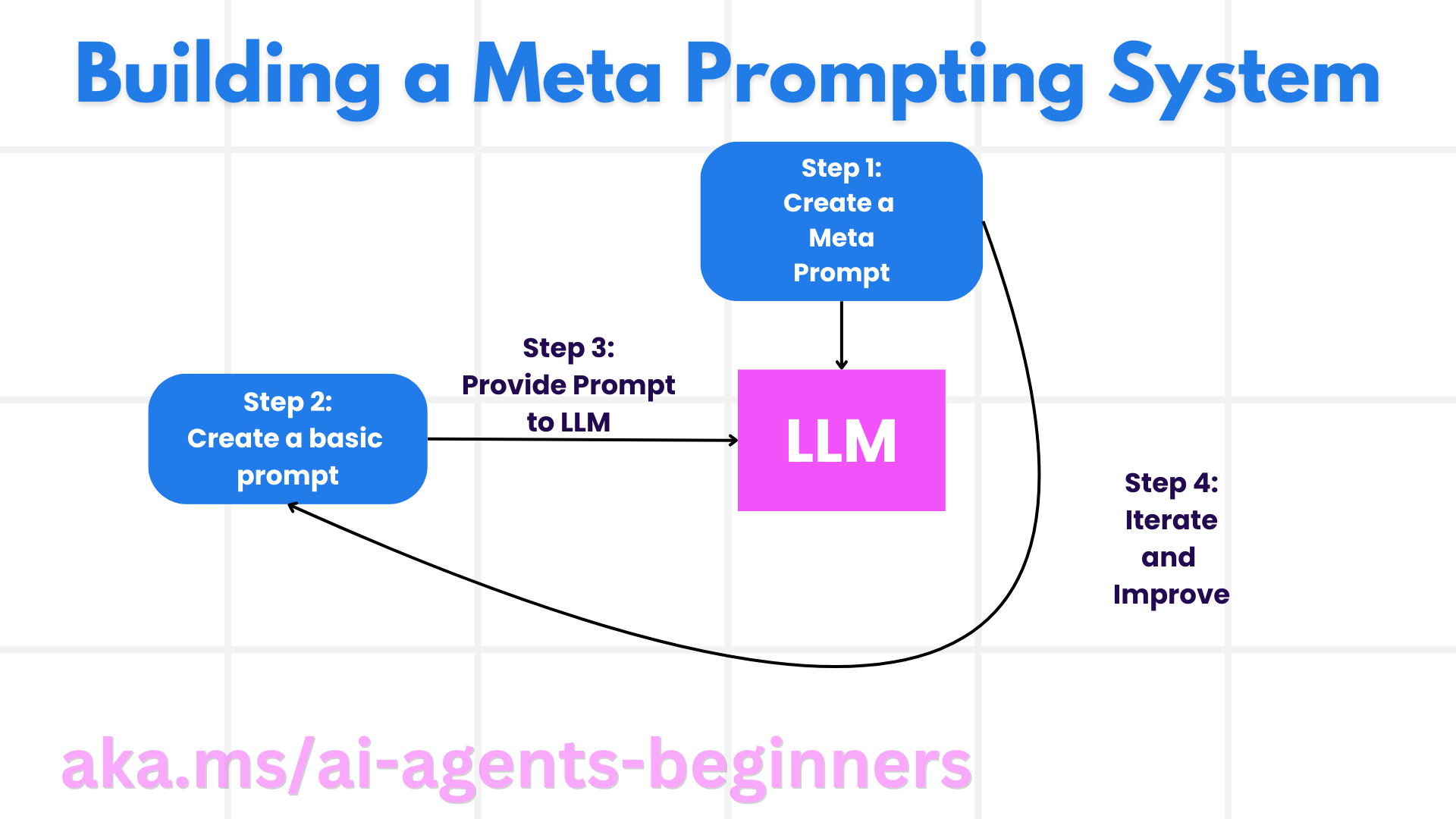

Aufbau eines Meta-Prompting-Systems

Wenn Sie jemals eine KI-Anwendung mit Large Language Models (LLMs) entwickelt haben, wissen Sie, wie wichtig es ist, einen starken Systemhinweis oder eine Systemnachricht zu entwerfen. Diese Prompts legen die Metaregeln, Anweisungen und Richtlinien für die Interaktion des LLM mit Benutzern und Daten fest.

Für KI-Agenten sind Systemhinweise sogar noch wichtiger, da KI-Agenten sehr spezifische Anweisungen benötigen, um die von uns für sie entworfenen Aufgaben zu erfüllen.

Um skalierbare System-Prompts zu erstellen, können wir das Meta-Prompt-System verwenden, um einen oder mehrere Agenten in unserer Anwendung zu erstellen:

Schritt 1: Erstellen eines Meta-Prompts oder einer Prompt-Vorlage

Meta-Prompts werden vom LLM verwendet, um System-Prompts für die von uns erstellten Agenten zu generieren. Wir haben sie als Vorlage entworfen, damit wir bei Bedarf effizient mehrere Agenten erstellen können.

Nachstehend finden Sie ein Beispiel für die Meta-Prompts, die wir dem LLM zur Verfügung stellen:

你是一位创建 AI Agent 助手的专家。

你将获得公司名称、角色、职责和其他信息,你将使用这些信息来提供系统提示。

为了创建系统提示,请尽可能详细地描述,并提供一个系统使用 LLM 可以更好地理解 AI 助手角色和职责的结构。

Schritt 2: Erstellen eines Basis-Tipps

Im nächsten Schritt erstellen Sie eine grundlegende Eingabeaufforderung zur Beschreibung des KI-Agenten.

Hier ist ein Beispiel:

你是 Contoso Travel 的旅行 Agent,擅长为客户预订航班。为了帮助客户,你可以执行以下任务:查找可用航班、预订航班、询问客户对座位和航班时间偏好、取消任何先前预订的航班,并提醒客户任何航班延误或取消。

Schritt 3: Geben Sie dem LLM grundlegende Tipps

Wir können diese Eingabeaufforderung nun optimieren, indem wir Meta-Eingabeaufforderungen als System-Eingabeaufforderungen und unsere Basis-Eingabeaufforderungen anbieten.

Dadurch wird eine Eingabeaufforderung erzeugt, die besser geeignet ist, unseren KI-Agenten zu führen:

**公司名称:** Contoso Travel

**角色:** 旅行 Agent 助理

**目标:**

你是 Contoso Travel 的 AI 驱动的旅行 Agent 助理,专门负责预订航班和提供卓越的客户服务。你的主要目标是协助客户查找、预订和管理他们的航班,同时确保他们的偏好和需求得到有效满足。

**主要职责:**

1. **航班查询:**

* 根据客户指定的目的地、日期和任何其他相关偏好,协助客户搜索可用航班。

* 提供选项列表,包括航班时间、航空公司、中途停留和价格。

2. **航班预订:**

* 协助客户预订航班,确保所有详细信息都正确输入系统。

* 确认预订并向客户提供他们的行程,包括确认号码和任何其他相关信息。

3. **客户偏好查询:**

* 主动询问客户对座位(例如,过道、靠窗、额外腿部空间)和首选航班时间(例如,上午、下午、晚上)的偏好。

* 记录这些偏好以供将来参考,并相应地定制建议。

4. **航班取消:**

* 如果需要,根据公司政策和程序协助客户取消先前预订的航班。

* 通知客户任何必要的退款或可能需要取消的其他步骤。

5. **航班监控:**

* 监控已预订航班的状态,并实时提醒客户有关其航班时刻表的任何延误、取消或更改。

* 根据需要通过首选通信渠道(例如,电子邮件、短信)提供更新。

**语气和风格:**

* 在与客户的所有互动中保持友好、专业和 அணுகக்கூடிய (平易近人) 的态度。

* 确保所有沟通都清晰、信息丰富,并根据客户的具体需求和查询进行定制。

**用户交互说明:**

* 及时准确地响应客户查询。

* 使用对话风格,同时确保专业性。

* 通过在提供的所有协助中保持专注、同情和主动,优先考虑客户满意度。

**附加说明:**

* 及时了解可能影响航班预订和客户体验的航空公司政策、旅行限制和其他相关信息的任何更改。

* 使用清晰简洁的语言解释选项和流程,尽可能避免使用术语,以便客户更好地理解。

此 AI 助手旨在简化 Contoso Travel 客户的航班预订流程,确保他们的所有旅行需求都得到高效和有效的满足。

Schritt 4: Iterieren und verbessern

Der Wert dieses Meta-Prompting-Systems liegt in der Möglichkeit, Prompts für mehrere Agenten zu erstellen und die Prompts im Laufe der Zeit zu verbessern. Ihre Prompts werden selten auf Anhieb für Ihren gesamten Anwendungsfall funktionieren. Die Möglichkeit der Feinabstimmung und Verbesserung durch Ändern grundlegender Prompts und deren Durchlauf durch das System ermöglicht es Ihnen, die Ergebnisse zu vergleichen und zu bewerten.

Die Bedrohung verstehen

Um vertrauenswürdige KI-Agenten zu entwickeln, ist es wichtig, die Risiken und Bedrohungen für KI-Agenten zu verstehen und zu entschärfen. Werfen wir einen Blick auf einige der verschiedenen Bedrohungen für KI-Agenten und wie man sie besser planen und sich darauf vorbereiten kann.

Mandate und Weisungen

Beschreibung: Ein Angreifer versucht, die Befehle oder Ziele des KI-Agenten zu ändern, indem er Eingaben auffordert oder manipuliert.

Abhilfemaßnahmen: Führen Sie Validierungsprüfungen und Eingabefilter durch, um potenziell gefährliche Hinweise zu erkennen, bevor sie vom KI-Agenten verarbeitet werden. Da diese Angriffe in der Regel häufige Interaktionen mit dem Agenten erfordern, ist die Begrenzung der Anzahl der Dialogrunden eine weitere Möglichkeit, solche Angriffe zu verhindern.

Zugang zu kritischen Systemen

Beschreibung: Wenn der KI-Agent Zugang zu Systemen und Diensten hat, die sensible Daten speichern, kann ein Angreifer die Kommunikation zwischen dem Agenten und diesen Diensten stören. Bei diesen Angriffen kann es sich um direkte Angriffe handeln oder um Versuche, indirekt über den Agenten an Informationen über diese Systeme zu gelangen.

Abhilfemaßnahmen: Der KI-Agent sollte nur bei Bedarf Zugang zum System haben, um solche Angriffe zu verhindern. Auch die Kommunikation zwischen dem Agenten und dem System sollte sicher sein. Die Implementierung von Authentifizierung und Zugriffskontrolle ist eine weitere Möglichkeit, diese Informationen zu schützen.

Überlastung von Ressourcen und Diensten

Beschreibung: Der KI-Agent hat Zugang zu verschiedenen Tools und Diensten, um Aufgaben zu erledigen. Ein Angreifer könnte diese Fähigkeit nutzen, um diese Dienste anzugreifen, indem er eine große Anzahl von Anfragen über den KI-Agenten sendet, was zu einem Systemausfall oder hohen Kosten führen könnte.

Abhilfemaßnahmen: Implementieren Sie Richtlinien zur Begrenzung der Anzahl von Anfragen, die ein KI-Agent an einen Dienst stellen kann. Die Begrenzung der Anzahl von Dialogrunden und Anfragen an den KI-Agenten ist eine weitere Möglichkeit, solche Angriffe zu verhindern.

Vergiftung der Wissensbasis

Beschreibung: Diese Art von Angriff zielt nicht direkt auf den KI-Agenten ab, sondern auf die Wissensbasis und andere Dienste, die der KI-Agent nutzt. Dabei können die Daten oder Informationen, die der KI-Agent zur Erfüllung seiner Aufgaben verwendet, beschädigt werden, was zu einer verzerrten oder unerwarteten Antwort an den Benutzer führt.

Abhilfemaßnahmen: Validieren Sie regelmäßig die Daten, die der KI-Agent in seinem Arbeitsablauf verwenden wird. Stellen Sie sicher, dass der Zugriff auf diese Daten sicher ist und nur von vertrauenswürdigen Personen geändert werden kann, um solche Angriffe zu vermeiden.

Kaskadenfehler

Beschreibung: Der KI-Agent greift auf eine Vielzahl von Tools und Diensten zu, um seine Aufgaben zu erfüllen. Von einem Angreifer verursachte Fehler können dazu führen, dass andere Systeme, mit denen der KI-Agent eine Verbindung herstellt, ausfallen, wodurch sich der Angriff ausweitet und die Fehlerbehebung erschwert wird.

Abhilfemaßnahmen: Eine Möglichkeit, dies zu vermeiden, besteht darin, den KI-Agenten in einer eingeschränkten Umgebung laufen zu lassen, z. B. bei der Ausführung von Aufgaben in einem Docker-Container, um direkte Systemangriffe zu verhindern. Die Schaffung von Fallback-Mechanismen und Wiederholungslogik, wenn bestimmte Systeme nicht korrekt reagieren, ist eine weitere Möglichkeit, größere Systemausfälle zu verhindern.

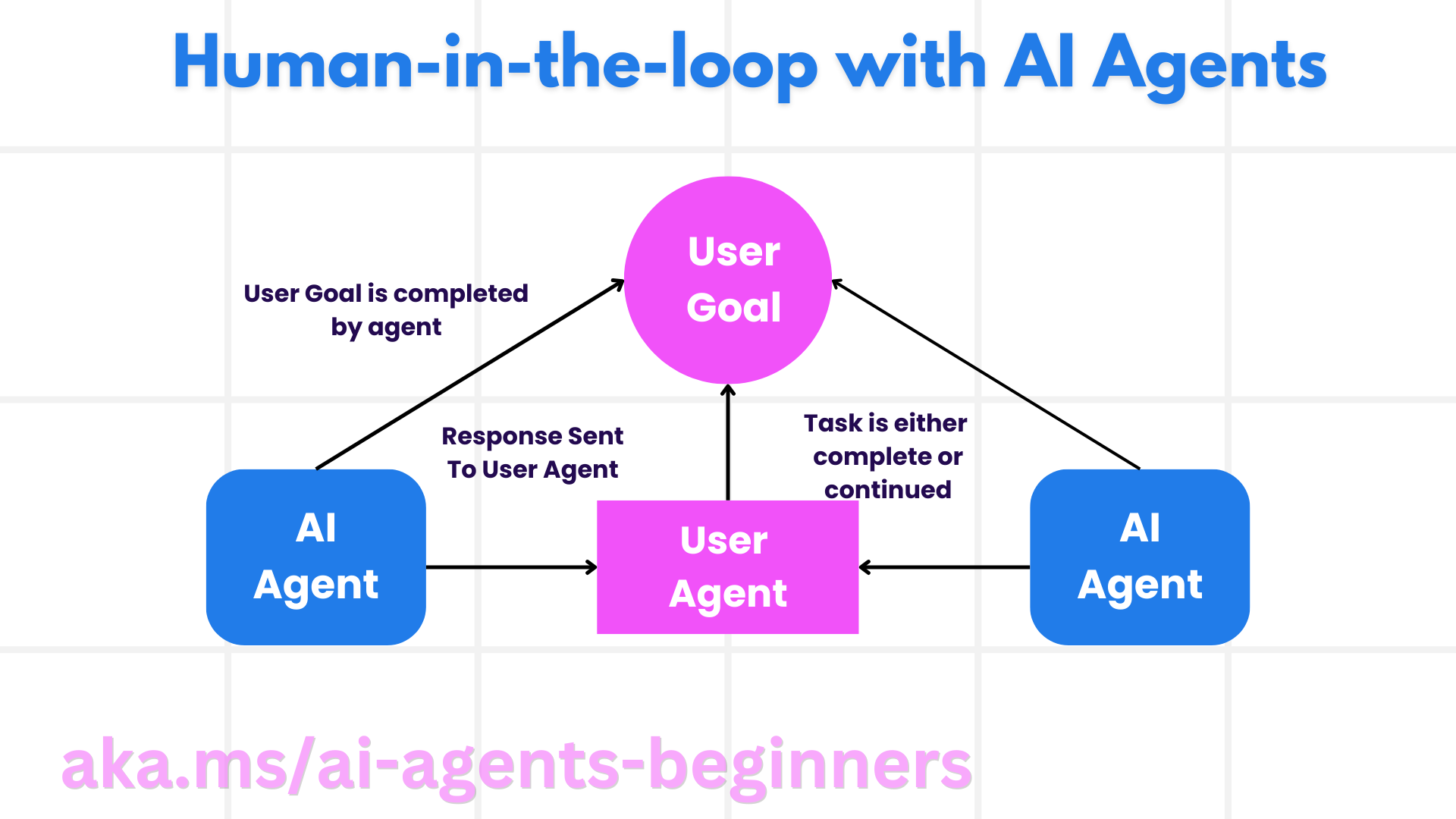

menschliches Eingreifen

Ein weiterer effektiver Weg zum Aufbau eines vertrauenswürdigen KI-Agentensystems ist das Eingreifen des Menschen. Dadurch wird ein Prozess geschaffen, bei dem der Benutzer dem Agenten während der Laufzeit Feedback geben kann. Der Benutzer agiert im Wesentlichen als Agent in einem Multi-Agentensystem, indem er einen laufenden Prozess genehmigt oder abbricht.

Es handelt sich um eine Anwendung, die die AutoGen Codefragment, das zeigt, wie dieses Konzept umgesetzt werden kann:

# 创建 agents。

model_client = OpenAIChatCompletionClient(model="gpt-4o-mini")

assistant = AssistantAgent("assistant", model_client=model_client)

user_proxy = UserProxyAgent("user_proxy", input_func=input) # 使用 input() 从控制台获取用户输入。

# 创建终止条件,当用户说“APPROVE”时,对话将结束。

termination = TextMentionTermination("APPROVE")

# 创建团队。

team = RoundRobinGroupChat([assistant, user_proxy], termination_condition=termination)

# 运行对话并流式传输到控制台。

stream = team.run_stream(task="Write a 4-line poem about the ocean.")

# 在脚本中运行时使用 asyncio.run(...)。

await Console(stream)

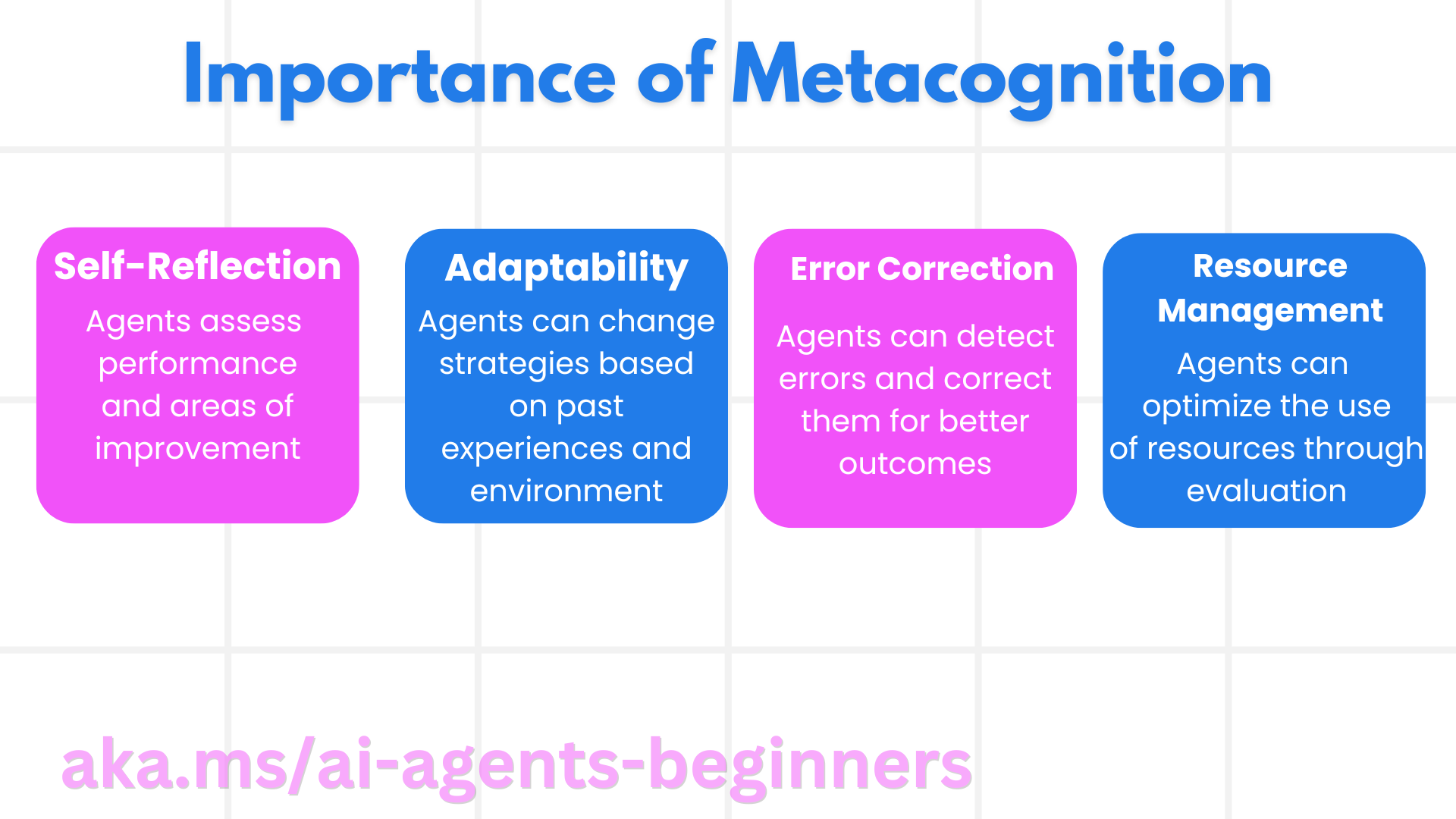

zu einem Urteil gelangen

Der Aufbau eines vertrauenswürdigen KI-Agenten erfordert ein sorgfältiges Design, starke Sicherheitsmaßnahmen und kontinuierliche Iteration. Durch die Implementierung eines strukturierten Systems von Meta-Prompts, das Verständnis potenzieller Bedrohungen und die Anwendung von Minderungsstrategien können Entwickler KI-Agenten entwickeln, die sowohl sicher als auch effektiv sind. Da sich die KI weiter entwickelt, ist eine proaktive Haltung zu Sicherheit, Datenschutz und ethischen Überlegungen der Schlüssel zur Förderung von Vertrauen und Zuverlässigkeit in KI-gesteuerten Systemen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...