Microsoft Intro to AI Agent: Erkundung des AI Agent Framework

KI-Agenten-Frameworks sind Softwareplattformen, die die Erstellung, den Einsatz und die Verwaltung von KI-Agenten vereinfachen sollen. Diese Frameworks bieten Entwicklern vorgefertigte Komponenten, Abstraktionen und Werkzeuge, um die Entwicklung komplexer KI-Systeme zu vereinfachen.

Diese Frameworks helfen den Entwicklern, sich auf die einzigartigen Aspekte ihrer Anwendungen zu konzentrieren, indem sie einen standardisierten Ansatz für allgemeine Herausforderungen bei der Entwicklung von KI-Agenten bieten. Sie verbessern die Skalierbarkeit, Zugänglichkeit und Effizienz der Entwicklung von KI-Systemen.

kurz

Dieser Kurs behandelt:

- Was sind KI-Agenten-Frameworks und welche Möglichkeiten bieten sie Entwicklern?

- Wie können Teams diese Frameworks nutzen, um schnell Prototypen zu erstellen, zu iterieren und die Fähigkeiten von Agent zu verbessern?

- Was ist der Unterschied zwischen den von Microsoft AutoGen, Semantic Kernel und Azure AI Agent entwickelten Frameworks und Tools?

- Ist eine direkte Integration in bestehende Azure-Ökosystem-Tools möglich oder benötige ich eine eigenständige Lösung?

- Was ist der Azure AI Agents Service und wie kann er helfen?

Lernziel

Das Ziel dieses Kurses ist es, Ihnen zu helfen, zu verstehen:

- Die Rolle von KI-Agenten-Rahmenwerken in der KI-Entwicklung.

- Wie man mit dem AI Agent Framework intelligente Agenten entwickelt.

- Die wichtigsten Funktionen des AI Agent Frameworks.

- Unterschiede zwischen AutoGen, Semantic Kernel und Azure AI Agent Service.

Was sind KI-Agenten-Frameworks und welche Möglichkeiten bieten sie Entwicklern?

Herkömmliche KI-Frameworks können Ihnen dabei helfen, KI in Ihre Anwendungen zu integrieren und diese Anwendungen dadurch zu verbessern:

- PersonalisierteKI kann das Nutzerverhalten und die Vorlieben analysieren, um personalisierte Empfehlungen, Inhalte und Erlebnisse zu liefern. Streaming-Dienste wie Netflix beispielsweise nutzen KI, um Filme und Serien auf der Grundlage des Nutzungsverhaltens zu empfehlen und so das Engagement und die Zufriedenheit der Nutzer zu steigern.

- Automatisierung und Effizienz: KI kann sich wiederholende Aufgaben automatisieren, Arbeitsabläufe rationalisieren und die betriebliche Effizienz verbessern. In Kundendienstanwendungen werden beispielsweise KI-gesteuerte Chatbots eingesetzt, um häufige Anfragen zu bearbeiten, die Antwortzeiten zu verkürzen und es den menschlichen Mitarbeitern zu ermöglichen, komplexere Probleme zu lösen.

- Verbessertes BenutzererlebnisKI: KI kann das Nutzererlebnis insgesamt verbessern, indem sie intelligente Funktionen wie Spracherkennung, Verarbeitung natürlicher Sprache und Textvorhersage bietet. So nutzen beispielsweise virtuelle Assistenten wie Siri und Google Assistant KI, um Sprachbefehle zu verstehen und darauf zu reagieren, was den Nutzern die Interaktion mit ihren Geräten erleichtert.

Das klingt alles großartig, oder? Warum brauchen wir also ein KI-Agenten-Framework?

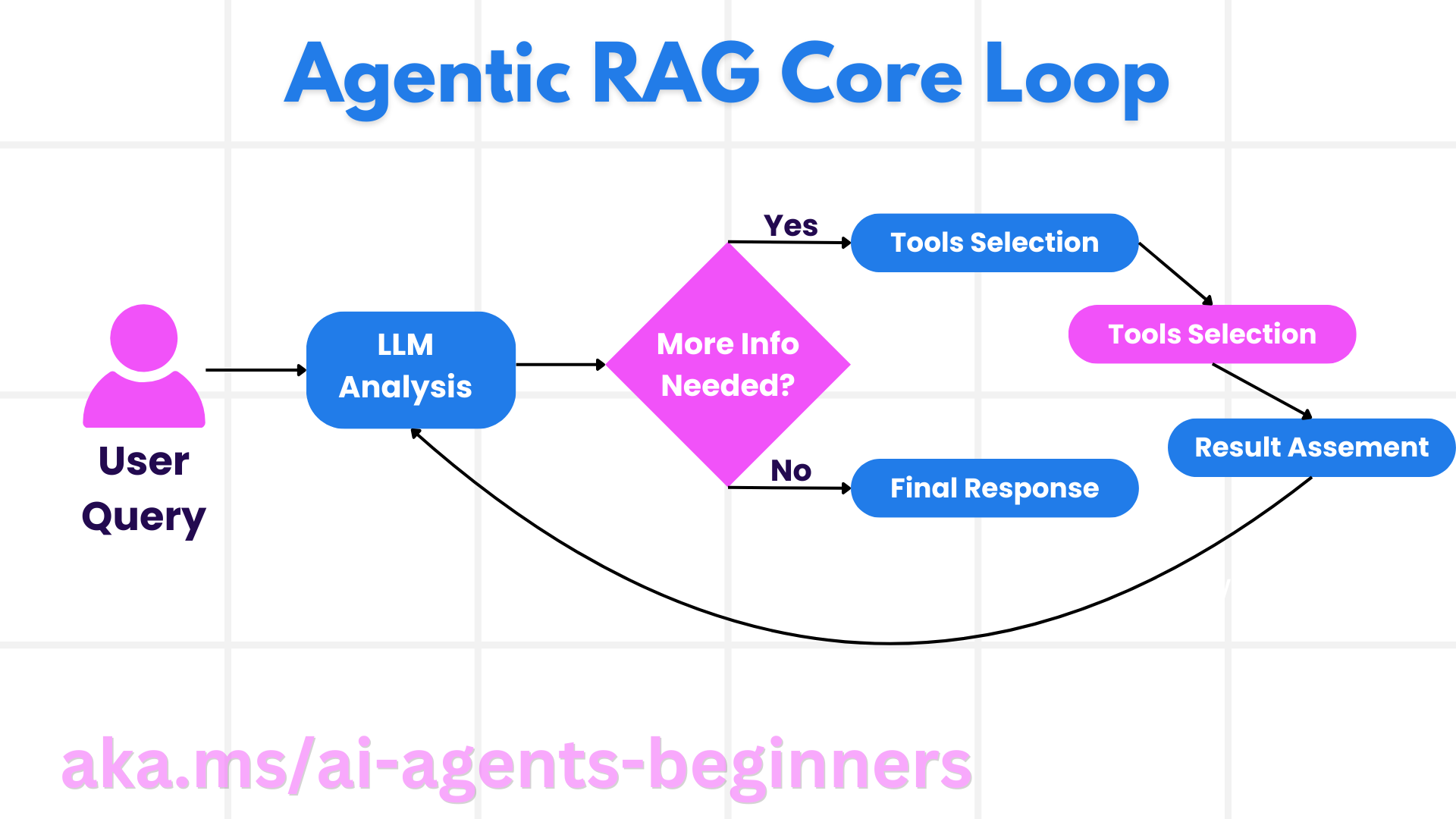

KI-Agent-Frameworks sind mehr als nur KI-Frameworks. Sie wurden entwickelt, um intelligente Agenten zu schaffen, die mit Benutzern, anderen Agenten und der Umgebung interagieren können, um bestimmte Ziele zu erreichen, und die ein autonomes Verhalten zeigen, Entscheidungen treffen und sich an veränderte Bedingungen anpassen können. Werfen wir einen Blick auf einige der wichtigsten Funktionen, die von KI-Agenten-Frameworks implementiert werden:

- Agent Zusammenarbeit und KoordinationUnterstützt die Erstellung mehrerer KI-Agenten, die zusammenarbeiten, kommunizieren und koordinieren können, um komplexe Aufgaben zu lösen.

- Automatisierung und Verwaltung von AufgabenBietet Mechanismen zur Automatisierung von mehrstufigen Arbeitsabläufen, zur Aufgabendelegation und zum dynamischen Aufgabenmanagement zwischen Agenten.

- Verständnis des Kontextes und AnpassungErmöglicht es dem Agenten, den Kontext zu verstehen, sich an veränderte Umgebungen anzupassen und Entscheidungen auf der Grundlage von Echtzeitinformationen zu treffen.

Kurz gesagt: Agenten ermöglichen es Ihnen, mehr zu tun, die Automatisierung auf die nächste Stufe zu heben und intelligentere Systeme zu schaffen, die sich an ihre Umgebung anpassen und von ihr lernen können.

Wie kann ich schnell Prototypen erstellen, iterieren und die Fähigkeiten von Agent verbessern?

Es handelt sich um ein sich schnell entwickelndes Feld, aber die meisten KI-Agenten-Frameworks haben ein paar Dinge gemeinsam, die Ihnen helfen können, Prototypen zu erstellen und schnell zu iterieren, nämlich modulare Komponenten, Tools für die Zusammenarbeit und Echtzeitlernen. Lassen Sie uns in diese eintauchen:

- Verwendung modularer KomponentenDas AI Framework bietet vorgefertigte Komponenten wie Hinweise, Parser und Speicherverwaltung.

- Nutzung von Tools zur ZusammenarbeitDesign Agents mit spezifischen Rollen und Aufgaben, damit sie kollaborative Arbeitsabläufe testen und verbessern können.

- Lernen in EchtzeitEs wird eine Rückkopplungsschleife erreicht, in der der Agent aus der Interaktion lernt und sein Verhalten dynamisch anpasst.

Verwendung modularer Komponenten

Frameworks wie LangChain und Microsoft Semantic Kernel bieten vorgefertigte Komponenten wie Hints, Parser und Speicherverwaltung.

Wie nutzen die Teams dieseTeams können diese Komponenten schnell zusammensetzen, um einen funktionalen Prototyp zu erstellen, ohne bei Null anfangen zu müssen, was schnelle Experimente und Iterationen ermöglicht.

Wie es in der Praxis funktioniertSie können vorgefertigte Parser verwenden, um Informationen aus Benutzereingaben zu extrahieren, In-Memory-Module, um Daten zu speichern und abzurufen, und Prompt-Generatoren, um mit Benutzern zu interagieren, ohne dass Sie diese Komponenten von Grund auf neu erstellen müssen.

Beispielcode (Rechnen). Sehen wir uns ein Beispiel dafür an, wie Informationen aus Benutzereingaben mithilfe eines vorgefertigten Parsers extrahiert werden können:

// Semantic Kernel 示例

ChatHistory chatHistory = [];

chatHistory.AddUserMessage("I'd like to go To New York");

// 定义一个包含预订旅行功能的插件

public class BookTravelPlugin(

IPizzaService pizzaService,

IUserContext userContext,

IPaymentService paymentService)

{

[KernelFunction("book_flight")]

[Description("Book travel given location and date")]

public async Task<Booking> BookFlight(

DateTime date,

string location,

)

{

// 根据日期、地点预订旅行

}

}

IKernelBuilder kernelBuilder = new KernelBuilder();

kernelBuilder..AddAzureOpenAIChatCompletion(

deploymentName: "NAME_OF_YOUR_DEPLOYMENT",

apiKey: "YOUR_API_KEY",

endpoint: "YOUR_AZURE_ENDPOINT"

);

kernelBuilder.Plugins.AddFromType<BookTravelPlugin>("BookTravel");

Kernel kernel = kernelBuilder.Build();

/*

在后台,它识别要调用的工具、它已经具有的参数 (location) 和它需要的参数 (date)

{

"tool_calls": [

{

"id": "call_abc123",

"type": "function",

"function": {

"name": "BookTravelPlugin-book_flight",

"arguments": "{\n\"location\": \"New York\",\n\"date\": \"\"\n}"

}

}

]

*/

ChatResponse response = await chatCompletion.GetChatMessageContentAsync(

chatHistory,

executionSettings: openAIPromptExecutionSettings,

kernel: kernel)

Console.WriteLine(response);

chatHistory.AddAssistantMessage(response);

// AI 响应:"Before I can book your flight, I need to know your departure date. When are you planning to travel?"

// 也就是说,在前面的代码中,它找出了要调用的工具,它已经拥有的参数 (location) 以及它从用户输入中需要的参数 (date),此时它最终会向用户询问缺失的信息

Anhand dieses Beispiels können Sie sehen, wie ein vorgefertigter Parser verwendet werden kann, um Schlüsselinformationen aus Benutzereingaben zu extrahieren, z. B. den Abflugort, das Ziel und das Datum einer Flugbuchungsanfrage. Dieser modulare Ansatz ermöglicht es Ihnen, sich auf die High-Level-Logik zu konzentrieren.

Nutzung von Tools zur Zusammenarbeit

CrewAI und Microsoft AutoGen Rahmenwerke wie dieses erleichtern die Schaffung von mehreren Agenten, die zusammenarbeiten können.

Wie nutzen die Teams dieseTeams können Agenten mit bestimmten Rollen und Aufgaben ausstatten, um gemeinsame Arbeitsabläufe zu testen und zu verbessern und die Effizienz des Systems insgesamt zu steigern.

Wie es in der Praxis funktioniertAgenten: Sie können ein Team von Agenten bilden, von denen jeder eine spezielle Funktion hat, z. B. Datenabfrage, Analyse oder Entscheidungsfindung. Diese Agenten können kommunizieren und Informationen austauschen, um gemeinsame Ziele zu erreichen, z. B. die Beantwortung von Benutzeranfragen oder die Erledigung von Aufgaben.

Beispielcode (AutoGen)::

# 创建 Agent,然后创建一个循环调度,让他们可以协同工作,在本例中是按顺序

# 数据检索 Agent

# 数据分析 Agent

# 决策 Agent

agent_retrieve = AssistantAgent(

name="dataretrieval",

model_client=model_client,

tools=[retrieve_tool],

system_message="Use tools to solve tasks."

)

agent_analyze = AssistantAgent(

name="dataanalysis",

model_client=model_client,

tools=[analyze_tool],

system_message="Use tools to solve tasks."

)

# 当用户说 "APPROVE" 时,对话结束

termination = TextMentionTermination("APPROVE")

user_proxy = UserProxyAgent("user_proxy", input_func=input)

team = RoundRobinGroupChat([agent_retrieve, agent_analyze, user_proxy], termination_condition=termination)

stream = team.run_stream(task="Analyze data", max_turns=10)

# 在脚本中运行时使用 asyncio.run(...)。

await Console(stream)

Im vorangegangenen Code haben Sie gesehen, wie man eine Aufgabe erstellt, bei der mehrere Agenten zusammenarbeiten, um Daten zu analysieren. Jeder Agent führt eine bestimmte Funktion aus und koordiniert die Agenten, um die Aufgabe auszuführen und die gewünschten Ergebnisse zu erzielen. Durch die Erstellung dedizierter Agenten mit spezialisierten Rollen können Sie die Effizienz und Leistung der Aufgabe verbessern.

Lernen in Echtzeit

Das Advanced Framework bietet kontextbezogenes Verständnis und Anpassung in Echtzeit.

Wie Teams diese Rahmenwerke nutzenTeams können Feedback-Schleifen implementieren, die es den Agenten ermöglichen, aus Interaktionen zu lernen und ihr Verhalten dynamisch anzupassen, was zu einer kontinuierlichen Verbesserung und Verfeinerung der Fähigkeiten führt.

praktische AnwendungAgenten können Benutzerfeedback, Umgebungsdaten und Aufgabenergebnisse analysieren, um ihre Wissensbasis zu aktualisieren, Entscheidungsalgorithmen anzupassen und die Leistung im Laufe der Zeit zu verbessern. Dieser iterative Lernprozess ermöglicht es den Agenten, sich an veränderte Bedingungen und Benutzerpräferenzen anzupassen und so die Effizienz des Systems insgesamt zu verbessern.

Was ist der Unterschied zwischen AutoGen, Semantic Kernel und dem Azure AI Agent Service Framework?

Es gibt viele Möglichkeiten, diese Frameworks zu vergleichen, aber lassen Sie uns einige Hauptunterschiede in Bezug auf ihr Design, ihre Funktionalität und ihre Zielanwendungsfälle betrachten:

AutoGen

Open-Source-Framework, entwickelt vom Microsoft Research's AI Frontiers Lab. Konzentriert sich auf ereignisgesteuerte, verteilte agentisch Anwendungen, die mehrere Large Language Models (LLMs) und SLMs, Tools und fortgeschrittene Multi-Agent-Designmuster unterstützen.

Das Kernkonzept von AutoGen sind Agenten, d. h. autonome Einheiten, die ihre Umgebung wahrnehmen, Entscheidungen treffen und Maßnahmen ergreifen können, um bestimmte Ziele zu erreichen. Agenten kommunizieren über asynchrone Nachrichtenübermittlung, so dass sie unabhängig und parallel arbeiten können, was die Skalierbarkeit und Reaktionsfähigkeit des Systems erhöht.

Agenten basieren auf Akteursmodellen. Laut Wikipedia ist ein Schauspieler Die Grundbausteine der gleichzeitigen Berechnung. Als Reaktion auf eine eingehende Nachricht kann ein Akteur: lokale Entscheidungen treffen, weitere Akteure erstellen, weitere Nachrichten senden und festlegen, wie er auf die nächste eingehende Nachricht reagieren soll..

AnwendungsfallAutomatisieren Sie die Codegenerierung, Datenanalyseaufgaben und den Aufbau benutzerdefinierter Intelligenzen (Agenten) für Planungs- und Forschungsfunktionen.

Hier sind einige der wichtigsten Kernkonzepte von AutoGen:

- Agenten. Ein intelligenter Körper (Agent) ist eine Softwareeinheit, die:

- Kommunikation über NachrichtenDiese Nachrichten können synchron oder asynchron sein.

- Aufrechterhaltung des eigenen StatusDieser Zustand kann durch eingehende Nachrichten verändert werden.

- ausführbare Operation als Reaktion auf eine empfangene Nachricht oder eine Änderung seines Zustands. Diese Aktionen können den Zustand des Agenten ändern und externe Auswirkungen haben, wie z. B. das Aktualisieren des Nachrichtenprotokolls, das Senden neuer Nachrichten, das Ausführen von Code oder das Durchführen von API-Aufrufen.

Nachfolgend finden Sie einen kurzen Codeschnipsel, mit dem Sie einen Agenten mit Chatfunktion erstellen können:

from autogen_agentchat.agents import AssistantAgent from autogen_agentchat.messages import TextMessage from autogen_ext.models.openai import OpenAIChatCompletionClient class MyAssistant(RoutedAgent): def __init__(self, name: str) -> None: super().__init__(name) model_client = OpenAIChatCompletionClient(model="gpt-4o") self._delegate = AssistantAgent(name, model_client=model_client) @message_handler async def handle_my_message_type(self, message: MyMessageType, ctx: MessageContext) -> None: print(f"{self.id.type} received message: {message.content}") response = await self._delegate.on_messages( [TextMessage(content=message.content, source="user")], ctx.cancellation_token ) print(f"{self.id.type} responded: {response.chat_message.content}")Im vorangegangenen Code ist die

MyAssistantwurde erstellt und geerbt vonRoutedAgent. Es hat einen Message-Handler, der den Inhalt der Nachricht ausgibt und dann dieAssistantAgentDelegieren Sie das Senden der Antwort. Achten Sie besonders darauf, wie wir die Antwort delegieren.AssistantAgentDie Instanz desself._delegate(math.) GattungAssistantAgentist eine vorgefertigte Intelligenz (Agent), die Chat-Ergänzungen verarbeiten kann.

Als nächstes teilen Sie AutoGen den Agententyp mit und starten das Programm:# main.py runtime = SingleThreadedAgentRuntime() await MyAgent.register(runtime, "my_agent", lambda: MyAgent()) runtime.start() # Start processing messages in the background. await runtime.send_message(MyMessageType("Hello, World!"), AgentId("my_agent", "default"))Im vorangehenden Code werden Agenten bei der Laufzeitumgebung registriert und anschließend Nachrichten an den Agenten gesendet, um die folgende Ausgabe zu erzeugen:

# Output from the console: my_agent received message: Hello, World! my_assistant received message: Hello, World! my_assistant responded: Hello! How can I assist you today? - MehrfachagentenAutoGen unterstützt die Erstellung mehrerer Agenten, die zusammenarbeiten können, um komplexe Aufgaben zu bewältigen. Agenten können kommunizieren, Informationen austauschen und ihre Aktionen koordinieren, um Probleme effektiver zu lösen. Um ein Multi-Agenten-System zu erstellen, definieren Sie verschiedene Arten von Agenten mit speziellen Funktionen und Rollen, wie z. B. Datenabfrage, Analyse, Entscheidungsfindung und Benutzerinteraktion. Schauen wir uns an, wie eine solche Kreation aussieht, damit wir sie verstehen können:

editor_description = "Editor for planning and reviewing the content."

# Example of declaring an Agent

editor_agent_type = await EditorAgent.register(

runtime,

editor_topic_type, # Using topic type as the agent type.

lambda: EditorAgent(

description=editor_description,

group_chat_topic_type=group_chat_topic_type,

model_client=OpenAIChatCompletionClient(

model="gpt-4o-2024-08-06",

# api_key="YOUR_API_KEY",

),

),

)

# remaining declarations shortened for brevity

# Group chat

group_chat_manager_type = await GroupChatManager.register(

runtime,

"group_chat_manager",

lambda: GroupChatManager(

participant_topic_types=[writer_topic_type, illustrator_topic_type, editor_topic_type, user_topic_type],

model_client=OpenAIChatCompletionClient(

model="gpt-4o-2024-08-06",

# api_key="YOUR_API_KEY",

),

participant_descriptions=[

writer_description,

illustrator_description,

editor_description,

user_description

],

),

)

Im vorherigen Code haben wir eine GroupChatManagerEr ist bei der Laufzeitumgebung registriert. Dieser Manager ist für die Koordinierung der Interaktionen zwischen verschiedenen Arten von Agenten, wie Autoren, Illustratoren, Redakteuren und Benutzern, zuständig.

- Agent LaufzeitDas Framework bietet eine Laufzeitumgebung, die die Kommunikation zwischen Agenten unterstützt und die Grenzen der Sicherheit und des Datenschutzes durchsetzt. Das Framework bietet eine Laufzeitumgebung, die die Kommunikation zwischen Agenten unterstützt, ihre Identität und ihren Lebenszyklus verwaltet und Sicherheits- und Datenschutzgrenzen durchsetzt. Dies bedeutet, dass Sie Ihre Agenten in einer sicheren und kontrollierten Umgebung ausführen können, um sicherzustellen, dass sie sicher und effizient interagieren können. Es gibt zwei Laufzeiten, die von Interesse sind:

- Eigenständige LaufzeitDies ist eine gute Wahl für Einzelprozessanwendungen, bei denen alle Agenten in der gleichen Programmiersprache implementiert sind und im gleichen Prozess ausgeführt werden. Dies ist eine gute Wahl für Einzelprozessanwendungen, bei denen alle Agenten in der gleichen Programmiersprache implementiert sind und im gleichen Prozess ausgeführt werden. Das folgende Diagramm zeigt, wie es funktioniert:

Eigenständige Laufzeit

Anwendungsstapel

Agenten kommunizieren über Nachrichten durch die Laufzeitumgebung, die den Lebenszyklus der Agenten verwaltet. - Verteilte Agenten-LaufzeitDies gilt für Multiprozess-Anwendungen, bei denen Agenten in verschiedenen Programmiersprachen implementiert und auf verschiedenen Rechnern ausgeführt werden können. Hier ist eine Illustration, wie es funktioniert:

Verteilte Laufzeit

- Eigenständige LaufzeitDies ist eine gute Wahl für Einzelprozessanwendungen, bei denen alle Agenten in der gleichen Programmiersprache implementiert sind und im gleichen Prozess ausgeführt werden. Dies ist eine gute Wahl für Einzelprozessanwendungen, bei denen alle Agenten in der gleichen Programmiersprache implementiert sind und im gleichen Prozess ausgeführt werden. Das folgende Diagramm zeigt, wie es funktioniert:

Semantischer Kernel + Agent Framework

Der Semantic Kernel besteht aus zwei Teilen, dem Semantic Kernel Agent Framework und dem Semantic Kernel selbst.

Lassen Sie uns kurz über den Semantic Kernel sprechen, der die folgenden Kernkonzepte umfasst:

- VerbindungenSchnittstelle zu externen KI-Diensten und Datenquellen.

using Microsoft.SemanticKernel;

// Create kernel

var builder = Kernel.CreateBuilder();

// Add a chat completion service:

builder.Services.AddAzureOpenAIChatCompletion(

"your-resource-name",

"your-endpoint",

"your-resource-key",

"deployment-model");

var kernel = builder.Build();

Der Semantic Kernel erstellt eine Verbindung zu einem externen KI-Dienst, in diesem Fall Azure OpenAI Chat Completion.

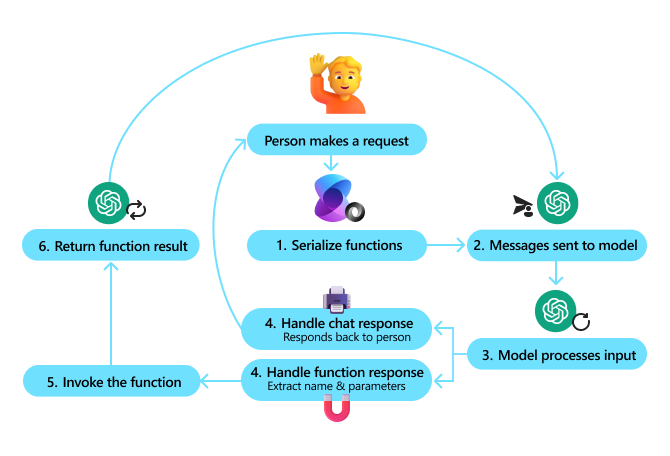

- PluginsPlugin: Kapselt Funktionen, die eine Anwendung verwenden kann. Es gibt sowohl fertige Plug-ins als auch Plug-ins, die Sie selbst erstellen können. Es gibt ein Konzept namens Semantische Funktionen. Semantisch ist es deshalb, weil Sie es mit semantischen Informationen versehen, damit der Semantische Kernel feststellen kann, dass er die Funktion aufrufen muss. Hier ist ein Beispiel:

var userInput = Console.ReadLine();

// Define semantic function inline.

string skPrompt = @"Summarize the provided unstructured text in a sentence that is easy to understand.

Text to summarize: {{$userInput}}";

// Register the function

kernel.CreateSemanticFunction(

promptTemplate: skPrompt,

functionName: "SummarizeText",

pluginName: "SemanticFunctions"

);

Hier starten Sie mit einem Vorlagentipp skPromptEs überlässt dem Benutzer die Eingabe von Text $userInput Bereich des Plugins. Sie verwenden dann das Plugin SemanticFunctions eingetragene Funktion SummarizeText. Beachten Sie den Namen der Funktion, der dem Semantischen Kernel hilft zu verstehen, was die Funktion tut und wann sie aufgerufen werden soll.

- Einheimische FunktionEs gibt auch native Funktionen, die das Framework direkt aufrufen kann, um Aufgaben zu erfüllen. Nachfolgend ein Beispiel für solche Funktionen, die Inhalte aus einer Datei abrufen:

public class NativeFunctions {

[SKFunction, Description("Retrieve content from local file")]

public async Task<string> RetrieveLocalFile(string fileName, int maxSize = 5000)

{

string content = await File.ReadAllTextAsync(fileName);

if (content.Length <= maxSize) return content;

return content.Substring(0, maxSize);

}

}

//Import native function

string plugInName = "NativeFunction";

string functionName = "RetrieveLocalFile";

var nativeFunctions = new NativeFunctions();

kernel.ImportFunctions(nativeFunctions, plugInName);

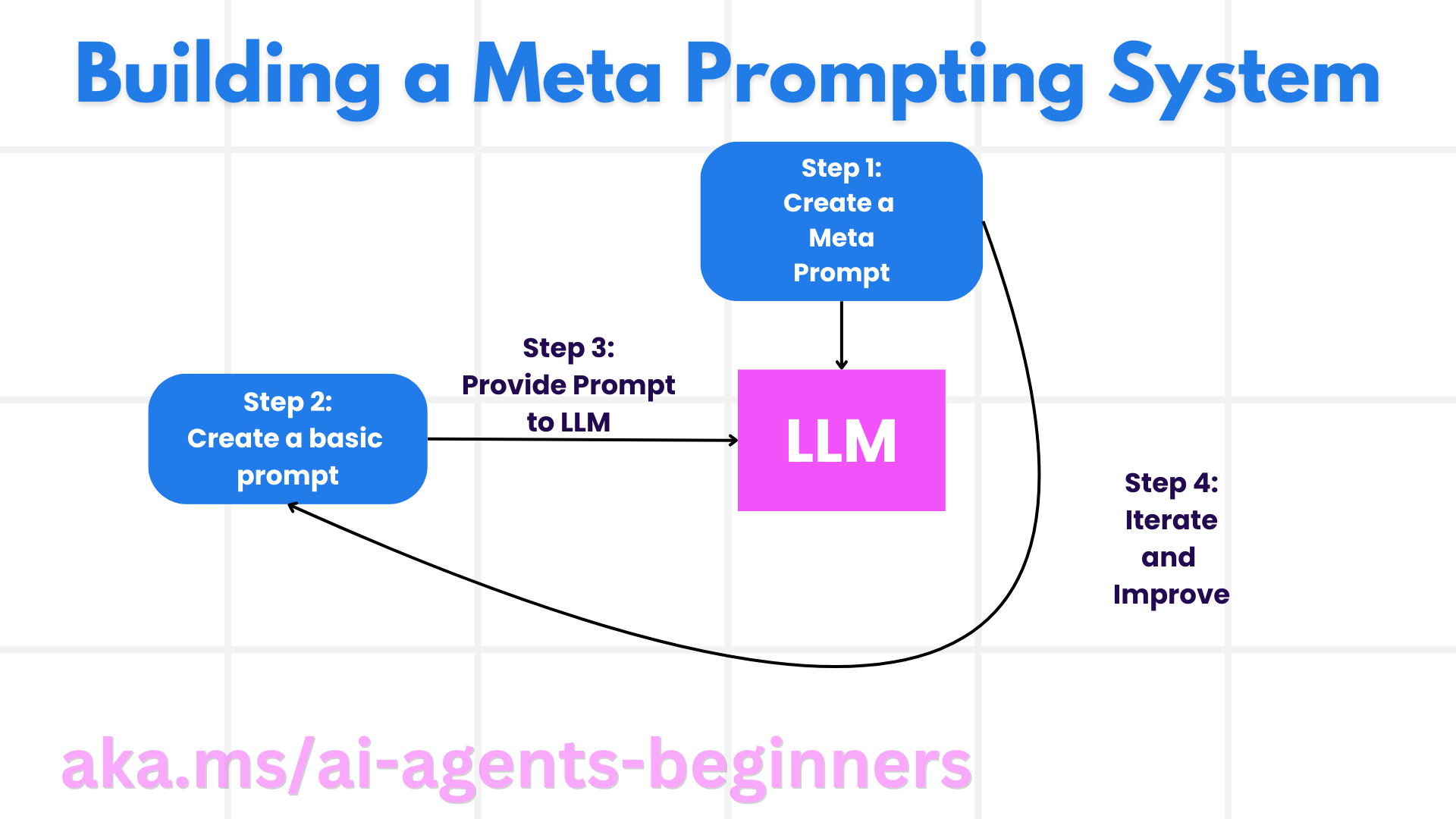

- PlanerPlaner: Der Planer orchestriert Ausführungspläne und Richtlinien auf der Grundlage von Benutzereingaben. Die Idee besteht darin, auszudrücken, wie die Ausführung erfolgen soll, und dies dann zu einer Anweisung für den Semantic Kernel zu machen. Dieser ruft dann die notwendigen Funktionen auf, um die Aufgaben auszuführen. Im Folgenden wird ein Beispiel für einen solchen Plan gegeben:

string planDefinition = "Read content from a local file and summarize the content.";

SequentialPlanner sequentialPlanner = new SequentialPlanner(kernel);

string assetsFolder = @"../../assets";

string fileName = Path.Combine(assetsFolder,"docs","06_SemanticKernel", "aci_documentation.txt");

ContextVariables contextVariables = new ContextVariables();

contextVariables.Add("fileName", fileName);

var customPlan = await sequentialPlanner.CreatePlanAsync(planDefinition);

// Execute the plan

KernelResult kernelResult = await kernel.RunAsync(contextVariables, customPlan);

Console.WriteLine($"Summarization: {kernelResult.GetValue<string>()}");

besondere Aufmerksamkeit planDefinitiondas ist die einfache Anweisung, der der Planer folgt. Die entsprechende Funktion wird dann gemäß diesem Plan aufgerufen, in diesem Fall unsere semantische Funktion SummarizeText und einheimische Funktionen RetrieveLocalFile.

- SpeicherAbstraktion und Vereinfachung der Kontextverwaltung für KI-Anwendungen. Die Idee des Speichers ist, dass dies etwas ist, das das Large Language Model (LLM) wissen sollte. Sie können diese Informationen in einem Vektorspeicher speichern, der schließlich zu einer In-Memory-Datenbank oder einer Vektordatenbank oder etwas Ähnlichem wird. Hier ist ein sehr vereinfachtes Beispiel für ein Szenario, in dem die Fakten wird dem Speicher hinzugefügt:

var facts = new Dictionary<string,string>();

facts.Add(

"Azure Machine Learning; https://learn.microsoft.com/azure/machine-learning/",

@"Azure Machine Learning is a cloud service for accelerating and

managing the machine learning project lifecycle. Machine learning professionals,

data scientists, and engineers can use it in their day-to-day workflows"

);

facts.Add(

"Azure SQL Service; https://learn.microsoft.com/azure/azure-sql/",

@"Azure SQL is a family of managed, secure, and intelligent products

that use the SQL Server database engine in the Azure cloud."

);

string memoryCollectionName = "SummarizedAzureDocs";

foreach (var fact in facts) {

await memoryBuilder.SaveReferenceAsync(

collection: memoryCollectionName,

description: fact.Key.Split(";")[1].Trim(),

text: fact.Value,

externalId: fact.Key.Split(";")[2].Trim(),

externalSourceName: "Azure Documentation"

);

}

Diese Fakten werden dann in der Speichersammlung gespeichert SummarizedAzureDocs im Speicher. Dies ist ein sehr vereinfachtes Beispiel, aber Sie können sehen, wie Informationen im Speicher zur Verwendung im Large Language Model (LLM) gespeichert werden können.

Das sind die Grundlagen des Semantic Kernel Frameworks, was ist mit dem Agent Framework?

Azure AI Agent Service

Der Azure AI Agent Service ist ein neueres Mitglied, das auf der Microsoft Ignite 2024 vorgestellt wurde. Er ermöglicht die Entwicklung und den Einsatz von KI-Agenten mit flexibleren Modellen, wie dem direkten Aufruf von Open-Source-LLMs (Large Language Models) wie Llama 3, Mistral und Cohere.

Azure AI Agent Service bietet stärkere Sicherheitsmechanismen für Unternehmen und Methoden zur Datenspeicherung, die ihn für Unternehmensanwendungen geeignet machen.

Es funktioniert sofort mit Multi-Agent-Orchestrierungs-Frameworks wie AutoGen und Semantic Kernel.

Dieser Dienst befindet sich derzeit in der öffentlichen Vorschau und unterstützt Python und C# für die Erstellung von Agenten.

Grundlegende Konzepte

Der Azure AI Agent Service umfasst die folgenden Kernkonzepte:

- AgentDer Azure AI Agent Service ist mit Azure AI Foundry integriert. In AI Foundry agieren KI-Intelligenzen (Agenten) als "intelligente" Microservices, die zur Beantwortung von Fragen verwendet werden können (RAG), Operationen durchzuführen oder Arbeitsabläufe vollständig zu automatisieren. Dies geschieht durch die Kombination der Fähigkeiten generativer KI-Modelle mit Tools, die ihnen den Zugriff auf und die Interaktion mit realen Datenquellen ermöglichen. Unten sehen Sie ein Beispiel für einen Agenten:

agent = project_client.agents.create_agent(

model="gpt-4o-mini",

name="my-agent",

instructions="You are helpful agent",

tools=code_interpreter.definitions,

tool_resources=code_interpreter.resources,

)

In diesem Beispiel wird ein Modell erstellt mit dem Modell gpt-4o-miniName my-agent und Weisungen You are helpful agent Der Agent ist mit Werkzeugen und Ressourcen zur Durchführung von Code-Interpretationsaufgaben ausgestattet. Der Agent ist mit Werkzeugen und Ressourcen zur Durchführung von Code-Interpretationsaufgaben ausgestattet.

- Thema und Meldungen. Thread ist ein weiteres wichtiges Konzept. Er stellt einen Dialog oder eine Interaktion zwischen einem Agenten und einem Benutzer dar. Threads können verwendet werden, um den Fortschritt eines Dialogs zu verfolgen, Kontextinformationen zu speichern und den Zustand einer Interaktion zu verwalten. Hier ist ein Beispiel für einen Thread:

thread = project_client.agents.create_thread()

message = project_client.agents.create_message(

thread_id=thread.id,

role="user",

content="Could you please create a bar chart for the operating profit using the following data and provide the file to me? Company A: $1.2 million, Company B: $2.5 million, Company C: $3.0 million, Company D: $1.8 million",

)

# Ask the agent to perform work on the thread

run = project_client.agents.create_and_process_run(thread_id=thread.id, agent_id=agent.id)

# Fetch and log all messages to see the agent's response

messages = project_client.agents.list_messages(thread_id=thread.id)

print(f"Messages: {messages}")

Im vorherigen Code wurde ein Thread erstellt. Danach wird eine Nachricht an den Thread gesendet. Die Nachricht wird an den Thread gesendet, indem die Funktion create_and_process_runDer Agent wird dann aufgefordert, die Arbeit an dem Thread auszuführen. Schließlich werden Nachrichten erfasst und protokolliert, um die Antwort des Agenten zu sehen. Nachrichten zeigen den Fortschritt des Dialogs zwischen dem Benutzer und dem Agenten an. Es ist auch wichtig zu verstehen, dass Nachrichten von verschiedenen Typen sein können, wie z. B. Text, Bilder oder Dateien, bei denen die Arbeit der Agenten z. B. zu einer Bild- oder Textantwort führt. Als Entwickler können Sie diese Informationen nutzen, um die Antwort weiter zu verarbeiten oder sie dem Benutzer zu präsentieren.

- Integration mit anderen KI-FrameworksDer Azure AI Agent Service kann mit anderen Frameworks wie AutoGen und Semantic Kernel interagieren. Das bedeutet, dass Sie einen Teil Ihrer Anwendung in einem der Frameworks erstellen können, z. B. indem Sie den Agent Service als Orchestrator verwenden, oder Sie können alles im Agent Service erstellen.

AnwendungsfallAzure AI Agent Service: Azure AI Agent Service ist für Unternehmensanwendungen konzipiert, die eine sichere, skalierbare und flexible Bereitstellung von KI-Intelligenzen (Agenten) erfordern.

Worin besteht der Unterschied zwischen diesen Rahmenwerken?

Es klingt, als gäbe es eine Menge Überschneidungen zwischen diesen Frameworks, aber es gibt einige wichtige Unterschiede in ihrem Design, ihrer Funktionalität und ihren Zielanwendungsfällen:

- AutoGenSchwerpunkt auf ereignisgesteuerten, verteilten agentenbasierten Anwendungen mit Unterstützung für mehrere Large Language Models (LLMs) und SLMs, Tools und fortgeschrittene Multi-Agent Design Patterns.

- Semantischer KernSchwerpunkt: Verstehen und Generieren von menschenähnlichen Textinhalten durch Erfassen tieferer semantischer Bedeutungen. Es ist darauf ausgelegt, komplexe Arbeitsabläufe zu automatisieren und Aufgaben auf der Grundlage von Projektzielen zu initiieren.

- Azure AI Agent ServiceBietet flexiblere Modelle, wie z. B. direkte Aufrufe von Open-Source-LLMs (Large Language Models) wie Llama 3, Mistral und Cohere. Bietet robustere Sicherheitsmechanismen und Datenspeichermethoden für Unternehmen, wodurch es für Unternehmensanwendungen geeignet ist.

Sie sind sich noch nicht sicher, welche Sie wählen sollen?

Anwendungsfall

Lassen Sie uns einige häufige Anwendungsfälle durchgehen, um zu sehen, ob wir Ihnen helfen können:

F: Mein Team entwickelt ein Projekt mit automatischer Codegenerierung und Datenanalyseaufgaben. Welches Framework sollten wir verwenden?

A: AutoGen ist in diesem Fall eine gute Wahl, da es sich auf ereignisgesteuerte, verteilte agentenbasierte Anwendungen konzentriert und fortgeschrittene Multi-Agent-Designmuster unterstützt.

F: Was macht AutoGen besser als Semantic Kernel und Azure AI Agent Service für diesen Anwendungsfall?

A: AutoGen wurde für ereignisgesteuerte, verteilte agentechnische Anwendungen entwickelt und eignet sich daher ideal für die Automatisierung von Codegenerierung und Datenanalyseaufgaben. Es bietet die Werkzeuge und Funktionen, die für den effizienten Aufbau komplexer Multi-Agentensysteme erforderlich sind.

F: Es klingt, als ob der Azure AI Agent Service auch hier funktioniert und Tools für die Codegenerierung und ähnliches bietet?

A: Ja, Azure AI Agent Service unterstützt auch Codegenerierung und Datenanalyseaufgaben, ist aber möglicherweise besser für Unternehmensanwendungen geeignet, die sichere, skalierbare und flexible KI-Agenten-Implementierungen erfordern. autoGen konzentriert sich mehr auf ereignisgesteuerte, verteilte agentenbasierte Anwendungen und fortgeschrittene Multi-Agenten-Designmuster. AutoGen ist mehr auf ereignisgesteuerte, verteilte agentenbasierte Anwendungen und fortgeschrittene Multi-Agenten-Designmuster ausgerichtet.

F: Sie meinen also, wenn ich in den Unternehmensbereich einsteigen möchte, sollte ich Azure AI Agent Service verwenden?

A: Ja, Azure AI Agent Service ist für Unternehmensanwendungen konzipiert, die eine sichere, skalierbare und flexible Bereitstellung von KI-Intelligenzen (Agenten) erfordern. Er bietet stärkere Sicherheitsmechanismen für Unternehmen und Methoden zur Datenspeicherung, die ihn für Unternehmensanwendungen geeignet machen.

Fassen wir die wichtigsten Unterschiede in einer Tabelle zusammen:

| Abb. Muster | Nachzählung (z.B. Wahlergebnisse) | Grundlegende Konzepte | Anwendungsfall |

|---|---|---|---|

| AutoGen | Ereignisgesteuerte, verteilte agentenbasierte Anwendungen | Agenten, Personas, Funktionen, Daten | Codegenerierung, Datenanalyseaufgaben |

| Semantischer Kern | Verstehen und Generieren humanoider Textinhalte | Agenten, modulare Komponenten, Kollaboration | Verständnis natürlicher Sprache, Erstellung von Inhalten |

| Azure AI Agent Service | Flexible Modellierung, Unternehmenssicherheit, Codegenerierung, Werkzeugaufruf | Modularität, Zusammenarbeit, Prozessorchestrierung | Sicherer, skalierbarer und flexibler Einsatz von KI-Intelligenzien (Agenten) |

Was ist der ideale Anwendungsfall für jedes dieser Frameworks?

- AutoGenEreignisgesteuerte, verteilte agentenbasierte Anwendungen, fortgeschrittenes Multi-Agenten-Designmuster. Ideal für automatisierte Code-Generierung, Datenanalyseaufgaben.

- Semantischer KernVerstehen und Erstellen von menschenähnlichen Textinhalten, Automatisieren komplexer Arbeitsabläufe und Auslösen von Aufgaben auf der Grundlage von Projektzielen. Ideal für das Verstehen natürlicher Sprache und die Generierung von Inhalten.

- Azure AI Agent ServiceFlexible Modelle, Sicherheitsmechanismen für Unternehmen und Methoden zur Datenspeicherung. Ideal für den sicheren, skalierbaren und flexiblen Einsatz von KI-Intelligenzen (Agenten) in Unternehmensanwendungen.

Kann ich die Tools direkt in mein bestehendes Azure-Ökosystem integrieren oder benötige ich eine eigenständige Lösung?

Die Antwort lautet: Ja, Sie können Ihre bestehenden Azure-Ökosystem-Tools direkt in den Azure AI Agent Service integrieren, zumal dieser so konzipiert ist, dass er nahtlos mit anderen Azure-Diensten zusammenarbeitet. Sie können zum Beispiel Bing, Azure AI Search und Azure Functions integrieren. Es gibt auch eine tiefe Integration mit Azure AI Foundry.

Für AutoGen und Semantic Kernel können Sie auch Azure-Dienste integrieren, aber dazu müssen Sie möglicherweise Azure-Dienste vom Code aus aufrufen. Eine weitere Integrationsmethode ist die Verwendung des Azure SDK, um von Ihren Agenten aus mit Azure-Diensten zu interagieren. Darüber hinaus können Sie, wie bereits erwähnt, den Azure AI Agent Service als Orchestrator für Agenten verwenden, die in AutoGen oder Semantic Kernel erstellt wurden, wodurch Sie einfachen Zugang zum Azure-Ökosystem erhalten.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...