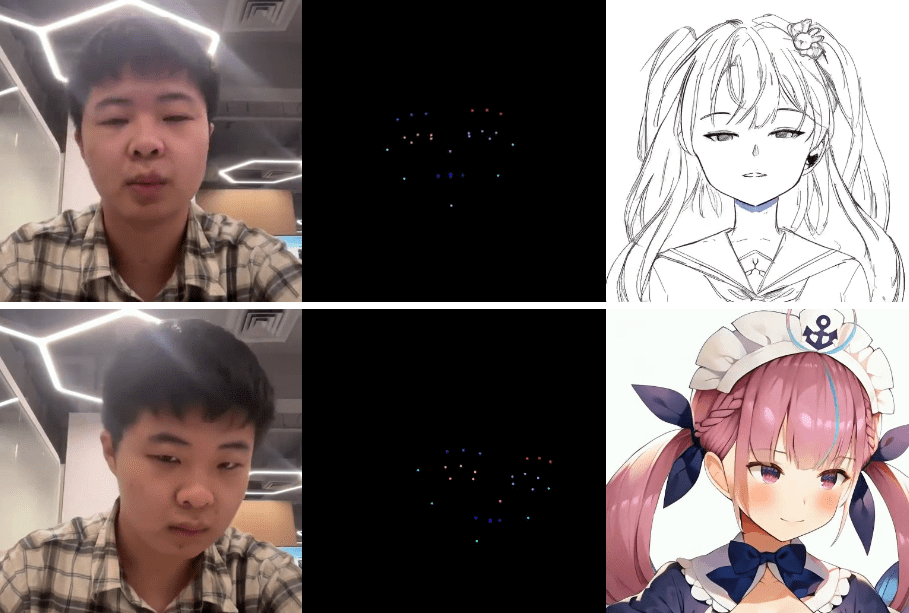

RAIN: Echtzeit-Erfassung echter menschlicher Mimik zur Erzeugung von Videoströmen mit Anime-Bildern

Allgemeine Einführung

RAIN (Real-time Animation Of Infinite Video Stream) ist ein Open-Source-Projekt, das die Echtzeit-Generierung von Animationseffekten für unendliche Videoströme ermöglicht. Das Projekt wurde von Pscgylotti entwickelt und bietet eine Lösung für die Videoerzeugung auf gängigen Benutzergeräten. Durch die Verwendung der neuesten Deep-Learning-Techniken ist RAIN in der Lage, einen kontinuierlichen Videostream auf der Grundlage der vom Benutzer hochgeladenen Bilder zu erzeugen, der für die Produktion von Animationen, Videoeffekten und anderen Bereichen geeignet ist.

RAIN produziert Echtzeit-Animationen auf Geräten der Verbraucherklasse.

Funktionsliste

- Animierte Videos in Echtzeit generieren

- Unterstützung für die Videoerstellung auf Benutzergeräten

- Bietet eine Vielzahl von vortrainierten Modellen und Gewichten

- Unterstützung für TensorRT-Beschleunigung

- Gradio-Anwendungsschnittstelle bereitstellen

- Unterstützt mehrere Parametereinstellungen für die Videoerzeugung

Hilfe verwenden

Einbauverfahren

- Stellen Sie sicher, dass Python >= 3.10 installiert ist.

- Installieren Sie PyTorch (empfohlene Version >= 2.3.0), das Sie von der offiziellen PyTorch-Website herunterladen können.

- Klonen Sie das RAIN-Projekt-Repository:

git clone https://github.com/Pscgylotti/RAIN.git

cd RAIN

- Installieren Sie die für die Argumentation erforderlichen Abhängigkeiten:

pip install -r requirements_inference.txt

Verwendungsprozess

- Laden Sie bereits trainierte Modelle und Gewichte herunter:

- Laden Sie die Original-RAIN-Gewichte von Google Drive oder Huggingface Hub herunter und legen Sie sie in die

weights/torch/Katalog. - Laden Sie die anderen erforderlichen Modelldateien herunter und legen Sie sie in den entsprechenden Verzeichnissen ab (z. B.

weights/onnx/).

- Laden Sie die Original-RAIN-Gewichte von Google Drive oder Huggingface Hub herunter und legen Sie sie in die

- Starten Sie die Gradio-Anwendung:

python gradio_app.py

Öffnen Sie Ihren Browser und besuchen Siehttp://localhost:7860/Laden Sie das Oberkörperporträt einer beliebigen Anime-Figur hoch, stellen Sie die Parameter ein und starten Sie das Gesichtsmorphing.

- Passen Sie die Parameter für die Videoerzeugung an:

- In der Gradio-Benutzeroberfläche können verschiedene Parameter nach Bedarf angepasst werden, um den besten Animationseffekt zu erzielen.

- Besonderes Augenmerk wird auf die Einstellung der augenbezogenen Parameter gelegt, um ein optimales Facial Compositing zu gewährleisten.

Detaillierte Funktionen

- Erzeugen von Videostreams in EchtzeitRAIN ist in der Lage, auf der Grundlage der vom Benutzer hochgeladenen Bilder kontinuierliche Videoströme in Echtzeit zu erzeugen, die sich für die Produktion von Animationen und Videoeffekten eignen.

- Unterstützung für vom Benutzer hochgeladene BilderBenutzer können ein beliebiges Bild hochladen und RAIN generiert einen entsprechenden Videostream auf der Grundlage des Bildes.

- Bietet eine Vielzahl von Parametern zur Anpassung der VideoerzeugungDer Benutzer kann die Generierungsparameter anpassen, um den besten Animationseffekt zu erzielen.

- Unterstützung für TensorRT-BeschleunigungTensorRT-Beschleunigung: Durch die Aktivierung der TensorRT-Beschleunigung kann RAIN die Modellkompilierung in kürzerer Zeit abschließen und so die Inferenzgeschwindigkeit erhöhen.

- Vorgefertigte Modelle zum Download verfügbarBenutzer können bereits trainierte Modelle von verschiedenen Plattformen herunterladen, um einen schnellen Start zu ermöglichen.

- Kompatibel mit mehreren Deep-Learning-FrameworksRAIN unterstützt eine Vielzahl von Deep-Learning-Frameworks wie PyTorch, was die Sekundärentwicklung erleichtert.

Hardware-Voraussetzung

- Für die Ausführung einer kompletten Inferenz-Demo werden in der Regel etwa 12 GiB an Geräte-RAM benötigt.

- Das Synthesemodell benötigt etwa 8 GiB RAM, wenn es allein ausgeführt wird.

Referenzprojekte

Das RAIN-Projekt basiert auf mehreren Open-Source-Projekten wie AnimateAnyone, Moore-AnimateAnyone, Open-AnimateAnyone usw. und kombiniert die Vorteile dieser Projekte, um eine effiziente Echtzeit-Animationserzeugung zu erreichen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...