Ollama OCR: Extrahieren von Text aus Bildern mithilfe visueller Modelle in Ollama

Allgemeine Einführung

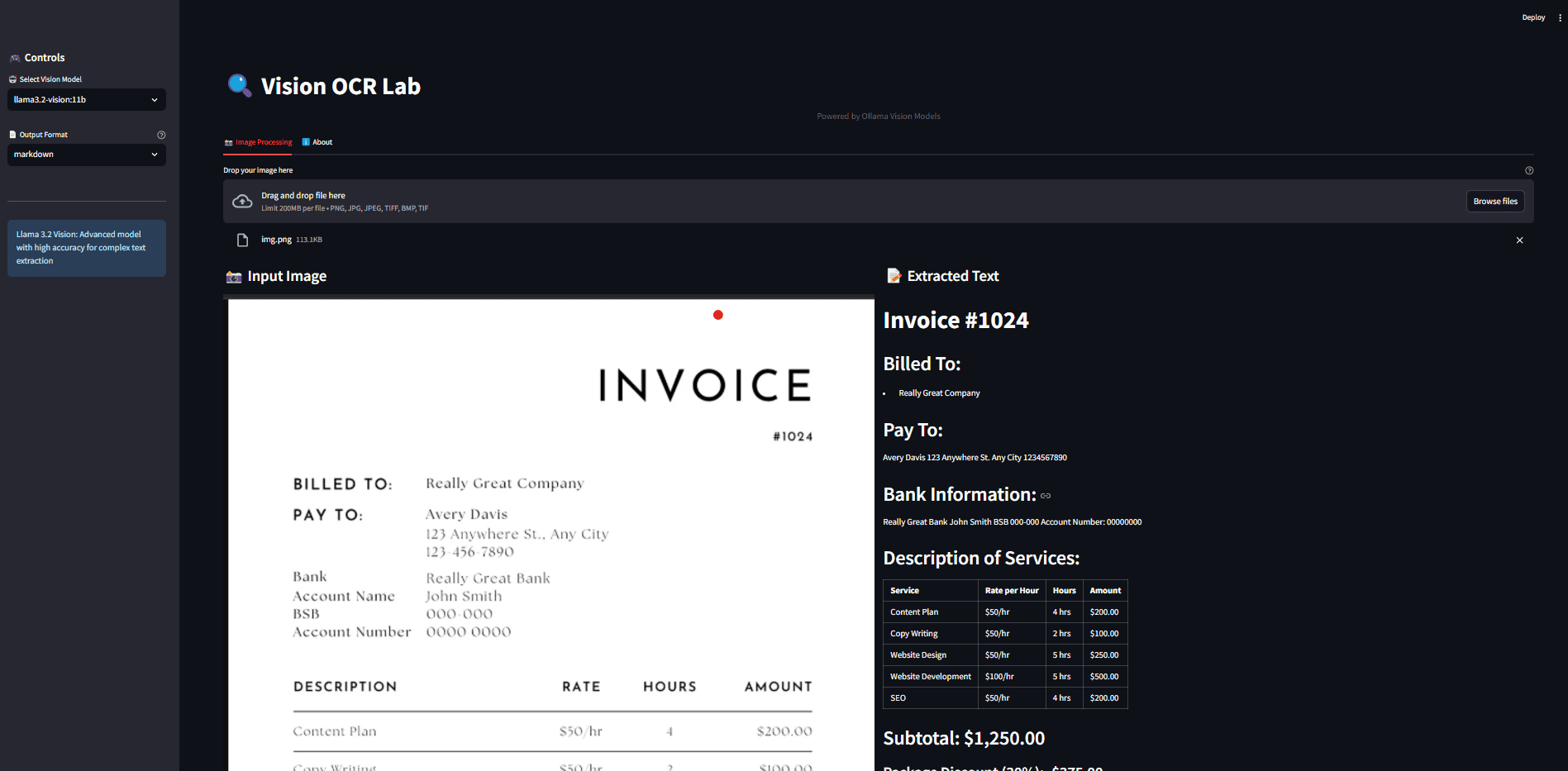

Ollama OCR ist ein leistungsfähiges Toolkit für die optische Zeichenerkennung (OCR), das Text aus Bildern extrahiert und dabei hochmoderne visuelle Sprachmodelle verwendet, die von der Ollama-Plattform bereitgestellt werden. Das Projekt ist sowohl als Python-Paket als auch als benutzerfreundliche Streamlit-Webanwendungsschnittstelle verfügbar. Es unterstützt eine breite Palette von Bildverarbeitungsmodellen, darunter LLaVA 7B für die Echtzeitverarbeitung und das hochpräzise Llama 3.2 Vision-Modell für komplexe Dokumente. Ollama OCR zeichnet sich durch die Unterstützung einer Vielzahl von Ausgabeformaten aus, darunter Markdown, reiner Text, JSON usw., sowie durch seine Stapelverarbeitungsfunktionen. Das Tool ist besonders für Entwickler und Forscher geeignet, die Textdaten aus Bildern extrahieren und strukturieren müssen.

Funktionsliste

- Unterstützung für mehrere fortgeschrittene visuelle Sprachmodelle (LLaVA 7B und Llama 3.2 Vision)

- Bereitstellung verschiedener Ausgabeformate (Markdown, einfacher Text, JSON, strukturierte Daten, Schlüssel-Wert-Paare)

- Unterstützt Stapelverarbeitungsfunktion, kann mehrere Bilder parallel verarbeiten

- Integrierte Bildvorverarbeitung (Größenänderung, Normalisierung usw.)

- Fortschrittskontrolle und Verarbeitungsstatistiken bereitstellen

- Unterstützt die benutzerfreundliche Streamlit-Weboberfläche

- Unterstützung des Hochladens von Bildern per Drag-and-Drop und Echtzeitverarbeitung

- Download-Funktion für extrahierten Text bereitstellen

- Integrierte Bildvorschau und detaillierte Informationsanzeige

Hilfe verwenden

1. die Installationsschritte

- Die Ollama-Plattform muss zuerst installiert werden:

- Besuchen Sie die offizielle Ollama-Website, um das Installationspaket für Ihr System herunterzuladen.

- Vervollständigen Sie die Grundinstallation von Ollama

- Installieren Sie das gewünschte visuelle Modell:

ollama pull llama3.2-vision:11b

- Installieren Sie das Ollama OCR-Paket:

pip install ollama-ocr

2. die Verwendung von Python-Paketen

2.1 Einzelbildverarbeitung

from ollama_ocr import OCRProcessor

# 初始化OCR处理器

ocr = OCRProcessor(model_name='llama3.2-vision:11b')

# 处理单张图像

result = ocr.process_image(

image_path="图片路径.png",

format_type="markdown" # 可选格式:markdown, text, json, structured, key_value

)

print(result)

2.2 Stapelverarbeitung von Bildern

# 初始化OCR处理器,设置并行处理数

ocr = OCRProcessor(model_name='llama3.2-vision:11b', max_workers=4)

# 批量处理图像

batch_results = ocr.process_batch(

input_path="图片文件夹路径",

format_type="markdown",

recursive=True, # 搜索子目录

preprocess=True # 启用图像预处理

)

# 查看处理结果

for file_path, text in batch_results['results'].items():

print(f"\n文件: {file_path}")

print(f"提取的文本: {text}")

# 查看处理统计

print(f"总图像数: {batch_results['statistics']['total']}")

print(f"成功处理: {batch_results['statistics']['successful']}")

print(f"处理失败: {batch_results['statistics']['failed']}")

3. wie man die Streamlit-Webanwendung nutzt

- Klonen Sie das Code-Repository:

git clone https://github.com/imanoop7/Ollama-OCR.git

cd Ollama-OCR

- Installieren Sie die Abhängigkeit:

pip install -r requirements.txt

- Starten Sie die Webanwendung:

cd src/ollama_ocr

streamlit run app.py

4. eine Beschreibung der Ausgabeformate

- Markdown-Formatierung: Beibehaltung der Textformatierung, einschließlich Überschriften und Listen

- Klartextformatierung: bietet eine saubere und einfache Textextraktion

- JSON-Format: Ausgabe im strukturierten Datenformat

- Strukturierte Formate: Tabellen und organisierte Daten

- Schlüssel-Wert-Paar-Format: Extrahieren von markierten Informationen

5. vorsichtsmaßnahmen

- Das LLaVA-Modell kann gelegentlich falsche Ergebnisse liefern, und es wird empfohlen, für wichtige Szenarien das Llama 3.2 Vision-Modell zu verwenden

- Die Bildvorverarbeitung kann die Erkennungsgenauigkeit verbessern

- Achten Sie bei der Stapelverarbeitung auf eine angemessene Einstellung der Anzahl der Parallelitäten, um einen übermäßigen Speicherverbrauch zu vermeiden.

- Es wird empfohlen, die Fortschrittsverfolgung einzuschalten, wenn eine große Anzahl von Bildern verarbeitet wird.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...