MOSS-TTSD - Tsinghua Labs Open-Source-Modell für zweisprachige Dialoge zur Spracherzeugung

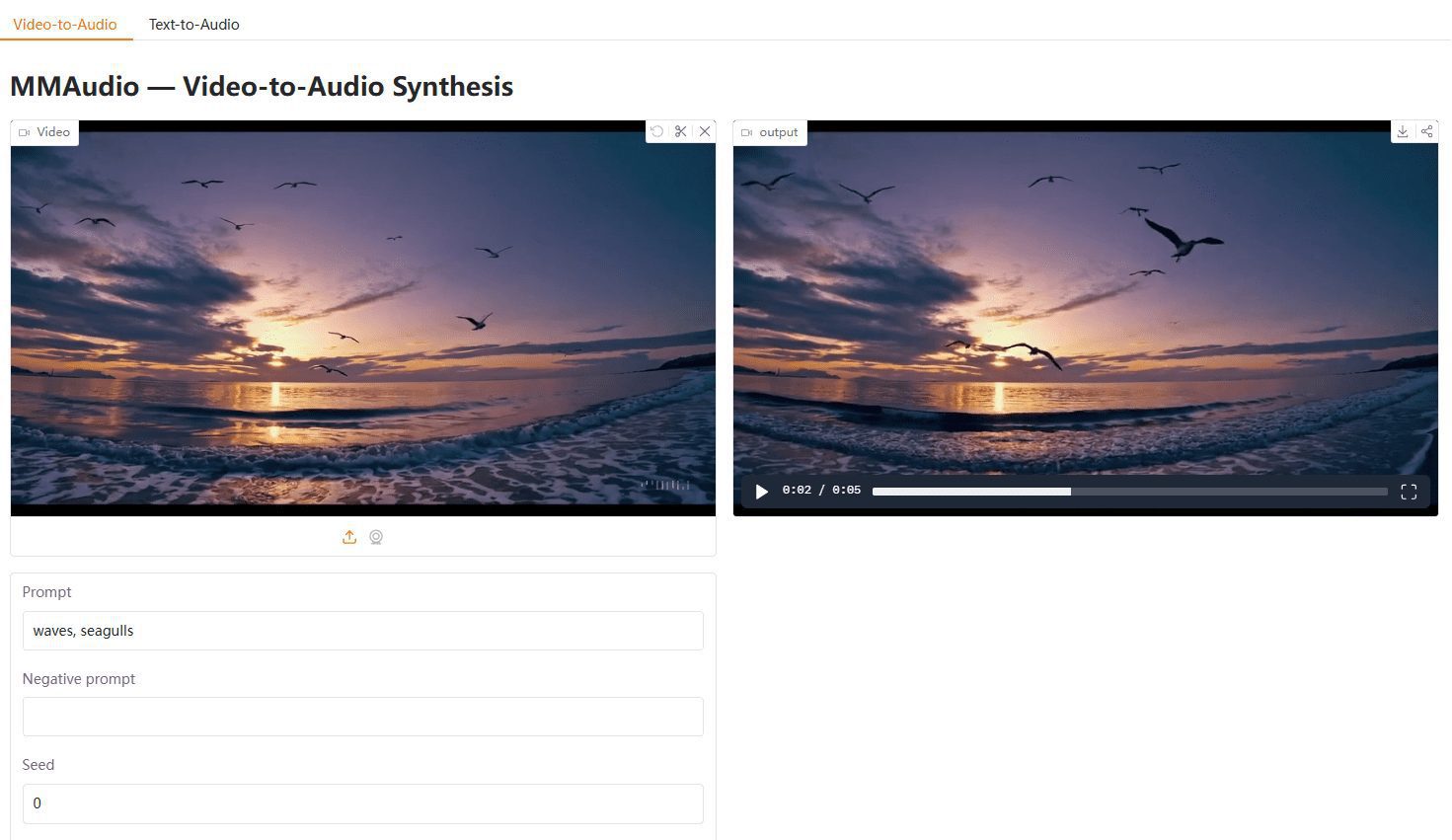

Was ist MOSS-TTSD?

MOSS-TTSD ist ein Open-Source-Modell für gesprochene Dialoge, das vom Speech and Language Lab der Tsinghua Universität entwickelt wurde. MOSS-TTSD kann Textdialogskripte in natürliche, flüssige und ausdrucksstarke Konversationssprache umwandeln und unterstützt die zweisprachige Generierung in Englisch und Chinesisch. Das Modell basiert auf einem fortschrittlichen semantisch-phonetischen neuronalen Netzwerk-Audiocodec und einem umfangreichen, vortrainierten Sprachmodell, kombiniert mit mehr als 1 Million Stunden an Ein-Personen-Sprachdaten und 400.000 Stunden an Konversations-Sprachdaten für das Training.MOSS-TTSD unterstützt das Klonen von Sprache ohne Samples, das genaue Stimmen für den Wechsel von Gesprächspartnern auf der Grundlage der Dialogskripte erzeugt, und erreicht das Klonen von Klangfarben ohne zusätzliche Samples.MOSS-TTSD ist für KI-Podcasts geeignet und kann in einer Vielzahl von Anwendungen eingesetzt werden. MOSS-TTSD eignet sich für KI-Podcasts, Film- und Fernsehsynchronisation, lange Interviews, Nachrichtenberichte und E-Commerce-Live-Sendungen usw. Es ist vollständig quelloffen und unterstützt die freie kommerzielle Nutzung.

Hauptmerkmale von MOSS-TTSD

- Natürliche und flüssige Erzeugung von DialogstimmenDie Fähigkeit, Textdialoge in natürliche, ausdrucksstarke Sprache zu übersetzen und dabei den Rhythmus und die Intonation des Dialogs präzise zu erfassen.

- Null-Abtastung beim Klonen von MehrlautsprechertönenGenerierung von Tönen verschiedener Gesprächspartner auf der Grundlage von Dialogskripten ohne zusätzliche Stimmproben für einen reibungslosen Dialogwechsel.

- Zweisprachige UnterstützungEs unterstützt die Erzeugung hochwertiger Sprache in Chinesisch und Englisch, um den Anforderungen mehrsprachiger Szenarien gerecht zu werden.

- Erzeugung von LangformsprachenDer Codec mit niedriger Bitrate ermöglicht die Erzeugung von bis zu 960 Sekunden Sprache in einem einzigen Durchgang und vermeidet so die unnatürlichen Übergänge von gespleißter Sprache.

- Open Source und Business ReadinessDie Modellgewichte, der Inferenzcode und die API-Schnittstellen sind vollständig quelloffen und unterstützen die freie kommerzielle Nutzung, was Entwicklern und Unternehmen eine schnelle Anwendungsentwicklung ermöglicht.

Offizielle Adresse der MOSS-TTSD-Website

- Projekt-Website:: https://www.open-moss.com/en/moss-ttsd/

- Github-Repositorien:: https://github.com/OpenMOSS/MOSS-TTSD

- HuggingFace-Modellbibliothek:: https://huggingface.co/fnlp/MOSS-TTSD-v0.5

- Online-Erlebnis-Demo:: https://huggingface.co/spaces/fnlp/MOSS-TTSD

Wie man MOSS-TTSD verwendet

- Vorbereitung der Umwelt::

- Installieren von NVIDIA-TreibernStellen Sie sicher, dass die neuesten Versionen der NVIDIA Treiber und des CUDA Toolkits installiert sind.

- Installation von Python und Abhängigkeiten::

pip install torch torchvision torchaudio transformers soundfile- Das Modell erhalten: Modelle von Hugging Face herunterladen::

git clone https://huggingface.co/fnlp/MOSS-TTSD-v0.5- Modelle laden und Sprache erzeugen

from transformers import AutoModelForTextToSpeech, AutoTokenizer

import soundfile as sf

# 加载模型和分词器

model_name = "fnlp/MOSS-TTSD-v0.5"

model = AutoModelForTextToSpeech.from_pretrained(model_name)

tokenizer = AutoTokenizer.from_pretrained(model_name)

# 输入文本

text = "你好,这是一个测试对话。"

inputs = tokenizer(text, return_tensors="pt")

# 生成语音

audio = model.generate(**inputs)

# 保存语音文件

sf.write("output.wav", audio.numpy(), model.config.sampling_rate)- Überprüfung der BetriebsumgebungGPU-Unterstützung prüfen::

import torch

print(torch.cuda.is_available())Die wichtigsten Vorteile von MOSS-TTSD

- Natürliche und flüssige SpracherzeugungDie Fähigkeit, einen Textdialog in eine natürliche, flüssige und ausdrucksstarke Sprache umzuwandeln, die den Reim und die Intonation des Dialogs genau wiedergibt.

- Klonen von Multi-Talker-TönenUnterstützt das Klonen von Null-Sample-Tönen, wodurch die Töne verschiedener Gesprächspartner ohne zusätzliche Sprachsamples erzeugt werden, was einen natürlichen Dialogwechsel ermöglicht.

- Zweisprachige UnterstützungUnterstützt qualitativ hochwertige Spracherzeugung sowohl in Chinesisch als auch in Englisch, um den Anforderungen mehrsprachiger Szenarien gerecht zu werden.

- Effiziente Datenverarbeitung und Pre-TrainingKombiniert mit umfangreichen Sprachdaten für das Training, basierend auf einem optimierten Trainingsrahmen, der eine hohe Qualität und Effizienz der generierten Sprache gewährleistet.

- Open Source und Business ReadinessDas Modell ist vollständig quelloffen und unterstützt die freie kommerzielle Nutzung, was die schnelle Einführung und Anwendung durch Entwickler erleichtert.

- Breite Palette von AnwendungsszenarienEs eignet sich für AI-Podcasting, Film- und TV-Synchronisation, lange Interviews, Nachrichtenberichte und E-Commerce-Live-Streaming.

- technologische InnovationVerbessert die Leistung und Effizienz der Spracherzeugung auf der Grundlage eines innovativen Sprachdiskretisierungs-Encoders, XY-Tokenizer, und eines Codecs mit niedriger Bitrate.

Personen, für die MOSS-TTSD bestimmt ist

- Ersteller von InhaltenVerwenden Sie es, um KI-Podcasts, Video-Voiceover, Nachrichtensendungen und vieles mehr zu produzieren, indem Sie schnell natürliche und flüssige Konversationssprachen erzeugen.

- Film & TV ProduktionsteamDurchführung von Dialogsynchronisationen für Film- und Fernsehproduktionen, Unterstützung des Klonens von Tönen mit mehreren Sprechern zur Steigerung der Produktionseffizienz.

- NachrichtenmedienGenerieren Sie natürliche Voice-over-Nachrichten, um die Attraktivität und Lesbarkeit von Nachrichten zu verbessern.

- E-Commerce-PraktikerBinden Sie Ihr Publikum ein und steigern Sie die Interaktivität mit digitalen menschlichen Dialogen in E-Commerce-Live-Übertragungen.

- Technologie-EntwicklerSekundäre Entwicklung mit Open-Source-Modellen, Integration in verschiedene Sprachanwendungen und Erweiterung der Funktionalität.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...