Apple stellt neues KI-Modell MM1 vor

Apple-Forscher haben gerade ein neues Papier veröffentlicht, in dem MM1 beschrieben wird, eine Familie von multimodalen KI-Modellen, die Sehen und Sprachverständnis kombinieren, um erweiterte Funktionen zu ermöglichen.

Einzelheiten.

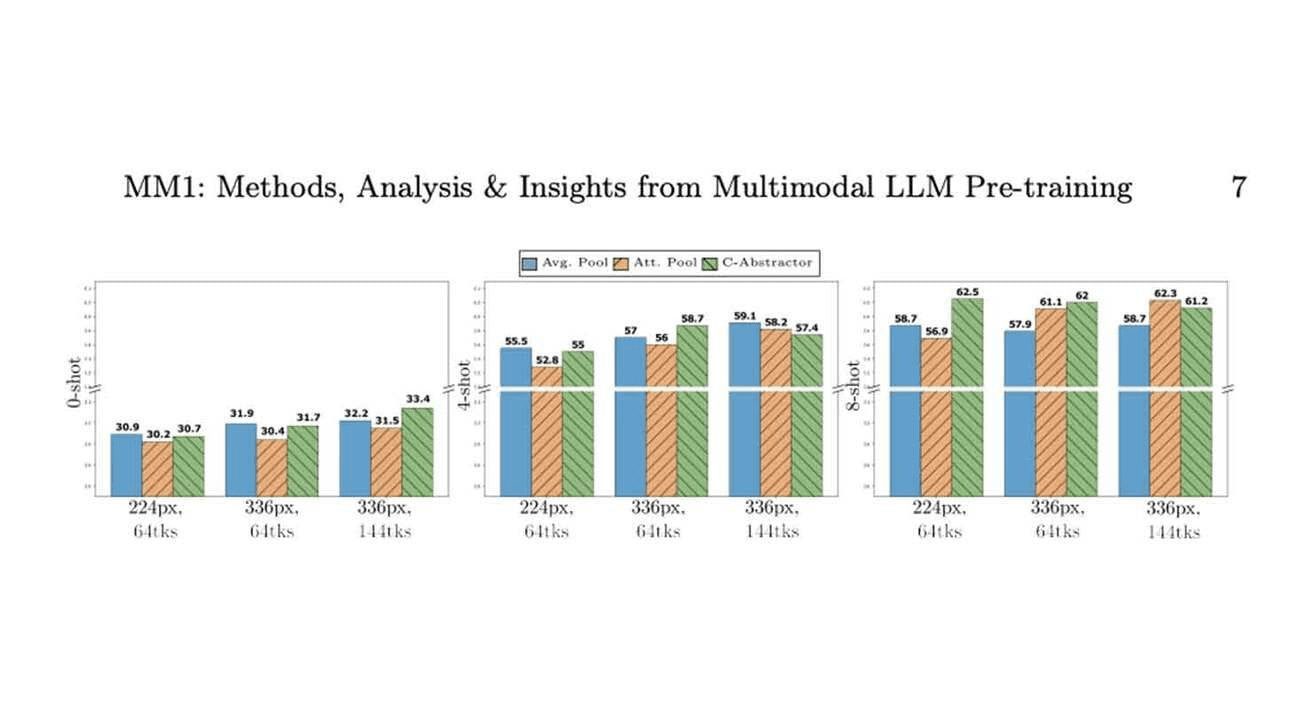

Das MM1-Modell wird mit einer sorgfältig zusammengestellten Mischung aus Bildunterschriften, Bildtextdaten und reinen Textdaten trainiert.

Das größte parametrische 30B-Modell zeigt, wie leistungsfähig das Lernen aus einer kleinen Anzahl von Beispielen und das Ableiten mehrerer Bilder ist.

Studie zeigt

Die Bildverarbeitung des skalierten Modells hat den größten Einfluss auf die Leistung.

Der MM1-Benchmark konkurriert mit modernen multimodalen Modellen wie GPT-4V und Gemini Pro.

Grund zur Besorgnis: Apples detaillierte und unauffällige Veröffentlichung neuer Modelle ist weit entfernt vom üblichen Stil der Geheimhaltung und ein großer Gewinn für Open-Source-Software. Jetzt, wo ein leistungsstarkes neues Modell offiziell verfügbar ist, ist Siri endlich bereit für ein Upgrade?

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...