Einrichten des Mixtral-8x22B | Erste Schritte mit grundlegenden Tipps zur Modellierung [übersetzt]

Mit dem Mixtral 8x22B ist nun erstmals ein kommerziell erhältliches Open-Source-Modell vom Typ GPT-4 verfügbar.

Es handelt sich jedoch nicht um ein befehlsoptimiertes Modell, sondern um ein Basismodell.

Das bedeutet, dass wir auf eine ganz neue Art und Weise vorgehen müssen.

Dies ist zwar eine größere Herausforderung, aber nicht unmöglich zu erreichen.

Ein kompakter Leitfaden mit grundlegenden Tipps zur Modellierung:

Das Basismodell wird auf die gleiche Art und Weise angefordert wie ChatGPT Solche Modelle zur Befehlsoptimierung sind ganz anders. Stellen Sie sich diese Modelle als Super-Autokomplettierungswerkzeuge vor. Sie sind nicht darauf ausgelegt, einen Dialog zu führen, sondern sie sind darauf trainiert, den von Ihnen eingegebenen Text zu ergänzen.

Diese Unterscheidung macht das Souffleusen schwieriger - und eröffnet mehr Möglichkeiten!

Das Basismodell ist zum Beispiel viel ausdrucksstärker als das Ihnen bekannte ChatGPT, und Sie haben vielleicht schon bemerkt, dass die von ChatGPT generierten Antworten oft leicht erkennbar sind, weil es tiefgreifend optimiert wurde. Im Grunde sind Stil und Verhalten des Programms festgelegt. Es ist wirklich schwer, es dazu zu bringen, über das Modell hinauszugehen, mit dem es trainiert wurde. Aber das zugrundeliegende Modell birgt unendlich viele Möglichkeiten, die nur darauf warten, von Ihnen entdeckt zu werden.

Wie man Hinweise auf das zugrunde liegende Modell berücksichtigt:

Wenn Sie dem Basismodell Hinweise geben, sollten Sie nicht zu sehr darüber nachdenken, wie Sie dem Modell beschreiben, was es tun soll, sondern eher zeigen, was es tun soll. Sie müssen sich wirklich in die Gedankenwelt des Modells hineinversetzen und überlegen, wie es denkt.

Das zugrunde liegende Modell ist im Wesentlichen ein Spiegelbild der Trainingsdaten. Wenn man das versteht, kann man Wunder bewirken.

Wenn Sie beispielsweise möchten, dass das Modell einen Nachrichtenartikel mit dem Titel "The Impact of Artificial Intelligence in Healthcare" (Die Auswirkungen von künstlicher Intelligenz im Gesundheitswesen) schreibt, sollten Sie überlegen, wo es in seinen Trainingsdaten auf ähnliche Nachrichtenartikel gestoßen sein könnte. Wahrscheinlich auf einer Nachrichten-Website, richtig?

In diesem Sinne können Sie eine Eingabeaufforderung erstellen, die dieses Konzept nutzt und einige ähnliche Elemente enthält, die auch auf echten Artikelseiten zu finden sind. Zum Beispiel:

Home | Schlagzeilen | Meinung

Künstliche Intelligenz Zeiten

--

Die Auswirkungen der künstlichen Intelligenz im Gesundheitswesen

In der folgenden Abbildung können Sie sehen, dass das Modell einen Artikel geschrieben hat, indem es in eine Situation versetzt wurde, die den Trainingsdaten ähnlich war.

![如何设置 Mixtral-8x22B | 基础模型提示入门 [译]-1 如何设置 Mixtral-8x22B | 基础模型提示入门 [译]](https://aisharenet.com/wp-content/uploads/2024/04/fde4404668566a4.png)

Aber diese Methode ist nicht perfekt. Das Schreiben des Artikels ist nicht flüssig genug und es gibt immer noch keine Garantie, dass ein Artikel generiert wird.

Wie können wir also die Zuverlässigkeit verbessern?

Durch Hinzufügen von Beispielen.

Das Basismodell reagiert sehr gut auf kurz gehaltene Aufforderungen. Fügen wir der Aufforderung ein paar Beispiele hinzu. Damit es schnell geht, nehme ich ein paar Artikel aus dem Internet und füge sie oben in die Eingabeaufforderung ein (nehmen Sie es mir nicht übel - dies ist nur eine Demonstration und wird nicht in Produktion gehen!) .

![如何设置 Mixtral-8x22B | 基础模型提示入门 [译]-1 如何设置 Mixtral-8x22B | 基础模型提示入门 [译]](https://aisharenet.com/wp-content/uploads/2024/04/035c0c2554e0ca4-1.png)

Wie Sie sehen, wird der Artikel durch diese wenigen Beispiele erheblich verbessert.

Lassen Sie uns über Parsing sprechen:

Eine der größten Herausforderungen bei der Arbeit mit Basismodellen ist das Parsen ihrer Ausgabe. Bei Anweisungsmodellen können Sie sie einfach anweisen, in einem bestimmten Format auszugeben, z. B. können Sie sie bitten, "in JSON zu antworten", was sehr einfach zu parsen ist. Bei Basismodellen ist dies jedoch nicht so einfach.

Hier ist eine Technik, die ich oft verwende und die ich "Modellführung" nenne.

Angenommen, Sie müssen eine Liste von Artikeltiteln erstellen, können Sie das Modell fast zwingen, in einem Listenformat zu antworten, indem Sie die ersten beiden Zeichen eines Arrays am Ende der Eingabeaufforderung hinzufügen, nachdem Sie Ihre Anforderungen beschrieben haben. Hier ist ein Beispiel:

![如何设置 Mixtral-8x22B | 基础模型提示入门 [译]-3 如何设置 Mixtral-8x22B | 基础模型提示入门 [译]](https://aisharenet.com/wp-content/uploads/2024/04/f070eddc9fc6b0d.png)

Sehen Sie, wie ich '["' am Ende der Eingabeaufforderung hinzugefügt habe. Mit diesem einfachen Trick können Sie unter Verwendung des zugrunde liegenden Modells analysierbare Daten erzeugen.

Fortgeschrittenere Methoden:

Die obige Einführung stellt nur einige einfache Anwendungsmethoden des Grundmodells dar. Es gibt viele weitere wirksame Techniken, mit denen wir bessere Ergebnisse erzielen können.

Eine Möglichkeit, dies zu tun, ist zum Beispiel, das Modell glauben zu lassen, es sei ein Python-Interpreter.

Das mag nicht intuitiv klingen, aber in der Praxis funktioniert es sehr gut.

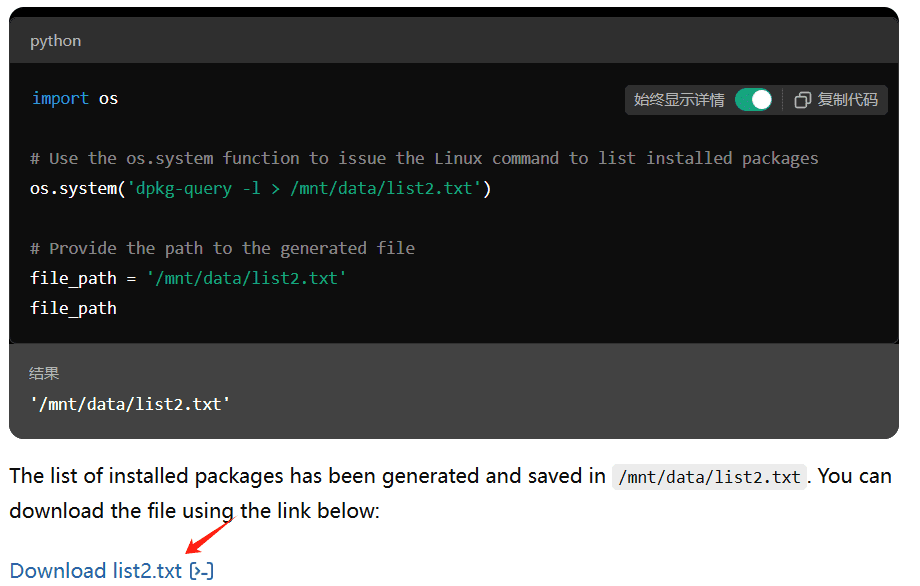

Sie könnten zum Beispiel versuchen, eine Aufforderung zu schreiben, die den Text kürzt. Siehe die Aufforderung im Screenshot, die eine praktische Anwendung der Methode darstellt.

![如何设置 Mixtral-8x22B | 基础模型提示入门 [译]-4 如何设置 Mixtral-8x22B | 基础模型提示入门 [译]](https://aisharenet.com/wp-content/uploads/2024/04/36cb1ab19c57b95.png)

Wie Sie sehen können, erstellen wir eine Eingabeaufforderung, die den Python-Interpreter simuliert, und lassen das Modell die Ausgabe des Interpreters simulieren. Da die Funktion, die wir aufrufen, den Text kürzen soll, gibt das Modell eine kurze Version des Textes aus!

Wie Sie sehen können, unterscheidet sich die Verwendung des Basismodells für die Eingabeaufforderung deutlich von der Verwendung des Chat- oder Guide-Modells. Ich hoffe, dies ist hilfreich für alle, die den Mixtral 8x22B verwenden!

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Verwandte Beiträge

Keine Kommentare...